Archives

SKEYETECH : Un drone intelligent pour sécuriser les sites industriels

SKEYETECH est une entreprise d’ingénierie mécatronique spécialisée dans la conception de solutions drones innovantes. Créée en 2014 par 3 ingénieurs passionnés d’aéronautique, la société compte aujourd’hui parmi son équipes 15 personnes aux compétences pluridisciplinaires. Son expertise dans 5 grands domaines (mécanique, électronique, intelligence embarquée, capteurs et liaison de données) lui permet de concevoir des produits drones durcis pour les secteurs de l’inspection, de la surveillance et de la défense.

Le marché du drone promet de grandes possibilités mais fait face à de nombreux freins : présence obligatoire d’un télépilote, homologations DGAC, manque d’autonomie, manque de fiabilité des machines…

C’est pour lever ces freins que SKEYETECH a développé la première solution de drone autonome et sans pilote. Cette solution révolutionnaire, permettant d’assurer des missions à forte récurrence et avec une grande réactivité, comprend un drone au fonctionnement autonome, grâce à un progiciel intégré, ainsi qu’une base d’accueil et de rechargement.

Le drone pourra ainsi décoller automatiquement de sa base sur alerte ou sur demande d’un opérateur afin de se rendre directement sur le point désigné. Sur place, il pourra capter des images permettant de lever le doute ou valider une inspection avec une rapidité d’intervention hors normes. A l’issue de sa mission, le drone rejoindra, seul, sa base avec une précision d’atterrissage unique afin de se recharger dans un espace protégé et sécurisé. La simplicité d’utilisation est liée au fait que toutes ces opérations se font sans l’intervention d’aucun pilote.

- Le drone est un quadri-rotor à décollage vertical avec une autonomie de 25 minutes. Il peut être équipé d’une grande variété de capteurs (jour-nuit, thermique…) afin de distinguer une intrusion dans toutes les conditions climatiques. Il présente de nombreuses redondances électroniques et systèmes de sécurité (batteries de secours, monitoring système…) pour assurer une fiabilité.

- La base d’accueil est identifiée via une connexion sécurisé Opérable à distance, elle assure le lien entre le drone, l’interface logicielle, et l’opérateur. Son ouverture, sa fermeture, ainsi que le recentrage du drone sont complètement automatisés. Via son interface logicielle, elle assure un déploiement du drone en moins de 30 secondes. Conçue pour abriter le drone et testée dans toutes les conditions climatiques, la station ainsi que tous ses composants ont été choisis afin de respecter les standards aéronautiques et un indice de protection IP67. Des prises Ethernet et USB sont facilement accessibles pour des opérations de maintenance simplifiées. Elle peut être alimentée via une alimentation de type secteur ou un groupe électrogène.

- L’interface logicielle permet à l’opérateur, via une tablette / un smartphone / un poste de sécurité de démarrer une mission de routine ou de prendre directement la main sur les caméras du drone. Une fonctionnalité « click and go» est également disponible afin de permettre une levée de doute en toute simplicité.

Le développement de cette solution a été mené en étroite collaboration avec la DGAC afin d’obtenir les autorisations réglementaires nécessaires à un usage sans intervention humaine. SKEYETECH est aujourd’hui la seule entreprise française à avoir des dérogations pour opérer sans télépilote, sur sites privés, de jour comme de nuit.

L’entreprise vise la commercialisation des premiers systèmes début 2018 via son partenaire et installateur français DRONE PROTECT SYSTEM.

Pour plus d’informations : www.skeyetech.fr

OptimData : Et si les machines pouvaient parler ?

Fondé il y a un peu plus de deux ans par Laurent Couillard et Etienne Droit, OptimData est né du constat que la digitalisation est à la fois un défi majeur et une opportunité pour le secteur industriel, dont la majeure partie n’a à ce jour pas intégré la révolution numérique.

Les défis que rencontre l’ensemble des acteurs du secteur (les producteurs de machines-outils et équipements, mais également leurs clients qui sont des producteurs de biens et services) sont multiples et nécessitent de revoir en profondeur certaines stratégies d’entreprise. Ainsi, l’augmentation de la compétition résultant notamment du fait de l’arrivée de nouveaux acteurs à envergure mondiale nécessite de disposer d’un outil de production à forte valeur ajoutée pour rester compétitif. Par ailleurs, des nouvelles technologies comme l’impression 3D peuvent intermédier des segments entiers, comme par exemple le marché des pièces détachées, qui est actuellement la principale source de revenu après-vente pour des producteurs d’équipements industriels. Enfin, les cadences de production actuelles et la versatilité des biens de grande consommation représentent des nouveaux défis pour la gestion de la disponibilité des machines (reconfigurations fréquentes etc.), la gestion des coûts et les procédures de sécurité.

Or, l’internet des objets industriels permet de répondre à ces enjeux de manière efficace en créant de nouveaux business modèles, en rendant les machines plus intelligentes, et en « augmentant » les hommes dans les usines. Cette perspective a poussé OptimData à développer sa solution ProductInUse, un logiciel destiné à répondre aux challenges des industriels souhaitant digitaliser leur outil et leur environnement de production.

ProductInUse est une application disponible sur mobile et PC, dont le fonctionnement repose sur deux volets innovants. Le premier est un outil de conception d’intelligence artificielle (« IA ») pour machines et équipements industriels. Reposant sur une exploitation big data et IoT, il permet aux ingénieurs de systèmes experts, d’identifier, designer, simuler et publier l’IA de machines. L’utilisateur est assisté dans la manipulation de données pour créer des algorithmes avancés. L’outil lui permet de créer des niveaux d’abstraction nécessaires au développement d’une IA et de conférer aux machines un langage qui est distribué facilement et à juste coût. Les machines exploiteront l’IA en contexte de leur propre production à travers une communauté de performance connectée. Cette communauté est le deuxième volet de ProductInUse. Les machines publient des messages et font des suggestions d’actions dans des fils d’actualité (assimilables à des carnets de santé de la machine). Elles interagissent telles des amies avec toutes les parties prenantes de la chaîne de production. L’utilisation de nouveaux paradigmes induits par l’évolution d’internet (mobilité, réseau social, outils collaboratifs) permet l’adoption rapide de cet outil.

La combinaison d’un service de conception assistée d’IA avec un outil de communauté de performance permet aux clients d’OptimData de développer des nouveaux services, que la jeune startup qualifie de services digitaux. Ces services digitaux ont vocation à véritablement être au cœur de la stratégie de digitalisation des industriels, car ils permettent de créer des nouvelles sources de revenus et d’améliorer les marges opérationnelles. Les applications envisageables sont très nombreuses (maintenance prescriptive, paiement à l’usage, coaching de performance, traçabilité logistique…) et OptimData collabore étroitement avec des industriels français et européens pour identifier et exploiter ces relais de croissance. Ainsi, l’adoption de la solution ProductInUse a par exemple permis à Sidel, leader mondial des solutions PET pour le conditionnement des liquides alimentaires, d’annoncer au salon drinktec 2017 la commercialisation de machines connectées capables d’utiliser plus de 80 expressions de langage pour auto-diagnostiquer des pannes et de suggérer la meilleure action corrective.

Pour plus d’informations : www.optimdata.eu

i-Guard : Une solution intelligente et autonome pour une cyber sécurité renforcée dans les entreprises

Dès cette époque, les fondateurs d’i-Guard avaient identifié qu’il était impossible pour un système antivirus classique de bloquer chaque jour de nouvelles cyber menaces toujours plus nombreuses et innovantes. La quadrature du cercle est en effet impossible à résoudre pour une solution classique reposant sur des bases de signatures : comment identifier, créer une réponse (basée sur cette identification) et la propager aux ordinateurs de ses clients quand il y a chaque jour 14 000 nouvelles menaces ?

En parallèle de cette évidence, l’équipe i-Guard a défini comme premier objectif de cerner les cibles facilement accessibles aux cyber pirates. Ainsi, il a été possible de déterminer qu’il fallait protéger les EndPoints (PC, portables, serveurs, smartphones) et principalement axer les efforts sur la sécurisation du système d’exploitation Windows (80% du marché mondial), cible principale des cyber attaques.

i-Guard a donc mis au point un module d’intelligence artificielle à installer directement dans le cœur de chaque EndPoint. Cette installation se fait via une console de management qui possède plusieurs fonctionnalités :

- Installer i-Guard sur chaque EndPoints

- Remonter et Centraliser les informations de sécurité

- Agir sur la sécurité

- Gérer les licences

L’intelligence artificielle est un noyau auquel i-Guard a appris les bases de la cyber sécurité mais qui évolue au fur et à mesure des attaques. Elle est également capable de peser les risques en fonction d’analyses en temps réel du comportement du système et des applications qui y sont installées. De fait, il n’y a plus besoin de faire appel à des définitions pour bloquer les menaces et i-Guard bloque les menaces totalement inconnues comme il l’a fait avec le ransomware Wannacry et le wiper NotPetya

Les applications possibles sont illimitées : de la simple protection informatique à la protection d’outils et de chaînes de production en passant par la protection d’éléments connectés (TV, frigo !) ou autonomes comme le seront les voitures dans le futur.

Pour plus d’informations : www.i-guard.eu

Challenge « Industrie du Futur », interview #6 : i-Guard

CYM : La Maintenance Prédictive, levier de productivité pour tous les industriels

La start-up parisienne fournit un service unique de maintenance prédictive. Le constat des deux dirigeants Ahmed Drif et Guillaume Le Vézouët est simple. Les Petits et Moyens Industriels n’ont pas de Branche “IoT” ou “Data Science” et se sentent perdus dans cette tendance dite de l’Industrie 4.0. C’est dans ce contexte qu’a été créé CYM (Connect Your Machine) en 2015 pour donner accès aux industriels aux technologies permettant d’améliorer la productivité de leurs parcs de machines.

Le premier objectif était de pouvoir rendre visible les taux d’usages des machines, en intégrant des capteurs correspondant aux paramètres à remonter, tels que la vibration, la pression ou encore la consommation électrique. Grâce à son écosystème de startups et fabricants renommés tels Bosch, CYM a la capacité d’intégrer les sensors qui remonteront les données pertinentes. Ces informations accessibles sur la Maintenance Factory permettent de mieux planifier les maintenances et surtout d’apprendre du comportement des machines.

Les travaux de recherches ont permis de mettre au point des algorithmes prédictifs pouvant être appliqués selon les besoins des métiers. S’améliorant cycle après cycle, ceux-ci permettent d’anticiper les défaillances et d’initier une opération de maintenance en amont de la panne.

Grâce à cette solution, l’industriel est accompagné dans la collecte, le transport et l’analyse des données.

De plus, les travaux actuellement menés avec un laboratoire de recherche permettront d’établir des paramètres de sécurité uniques permettant de garantir la confidentialité des données.

C’est en partenariat avec un industriel que CYM a par exemple développé une solution de supervision des filtres à air et d’optimisation de la maintenance sur site de Power Generation. La Maintenance Factory analyse la variation des débits volumiques en fonction des pressions différentielles dans plusieurs configurations et, corrélée à des facteurs externes, prédit les opérations de maintenance à venir.

La Maintenance Factory est aujourd’hui en place chez plusieurs PMI, ainsi qu’en POC chez de grands groupes français mais la jeune pousse ne compte pas s’arrêter en si bon chemin. Afin de financer sa croissance et la commercialisation de son offre, CYM prépare une levée de fond prévue pour fin 2017 et ambitionne de devenir le porte-drapeau de la performance industrielle.

Pour plus d’informations, rendez-vous sur le site www.cym-iot.com – Twitter : @Cym_IoT – LinkedIn : Cym-Predictive Maintenance

Challenge « Industrie du Futur », interview #5 : CYM

Challenge « Industrie du Futur », interview #4 : Spin off LETI

Spin off LETI : Les détecteurs spectrométriques de rayons X qui « voient » les liquides dans nos bagages à main

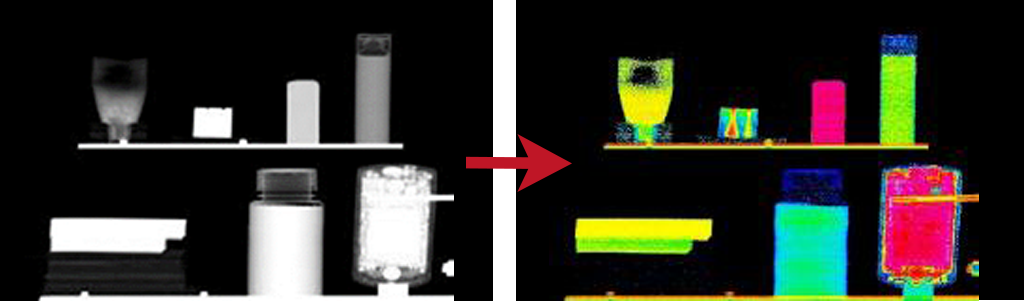

La coopération entre le LETI et MultiX est à l’origine du développement par MultiX de la première génération de détecteurs spectrométriques ME100. L’expertise du LETI, d’une part en conception et tests d’ASIC, traitement de signal et détecteurs à base de semi-conducteur de type CdTe/ Cd(Zn)Te et d’autre part en traitement de l’information multi-énergie X pour la discrimination de différents matériaux dans le cadre des applications de contrôle de bagages de cabine et du tri de déchets. Cette coopération a permis le transfert de ces briques technologiques à MultiX.

Le but final était de développer une barrette de détection spectrométrique à base de semi-conducteurs CdTe pour de forts flux X et d’y associer une méthode d’exploitation du signal multi-énergie de façon à améliorer l’identification du contenu d’un bagage à l’aéroport. Il s’agissait de démontrer l’amélioration apportée par la multi-énergie aux systèmes actuels qui exploitent une information biénergie. En particulier, ces détecteurs présentent des limites dans l’identification des matériaux organiques et conduisent à un taux important de fausses détections.

Le principal challenge pour le LETI était l’obtention EN TEMPS REEL d’un signal spectrométrique avec une résolution énergétique meilleure que 10% à 100keV à des flux de l’ordre de 3Mcps/s/mm2. Une spécification associant vitesse et précision a priori très difficile à tenir !

Le Laboratoire Detecteurs (LDET) du LETI a mis au point une nouvelle électronique rapide de comptage et un traitement spécifique des coups détectés. Cette nouvelle électronique a permis d’obtenir le taux de comptage souhaité avec une spectrométrie présentant une excellente résolution en énergie (de l’ordre de 9%) à un flux de 3Mcps/s/mm2 (flux nominal de rayonnement pour un système de contrôle de bagages). 8 brevets ont été déposés sur lesquels la technologie de MultiX s’appuie aujourd’hui.

Ces dernières années, on a vu l’émergence des détecteurs de rayonnement X à conversion directe réalisés à base de semi-conducteurs de type Cd(Zn)Te fonctionnant à température ambiante et pouvant se segmenter en électrodes (imagerie) avec des capacités spectrométriques (quantification). Couplées à un circuit de lecture CMOS permettant d’intégrer de nouvelles fonctionnalités, ces architectures ont ouvert des possibilités de traitement de l’information multi-énergie apportant ainsi des performances nouvelles aux systèmes d’imagerie RX et gamma. L’enjeu majeur est désormais la généralisation de l’ « imagerie couleur » dans le domaine de la sécurité afin de détecter les substances illicites et les explosifs dans les bagages aériens, le contrôle non destructif permettant, entre autres, de discriminer plus finement tout objet indésirable dans l’industrie agro-alimentaire, le tri de déchets conduisant à un processus de recyclage plus efficace et l’imagerie médicale.

Pour plus d’informations : www.leti-cea.fr

Challenge « Industrie du Futur », interview #3 : Scortex

Scortex : L’intelligence artificielle pour transformer l’inspection visuelle au service de la qualité

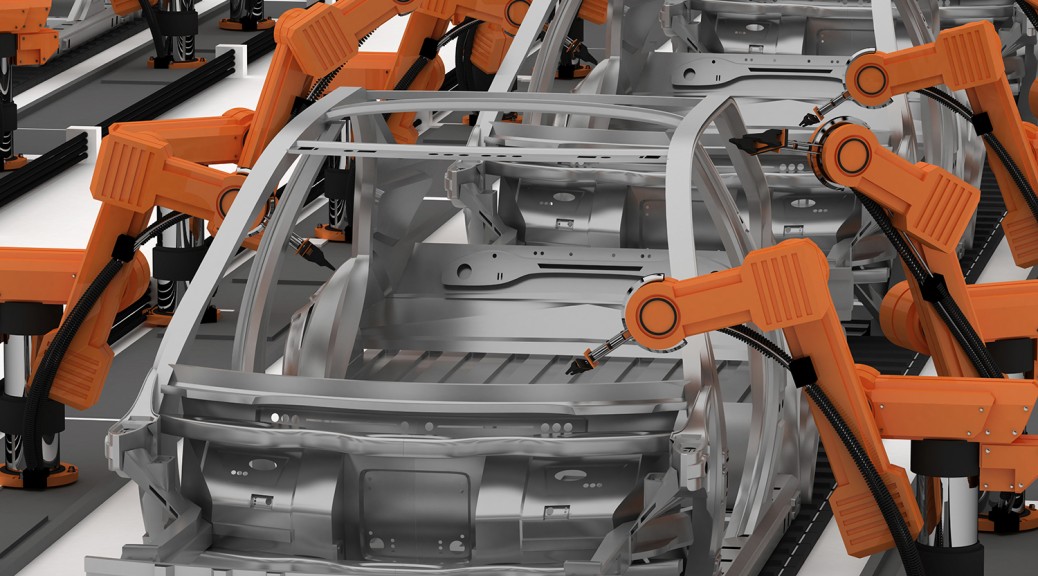

L’industrie manufacturière est confrontée à une multitude de défis. La concurrence mondiale féroce et la vitesse de production toujours croissante exigent l’amélioration continue de la qualité de ses produits et services. L’augmentation des coûts de la main-d’œuvre et des cadences de production exige des processus de contrôle plus efficaces et une grande agilité.

A l’heure de l’Industrie 4.0, l’une des plus grandes améliorations potentielles est l’automatisation de l’inspection visuelle, tâche encore effectuée essentiellement manuellement. Un inspecteur humain introduit une forte variance dans la réalisation de l’inspection et ces inspections sont d’une grande pénibilité. De ce fait, la collecte d’informations liées aux contrôles ne peut pas être utilisée pour en tirer de conclusion globale. Les techniques de traitement d’image traditionnelles ont échoué dans l’automatisation des tâches d’inspections complexes. Une approche disruptive était nécessaire pour automatiser ces inspections sur les chaînes de production.

Scortex propose une solution d’inspection qui combine vision industrielle et deep learning. Celle-ci permet d’atteindre des niveaux inégalés en détection et cadence de contrôle.

Ce produit est destiné à l’ingénieur contrôle qualité. A partir de ses spécifications qualité et d’une base d’images, il peut créer une application d’inspection personnalisée à sa production. Grâce à une interface intuitive, aucune connaissance en deep learning n’est nécessaire.

L’application est facilement déployée en production grâce à une box connectée. Celle-ci est plug&play avec les caméras industrielles et peut communiquer avec l’ensemble des machines grâce à l’intégration des protocoles industriels. L’analyse est faite en temps-réel et le contrôle qualité n’est plus une étape ralentissant la supply chain. La synergie logiciel et hardware donne la possibilité d’une amélioration agile et d’adapter rapidement le contrôle à de nouveaux produits. La robustesse est une priorité dans les développements. . Scortex développe une architecture de calcul propriétaire pour l’exécution d’algorithme de deep learning.

Le flux d’images est converti en information utile et structurée : taux, type et location des défauts sur 100% de la production. Cela permet d’avoir une vue globale de la qualité des produits en temps réel et d’effectuer des analyses fines a posteriori.

Scortex déploie actuellement sa solution dans des usines du secteur automobile, des biens de consommation et dans les fonderies à travers l’Europe pour des applications de contrôle de pièces plastiques, métalliques ou peintes.

Pour plus d’informations : http://scortex.io/

Challenge « Industrie du Futur », interview #1 : Enovasense

Enovasense révolutionne le contrôle des revêtements

Enovasense a été fondée en 2013 par Jean Inard-Charvin et Geoffrey Bruno, deux ingénieurs de l’Institut d’Optique (Palaiseau). En 4 ans, les étapes clés du lancement de la société sont validées : dépôt du brevet à l’international, validation du produit sur des dizaines d’applications, mise en service d’appareils en ligne de production dans le Monde entier, augmentation de capital auprès d’un fonds d’investissement, développement d’un réseau de distribution à l’international…

L’engouement pour la technologie Enovasense tient à la combinaison d’un marché potentiel vaste et d’un besoin aujourd’hui mal desservi. Une peinture sur un avion, un revêtement antifriction dans un moteur ou sur une prothèse médiale, un plaquage sur un bijou, un traitement anticorrosion sur une pièce d’escalade… les cas d’applications se comptent par centaines. Pourtant les techniques existantes de mesure de l’épaisseur, principalement à contact ou destructives étaient cantonnées au contrôle manuel de fin de production, sur un échantillon de pièces.

La technologie Enovasense repose sur le principe de radiométrie photothermique laser. Un laser provenant de la tête de mesure vient échauffer très légèrement la couche à mesurer. Ce flux de chaleur, généré ainsi sans contact avec la pièce se diffuse dans la couche jusqu’au substrat. Arrivé à cette interface, il repart dans la direction opposée et revient à la surface. La tête de mesure possède aussi un détecteur infrarouge qui observe la surface et collecte ce retour de chaleur. Les algorithmes d’Enovasense peuvent alors interpréter les informations provenant de ce signal thermique pour les relier à l’épaisseur de la couche. En effet, plus l’épaisseur est importante, plus le signal thermique qui la traverse est atténué et retardé.

Les avantages de cette technologie sont nombreux. Elle permet de mesurer quasiment tous les revêtements sur tous types de substrats parfois jusqu’à un millimètre d’épaisseur. La mesure se fait totalement sans contact avec la pièce, ce qui permet de l’intégrer sur des lignes en mouvement pour mesurer des pièces à la volée, de contrôler des revêtements encore humides, à haute température ou difficilement accessibles. Enovasense a compacté la tête de mesure à l’extrême de façon à l’intégrer dans les situations industrielles les plus complexes.

Grâce à ces avantages, les industriels peuvent contrôler jusqu’à 100% des pièces produites, avoir un suivi en direct de leur process de production pour optimiser la consommation de matière première, améliorer la qualité et la conformité des pièces et réagir en cas de dérive.

Pour plus d’informations : https://enovasense.com

EXPERT TELEPORTATION : La téléportation pour les industriels

La disponibilité du matériel et de l’expertise est un enjeu majeur des entreprises industrielles. 82% des interventions sont très techniques et les experts, ressources rares, perdent beaucoup de temps dans les transports avant de pouvoir intervenir.

Il y a de sérieux problèmes de compétences (+81% des sociétés industrielles vont avoir des problèmes avec des départs à la retraite de techniciens qualifiés, 51% n’ont pas de documentation à jour, 75% connaissent des difficultés à trouver de la main d’œuvre, 87% cherchent à réduire le coût de leur déplacement). Les outils actuels de communication n’empêchent que partiellement les déplacements. En effet, un appel téléphonique ne permet pas de voir une situation, une photo n’est pas interactive, une caméra GoPro ne permet pas une diffusion/discussion en temps réel, un smartphone avec Skype ne permet pas d’avoir les mains libres, etc.

EXPERT TELEPORTATION est unique en son genre : elle assemble le meilleur de chaque technologie pour une télé-assistance en temps réel. Pour la première fois, un expert peut voir une situation au travers des yeux d’un technicien grâce à des lunettes connectées, potentiellement à des milliers de kilomètres, comme s’il était lui-même sur place ! Les mains du technicien se retrouvent totalement libres et l’expert peut donc les guider à distance exactement comme s’il était dans la peau du technicien. Voici une vidéo de cas d’utilisation.

Bref, c’est Mission Impossible (ou tout autre film high tech) en vrai ! EXPERT TELEPORTATION s’appuie sur une expertise particulière sur la connectivité, une optimisation logicielle pour une utilisation ultra performante par rapport aux autres outils de vidéo-conférence, d’ergonomie et c’est aussi la seule entreprise au monde à customiser intégralement des lunettes connectées du marché. Plus de 20 awards ont récompensés la technologie ces 18 derniers mois.

Alors que l’entreprise était spécialisée dans le développement d’applications mobiles pour les professionnels et le grand public, Frédéric a l’idée de cette solution de télé maintenance en observant son père, lui-même directeur technique, plus de 200 jours par an en déplacement. C’est donc bien d’un besoin du terrain qu’est né ce produit.

L’objectif est donc de réduire drastiquement les coûts des entreprises industrielles : suppression des frais de déplacement, démultiplication de la productivité, meilleure satisfaction client, transfert de compétences plus rapide entre les salariés, diminution des pertes d’exploitation, mise en sécurité, plus de collaboratif entre les différences services et les fournisseurs. Des clients comme Veolia (leader mondial gestion de l’eau), Technip, Henkel ou encore Peugeot Citroën (4ème constructeur automobile européen) effectuent aujourd’hui des opérations en 20 minutes qui prenaient 2 jours de déplacement sans la technologie.

Pour plus d’informations : www.expert-teleportation.com

Picomto : La capture et diffusion du savoir-faire opérationnel dans l’industrie

Aujourd’hui, l’industrie est liée à la problématique de transmission du savoir : vieillissement de la population, turnover du personnel, le besoin de former les nouveaux arrivants, l’inexistence du transfert de connaissances, la complexité de la centralisation du savoir, nécessité de suivre des procédures…

La transmission du savoir-faire dans l’industrie se fait principalement au travers des instructions de travail, modes opératoires, procédures de maintenance, procédures internes… qui sont rédigés aujourd’hui à 99% sur des logiciels comme la suite Microsoft Office. Des solutions qui ne sont pas dédiées à ces finalités et qui du coup génèrent des conséquences :

- Pas de normalisation

- Diffusion sans maîtrise

- Pas de traçabilité

- Mises à jour laborieuses…

Il y a donc un réel besoin pour les industriels d’avoir une solution dédiée à la création, gestion, partage, consultation et analyse d’instructions de travail.

Fort de ce besoin, Picomto a développé sa solution ouverte (API) pour capturer et diffuser le savoir-faire opérationnel dans l’industrie avec un double objectif : Faciliter la formalisation du savoir-faire et faciliter sa compréhension et son exécution. La solution s’inscrit dans le courant de l’industrie du futur et peut s’intégrer à d’autres systèmes d’informations (ERP, GMAO..). C’est un véritable outil permettant de créer des instructions de travail ISO 9001.

Pour cela, la start-up a imaginé un format qui est piloté par le visuel. Chaque instruction comprend un ensemble de page, et par page on trouve une image/vidéo accompagnées d’annotations textuelles de 400 caractères ainsi que des formulaires de capture de données terrain.

Toutes les instructions visuelles de travail créées dans Picomto sont traçables, normalisées, multilingues et peuvent être modifiable à tout moment pour entrer dans une démarche d’amélioration continue. La solution est disponible sous navigateur web et application Androïd avec une gestion en mode connecté et déconnecté.

La solution est dédiée au secteur industriel. L’usage qui en est fait est polyvalent : production, fabrication, maintenance, qualité, exploitation… Par exemple, parmi les clients de Picomto :

- Dans un objectif d’augmentation de la qualité et de réduction des non-conformités sur ses lignes de production, un sous-traitant dans l’automobile a intégré des écrans à chaque poste de travail pour que les opérateurs aient accès en temps réel aux instructions visuelles de travail et formulaires de non-conformités

- Un industriel utilisait auparavant le papier pour toutes les procédures de maintenance et formulaires de collecte de données. Ils ont choisi Picomto pour digitaliser leurs procédures de maintenance et checklists afin de gagner en mobilité et accessibilité. Les techniciens consultent et exécutent les procédures et checklists directement depuis leur smartphone évitant les données inexploitables que peut engendrer le papier. Toutes les informations collectées sont ensuite transmises dans leur GMAO pour faire de la maintenance prédictive

Pour plus d’informations : https://fr.picomto.com/

Itris Automation : Pour un développement efficace des programmes automates

Il y a bientôt 25 ans, en décembre 1993, a été publié la première version du standard international IEC 61131-3 formalisant et standardisant les langages de programmation pour les automates programmables industriels. Quatre ans seulement après la publication du premier standard définissant le langage C, le monde de l’automatisme uniformisait à son tour ses pratiques. L’ère du génie logiciel appliqué largement, diffusé à tous et accessible dans le monde industriel allait pouvoir commencer !

Définissant 5 langages différents, avec des niveaux d’abstraction variables permettant à tous de choisir la bonne représentation en fonction de la tâche à accomplir et du cadre de référence (le ladder pour les développeurs de culture électrotechnique, le texte structuré pour les informaticiens …). Le standard est d’une richesse rare ! De même, son ouverture à des extensions offre à chaque constructeur d’automate la liberté d’enrichir encore les fonctionnalités disponibles.

Et c’est là que les problèmes commencèrent… L’hétérogénéité des langages et leur niveau d’abstraction variable sont alors devenus un obstacle à l’émergence d’outils d’aide au développement. Or, de tels outils sont essentiels pour automatiser et supporter les nombreuses tâches nécessaires à la satisfaction du niveau d’exigence de l’industrie, en matière de qualité et de documentation. Des efforts manuels, coûteux et non répétables devenaient la seule alternative.

Ces challenges sont la motivation principale de la création d’Itris Automation en 2008. L’objectif de la société est de fournir à l’industrie des outils inspirés des techniques de génie logiciel largement diffusées dans des secteurs connexes tels que l’informatique embarquée, tout en les adaptant aux contraintes spécifiques de l’industrie. Et, avant toutes choses, il a fallut s’attaquer aux questions d’hétérogénéité et de faible niveau d’abstraction des langages …

C’est pour cela qu’est né GLIPS, un langage textuel et d’abstraction de haut niveau pour les systèmes de contrôle-commande. Capable de représenter les 5 langages de la norme IEC 61131-3, dans toute leur diversité d’implémentation, il a ouvert la porte au développement d’une gamme d’outils couvrant les besoins d’analyse statique, de traduction automatique, de génération de documentation et d’aide au diagnostic. Surtout, il est accompagné de fonctionnalités d’import et d’export permettant aux automaticiens de continuer d’utiliser leurs langages et environnements habituels, condition sine qua non à l’adoption de nouvelles approches.

Aujourd’hui, le logiciel est plus que jamais au cœur de l’industrie. Qu’elle soit dite ‘du futur’ ou ‘4.0’, ses gains de productivité et de qualité sont tirés avant tout par une meilleure automatisation dans un contexte interconnecté. Les motivations de 1993 restent toujours valables – et c’est un défi que les équipes d’Itris Automation continuent de relever au quotidien.

Pour plus d’informations : www.itris-automation.fr

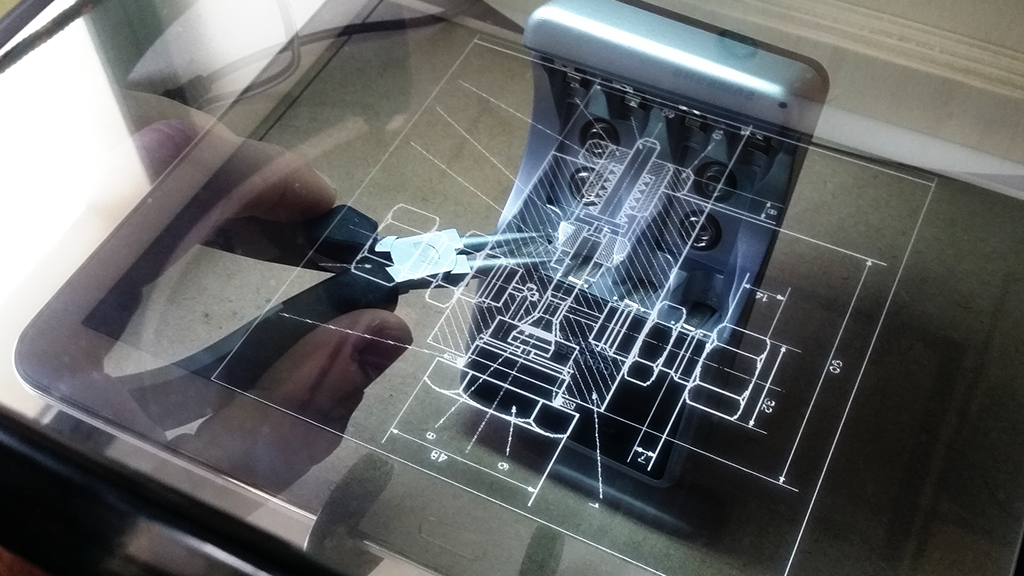

HoloMake : L’Interaction Manuelle Augmentée au service de l’industrie du futur

C’est fin 2014 que la startup HoloMake a commencé à réfléchir à un dispositif simple pour reporter des formes numériques sur des objets réels.

Jusqu’à présent, pour reporter une forme sur un support physique ‘adapté’, les seules solutions étaient le papier calque, la table lumineuse, le papier carbone ou l’impression. Depuis début 2016, il existe une petite machine à décalquer holographique dénommée QroKee, qui permet de reproduire un motif, une image, une photo sur tout type de matériaux en utilisant tout type d’outils, et ce, de façon la plus ergonomique qui soit. QroKee est le premier produit développé par HoloMake à destination du marché du loisir créatif et du grand public.

Fort du constat de l’efficacité de ce concept original de réalité augmentée, fin 2016, Holomake a décidé de le décliner à l’usage des professionnels.

Lorsque l’on parle de la Réalité Augmentée dans le contexte de l’Industrie 4.0 et des challenges de l’usine du futur, les dispositifs proposés par les acteurs majeurs doivent forcément être portés sur la tête de l’opérateur. Or, dans de nombreux cas d’utilisation, il n’est pas spécialement pertinent d’utiliser un dispositif embarqué (casque, lunettes, tablette ou smartphone tenu à la main), encombrant, et qui nécessite un tracking permanent qui rend instables les images présentées. A contrario, HoloMake propose des dispositifs fixes, attachés au plan de travail, qui enrichissent le champ de vision de l’utilisateur avec des guides virtuels holographiques, précis et stables, perçus exactement sur les objets réels sans aucun équipement particulier.

Les systèmes HoloMake affichent un plan holographique 2D qui peut être positionné et orienté librement en 3D dans l’espace de travail. En l’absence de stéréoscopie et de tracking, ces dispositifs sont naturellement multi-utilisateurs. Les systèmes de guidage holographique proposés améliorent de façon significative la qualité et la fiabilité des opérations manuelles complexes en allégeant la charge cognitive qui pèse sur l’opérateur.

Trois éléments-clés composent les solutions développées par HoloMake: une source d’affichage, une surface réfléchissante et un éclairage. Elles peuvent intégrer en option différents capteurs pour assurer des fonctions de tracking ou de scanning.

Parmi les cas d’usages mis en avant dans les solutions HoloMake, on peut retenir par exemple le fait de guider un assemblage qui nécessite de la précision comme l’enfichage de fils électriques dans une gaine; de guider une opération qui nécessite de l’attention comme une soudure, une gravure ou un perçage; d’aider au contrôle qualité de pièces mécaniques ou électroniques; d’afficher les informations de la notice technique sur la zone de travail; ou bien encore le fait d’être utilisé comme guide pour la formation des opérateurs.

Spécialisé dans la conception sur-mesure de systèmes de guidage holographique adaptés à des cas d’utilisation précis, Holomake cherche des partenaires, industriels ou startups, pour mettre au point des expériences-pilotes qui mettraient en avant tous les avantages de cette technique. Leur objectif est de montrer qu’il est possible de proposer aujourd’hui des solutions de réalité augmentée au service de l’opérateur sur son poste de travail et ainsi d’accélérer l’adoption de ces technologies dans l’industrie.

Pour plus d’informations : www.holomake.com

Energiency : L’intelligence énergétique pour rendre les usines durablement intelligentes et sobres en énergie

Le logiciel Energiency utilise les technologies du cloud, du big data et de la data science pour analyser en continu les données issues des compteurs d’énergie et de l’Internet des Objets Industriel (IioT).

Les opérateurs peuvent tout d’abord visualiser en temps réel les consommations d’énergie par produit, lot ou ordre de fabrication. Cette comptabilité énergétique instantanée disponible au cœur de l’atelier permet d’identifier instantanément les écarts de variabilité significatifs et de mieux maîtriser l’amélioration continue de leur performance et de leur excellence opérationnelle.

L’energy manager et l’opérateur en atelier bénéficient également dans le logiciel d’une analyse prédictive calculée par le logiciel selon des données issues de variables d’influence (plannings, production, maintenance, météo, etc). Cela permet d’anticiper à l’aide d’alertes graduelles tout écart significatif par rapport à la performance attendue, et d’anticiper la vigilance à mettre en place en cas d’enjeu énergétique important à venir.

Pour aller plus loin, le logiciel Energiency fournit également des préconisations opérationnelles en temps réel permettant de mettre en œuvre sans délai un protocole précis d’intervention ou l’envoi de consignes vers l’automatisme en place dans l’usine.

Avec cette caisse à outil logicielle accessible sans investissement (as a Service), les industriels produisent mieux avec moins, pour réaliser jusqu’à 20% d’économies sur leurs usages énergétiques, et ce sans investissement.

Energiency est lauréat de 25 Prix Innovation, et a été désignée « Start-up de la Transition Energétique » par le magazine Usine Nouvelle. Energiency a par ailleurs bouclé une levée de fonds de 2,7 M€ en 2017 avec les fonds d’investissement ISAI, Go Capital et West Web Valley pour accélérer son activité en Europe.

Pour plus d’informations : www.energiency.com

Tellmeplus : L’Intelligence Artificielle automatisée au service de la performance des entreprises

Tellmeplus est l’éditeur de Predictive Objects, une plateforme logicielle d’intelligence artificielle qui utilise le Machine Learning et l’Intelligence Artificielle pour automatiser la production de modèles prédictifs.

Predictive Objects repose sur une technologie brevetée, le Meta Active Machine Learning qui laisse le soin à l’intelligence artificielle d’automatiser l’ensemble du processus de sélection, d’analyse des données, en choisissant automatiquement la meilleure combinaison algorithme/données pour générer et déployer en un clic les modèles prédictifs les plus pertinents. Pour autant, l’expertise humaine reste bien évidemment nécessaire pour confirmer l’alignement du modèle généré avec des éléments contextuels et opérationnels. L’intelligence artificielle n’a donc pas pour vocation à remplacer l’expert, mais plutôt à lui laisser le loisir de se concentrer sur des tâches à plus forte valeur ajoutée pour qu’il devienne un expert « augmenté ».

En reposant sur les algorithmes symboliques, le Meta Active Machine Learning assure également l’explicabilité des prédictions. Ainsi, non seulement les entreprises sont à même de créer des modèles prédictifs en quelques semaines, mais également de favoriser la collaboration entre les différents services de l’entreprise et évite l’effet « boîte noire » si souvent reproché à la science algorithmique et à l’IA.

Dernier élément important, les modèles produits par Predictive Objects peuvent être déployés en un clic au plus proche de la donnée et de l’action : on premise, dans le cloud, dans une plateforme IIoT, voire dans l’objet lui-même « at the edge of the network ». En embarquant l’intelligence au plus près des objets, la solution les rend ‘intelligents’, capables de prendre des décisions instantanées, même en l’absence de réseau.

Quelques exemples pour mieux comprendre les usages de Prédictive Objects : la maintenance prédictive avec pour but d’identifier, expliquer et anticiper les pannes de machines industrielles ou d’objets connectés B2C tels que la box TV ou la voiture. L’optimisation de processus industriels est une autre illustration de la pertinence de l’analyse prédictive avec l’identification de pièces défectueuses le plus en amont possible d’une chaîne de production… Mais surtout l’intérêt de “l’Automated Embedded Artificial Intelligence” réside dans le fait que votre box TV ou que votre usine puisse continuer à fonctionner même lorsque la connexion est rompue.

Basée à Paris et Montpellier, Tellmeplus a été créée en 2011 par Jean-Michel Cambot, l’inventeur de Business Objects, qui a été rejoint en 2016 par Benoit Gourdon, co-fondateur de Neolane.

Pour plus d’informations : www.tellmeplus.com

Gunvor au Congo : Or noir, corruption et géopolitique

L’ONG suisse Public Eye a enquêté sur les coulisses d’un contrat pétrolier gigantesque obtenu par la société de négoce Gunvor. Avec l’aide de Mediapart qui a recueilli des documents très compromettants pour la firme suisse, Public Eye a rendu public la semaine dernière son investigation. Quatre procédures judiciaires sont toujours en cours pour faire la lumière sur cette affaire.

L’Ovni Gunvor

Fondée en 1997 par le Russe Guennadi Timtchenko, proche de Vladimir Poutine et le Suédois Torbjörn Törnqvist, Gunvor est partie de zéro, ou presque, pour devenir en quelques années le numéro un de la commercialisation du pétrole russe. Entre 2005 et 2007, son chiffre d’affaires passe de 5 à 43 milliards de dollars grâce à l’exportation de pétrole russe. La société s’impose alors comme le vendeur attitré du géant étatique russe Rosneft et la 4ème plus importante société privé de négoce de pétrole.

Loin de vouloir s’arrêter là, Gunvor cherche dès 2006 à trouver de nouveaux marchés, en Afrique notamment. La firme s’essaie successivement au Nigeria, en Angola et en Côte d’Ivoire, avant de percer au Congo Brazzaville. Pour cela, elle débauche les meilleurs : quatre traders de Totsa, filiale de négoce du groupe Total, sont engagés. L’année suivante, le desk Afrique d’ Addax, une société concurrente, perd cinq de ses meilleurs éléments au profit de Gunvor.

Contrat mirifique

Le Congo Brazzaville est une cible de choix. C’est un Etat rentier du pétrole (90% des exportations, 70% du PIB) où la moitié de la population vit avec moins de deux dollars par jour. Le pays est dirigé par le clan du président Denis Sassou Nguesso, au pouvoir depuis trente-huit ans, à l’exception d’un bref interlude démocratique entre 1992 et 1997. Il a placé ses proches aux postes clés, à l’instar de son fils Denis Christel, surnommé «Kiki», directeur général adjoint en charge de l’aval pétrolier au sein de la Société Nationale des Pétroles Congolais (SNPC), qui commercialise l’or noir pour le compte de l’Etat africain. Le pays figure par ailleurs au quinzième rang des États les plus corrompus de la planète, selon Transparency International.

Gunvor propose alors un deal très intéressant pour le clan Nguesso. Six accords de préfinancements de 125 millions de dollars chacun, soit 750 M€ au total, sont signés entre janvier 2011 et septembre 2012. Initialement dédiés au développement de l’industrie pétrolière, ces fonds vont être en partie détournés sans que les institutions financières internationales, tel que le FMI, ne puissent intervenir. « Gunvor se transforme en parabanque, sans toutefois devoir respecter les règles et contraintes qui s’appliquent aux institutions financières. Et ce, avec l’aide de BNP Paribas qui finance partiellement ces prêts », explique Public Eye.

En échange des préfinancements, Gunvor va affréter entre janvier 2011 à l’été 2012, vingt-deux tankers à Pointe-Noire. Au total, la firme acquiert des barils de Djéno, le principal brut congolais, pour une valeur totale de 2,2 milliards de dollars. Et ce, alors que les prix du pétrole étaient au plus haut, plus de 100 $ le baril (contre 50$ aujourd’hui). Au final, le contrat congolais aurait permis à la compagnie suisse d’engranger plus de 100 millions de dollars de profits.

Pétrole et géopolitique

Pour se faire une place sur le marché africain Gunvor va proposer une formule originale, avec « une approche géopolitique » qu’aucun de ses concurrents n’a su, ou pu, développer, explique une source à Mediapart. Si les montages financiers complexes pour rémunérer grassement des intermédiaires et des agents publics ne sont pas rares dans le secteur pétrolier, Gunvor a valorisé ses réseaux. En plus des préfinancements, les « apporteurs d’affaires » comme on dit dans le jargon, Maxime Gandzion et Jean-Marc Henry, devaient ouvrir les portes du Kremlin au clan Nguesso, soucieux de trouver en Vladimir Poutine, un allié de poids sur la scène internationale.

Le 31 août 2011, peu après le début de la coopération entre Gunvor et le Congo, un accord intergouvernemental de coopération économique entre les deux pays est signé à Moscou. C’est la consécration. L’accord prévoit que la Russie soutienne « au niveau étatique » les compagnies russes et congolaises qui participeront aux travaux de construction et à la modernisation du complexe pétrolier congolais.

Quelques mois plus tard, la justice suisse est alertée de mouvements financiers à travers des paradis fiscaux (Hong Kong notamment) s’élèvant à plus de 30 millions de dollars et lance une enquête.

Ennuis judiciaires

Le 3 juillet 2012, les locaux suisses de Gunvor sont perquisitionnés pour trouver des preuves d’irrégularités. Le procureur Sautebin, en charge de l’affaire, éprouve toutes les peines du monde à prouver la corruption au niveau de la direction car Gunvor s’est retourné contre un de ses employés jugé seul responsable. Une sorte de syndrome Kerviel… Mais un revirement récent pourrait tout changer. L’intéressé aurait demandé l’ouverture d’une « procédure simplifiée ». En échange d’informations accablantes, il pourrait n’écoper que d’une condamnation, amende voire d’un non-lieu, préalablement négocié avec les autorités judiciaires helvétiques.

De son côté le Russe Guennadi Timtchenko a précipitamment revendu, en mars 2014, ses parts dans Gunvor à son partenaire Törnqvist. Une bonne inspiration. Son nom est en effet apparu sur la liste des ressortissants russes visés par les sanctions américaines adoptées la même année après l’annexion de la Crimée par la Russie.

Avec la chute des cours du baril, les revenus du Congo ont baissé massivement (-54,4% entre 2014 et 2016 selon la Banque mondiale). Pour faire face à son déficit public et une dette estimé à 120% du PIB, Brazzaville espère désormais un soutien financier des institutions internationales. Le projet de coopération russo-congolais n’a lui guère avancé.

Romain Chicheportiche

La France championne d’Europe de l’ouest en densité éolienne (en commençant par le bas du podium)

Selon le document présenté par EDF Energies Nouvelles, la densité démographique moyenne de la France est de 123 habitants par kilomètre-carré, soit presque deux fois inférieure à celle de l’Allemagne (231 habitants par kilomètre-carré) tandis que la densité éolienne française est de 21 kW par kilomètre-carré, contre 139 en Allemagne. La densité éolienne est de 63 kW/km2 en Grande-Bretagne, de 58 au Portugal, 43 en Irlande et 31 en Italie.

Si la France développait l’éolien en suivant le modèle Allemand alors l’hexagone pourrait multiplier par un facteur 7 sa production d’électricité à partir du vent. Et même d’un facteur 14 en intégrant le facteur démographique. Selon RTE la France a produit 20,7 TWh d’électricité éolienne durant l’année 2016, année durant laquelle la consommation électrique française a été de 473 TWh.

Si le facteur de charge de l’éolien en France est d’environ 23% il est 90% du temps supérieur à 6%. Et avec un facteur de capacité de 6% on peut théoriquement répondre à 100% de la demande. Autrement dit il est vraiment lourdement fallacieux de penser que si le facteur de capacité est de 23%, alors les éoliennes ne produiraient rien 77% du temps. L’erreur est malheureusement fréquente, comme ici le 13 septembre, et là le 20 septembre. La complémentarité du solaire photovoltaïque et de l’éolien à l’échelle saisonnière est en outre excellente en Europe de l’ouest.

«Le facteur de charge de l’éolien (ou du PV) n’est pas une fatalité» a expliqué aux Techniques de l’ingénieur Bernard Multon, professeur de génie électrique à L’Ecole Normale Supérieure de Rennes. «Et il peut être accru, à site de production donné, par des choix de dimensionnement tels que celui des éoliennes à turbine surdimensionnée pour une puissance nominale donnée, ce que Bernard Chabot appelle la révolution silencieuse (voir ici et ici)» a ajouté l’expert.

Selon le média ThinkProgress dans l’état du Massachussets (USA) un parc éolien offshore de 144 MW pourraît être couplé avec des batteries Lithium capables de stocker 40 MWh.

Olivier Daniélo

Smart City : les clés de la ville aux mains des pirates

Le marché de la Smart City devrait représenter 165 milliards d’euros en France d’ici à 2022 selon une étude de Cisco. Un rapport du ministère du Logement et l’habitat durable paru en 2016 précise que la moitié (49 %) des investissements concerne les bâtiments et les usages, 17 % la conception urbaine et l’environnement, 15 % la mobilité, 10 % l’énergie et les réseaux et 9 % pour le reste.

C’est dans cette poignée de pour cent que l’on trouve notamment la sécurité des flux… Comme d’autres technologies qui ne sont pas encore arrivées à maturité, la protection des échanges est rarement une priorité. Dans bien des cas, elle n’est pas même intégrée dès les premières lignes d’un projet.

Or, tous les concepteurs de smart City vont devoir rapidement changer leurs méthodes de travail. Le 25 mai 2018, le Règlement Général sur la Protection des Données (RGPD) entrera en application. Validé en 2016, il renforce la protection des citoyens et accentue par conséquent les obligations de toutes les entreprises. Quelles que soient leur taille et leur activité, elles doivent dès à présent s’organiser pour être en conformité.

Si un piratage informatique du réseau informatique d’une Smart City entraîne une fuite de données à caractère personnel, le gérant devra en effet avertir la CNIL sous 72 heures. Cette notification devra être faite dès que l’intrusion malveillante aura été constatée. Passé ce délai ou si il n’avertit pas cet organisme, le gestionnaire de ce réseau devra s’acquitter d’une amende. L’article 83.6 du RGPD précise que cette sanction peut atteindre jusqu’à 4 % du chiffre d’affaires mondial annuel (pour un grand groupe).

Coupure d’eau

Pour l’instant, ces villes intelligentes n’ont pas encore été réellement impactées. Mais des indices montrent que des attaques devraient se multiplier au fur et à mesure de leur développement. Des pirates ont déjà infecté des réseaux électriques, des systèmes d’alerte de Dallas, le réseau du tramway à San Francisco…

Demain, on peut imaginer, différents services paralysés par des cybercriminels qui auront infecté un réseau informatique avec un ransomware (virus chiffrant toutes les données d’un serveur ou d’ordinateurs) et exigeront le paiement d’une rançon pour tout débloquer. Un scénario de film de science-fiction ? Pas vraiment, le niveau de sécurité de ces réseaux et des objets connectés est tellement faible, voire inexistant, qu’il pourrait vite devenir une triste réalité…

Selon l’ANSSI (Agence nationale de sécurité des systèmes d’information) il faut focaliser les efforts de sécurisation sur les objets connectés de type actionneurs, qui ont des conséquences physiques sur la ville (gestion de l’eau, électricité, transports…). Mais il faut surtout en revenir aux règles fondamentales. Et la première d’entre elles est d’intégrer la sécurité dès le début d’un projet, car « c’est très compliqué de l’intégrer plus tard », rappelle Hervé Debar, Directeur du département RST à Télécom SudParis.

Le chiffrement des communications de la smart City et le cloisonnement des données sont également prioritaires. Comme pour le réseau d’une entreprise, il est indispensable de faire un audit du système informatique. C’est ce qu’a fait Singapour, l’une des smart cities les plus avancées, en 2012 dans 11 secteurs dont les infrastructures sont jugées cruciales (transports, énergie, télécoms, finance…). Même si cet exemple est à part, il s’agit d’une ville État où tout est centralisé, il doit servir de référence en France.

Par Philippe Richard

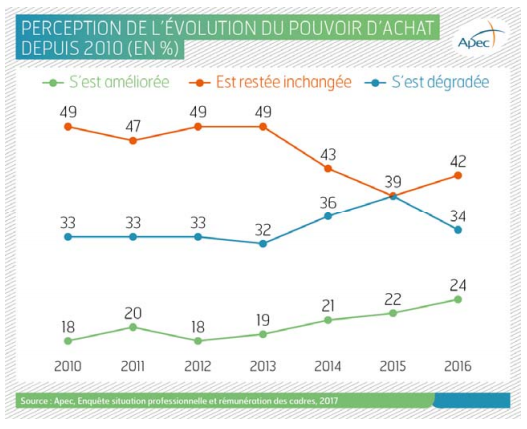

Évolution de la rémunération en 2017 : les cadres plus optimistes

Perspectives d’évolution salariale en 2017 45 % des cadres interrogés dans la dernière enquête de l’Apec prévoient de demander une augmentation en 2017. 35 % pensent l’obtenir (qu’ils l’aient ou pas demandée), contre 33 % un an auparavant. De plus, 24 % des cadres perçoivent une amélioration de leur pouvoir d’achat (+ 2 points sur un an) tandis que la part de ceux estimant qu’il s’est dégradé est en recul de 5 points. À noter que près de 9 cadres sur 10 considèrent les avantages salariaux tels qu’une revalorisation salariale, des primes ou encore des bonus, comme le principal levier de reconnaissance professionnelle.

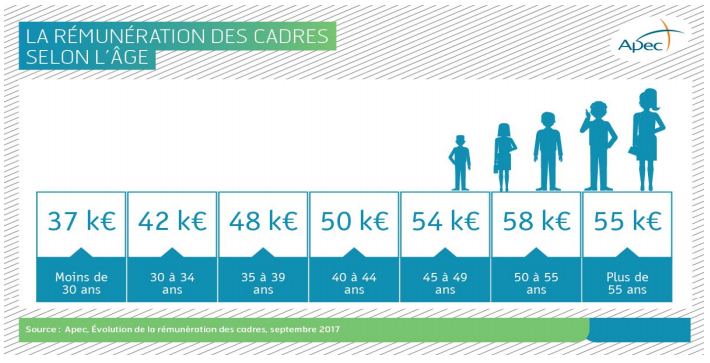

Des niveaux de rémunération stables en 2016 En 2016, la rémunération annuelle brute moyenne des cadres s’établissait à 56 k€ (salaire fixe + part variable). Quant au salaire médian, il s’élevait à 48 k€. Des niveaux stables par rapport à 2015. En outre, 80 % des cadres ont un salaire annuel brut (fixe + part variable) compris entre 34 k€ à 85 k€. Cette forte dispersion illustre la grande hétérogénéité des situations professionnelles des cadres relative à leurs caractéristiques individuelles, à celles de leur formation initiale, du poste occupé, de leur entreprise ou bien de leur parcours professionnel. Par ailleurs, l’âge et la taille de l’entreprise restent deux facteurs clés de la rémunération des cadres. Autre constat marquant, les hommes cadres gagnent 12 % de plus que leurs homologues féminins (écart médian tous profils confondus). Toutefois, cet écart se réduit d’année en année.

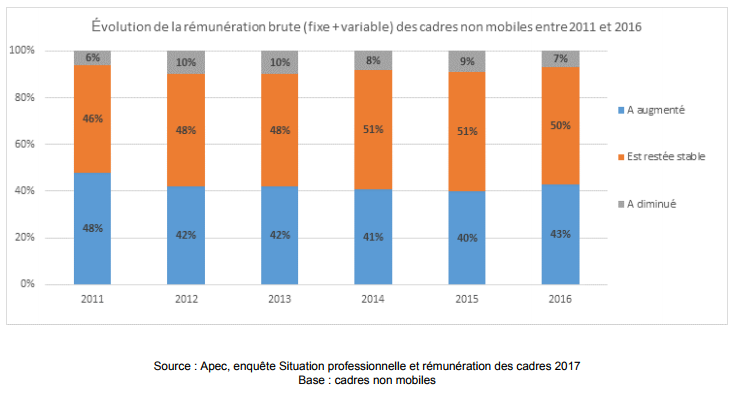

L’évolution de la rémunération des cadres selon leur situation professionnelle En 2016, 66 % des cadres ayant intégré une nouvelle entreprise suite à un changement direct, c’est-à-dire sans période de chômage, ont vu leur rémunération augmenter, contre 38 % pour ceux qui ont connu une période de chômage. S’agissant des cadres mobiles en interne, 53 % d’entre eux ont été augmentés en 2016, soit un niveau quasi stable par rapport à 2015. Quant aux cadres qui n’ont connu aucun changement professionnel en 2016, 43 % d’entre eux ont bénéficié d’une revalorisation salariale, contre 40 % en 2015.

Source : Apec

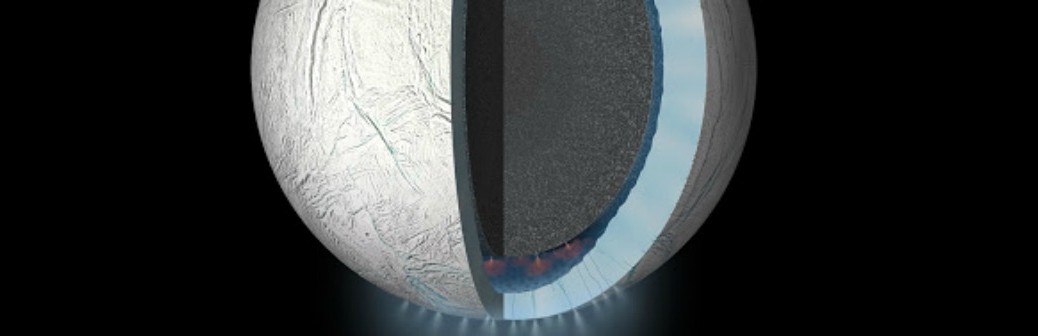

Cassini est morte, Vive Cassini

Les opérateurs de la mission en ont décidé ainsi. La sonde Cassini doit finir ses jours dans l’atmosphère de Saturne. Après 20 ans dans l’espace, le niveau exact du réservoir de carburant n’étant pas connu, ils ont préféré contrôler la fin de vie de l’orbiteur pour être sûr qu’il n’irait pas s’écraser sur Titan ou Encelade. Car les règles de la protection planétaire le stipulent bien : il ne faut pas contaminer des mondes qui pourraient abriter des traces de vie actuelles ou éteintes. En précipitant Cassini dans l’atmosphère de Saturne, on était sûr qu’elle serait complètement désintégrée. En outre, les scientifiques en attendent une belle moisson de données sur la haute atmosphère de Saturne. Les caméras ont été éteintes depuis le 14 septembre, car l’envoi de photos prend trop de ressources et les autres mesures sont scientifiquement plus intéressantes. Dix instruments qui mesurent gaz, plasma, particules, température, champs électriques ont donc continué de fonctionner pendant la descente qui s’est passée comme prévu, mieux même puisque la sonde a émis pendant 13 secondes de plus qu’espéré. L’approche s’est faite par le pôle Nord de Saturne, le point d’entrée a été fixé à 3000 km au dessus de la surface de référence d’une planète gazeuse (que les scientifiques ont arbitrairement choisie comme l’altitude où la pression atmosphérique est d’un bar). Une fois entrée, la sonde a continué d’émettre pendant un peu plus d’une minute comme l’avaient estimé les responsables de la mission à peu près à 1500 km au-dessus du sommet des nuages. Ainsi, même si la sonde est à présent désintégrée, les données récoltées sont telles, que les découvertes qu’elle a faite sont encore à venir. Cassini a de beaux jours devant elle !

Tout est encore à faire

Les différents responsables de la mission ont tous insisté sur ce point lors de la conférence de presse qui s’est tenue juste après : « Ce n’est pas une fin, c’est un début, nous y retournerons ». « D’ailleurs Cassini ne nous a donné qu’un aperçu du goût de son atmosphère ». Insistant aussi sur l’exemplarité de cette mission pour laquelle tout a été parfait : « de la sonde elle-même aux différentes collaborations qui se sont maintenus pendant si longtemps ».

Et pour l’avenir ?

- Téléchargez notre livre blanc gratuit qui retrace l’épopée Cassini : «Sonde Cassini-Huygens, une épopée de vingt ans»

Par Sophie Hoguin

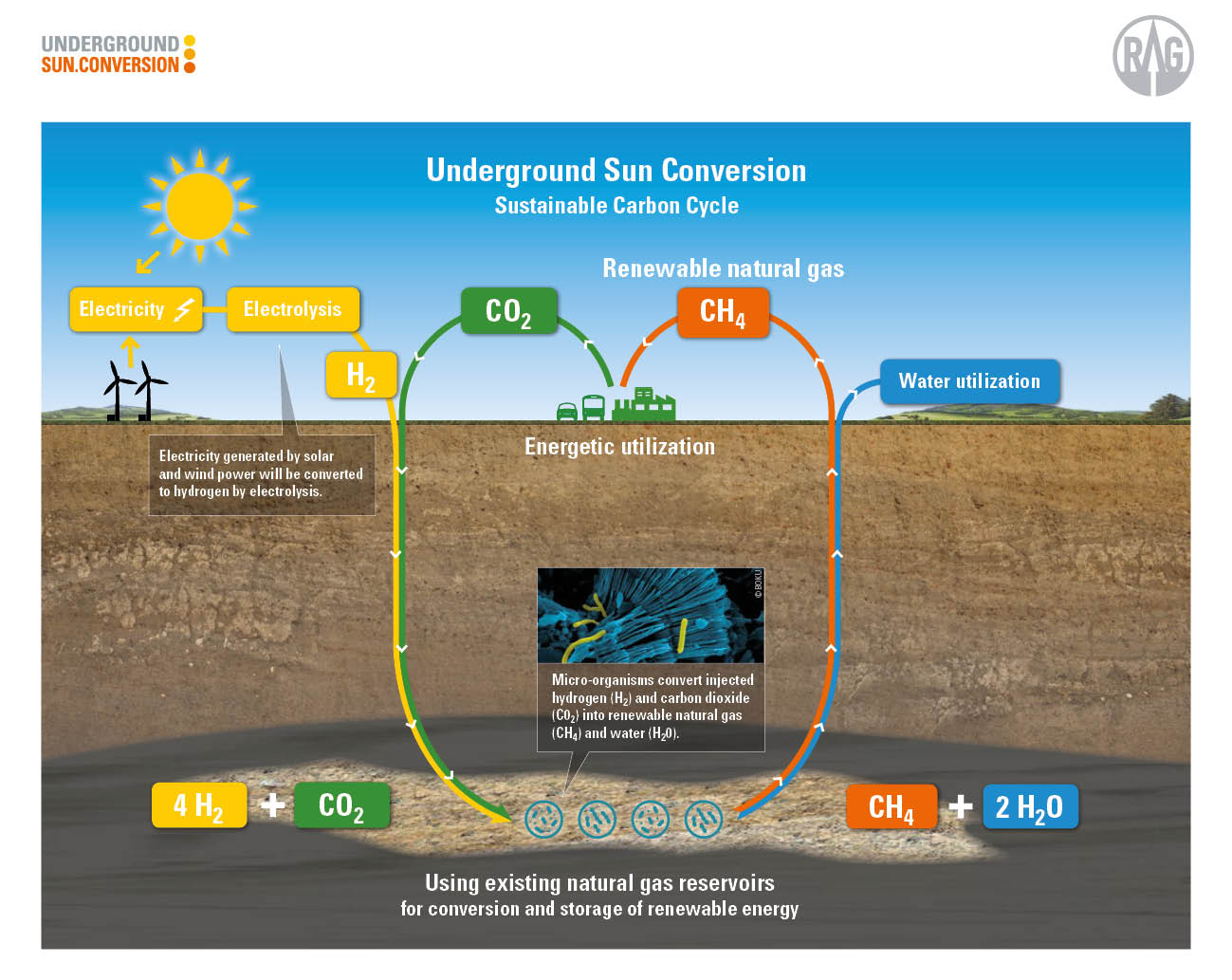

Convertir le solaire et l’éolien en méthane de synthèse

McLyzer 100-30

McPhy est reconnu dans le secteur grâce à sa technologie d’électrolyse qui permet de produire de l’hydrogène en utilisant des énergies renouvelables. L’entreprise a remporté l’appel d’offres international lancé par RAG. « Les critères étaient particulièrement exigeants notamment sur la rapidité de réponse aux variations de puissance électrique, la production directe d’hydrogène à une pression de 30 bar, la maturité de la technologie et la robustesse du système. Les caractéristiques du générateur d’hydrogène McLyzer 100-30 répondaient parfaitement à ces exigences », explique Pascal Mauberger, président de McPhy.

Le gaz naturel de synthèse sera produit grâce à l’électrolyse fournie par le Français et stockée directement dans un réservoir naturel situé à plus de 1 000 mètres sous terre, puis injecté dans le réseau pour être délivré à la demande, en fonction des besoins des consommateurs. Ce nouveau contrat porte à plus de 13 MW la capacité des équipements de Power-to-gas bientôt installée par McPhy, soit une production quotidienne de près de 6 tonnes d’hydrogène renouvelable.

La technologie de Power-to-gas est de plus en plus étudiée pour stabiliser les réseaux électriques confrontés à l’afflux croissant d’électricité d’origine renouvelable. Transformer les excès de production éolienne et solaire en méthane de synthèse à l’avantage d’être plus facilement stockable et de faire participer ces installations à la réserve primaire et secondaire. Les coûts élevés de cette transformation la rendaient jusqu’ici non rentable.

Par Romain Chicheportiche

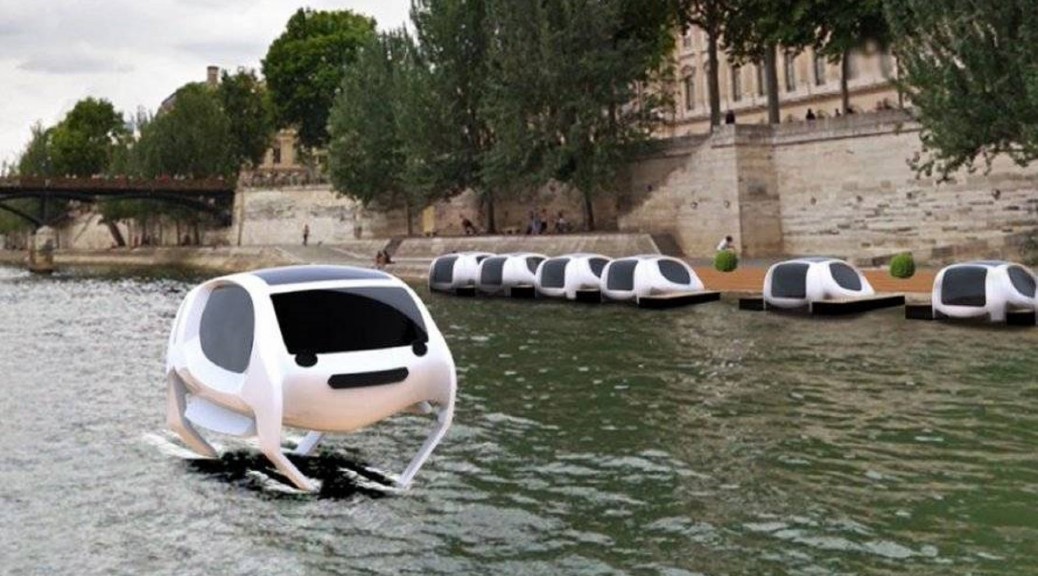

La SeaBubble d’Alain Thebault : une innovation au potentiel véritablement disruptif

On pouvait craindre que la SeaBubble, perchée sur des foils, manquerait de stabilité quand l’eau s’agite. Mais cette vidéo publiée par Alain Thebault le 7 septembre 2017 sur son compte Twitter personnel démontre que l’engin tient vraiment très bien la route. Bluffant.

A Paris est-ce la SeaBubble qui n’est pas adaptée à la réglementation pour naviguer sur la Seine ou est-ce la réglementation française qui est obsolète ? La vitesse est limitée entre 12 et 18 km/h sur la Seine. Ceci afin de limiter la puissance des vagues générés par les bateaux, ainsi que la pollution. Mais la SeaBubble ne génère pas de vague, il vole au-dessus de l’eau. Et il est 100% électrique à batterie. C’est donc bien la réglementation française qui est inadaptée.

Certains objecteront que naviguer à 30 ou 50 km/h est dangereux. Or les SeaBubbles seront équipés de systèmes de navigation 100% autonome : le risque d’erreur humaine sera donc nul. De nombreux bateaux dans le monde sont dès à présent équipés de systèmes de navigation semi-autonome. La densité de trafic sur l’eau est bien moindre que dans les rues parisiennes. En outre les SeaBubbles sont silencieux et donc bien plus conviviaux, même à 50 km/h, que les bateaux thermiques pétro-fumants navigant à 12 km/h.

Haute efficience

Techniques de l’ingénieur avait fait écho dès janvier 2015 d’un engin slovène, le Quadrofoil, utilisant la même technologie. Et souligné la haute efficience énergétique de cette solution de transport. La trainée est réduite de 40%, et donc la consommation énergétique. Mais Alain Thebault, recordman du monde vitesse en voilier avec son fabuleux hydroptère, dispose manifestement d’un bien meilleur réseau de relations que l’équipe slovène. Le co-fondateur de Google, Larry Page, lui avait demandé s’il pouvait venir faire un baptême en Hydroptère dans la baie de San Francisco. Alain Thebault a accepté. Aujourd’hui ce sont les SeaBubbles qui séduisent Google. Et l’ex-directeur de la communication d’Uber-France a rejoint l’équipe du capitaine Thébault.

Il serait dommage que la capitale de la France ne puisse pas être la première au monde à disposer de ce nouveau moyen de transport. Pour une fois, ce n’est pas une innovation californienne qui débarque en France mais l’inverse. Bénéficier du soutien du président de la République Emmanuel Macron et de la Maire de Paris Anne Hidalgo sera-t-il suffisant ?

Techniques-Ingénieur.fr n’a pas hésité à publier des analyses critiques quand des innovations comportent des tares physiques intrinsèques. Comme par exemple avec la route solaire ou l’arbre à vent. Mais la vidéo diffusée par Alain Thebault et susmentionnée a éliminé les doutes au niveau de la stabilité des SeaBubbles. Techniquement, la solution a un potentiel véritablement disruptif.

Facteur non négligeable pour devenir un succès commercial : le SeaBubble a un côté assez Bling-Bling et m’as-tu-vu: il permet de marcher sur l’eau, d’être ainsi au-dessus de la mêlée, et d’aller vite. Le concept plaît par conséquent beaucoup, tant en Suisse (Lac Léman) qu’en Californie (San Francisco Bay Area).

Bientôt du Bubble-sharing ?

Cette start-up, si elle réussit à parvenir à des volumes de production permettant de faire baisser ses coûts, peut devenir une Licorne. Comme BlaBlaCar fondée par Frédéric Mazzella, un autre chouchou d’Emmanuel Macron. Peut-être que BlaBlaCar et SeaBubble finiront d’ailleurs par converger. Des BlaBlaBubbles.

Le parcours personnel d’Alain Thebault, tel que décrit par cet article publié en 2016 dans Le Point ainsi que dans cette vidéo-conférence, est touchant. Comme ce champion breton de vitesse à la voile le dit lui-même, « il revient de loin ». Et d’ajouter : « je n’ai pas la même conception du confort que la majorité des gens. Quand tu n’as rien, la lumière, la nourriture n’ont pas la même saveur. »

Le navigateur Eric Tabarly lui avait déclaré :

« Alain, le plus important dans la vie, c’est de rester Libre »

Vive l’innovation française.

Olivier Daniélo

L’Hyperloop propulsé sur le devant de la scène

Depuis quelques mois c’est une course effrénée à coup d’annonces de futurs contrats, de délais ultra-courts, de concours de vitesse avec toujours plus de concurrents et de clients qui se manifestent. Dernier en date : la Chine qui prend officiellement le train en marche. Le 30 août 2017, la CASIC (China Aerospace Science and Industry Corp), l’un des principaux industriels du secteur spatial chinois a en effet annoncé avoir lancé la R&D pour le développement d’un système de transport ultra-rapide de type hyperloop pouvant atteindre à terme les 4000 km/h grâce à un vide total dans les tunnels. Baptisé HyperFlight, les capsules voyageraient dans des tunnels aériens ou souterrains et le réseau serait hiérarchisé en trois niveaux : un réseau régional utilisant des vitesses de 1000 km/h, un réseau national à 2000 km/h et un troisième, international à 4000 km/h. La CASIC aurait déjà déposé plus de 200 brevets sur ses recherches en cours.

Si vous avez loupé le début

L’idée d’un train ou d’une capsule propulsée dans un tunnel avec un vide partiel est développée de manière plus ou moins élaborée depuis le XVIIIe siècle (par exemple les trains atmosphériques dont la seule application efficace a été les tubes pneumatiques). Mais cette fois semble être la bonne. Elon Musk, le patron milliardaire de SpaceX et Tesla, propose l’idée de propulser des capsules dans des tubes à basse pression qui pourraient atteindre les 1200 km/h à l’été 2012. Un an plus tard, un livre blanc de près de 60 pages détaille le fonctionnement possible de l’Hyperloop et les options technologiques étudiées par les ingénieurs de Tesla et SpaceX. Le document est en libre accès à tout entrepreneur intéressé pour développer cette technologie et la commercialiser, mais le nom Hyperloop reste propriété de SpaceX. Depuis, plusieurs entreprises se sont lancées dans l’aventure.

HTT : des Américains qui parcourent le monde

Dès 2013, Dirk Ahlborn crée Hyperloop Transportation Technologies (HTT), une entreprise américaine qui va résolument se tourner vers l’Europe et le reste du monde. Si les travaux pour un tube à pleine échelle débute dès janvier 2016 à Quay West (Californie), HTT développe rapidement des partenariats et des accords pour des études de faisabilité un peu partout dans le monde. Sont ainsi prévus : un centre de recherche à Toulouse (pour profiter du savoir-faire aérospatial de la région), plusieurs études pour le développement de l’Hyperloop en Europe de l’Est à partir de la Slovaquie, une liaison entre Abou Dhabi et Al Ain (Emirats Arabes Unis), une liaison entre les villes de Amaravati et Vijaywada (Etat d’Andra Pradesh en Inde), des études à Jakarta (Indonésie) ou encore un accord avec la Corée du Sud et le KICT (Korea Institute of Civil Engineering and Building Technology) pour l’installation d’un tube à pleine échelle permettant d’étudier notamment le management de la sécurité. Relançant ainsi le plan de la Corée qui travaille sur son HyperTube Express qui relierait Séoul à Busan en 20 mn depuis 2011. Au niveau démonstration de faisabilité, HTT a pour le moment seulement présenté son projet de capsule. La construction, confiée au spécialiste de l’aéronautique espagnol Carbures, doit en être achevée pour 2018.

Hyperloop One : celui qui veut être le premier

Créé en 2014, Hyperloop Technologies qui deviendra Hyperloop One ne cesse de le clamer : nous serons les premiers. En 2016, l’entreprise américaine construit son site de démonstration dans le désert du Nevada, près de Las Vegas : le DevLoop. Deux essais s’y sont tenus cet été 2017 avec à la clé la démonstration de la faisabilité du concept sur de petits tronçons mais permettant de tester toutes les composantes : propulsion, freins, vide partiel et lévitation magnétique. La phase 2 s’est achevée avec une vitesse de 309 km/h sur 435 m avec le prototype de la capsule. Les trois dirigeants, Rob Lloyd, Shervin Pishevar et Josh Giegel estiment que cela va leur permettre d’accélérer les opérations de commercialisation. Spécialistes du buzz médiatique, Hyperloop One a déjà signé plusieurs accords de partenariats aux Emirats Arabes Unis, en Inde ou en Russie et fait parler d’elle à travers une opération originale : le « Global Challenge ». Les potentiels clients ont été invités à présenter les avantages économiques, sociaux et stratégiques de l’installation d’un hyperloop dans leur ville, région, pays et un jury se charge de choisir les meilleurs projets parmi les 2600 proposés. Trente-cinq projets ont été retenus début 2017 et les gagnants qui travailleront de manière privilégiée au développement de l’Hyperloop seront connus avant la fin de l’année.

Arrivo : arrivent ceux qui sont partis

Parmi les entreprises qui s’attaquent à l’Hyperloop, une petite nouvelle est née début 2017 : Arrivo. Fondée par Brogan BamBrogan, ex-cofondateur d’Hyperloop One, et trois autres transfuges après une série de plaintes pour harcèlement et népotisme contre Hyperloop One suivi d’une plainte de ces derniers pour violation des clauses de non-concurrence et non-dénigrement. Le règlement amiable du conflit a été gardé secret mais a abouti à la naissance d’Arrivo dont le siège est désormais basé à Los Angeles. Pour le reste, il faut maintenant qu’ils fassent leurs preuves.

Transpod : les canadiens pragmatiques des grands espaces

Transpod est une startup canadienne lancée fin 2015 qui développe son outil en Italie et au Canada principalement. Elle se prépare à effectuer ses premiers tests à Calgary et prévoit la construction d’une ligne de 4km pour achever la conception de son Hyperloop. Elle annonce une ligne entre Edmonton et Calgary pour 2019-2020 et envisage à terme de créer des tunnels avec vide total pour atteindre des vitesses de 3 à 5000 km/h. Leur force : les services proposés seraient 30 à 40% moins chers que leurs concurrents grâce à des coûts d’infrastructures inférieurs et une absence de communication à gros budget.

Concours d’étudiants : la foire aux technologies

L’Hyperloop Pod competition est un concours de conception de capsule pour l’Hyperloop lancé par SpaceX en 2015. Principalement ouverte à des équipes d’étudiants, cette compétition est l’occasion de voir s’affronter de nombreux essais de technologies différentes (par lévitation magnétique, par coussins d’air etc.) et parfois de transformer l’essai comme pour les gagnants de la deuxième étape, les Néerlandais de l’université de Delft qui ont depuis lancé leur propre entreprise Hardt Global Mobility avec des fonds de Uniiq et des chemins de fer néerlandais à hauteur de 600 000 euros. La deuxième phase du concours qui s’est tenue les 24 et 25 août 2017 sur le site de SpaceX consistait en un concours de vitesse où les Allemands de l’université de Munich avec leur WARR Hyperloop l’ont emporté avec une vitesse de 324 km/h. Record aussitôt battu par le pod pousseur de la compétition (les capsules des étudiants étaient propulsées à l’aide d’un pod pousseur) conçu par Tesla et SpaceX. Elon Musk a annoncé pouvoir dépasser les 500km/h dès le mois prochain.

Quand Elon Musk revient dans la course

Un essai pas complètement innocent. Si jusque là Elon Musk avait délaissé l’Hyperloop, Bloomberg écrivait le 4 août dernier que des proches affirment qu’il travaille finalement à développer son propre Hyperloop. Ses projets en la matière ne sont pas encore très clairs. Ce qui est sûr c’est qu’il compte bien creuser les souterrains pouvant accueillir des Hyperloop via son entreprise la Boring Company avec déjà l’annonce d’une liaison Washington/New York.

C’est l’ébullition tout autour du monde

C’est ainsi que la bouteille Hyperloop jetée à la mer en 2013 a relancé tous les projets similaires autour du monde. Aujourd’hui, tous les pays suffisamment développés se penchent sur la question de soutenir ou installer des réseaux de type Hyperloop. Cependant, il reste encore à cette technologie à faire la preuve de sa complète faisabilité, de sa fiabilité et de sa sécurité. C’est pourquoi d’aucuns doutent qu’un Hyperloop sera vraiment à votre porte en 2020.

Sophie Hoguin

Moona, l’objet connecté anti-insomnie

La filière ô combien grandissante des objets connectés s’intéresse de près à notre bien-être, et donc à notre sommeil. C’est le cas de Moona, qui aide le dormeur à trouver puis à conserver le sommeil, au moyen d’un dispositif de régulation de la température corporelle. «Plusieurs études scientifiques décrivent le lien entre température et qualité du sommeil, explique Coline Juin, co-fondatrice de la start-up éponyme, créée en juin 2016 et incubée à Centrale Paris. La température corporelle doit diminuer de 1° pour qu’une personne puisse s’endormir. Elle descend naturellement jusqu’à 3-4 heures du matin, la phase où le repos est le plus réparateur, avant de s’élever à nouveau le matin.»

Moona se compose d’un fine membrane, qui se glisse dans la taie d’oreiller, et d’un boîtier posé sur la table de nuit, qui assure une circulation hydraulique dans la dite membrane. Pour favoriser l’endormissement, l’eau est rafraîchie; pour le réveil, elle est au contraire réchauffée. «Nous préconisons une température d’utilisation entre 24 et 33°C, agréable pour la plupart des personnes, détaille Coline Juin. Nous avons étudié plusieurs techniques de changement de température – matériaux à changement de phase, détente de gaz… – et avons sélectionné un échangeur basé sur l’effet thermoélectrique, qui présente le meilleur équilibre entre le rendement et la nuisance sonore.»

Machine learning et conseils personnalisés

Le boîtier se connecte au réseau WiFi (qui peut être désactivé pendant la nuit) puis au cloud, à des fins d’analyse de données. «Moona récupère et transmet plusieurs informations – température de la pièce, hygrométrie, luminosité et mouvement de l’utilisateur grâce à un capteur de mouvement – qui sont traitées par un algorithme de machine learning, développé en interne, précise Coline Juin. A partir de ces résultats et d’autres informations renseignées par l’utilisateur sur l’application mobile – âge, poids, sexe, profil de sommeil (petit ou gros dormeur, etc), sensibilité à la température – nous fournissons des conseils personnalisés. La communication avec d’autres objets et plateformes IoT est par ailleurs prévue.»

Moona bénéficiera d’une campagne de financement sur la plateforme Kickstarter à partir du 13 septembre. La commercialisation en magasin n’est pas prévue avant la mi-2018, à un prix de 399 €. Plus de 200 tests ont déjà été réalisés par des volontaires et une étude clinique est conduite par le CHU de Nantes auprès de 15 patients, depuis le mois de juin. Des applications professionnelles sont donc envisageables. «Les maisons de retraite et les hôpitaux pourraient en effet devenir des partenaires, mais ce sera fait dans un deuxième temps» conclut Coline Juin.

Frédéric Monflier

RiskEV : la version 1.6 relookée est disponible !

Avec les évolutions fréquentes de réglementation, il est aujourd’hui nécessaire de sécuriser les évaluations des risques et de pouvoir assurer une traçabilité des expositions sur le long terme. Ce travail sera facilité par le choix d’un logiciel intuitif et performant. C’est ce que propose RiskEV, dont une toute nouvelle version est disponible en ligne. Avec un nouvel écran plus clair et encore plus intuitif, le logiciel est toujours aussi facile d’utilisation.

Et, encore plus important que le design, les fonctionnalités du logiciel sont également améliorées ! Parmi les nouveautés, retrouvez notamment l’édition personnalisée de fiche de poste pour tout risque professionnel, la possibilité d’attribuer des évaluations à tout niveau de l’organisation, …

Cette nouvelle version de RiskEV conserve bien sûr les atouts d’origine du logiciel :

- La possibilité d’évaluer et gérer tous les risques dans un seul outil,

- La gestion facile des plans d’action,

- L’édition d’un Document Unique simple et complet,

- La traçabilité des expositions individuelle ou collective assurée dans le temps

Important : le logiciel RiskEV n’est plus commercialisé

par Techniques de l’Ingénieur.

La matière organique des comètes plus ancienne que le système solaire ?

Terminée en septembre 2016, la mission Rosetta de l’ESA a révélé que la matière organique représente près de 40% de la masse du noyau de la comète « Tchouri » (67P Churyumov-Gerasimenko). Composée de molécules à base de carbone, d’hydrogène, d’azote et d’oxygène, elle constitue l’une des briques de base de la vie telle que nous la connaissons sur Terre. Or cette matière organique trouvée en masse n’aurait pas été fabriquée au moment de la formation du système solaire, mais bien avant, dans le milieu interstellaire. C’est ce qu’avancent aujourd’hui Jean-Loup Bertaux, du Laboratoire atmosphères, milieux, observations spatiales (CNRS/UPMC/Univ. Versailles–Saint-Quentin-en-Yvelines), et Rosine Lallement, du laboratoire Galaxies, étoiles, physique et instrumentation (Observatoire de Paris/CNRS/Université Paris Diderot). Et selon ces deux chercheurs français, une bonne partie de cette matière organique cométaire serait même déjà bien connue des astronomes.

Voilà 70 ans que l’analyse du spectre de la lumière des étoiles montre partout dans le milieu interstellaire des absorptions inconnues, à des longueurs d’ondes bien précises : les « Diffuse interstellar bands » (DIB), attribuées à des molécules organiques complexes, qui constitueraient « le plus grand réservoir connu de matière organique dans l’univers » selon l’astrophysicien américain Theodore Snow. Cette matière organique interstellaire est généralement proportionnelle à la matière interstellaire dans son ensemble, sauf dans le cas d’un nuage très dense, comme une nébuleuse proto-solaire : au cœur de la nébuleuse, où la matière est encore plus dense, les DIB plafonnent, voire diminuent. C’est le signe que les molécules organiques qui provoquent les DIB disparaissent, par agglutination les unes aux autres. Une fois collées ensembles, elles ne peuvent plus absorber autant que lorsqu’elles flottent librement dans l’espace.

Ce type de nébuleuse primitive finit par former, par contraction, un système solaire comme le nôtre, composé de planètes… et de comètes. Or, on sait depuis la mission Rosetta que les noyaux de comètes se sont formés par accrétion hiérarchique dans la nébuleuse : les petits grains se sont collés les uns aux autres pour former des grains plus gros, lesquels se sont agglomérés à leur tour jusqu’à atteindre la taille d’un noyau de comète, de quelques kilomètres. Un processus non violent.

Les molécules organiques provoquant les DIBs et préexistantes dans les nébuleuses primitives n’ont donc probablement pas été détruites mais ont pu faire partie des grains constituant les noyaux cométaires, où elles sont toujours 4,6 milliards d’années plus tard. Une mission spatiale de retour d’échantillon, qui permettrait d’analyser en laboratoire la matière organique d’une comète, révèlerait enfin la nature exacte de cette mystérieuse matière interstellaire responsable des absorptions relevées vers les étoiles.

Si la matière organique des comètes a bel et bien été fabriquée dans le milieu interstellaire, et si elle a pu jouer un rôle dans l’émergence de la vie sur la Terre comme les scientifiques l’imaginent aujourd’hui, alors elle a pu également atteindre un grand nombre d’autres planètes de notre galaxie… et y engendrer également la vie ?

Source : cnrs