Ils ont ainsi identifié cinq comportements présents dans les deux pays : une majorité des sujets font un compromis entre leur opinion et celles des autres (59% des personnes en France), certains conservent leur opinion (29% en France), alors que les autres suivent fidèlement, amplifient, ou contredisent les informations reçues. L’étude montre également comment un groupe peut accroître collectivement ses performances et la précision de ses estimations grâce à l’information sociale. Ces analyses ont permis d’élaborer un modèle reproduisant les résultats de l’étude et prédisant la performance d’un groupe selon la quantité et la qualité de l’information échangée entre ses membres. L’objectif serait in fine de développer des algorithmes d’aide à la décision. Les résultats de cette étude sont publiés le 6 novembre 2017 dans la revue PNAS.

Nous interagissons de plus en plus grâce au développement des technologies et contenus numériques. Ainsi, les réseaux sociaux sont d’importantes sources d’informations sociales dont nous décidons de tenir compte ou non. De plus, de nombreux sites de commerce en ligne utilisent très largement des systèmes de réputation et de notation qui permettent à leurs clients d’exploiter les avis d’autres utilisateurs pour réaliser leurs propres choix. La quantité d’information à laquelle chacun d’entre nous est soumis est cependant bien trop importante pour être toujours traitée correctement, sans compter les fausses informations qui sont parfois difficiles à déceler.

Ces constatations appellent au développement d’outils d’aide à l’intelligence collective, pouvant favoriser le traitement de l’information et la prise de décision dans un groupe par l’intermédiaire des interactions sociales. Le groupe de chercheurs s’est donc intéressé à l’impact de l’information sociale, c’est-à-dire la manière dont nous sommes affectés par ce que font les autres. Dans quelles conditions cette information sociale peut-elle accroître l’efficacité de nos prises de décisions collectives ?

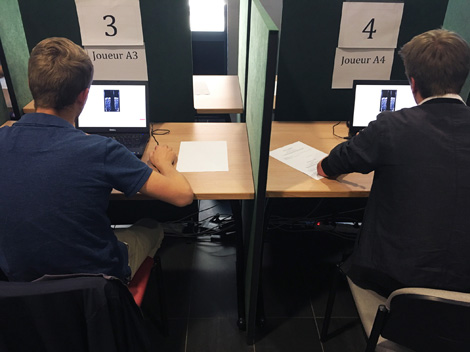

Les expériences réalisées ont impliqué 186 personnes en France et 180 au Japon. Chaque participant devait estimer des valeurs, telles que l’âge de Gandhi lorsqu’il est décédé ou le nombre d’étoiles dans notre galaxie, tout en précisant son degré de confiance dans sa réponse. Suite à cette étape, la moyenne des réponses de participants précédents – l’information sociale – lui était fournie, et le sujet devait répondre à nouveau pour donner son estimation finale. L’une des originalités de cette étude réside dans l’introduction d’agents virtuels contrôlés par les chercheurs, à l’insu des participants, et donnant systématiquement la bonne réponse. Ces agents, dont le nombre pouvait varier, influençaient donc favorablement l’information sociale transmise aux sujets.

Ces travaux montrent comment l’information sociale conduit le groupe à accroître collectivement ses performances et la précision de ses estimations. Ils permettent également de mesurer précisément la sensibilité des sujets à l’information sociale. Les chercheurs ont ainsi identifié cinq profils de sensibilité indépendants du biais culturel, car présents dans les deux pays. En France, l’analyse de près de 11000 réponses montre que 29% des personnes interrogées maintiennent leur opinion, 4% suivent strictement l’information qui leur est fournie et 59% font un compromis entre leur avis initial et l’information sociale. Par ailleurs, 6% des personnes amplifient l’information sociale reçue, pensant que le reste du groupe a, de la même manière qu’eux, sous-estimé sa réponse initiale. Enfin, 2% finissent par contredire leur propre estimation et celle du groupe, le plus souvent sans pouvoir justifier leur décision. En outre, plus l’estimation personnelle d’un participant est éloignée de l’information sociale reçue, plus ce sujet est sensible à cette information. Autre résultat plus surprenant, les scientifiques montrent que la performance d’un groupe peut être améliorée grâce à une quantité limitée d’information incorrecte, celle-ci compensant un biais cognitif humain consistant à sous-estimer des quantités.

Par ailleurs, un modèle mathématique basé sur ces expériences a été développé. Il reproduit fidèlement les mécanismes de sensibilité à l’information sociale observés expérimentalement et prédit l’impact de la quantité et de la qualité de l’information échangée entre les individus d’un groupe sur leur performance collective. La compréhension des processus gouvernant l’influence de l’information sociale sur les choix individuels et collectifs ouvre ainsi de nouvelles perspectives. Des algorithmes personnalisés pourraient être développés afin d’anticiper les différents types de réponses selon la forme des informations sociales reçues et ainsi contribuer à l’amélioration de la coopération et de la collaboration à l’échelle des groupes.

Notes :

1 Les laboratoires français impliqués sont :

Le Centre de recherches sur la cognition animale (CNRS/Université Toulouse III – Paul Sabatier)

Le Laboratoire de physique théorique (CNRS/Université Toulouse III – Paul Sabatier)

TSE Recherche (CNRS/Université Toulouse 1 Capitole/INRA/EHESS) laboratoire de l’école d’économie de Toulouse

Références :

How social information can improve estimation accuracy in human groups. Jayles, B., Kim, H-R., Escobedo, R., Cezera, S., Blanchet, A., Kameda, T., Sire, C., and Theraulaz, G., Proceedings of The National Academy of Sciences USA (sous presse)

DOI: www.pnas.org/cgi/doi/10.1073/pnas.1703695114

Source : cnrs