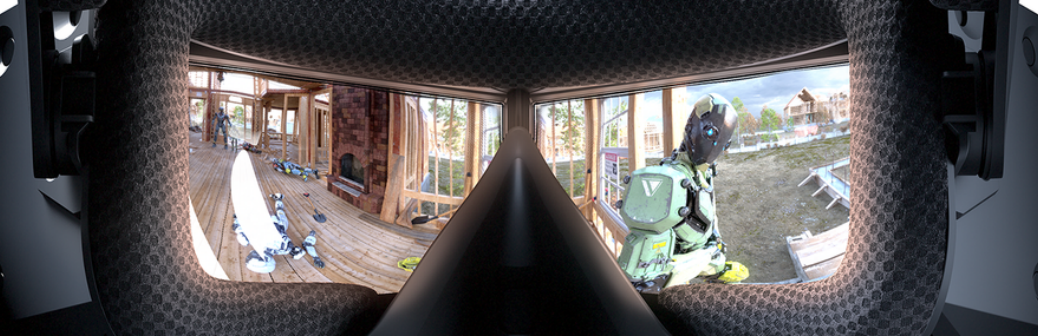

Si l’on se fie à son poids de 450 grammes environ, le casque de réalité virtuelle StarVR est semblable au Vive Pro de HTC ou à l’Oculus Rift. Mais, au vu de ce qu’il contient et ce qu’il propose, il ne joue pas tout à fait dans la même catégorie. Son champ de vision horizontal de 210°, contre 110° chez les concurrents, se révèle en effet beaucoup plus immersif. Il bénéficie en supplément d’un système de «eye tracking» intégré (suivi de la direction du regard) qui modifie dynamiquement la définition de l’image afin d’améliorer les performances graphiques. Dévoilé dans sa version définitive au salon Siggraph, en août dernier, le StarVR s’apprête à la commercialisation. Sa disponibilité et son prix (au delà des 1000 € probablement) ne sont pas encore officiels.

Le StarVR se distingue également en raison de ses origines françaises. Il est le descendant d’un prototype de casque à large champ de vision conçu en 2013 par des anciens ingénieurs d’Airbus. A l’époque déjà, l’angle horizontal du champ de vision s’élève à 210°, ce qui correspond au champ de vision humain quand on bouge les yeux sans bouger la tête. Ce casque, nommé InfinitEye, et l’entreprise du même nom sont acquis deux ans plus tard par l’entreprise suédoise Starbreeze, spécialisée dans le développement et l’édition de jeux vidéo.

Pour le divertissement et l’industrie

StarVR est désormais le fruit d’une co-entreprise impliquant Starbreeze et l’industriel taïwanais Acer, qui détient 66% du capital. «Le StarVR se destinait principalement au marché du LBE (location based entertainment ou salles d’arcade, ndlr), confie Marc Piuzzi, ingénieur en solutions de réalité virtuelle. Depuis l’arrivée d’Acer, nous ciblons aussi les entreprises et l’industrie.» Si la société StarVR est représentée à Taipei, à Stockholm et à Los Angeles, les locaux consacrés à la recherche et développement sont situés sur les Champs-Elysées et regroupent une petite trentaine de personnes.

«Les premiers clients intéressés par notre technologie sont les concepteurs de l’industrie automobile, qui sont déçus par la qualité et l’étroitesse du champ de vision des casques RV actuels, enchaîne Marc Piuzzi. Un champ de vision large est notamment un argument pour les ingénieurs qui apprécient l’ergonomie dans l’habitacle d’un véhicule. Les secteurs de la simulation automobile et aéronautique sont également des débouchés potentiels.»

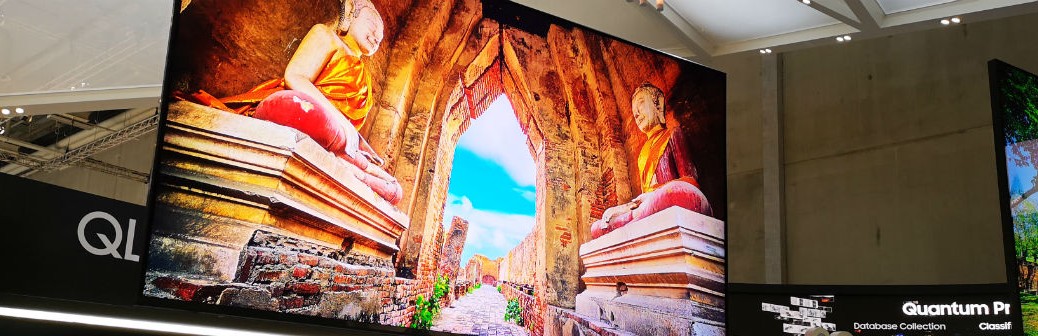

De manière concrète, le StarVR se compose de deux écrans de 1840×1460 pixels chacun et de deux lentilles de Fresnel, qui reproduisent ce champ de vision de 210° à l’horizontal et de 130° à la verticale. Ces deux lentilles ont constitué un défi technique à part entière. «Elles ont demandé deux ans de développement, détaille Marc Piuzzi. Elles jouissent de bonnes propriétés optiques et peuvent être fabriquées à l’échelle industrielle.» Les écrans ont de même leurs particularités. Alors qu’une précédente version disposait d’écrans classiques de téléphone portable, à 60 Hz, la version commerciale est équipée d’écrans Amoled à 90 Hz, élaborés par Acer.

«Un taux de rafraîchissement de 60 images par seconde n’est pas suffisant, indique Marc Piuzzi, et peut provoquer des cinétoses et des scintillements sur les surfaces très claires des objets 3D. Qui plus est, l’arrangement des sous-pixels de nos écrans est complet : chaque pixel compte des sous-pixels rouge, vert et bleu, ce qui a son importance quand l’affichage est placé juste devant les yeux. C’est mieux que la technologie Pentile de Samsung, où les sous-pixels verts sont prédominants (l’oeil humain est plus sensible au vert, ndlr).»

Un gain de performances de 100%

Quant au suivi oculaire, l’idée faisait partie initialement du projet d’InfinitEye. Elle s’est concrétisée cette année avec l’intégration d’un système conçu par une autre société suédoise, en l’occurrence Tobii, dont c’est le domaine d’expertise. Cette fonction est avantageuse à double titre. «En premier lieu, elle améliore les performances, explique Marc Piuzzi. Sur la base d’une carte graphique nVidia GTX 1080Ti (carte graphique haut de gamme prisée par les joueurs «hardcore», ndlr), on parvient à créer deux flux vidéo – un pour chaque écran – à 90 images/seconde, ce qui dépend toutefois du niveau de détails graphiques. En liaison avec le dispositif de Tobii, la carte graphique calcule l’image 3D dans sa définition optimale à l’intérieur d’un cercle centré sur le regard de l’utilisateur, qui couvre 30% du champ de vision. A l’extérieur du cercle, elle traite l’image à 40% de la définition native des écrans. Les performances peuvent doubler en fonction des applications. La puce Tobii analysant le regard étant à l’intérieur du casque, la latence est éliminée.»

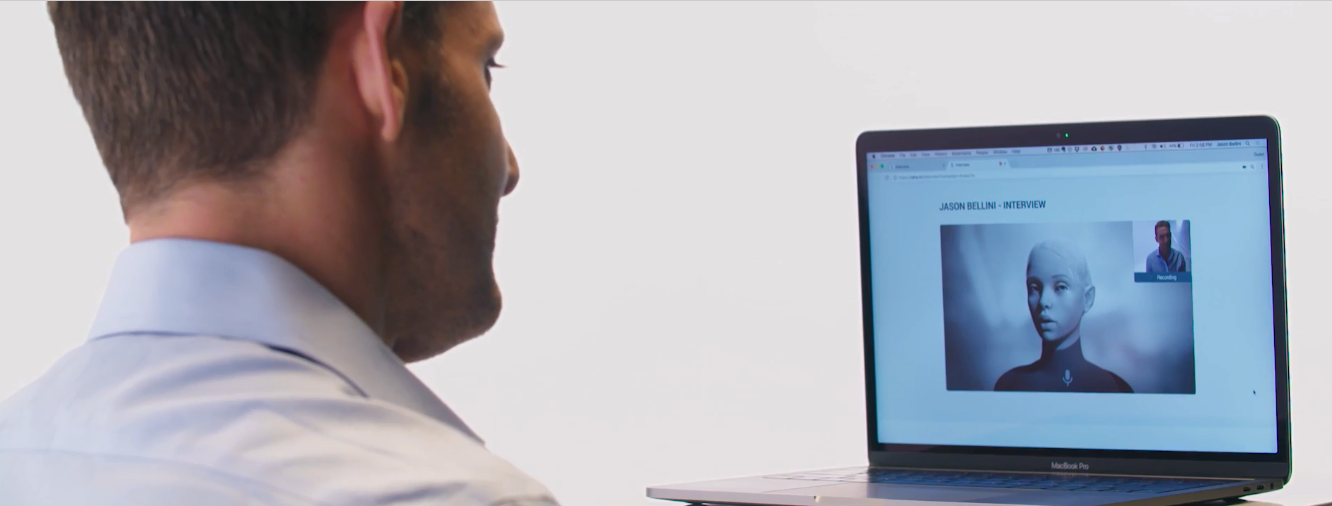

D’autre part, «ce dispositif automatise l’ajustement de la distorsion optique de l’image, qui dépend de l’écart interpupillaire de l’utilisateur, ajoute Marc Piuzzi. Il n’y a plus besoin de molette de réglage manuel.» Son incorporation n’a pas été une mince affaire. «Les LEDs à infrarouge sont placées sur le pourtour des lentilles, décrit Marc Piuzzi. Il a fallu aussi trouver de la place pour les miroirs et les deux caméras qui analysent la position des rétines.» Cette technologie devrait être également utile dans la filière de la formation (BTP, industrie…), qui fait un usage croissant de la réalité virtuelle pour enseigner les bons gestes ou sensibiliser aux risques. «On sait où la personne regarde» constate Marc Piuzzi. Une information qui peut être mise à profit pour améliorer les opérations.

Pour en savoir plus : www.starvr.com

Par Frédéric Monflier