Stéphane Le Foll a classé le frelon asiatique en danger sanitaire de 2e catégorie en 2013. Mais aucune réelle coordination de lutte au niveau national n’a été mise en place, fautes de moyens. Pourtant, Stéphane Le Foll avait annoncé la classification du frelon asiatique en catégorie 1 en octobre 2012.

Puis, il a réitéré son intention de le faire en Décembre 2014 devant les apiculteurs de la Sarthe. Malgré cette intention affichée, l’UNAF dénonce un « double discours », puisqu’aucune décision n’a été prise malgré l’urgence.

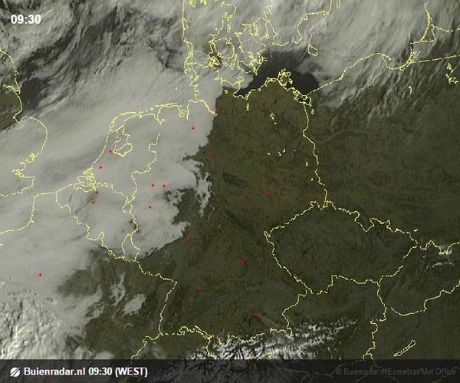

Selon le Muséum National d’Histoire Naturelle, le frelon asiatique est aujourd’hui présent dans 63 départements du sud, du centre et de l’ouest de la France, couvrant les trois quarts du territoire. Il a également gagné l’Espagne, l’Italie, le Portugal et la Belgique. « Le pire, c’est que nos collègues de pays étrangers ont demandé à leurs états d’attaquer la France pour n’avoir pas pris de mesures pour limiter l’invasion du frelon », assure Henri Clément, porte-parole de l’UNAF.

Se doter de moyens pour assurer la lutte

Le classement du frelon asiatique en danger sanitaire de catégorie 2 n’impose pas d’obligation de destructions de nids. En revanche, le classement en catégorie 1 imposerait un plan de lutte obligatoire, à la charge de l’état. Le Gouvernement ne semble donc pas pressé de débloquer des fonds.

Pour diminuer les prix de la lutte contre ce ravageur, l’UNAF demande le retour du SO2 pour la destruction des nids. Aujourd’hui la destruction des nids ne peut se faire que par des biodicides (ou par destruction mécanique pour les nids facilement accessibles), selon la note de service DGAL/SDSPA/N2013-8082 de mai 2013 définissant les « mesures de surveillance, de prévention et de luttes permettant de limiter l’impact du frelon asiatique ».

Pour lutter contre l’attaque des ruchers par les frelons asiatiques, cette note met également en oeuvre le « piégeage de protection du rucher ». Celui-ci consiste en « l’installation au rucher, pendant les périodes estivales et automnales, de dispositifs de piégeages de masse d’ouvrières de V. Velutina », explique l’ITSAP, l’Institut de l’abeille. « Son objectif est la capture d’ouvrières afin de réduire la claustration des colonies d’abeilles et de maintenir l’activité de butinage, tout en minimisant les atteintes aux insectes non cibles », précise-t-il. Ces moyens de lutte sont généralement à la charge des apiculteurs, parfois avec le soutien de collectivités locales.

Mais pour l’UNAF, ce piégeage est insuffisant. « Si on ne piège qu’au niveau du rucher, on n’empêche pas le pillage des frelons sur les ruches l’été venu et on n’empêche en rien la prolifération des frelons », regrette Gilles Lanio, Président de l’UNAF . Car lorsqu’un nid se développe, les ouvrières ont un terrain de « chasse » beaucoup plus vaste. « Si les fondatrices ont un terrain de chasse d’environ 300 m autour du lieu de nidification, les ouvrières prospectent jusqu’à 3 km pour chercher de la nourriture», prévient Gilles Lanio.

Plutôt que de piéger les milliers de frelons ouvriers des nids, il serait plus efficace de piéger les reines fécondées au printemps, avant qu’elles ne pondent ! L’union apicole demande donc un piégeage de printemps, au-delà des ruchers, pour intercepter les reines. « Un nid de frelon en fin de saison peut lâcher 400 à 500 reines qui vont passer l’hiver au chaud. A la fin de l’hiver, ces reines vont devoir chercher un endroit pour faire un nid », détaille Gilles Lanio. Ces reines doivent donc être interceptées avant qu’elles n’aient le temps de fonder leur nid.

Le piégeage proposé par l’UNAF est sélectif. « Nous préconisons un piégeage de printemps qui va de février à début mai pour intercepter les reines qui à ce moment là doivent assumer toutes seules leur alimentation », expose-t-il. Un piégeage de grande envergure à ce moment sur le territoire permettrait de faire reculer la pression des frelons. Mais, faute de moyens , les apiculteurs ne peuvent pas assurer seuls les frais de piégeage.

Un tel piège sélectif coûte environ 4 euros. Certes, il tuera quelques insectes utiles, mais un nid de frelon qui n’a pas été détruit peut consommer de 3 500 à 15 000 équivalent abeilles par jour au mois de septembre ! Au moment où la filière apicole connait des surmortalités d’abeilles chroniques et multifactorielles, l’implication de l’état et le classement de ce frelon en danger sanitaire de catégorie 1 est capital pour l’avenir de l’apiculture française. Car, entre 1994 et 2014, la production nationale de miel est passée de 32 000 tonnes à 10 000 tonnes…

Bientôt le tour de Aethina tumida ? Les apiculteurs craignent désormais également l’arrivée d’un petit coléoptère des ruches, Aethina tumida, dont la progression est rapide en Italie, depuis son apparition à l’automne 2014. En France, ce coléoptère est déjà classé en danger sanitaire de catégorie 1.

Par Matthieu Combe, journaliste scientifique

Et aussi dans l’actualité :