Même si cela peut sembler à première vue paradoxal, les plantes sont très peu efficaces pour mettre le soleil en bouteille, c’est-à-dire pour stocker l’énergie solaire. La finalité existentielle d’une pâquerette n’est pas d’emmagaziner de l’énergie pour les êtres humains ou pour les vaches mais de s’épanouir !

Tout d’abord les feuilles d’un végétal, par exemple un arbre ou une céréale, ne sont pas orientées de manière optimale pour capter le flux énergétique de notre étoile. Elles se font de l’ombre les unes vis-à-vis des autres. Et il n’y a pas de système de tracking permettant de faire pivoter le tronc de l’arbre et de suivre le mouvement apparent du soleil. Même le Tournesol, contrairement à ce que laisse croire son nom, ne tourne pas pour suivre la course solaire (par contre, avant la floraison, ses feuilles, et non pas la plante entière, ont une orientation héliotropique).

Seule une fraction de la surface foliaire globale capture à un instant t l’énergie solaire incidente. Une partie de l’énergie solaire n’est pas captée du tout, passe à travers les feuilles et tombe sur le sol. Une autre est réfléchie par les feuilles. Et seule une partie de l’énergie qui pénétre dans les cellules foliaires parvient effectivement au niveau des photosystèmes, le reste est perdu sous forme de chaleur. Au final environ 20% de l’énergie incidente est capturée.

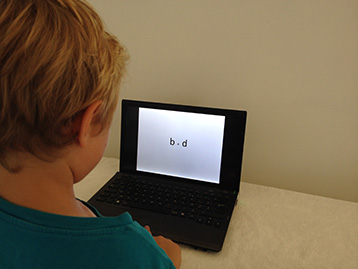

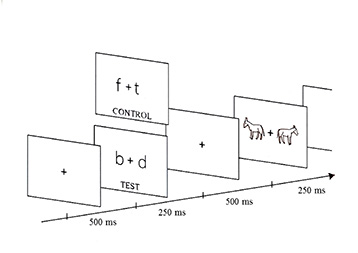

Ensuite les feuilles ne convertissent que 12% de l’énergie solaire capturée. Les molécules, chlorophylles et caroténoïdes, des antennes collectrices des photosystèmes localisées dans la membrane des thylakoïdes chloroplastiques ne sont capables d’absorber que certaines longueurs d’ondes du spectre solaire. Ce qui explique d’ailleurs la couleur verte des feuilles. Seule une partie du spectre (Photosintesis Active Radiations, PAR) est actif d’un point de vue photosynthétique.

De plus 40% de l’énergie de la plante est utilisée pour la respiration cellulaire, et 60% pour les biosynthèses. Enfin il faut 8 photons d’environ 1,8 eV pour fixer une molécule de carbone, ce qui stocke 4,8 eV. L’efficacité du processus est ainsi de 33%.

Comme le montre Roland Geyer, scientifique de l’Université de Californie, l’efficacité globale de la photosynthèse au sens large est ainsi de 0.20 x 0.12 x 0.60 x 0.33 = 0.005, soit 0,5%. En réalité cette efficacité varie selon les espèces végétales de 0,1% à 2%. Les championnes du monde sont les microalgues, des organismes photosynthétiques microscopiques unicellulaires. Certaines espèces de microalgues, dont jusqu’à 75% de la masse peut être lipidique, sont capables de produire, dans des conditions idéales de laboratoire, 30 tonnes d’huile par hectare de culture et par an.

Pour les organismes pluricellulaires, c’est le palmier à huile qui remporte…la palme. Indépendamment de la croissance de sa biomasse lignocellulosique, qui n’a rien d’exceptionnelle, le palmier est en revanche capable de produire 5 tonnes d’huile par hectare et par an. Soit bien davantage que le colza (3,5 tonnes) ou que Jatropha curcas (1,8 tonnes).

Même les micro-algues et le palmier à huile ne font pas le poids

30 tonnes d’huile à l’hectare et par an pour les micro-algues, est-ce beaucoup ? Sachant qu’un litre d’huile a un contenu énergétique de 9,2 kWh en moyenne, c’est équivalent à 276 MWh par hectare et par an. A supposer que l’huile végétale pure soit utilisée directement dans un moteur thermique, c’est-à-dire sans transformations consommatrices en énergie, il ne reste en sortie de moteur thermique, dont le rendement est de 20%, que 55 MWh.

Sur un hectare on peut installer 1 MW de panneaux solaires photovoltaïques. En prenant une hypothèse basse pour le facteur de capacité (15%), on produit alors chaque année 1314 MWh. 2,5% de l’énergie électrique étant perdue en transmission depuis le panneau PV jusqu’à la prise et le rendement de la prise à la roue d’un véhicule électrique étant d’environ 72%, il reste en sortie de moteur 922 MWh.

L’efficacité de l’électro-mobilité photovoltaïque est ainsi 17 fois supérieure à celle de la thermo-mobilité photosynthétique microalgale. Il convient d’intégrer l’énergie qui a été nécessaire à la construction des panneaux PV et aussi à la culture des microalgues. L’énergie délivrée par un panneau PV permet d’en produire plus de 10 autres, autrement dit le facteur de correction est au maximum de 10%. Pour les microalgues l’énergie consommée pour les cultiver est variable selon les espèces. Même en retenant une hypothèse favorable à la filière microalgale d’une énergie consommée égale à zéro, l’écart avec l’efficacité de l’électromobilité photovoltaïque reste supérieur à 0.90 x 17 = 15 fois.

Les recherches menées en matière d’algocarburants ne sont pas inutiles: les micro-algues restent très intéressantes pour la production de molécules à intérêt alimentaire ou pharmaceutique. Et également pour la production de bioplastiques.

Pour le palmier à huile, qui est pourtant le champion des plantes terrestres, l’écart est de 90 fois. L’électro-mobilité photovoltaïque permet ainsi de réduire d’un facteur 90 l’empreinte surfacique, et de préserver les forêts primaires Indonésiennes et Malaisiennes où vit par exemple une espèce emblématique, l’Oran-Outang. Ces questions d’efficacité énergétique ont ainsi des implications majeures et très concrètes. Il ne s’agit pas de simples discussions théoriques de salon.

L’électro-mobilité solaire, une clé pour préserver la biodiversité

Dans leur étude Sun-to-Wheel (« du Soleil à la roue ») Geyer et al on effectué un comparatif entre l’efficacité de l’électro-mobilité photovoltaïque avec la thermo-mobilité photosynthétique à base de maïs ou à base de switch-grass (Panicum virgatum), qui est aussi une graminée (Spatially-explicit life cycle assessment of sun-to-wheels transportation pathways in the U.S).

Roland Geyer a calculé que si l’ensemble des carburants pétroliers utilisés par les USA étaient remplacés par des agrocarburants à base de maïs, il faudrait cultiver 2,2 millions de kilomètres carrés (220 millions d’hectares). La surface des USA (y compris celle de l’Alaska) est de 9,8 millions de km2. L’efficacité de l’électro-mobilité photovoltaïque est supérieure d’un facteur 200 à celle de la thermo-mobilité au maïs. Les conséquences en termes d’empreinte surfacique sont linéairement proportionnelles. Ces réflexions ont d’ailleurs poussé le Vice-Président Al Gore a reconnaître qu’il avait fait erreur en faisant dans le passé la promotion des agrocarburants. Avec le switch-grass le résultat est un peu moins médiocre : 48 millions d’hectares. Mais cela reste extrêmement mauvais comparativement à l’électro-mobilité photovoltaïque qui requiert une surface de seulement 1,1 million d’hectare.

« Nous faisons fausse route avec les agrocarburant » résument les chercheurs. A cause d’un facteur fondamental en amont – le rendement photosynthétique – qu’aucune amélioration technique en aval ne pourra surmonter. « La photosynthèse a des limitations fondamentales » souligne le scientifique Krassen Dimitrov de l’Université du Queensland en Australie. « Même la mise au point d’organismes génétiquement modifiés super-efficaces ne serait pertinente sur le plan économique sans complètement modifier la machine photosynthétique » (GreenFuel technologies: a case study for industrial photosynthetic energy capture).

Convertir la biomasse solide (par exemple le bois) en carburants liquides aggrave encore davantage le bilan. L’énergie requise pour cette conversion peut d’ailleurs dépasser l’énergie contenue dans le bois lui-même.

Compte des ordres de grandeur en jeu, on peut sérieusement s’interroger sur la pertinence des filières énergétiques reposant sur la collecte de l’énergie solaire avec des plantes pour produire des agrocarburants. A fortiori quand on sait que brûler ces agrocarburants dans un moteur thermique conduit à perdre entre 75 et 80% de l’énergie contenue dans ces carburants végétaux. La prise de conscience concernant les limites intrinsèques des filières agrocarburants va fort heureusement croissante, y compris dans le milieu politique.

Point fondamental, les modules photovoltaïques peuvent être installés partout. Sur les toitures des maisons et des bâtiments commerciaux, au dessus des parkings, au niveau des déserts ou sur les lacs de barrage, ce qui limite d’ailleurs l’évaporation. Leur impact sur les terres cultivables à vocation alimentaire est donc nul. Il est d’ailleurs possible d’effectuer du Solar-Sharing, c’est à dire de cultiver des plantes sous les panneaux solaires judicieusement espacés en fonction du point de compensation de la photosynthèse des espèces cultivées. Et comme le souligne Mark Jacobson de l’université Stanford, ces panneaux solaires, contrairement aux plantes, n’ont besoin ni d’engrais nitratés et phosphatés qui perturbent les écosystèmes comme par exemple avec les fameuses marées vertes, ni de pesticides qui impactent la biodiversité (dont les abeilles pollinisatrices), ni d’eau douce, une ressource précieuse et indispensable à l’épanouissement Humain.

Le phosphore, talon d’Achille de la filière microalgale

L’azote des nitrates absorbés par l’appareil racinaire des plantes ne pose pas de problème étant donné que le diazote constitue 80% de la masse de l’air et que l’on sait fixer le diazote atmosphérique pour produire des engrais (procédé Haber-Bosch). Mais les microalgues ont aussi besoin de grandes quantités de phosphates. Le phosphore est un élément indispensable à l’agriculture moderne. Or les réserves minières de roches phosphatées, principalement au Maroc et au Sahara occidental d’où le conflit entre les habitants de ces deux territoires, ne sont pas infinies. Il est donc inopportun de gaspiller ce stock pour faire rouler les voitures étant donné qu’il existe d’autres solutions.

Les panneaux photovoltaïques, eux, sont construits à partir de silicium, le second élément le plus abondant de la croûte terrestre après l’oxygène. L’entreprise Silveo (SolarCity) produit des panneaux à base de silicium et sans argent.

Et le stockage hydrogène ?

Les voitures dites « à hydrogène » sont des véhicules électriques. L’électro-mobilité à base de batterie est plus efficace que celle à base de dihydrogène. En effet l’efficacité de la production de dihydrogène par électrolyse et de celle de la pile à combustible est sur un cycle d’environ 33% selon ERH2-Bretagne-Observatoire. Cela plombe le bilan d’un facteur 2,5 comparativement à celui des batteries. Autrement dit un parc automobile reposant sur l’hydrogène requiert une surface de collecte de l’énergie solaire 2,5 fois plus importante que le même parc automobile reposant sur le stockage par batteries. Il en résulte que le plein d’hydrogène coûtera fatalement au moins 2,5 fois plus cher que le plein direct d’électricité. Ce problème de compétitivité est directement lié à des données physiques de base.

La prise en compte de l’investissement énergétique nécessaire d’un côté à la construction des batteries, et de l’autre à celle des électrolyseurs, des piles à combustible et des réservoirs à hydrogène n’élimine pas le stockage batterie de la première place du podium de l’efficacité énergétique.

S’ajoutent en outre des problèmes de sécurité soulignés par exemple dans une note d’analyse récente de France Stratégie, le Commissariat général à la stratégie et à la prospective, sous la houlette d’Etienne Beeker. Cette note a été critiquée par une association en faveur de la filière hydrogène. Pour le multimilliardaire Elon Musk, PDG de Tesla Motors et de SpaceX, les Fuel Cells (piles à combustible) sont des « Fool Cells », littéralement des piles pour idiots. Jeu de mots qui a le don d’agacer au plus haut point les promoteurs de l’hydrogène. Il en rappelle en effet un autre, celui sur les « Fossil Fuels » (« Fossil Fools », les idiots des énergies fossiles). 95% de l’hydrogène actuellement disponible sur le marché provient effectivement de l’industrie des combustibles fossiles, et non de l’électrolyse de l’eau.

L’Hyperloop solaire, le mode de transport le plus écologique du monde

Les transports aériens peuvent difficilement être électrifiés compte-tenu de la densité énergétique (massique et volumique) des batteries actuelles. Mais on peut aborder la problématique différemment. Avec l’Hyperloop électro-solaire, projet open source et coopératif d’Elon Musk, les marchandises et les personnes pourront voyager à 1100 km/h dans un tube (presque) sous-vide, et donc avec (presque) aussi peu de frottements que dans l’espace. Avec en plus un système de sustentation sur coussins d’airs, la consommation d’énergie sera minimale, et la vitesse identique à celle des transports aériens. Ceci tout en évitant les longues périodes d’attente dans les aéroports et en augmentant le niveau de sécurité. Le voyage Paris-Marseille sera alors effectué en une demi-heure. Le Bruxelles-Istanbul en 3 heures et le Londres-Pékin en 9 heures. L’Hyperloop aura des conséquences majeures tout autant en matière de transport aérien que maritime. Tant pour le transport des voyageurs que des marchandises. Et il permettra de réduire la dépendance de l’Humanité envers les carburants liquides. L’Hyperloop est le moyen de transport à la fois le plus performant et le plus écologique du monde. Que ce soit avec Tesla Motors, SolarCity ou le projet Hyperloop, sur le plan de la physique Elon Musk et ses collègues ont tout bon.

Le pétrole, lui aussi, est un agrocarburant

La biomasse dont le pétrole dérive a été formée par des micro-algues photosynthétiques océaniques il y a des millions d’années. Le stock de pétrole global, déjà brûlé depuis le début de l’ère industrielle et pas encore brûlé, est de 1200 + 1500 = 2700 milliards de barils selon l’IFP, ce qui est équivalent à 4590 PWh. Il est faible comparativement à la quantité d’énergie solaire interceptée chaque année par le disque terrestre: 1 533 000 PWh.

En 26 heures la Terre intercepte une énergie solaire équivalente à la totalité du stock de pétrole mondial déjà brûlé et pas encore brûlé. Le risque de pénurie énergétique est très relatif face à un flux photonique aussi colossal.

Par Olivier Danielo

Et aussi dans l’actualité :