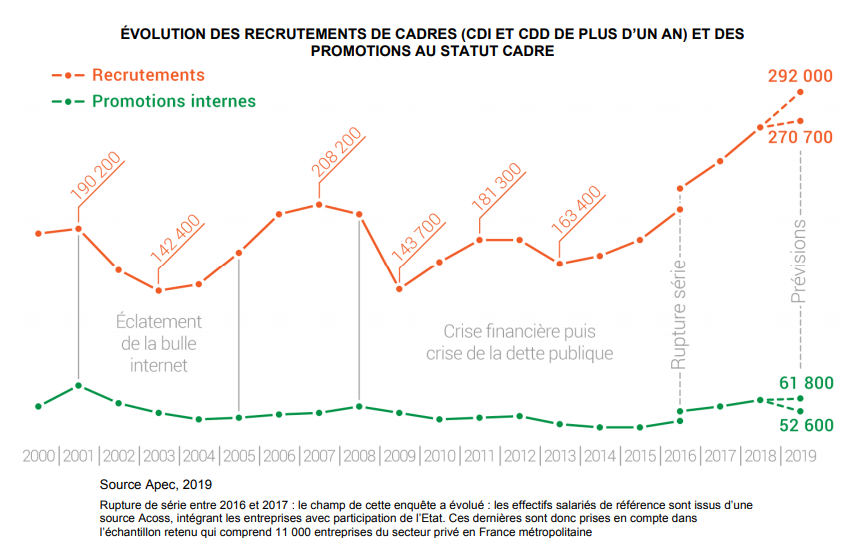

Le rapport de l’IEA qui inquiète

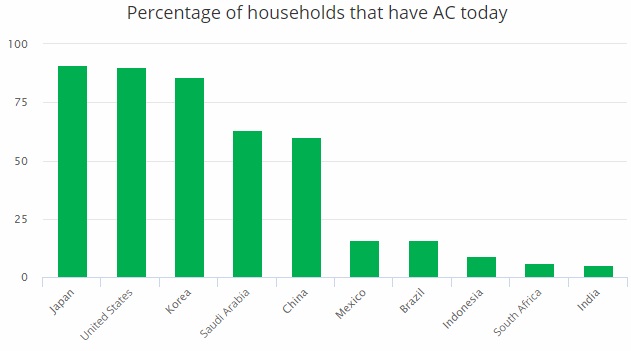

Il y a des chiffres parfois surréalistes qui font beaucoup réfléchir. 10% de la consommation électrique mondiale, c’est énorme. Pire : la situation va s’aggraver d’ici les 30 prochaines années, car de nombreux pays chauds et très peuplés tels que l’Inde sont encore peu équipés en air conditionné.

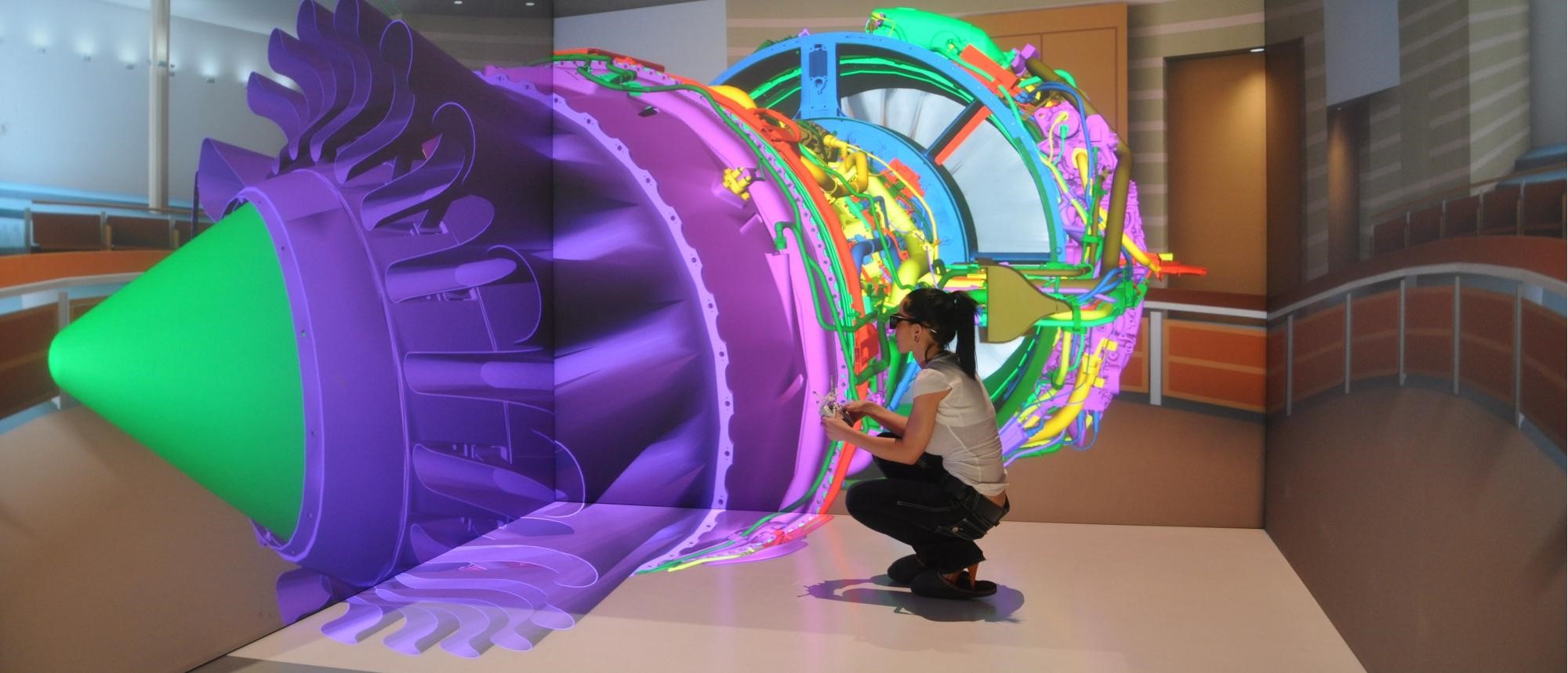

Si rien ne change, l’air conditionné deviendra bientôt l’une des premières sources de consommation électrique. Fort heureusement, ce constat de l’International Energy Agency (IEA) est suivi de propositions de solutions. Selon l’IEA il serait urgent de miser sur le déploiement de systèmes d’air conditionné plus efficaces et de travailler également sur les technologies permettant de réduire efficacement la facture énergétique des bâtiments (cf. Figure 1).

Comment la recherche peut-elle résoudre le problème de l’air conditionné?

Et si la solution était tout simplement de se passer d’air conditionné ? Une équipe de chercheurs de l’université américaine de Columbia semblent envisager sérieusement cette possibilité au regard des résultats de leurs travaux. La solution proposée par l’équipe du docteur Jyotirmoy Mandal est plutôt audacieuse : élaborer un revêtement polymère super réfléchissant et possédant une quantité importante de porosités à l’échelle micrométrique et nanométrique. Comment un tel revêtement peut-il servir à refroidir un bâtiment ? Grâce à un processus physique appelé « passive daytime radiative cooling » ou PDRC, par lequel un matériau est capable à la fois de réfléchir le rayonnement solaire et d’émettre de la chaleur par radiation dans les parties froides de l’univers lointain. Du point de vue des propriétés physiques, un tel matériau doit donc avoir une haute réflectance et une excellente émissivité.

Comment l’effet de PDRC est-il possible ?

Au premier abord, il semble impossible de refroidir une surface exposée en plein soleil sans utiliser d’énergie. Les choses sont en réalité plus complexes : le soleil émet la majorité de son énergie dans les domaines de longueur d’onde du proche infrarouge et du visible. Les matériaux à effet PDRC sont donc conçus pour réfléchir ces longueurs d’onde ; jusqu’ici rien d’étonnant. La subtilité réside en fait dans la capacité du matériau à réémettre de l’énergie radiative dans une plage de longueurs d’onde qui n’est pas absorbée par l’atmosphère. En clair, cette énergie part dans l’espace lointain et ne contribue pas à l’effet de serre sur terre !

Une peinture blanche qui n’absorbe pas les UV

Bien que des matériaux réfrigérants passifs soient déjà commercialisés, ils sont en revanche onéreux, sensibles à la corrosion et non applicables sur des surfaces existantes. Les seuls revêtements facilement applicables qui existent sont des peintures blanches classiques dont la réflectance n’excède pas 85 %.

Pour améliorer les propriétés de ces peintures, l’équipe de chercheurs a donc eu l’idée de remplacer les pigments par des cavités remplies d’air et c’est une réussite : le bilan thermique du matériau affiche une perte de 100 W par mètre carré, soit une réduction de 6°C dans l’environnement aride de l’Arizona et 3°C dans l’atmosphère tropicale du Bangladesh.

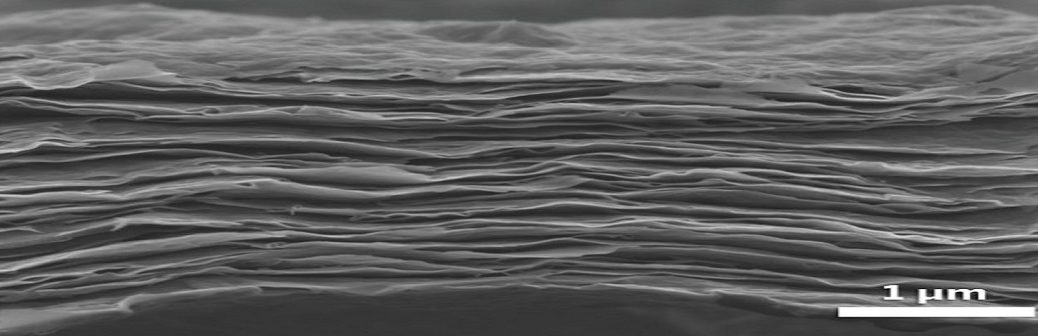

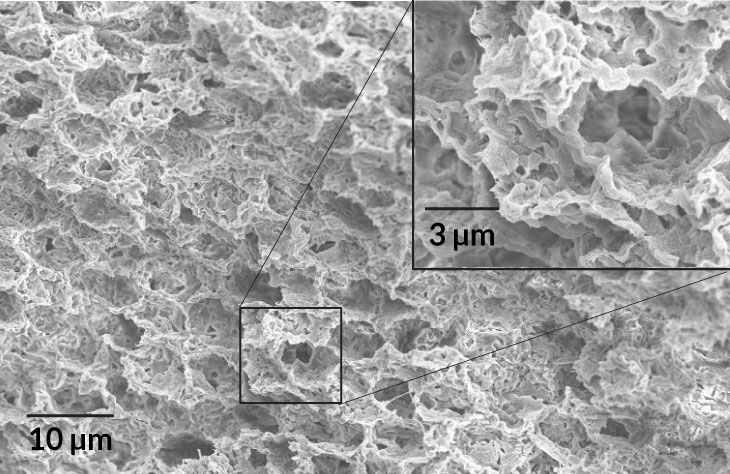

Un matériau ayant la structure d’une éponge

Cette peinture a été synthétisée à partir d’eau, d’acétone ainsi que d’un polymère appelé poly(vinylidene fluoride-co-hexafluoropropene). Lors du séchage de la peinture, l’évaporation de l’acétone et de l’eau laisse derrière elle un film polymère criblé de poches d’air (cf. Figure 2). Ces petites cavités dont la taille varie de 200 nm à quelques micromètres ont la particularité de réfléchir plus de 96 % de la lumière du soleil incidente.

Une solution polyvalente et économique

La solution proposée par cette équipe de chercheurs semble être idéale. En plus d’être économique et facile à appliquer, il semblerait qu’elle puisse également être colorée et utilisée sur toute surface qui peut être peinte. Concrètement, les applications vont bien plus loin que les façades et les toits des bâtiments : ce revêtement pourrait bientôt être appliqué sur tous types de véhicules comme les avions les voitures et même des engins spatiaux.