C’est le grand dada du moment : utiliser du méthane comme ergol pour les futurs moteurs chimiques des lanceurs. Pourquoi le méthane ? Car même s’il est moins puissant que l’hydrogène, il est beaucoup moins coûteux et facile à manipuler – il est liquide à -161°C contre -253°C pour l’hydrogène. Cette température, proche de l’oxygène liquide (183°C), permet des simplifications dans l’architecture du moteur pour le stockage des deux ergols. En effet, il peut par exemple être utilisé pour pressuriser les réservoirs d’ergols (pressurisation autogène), ce qui élimine le besoin de systèmes de pressurisation complexes et coûteux à base d’hélium par exemple. En outre, le méthane est six fois plus dense que l’hydrogène, il prend donc six fois moins de place. Les étages de fusées pourront être plus compacts et potentiellement plus faciles à récupérer pour être réutiliser.

L’Europe mise sur Prometheus

Pour les lanceurs européens, dont Ariane 6, le moteur phare sera Prometheus (pour Precursor Reusable Oxygen METHane cost Effective propUlsion System) qui, comme son acronyme anglais l’indique, est un moteur qui fonctionne à l’oxygène et au méthane et qui doit être réutilisable. Il vise bien sûr aussi une réduction des coûts ! Prometheus disposera d’une poussée variable d’un maximum de 100t et Ariane 6 décollera équipée de 7 d’entre eux. Les premiers essais d’allumage ne sont prévus qu’en 2020 et l’intégration sur les lanceurs à l’horizon 2030. La série des moteurs actuels, Vulcain, a donc encore de beaux jours devant elle.

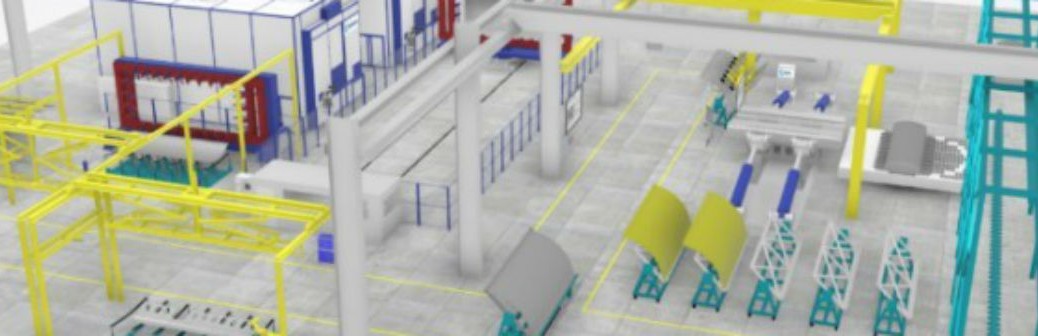

Prometheus est en début de fabrication dans l’usine d’ArianeGroup à Vernon (Eure) où les premières pièces fabriquées par fabrication additive sont sortis l’été dernier (générateur de gaz). L’utilisation de la fabrication additive et un dispositif industriel conçu pour la production de 50 moteurs par an doit permettre de diviser par 10 le coût de production par rapport à Vulcain 2. Portant le tarif d’un moteur à « seulement » 1M€.

Les Américains aussi carbureront au méthane

L’Europe n’est pas la seule à opter pour le méthane. Blue Origin et son moteur BE4 avance aussi. La société fondée par Jeff Bezos, le PDG d’Amazon, a en effet annoncé en janvier 2018, qu’un nouveau test au feu du moteur BE-4 a été effectué avec succès après celui déjà annoncé en octobre 2017.

Ce moteur doit notamment équiper le lanceur lourd New Glenn dont le premier vol est prévu en 2020. Il est toujours en compétition pour équiper la future fusée réutilisable Vulcan de United Launch Alliance (ULA). La décision devrait être prise dans les prochains mois. Le test, réalisé à pleine puissance, a montré que les objectifs d’impulsions spécifiques étaient même dépassés. Cet essai avait notamment pour but de vérifier la réutilisation des pompes hydrostatiques et la stabilité des processus de marche/arrêt. Une variante de ce moteur le BE-4U doit en effet pouvoir équiper l’étage supérieur de la New Glenn et permettre ainsi la mise en orbite de plusieurs charges utiles différentes. La New Glenn, qui doit être disponible en version deux ou trois étages, dont le premier réutilisable sera propulsée par une poussée de l’ordre de 176 tonnes (3,85 millions de livres) grâce à 7 BE-4 et devrait pouvoir mettre en orbite basse un peu moins de 50t.

De son côté, Space X travaille à son Raptor. De multiples versions de ce moteur fonctionnant au méthane ont été présentées depuis les débuts du projet en 2009. La version en cours, dont les tests d’allumage sur banc d’essais ont commencé, est finalement la plus petite et doit servir de base à la propulsion de la BFR (Big Fucking Rocket), un lanceur très lourd destiné aux lancement nécessaires aux voyages interplanétaires qui serait pourvu d’une trentaine de Raptors.

Plusieurs autres projets sont aussi en cours ailleurs dans les grandes nations spatiales comme en Russie ou en Chine.

Plus efficace et moins chère

Pour rendre la propulsion chimique plus efficace et attractive, la tendance est à l’optimisation. Du côté d’Ariane, il s’agit par exemple du moteur Vinci pour l’étage supérieur des lanceurs moyens/lourds de l’ESA qui doit apporter plus de polyvalence à Ariane 6. Fonctionnant à base d’ergols liquides (hydrogène et oxygène), il aura par exemple une capacité d’allumages multiples : il pourra se ré-allumer en vol autant de fois que nécessaire pour placer plusieurs charges utiles en orbite à différents endroits, selon les besoins. Une propriété essentielle à l’heure du développement des constellations de satellites. Vinci subit actuellement ses derniers tests avant essais en vol et la fabrication des premières pièces des moteurs de vol sont déjà sorties des usines.

Pour la Nasa, la future « Méga » fusée SLS qui doit être capable d’emporter une capsule Orion avec des passagers pour 2020 sera équipée de moteurs RS25 d’Aerojet Rocketdyne un peu revisités.

Le dernier test effectué en décembre 2017 visait ainsi à valider l’un des quatre contrôleurs du moteur qui optimise son fonctionnement avec les données des ordinateurs de vols et les paramètres mesurés dans le moteur. L’essai visait aussi à valider la plus grande pièce de moteur de fusée imprimée en 3D par la Nasa : un système amortisseur d’effet POGO (vibrations provoquées par les fluctuations de poussée du moteur qui peuvent entrer en résonance avec la structure et détruire le lanceur). La fabrication additive doit permettre de réduire les coûts de fabrication du moteur RS-25 de l’ordre de 30 %. Rien que pour l’amortisseur POGO, imprimée en deux parties par fusion laser, le nombre de pièces est passée de 28 à 6 et le nombre de soudures originelles de 123 à 27.

Le chimique fait aussi dans le petit

Les innovations en matière de propulsion chimique ne sont pas réservées aux très gros moteurs. Des solutions voient aussi le jour pour les nanosatellites. Notamment via des systèmes de propulsion par gaz froid miniaturisés. Ainsi, le GomX-4B de l’ESA, lancé en février 2018, est muni de deux paires de petits propulseurs qui ressemblent à des briquets de cigarettes.

La mission GomX-4 vise à tester cette propulsion et la communication par radio entre plusieurs satellites (dans ce cas GomX-4B et GomX-4A). Les propulseurs fabriqués par le suédois NanoSpace doivent permettre d’ajuster les mouvements du satellite à des vitesses de l’ordre de 15m/s. Deux réservoirs de butane liquide pressurisés sont reliés aux deux paires de propulseurs. Il n’y a pas de combustion, la poussée est assurée lorsque le liquide pressurisé relâché à l’extérieur se détend pour devenir un gaz. Le butane liquide, 1000 fois plus dense que son gaz, peut être stocké dans un très petit volume. Chaque propulseur fournit une poussée de 1 millinewton, ce qui reste suffisant pour faire bouger le satellite de 8 kg. L’ensemble, chambre, capteurs et tuyères tient sur dans un élément de 1×2 cm et d’1mm d’épaisseur. Avec le vol de GomX-4B, NanoSpace vise à démontrer les différentes variantes de poussées possibles : longues, courtes, par impulsion, dirigées vers le haut, le bas et ce dans de réelles conditions spatiales.

Sophie Hoguin