L’existant est-il optimisé ?

On constate souvent deux angles morts dans la conduite des démarches qualité, notamment dans les TPE PME :

- La place de l’humain et du champ social, question escamotée comme si la dimension sociale de l’entreprise n’était pas légitime dans une démarche qualité ;

- La compréhension systémique de l’entreprise, souvent sommaire ou simpliste et donc peu opérante pour aider l’entreprise face à ses enjeux.

Ces deux angles morts sont d’ailleurs liés par la même croyance malheureusement largement partagée dans l’entreprise, que la performance est avant tout question de technique et d’outils bien utilisés ! Cette croyance s’accompagne souvent d’une certaine méfiance vis-à-vis de ce qui n’est pas tangible et quantifiable.

Ce ne serait pas grave si le tabou dont semblent frappés ces sujets n’avait des conséquences dommageables pour les performances des entreprises :

- Inefficacité relative de la démarche qualité par faiblesse du modèle de fonctionnement (faiblesse d’analyse systémique) ;

- Faible implication du personnel faute de prise en compte réaliste de l’humain (faiblesse du champ social).

Et pourtant nombreux sont ceux qui ont alerté sur la question. Déjà dans les années 1970 Joseph JURAN avait alerté sur la double dimension du changement, technique et culturel, et sur la nécessité de prendre en compte les répercussions sociales si l’on veut que le changement technique soit accepté.

Quarante-cinq ans plus tard, Philippe Lorino redit presque la même chose, comme si aucun progrès n’avait été fait sur cette question : « A la philosophie de base, qui date des années 30, on peut tout à fait ajouter une dimension qui prenne en compte le dialogue social et les organisations représentatives des salariés. C’est en effet le principal angle mort de la méthode Lean historique » (Cf. article de Philippe LORINO (Professeur Eminent ESSEC) dans l’article donné à l’Usine Nouvelle en octobre 2014).

Ne pourrait-on pas mieux prendre en compte la réalité de l’entreprise et sa complexité dans les démarches qualité et élargir le modèle techniciste qui prévaut encore ?

Peut-on s’extraire du modèle classique ?

L’évolution du référentiel ISO 9001 en 2015 offre des ouvertures à explorer.

Ainsi par exemple, dans l’ISO 9000, la définition de système de management de la qualité (« SMQ » dans la suite ou simplement « système » pour ne pas alourdir la lecture) s’enrichit et précise sa relation avec les processus.

§ 3.5.3 – Système de management : ensemble d’éléments corrélés ou en interaction d’un organisme, utilisés pour établir des politiques, des objectifs et des processus de façon à atteindre lesdits objectifs. (rappel : SMQ = partie d’un SM relatif à la qualité).

Cette définition suggère que les processus sont établis et déterminés par des éléments du système de management. Que sont ces éléments constitutifs du système de management ?

Monsieur Nigel CROFT, chef du comité technique de l’ISO en charge de la rédaction des référentiels ISO 9000, 9001 et 9004, a répondu à cette question lors d’une de ses conférences de présentation de l’ISO 9001 en regroupant ces éléments en trois catégories désignées par :

- « Hardware » : équipements, installations, réseaux …,

- « Software » : connaissances formelles, brevets, procédures …,

- « Humanware » : humains, valeurs, expériences, savoirs, comportements …

Ces trois éléments se rencontrant et interagissant notamment lors de la mise en œuvre des processus d’une l’entreprise.

En France, une pratique largement répandue consiste à considérer qu’un système de management de la qualité est composé uniquement d’un ensemble de processus. Pour cela, les tenants de cette approche n’hésitent pas à tordre la définition de l’ISO 9000, pour aboutir à ce que les éléments du système, qui créent et établissent les processus, soient finalement phagocytés par ces derniers, à l’instar de la figure de l’humanoïde de Science-Fiction qui se retourne contre son créateur !

Pour s’en convaincre, citons la note 2 de la définition de système de management qui précise :

« Les éléments du système de management comprennent la structure, les rôles et responsabilités, la planification, le fonctionnement de l’organisme, les politiques, les pratiques, les règles, les convictions, les objectifs et les processus permettant d’atteindre ces objectifs. »

Ne serait-il pas alors possible et utile de considérer que le système de management de la qualité est composé d’autres éléments que les seuls processus dont les finalités opérationnelles et économiques, pour importantes qu’elles soient, ne recouvrent pas la totalité des enjeux des parties intéressées de l’entreprise ?

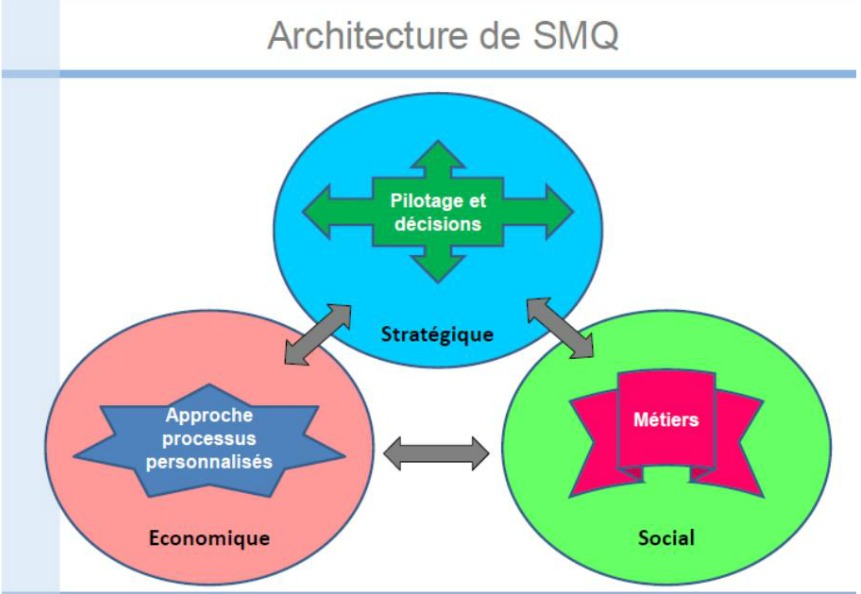

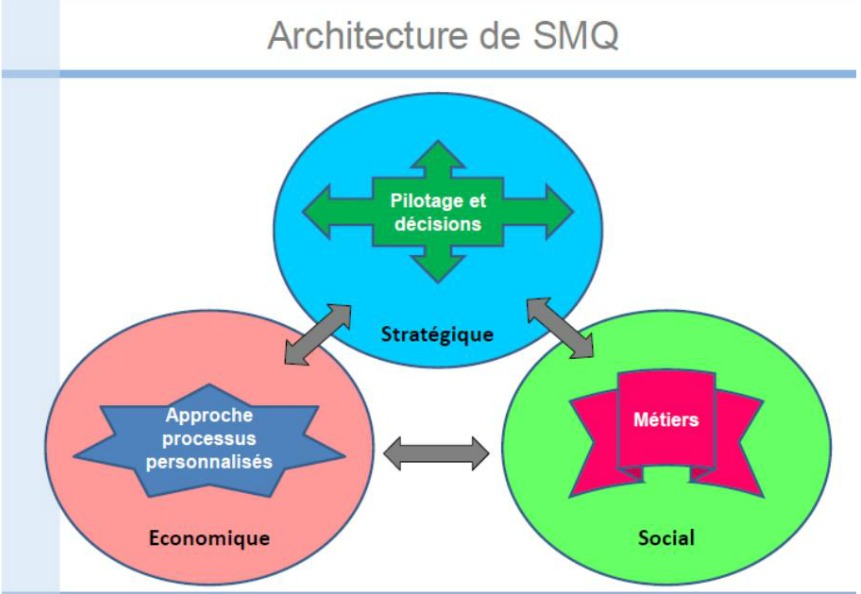

Une entreprise est un système qui créé de la valeur pour les parties intéressées. Selon les parties intéressées considérées on sera enclin à considérer l’entreprise de différents points de vues :

- d’un point de vue économique : clients, activités, produits et services, chiffre d’affaires, rentabilité, investissement …,

- d’un point de vue social : emplois, rémunérations, conditions de travail, relations sociales …,

- d’un point de vue stratégique : compétition, changement, alliances, pouvoir, décisions …

Nous avons beaucoup agit dans les démarches qualité, s’appuyant sur les finalités satisfaction clients et conformité des produits et services du SMQ, comme s’il suffisait de prendre en compte la dimension économique de l’entreprise, siège des activités productives de biens et de services fournis aux clients, pour obtenir un fonctionnement optimisé.

De plus, il a souvent été considéré que les deux autres dimensions de l’entreprise devaient finalement se mettre au service du champ économique pour l’intérêt de tous !

Le modèle largement répandu de système de management de la qualité fondé sur des processus (champ économique) peut se lire de cette façon, comme un modèle réducteur, éclipsant et bridant les deux autres dimensions de l’entreprise :

- La dimension stratégique, en la réduisant aux principes de leadership et de prise de décision fondée sur les preuves comme si les affects, les essais-erreurs, la chance, les égos … n’entraient pas dans la compétition économique et les prises de décision ;

- Le social, en le réduisant aux principes d’implication du personnel et à la gestion des « ressources humaines », appellation souvent mal acceptée par ceux qu’elle désigne, comme si les personnes appartenaient à l’entreprise et n’avaient pas, individuellement, un parcours professionnel à construire, à entretenir et à valoriser.

C’est un peu comme si pour obliger un véhicule à aller le plus loin possible en avant, on limitait son rayon de braquage pour l’empêcher de dévier à droite ou à gauche et qu’on supprimait la marche arrière et le frein pour l’obliger à avancer coûte que coûte. Cela ne serait pas efficace n’est-ce pas ?

Et bien, toutes choses égales par ailleurs, c’est pourtant ce que l’on peut voir dans de nombreuses entreprises pour ses dimensions bridées.

Comment faire évoluer le modèle classique ?

Nous savons pourtant depuis longtemps, grâce à la théorie des systèmes élaborée dans les années 1950-60 que « la régulation d’un système n’est efficace que si elle s’appuie sur un système de contrôle aussi complexe que le système lui-même » (in. « Le Macroscope » J. de Rosnay – 1975). Cela est connu sous le nom de « loi de la variété requise » proposée par Ross Ashby en 1958 et jamais démentie depuis, à ma connaissance.

Il ne paraît donc pas déraisonnable de s’interroger sur la variété requise des modèles de systèmes de management de la qualité associés aux démarches qualité dans les entreprises !

Le SMQ, par définition outil permettant d’orienter et diriger un organisme en matière de qualité, peut-il s’acquitter efficacement de sa tâche sans prendre en compte les trois champs d’actions principaux existant dans l’entreprise : économique, stratégique et social ?

Notre réponse est non ! Et c’est cette prise en compte systémique que nous proposons dans notre méta-modèle de système de management de la qualité illustré par la figure associée à cet article :

Ce modèle s’est construit progressivement dans la confrontation de l’expérience pratique dans les entreprises et la réflexion à partir des approches existantes des démarches qualité, incluant la perception des angles morts présentés au début de cet article.

La plus grande difficulté a été d’identifier, à côté de l’élément « processus » – représentant la projection du champ « Economique » sur le SMQ –, les éléments qui pourraient représenter efficacement les champs Stratégique et Social de l’entreprise tout en faisant partie du SMQ. Autrement dit, trouver une projection pertinente des champs Stratégique et Social dans le SMQ.

Un résultat possible, testé avec succès dans plusieurs TPE – PME, propose les éléments concrets suivants :

- Les instances de pilotage et de décisions, représentant le champ Stratégique projeté au niveau du SMQ ;

- Les métiers, représentant une projection du champ Social sur le SMQ.

Dans la pratique, ce modèle s’est avéré opérant car il traduit des réalités et permet de rendre compte de l’existence de champs d’actions et de logiques spécifiques aux acteurs de l’entreprise, logiques qui ne sont pas naturellement convergentes et qui interagissent en permanence dans une succession temporelle de compromis et d’équilibres à établir.

S’il est compréhensible que d’un point de vue Economique on puisse souhaiter que les décisions prises et les compétences des acteurs soient entièrement consacrées à la performance des processus, la réalité du terrain nous montre quotidiennement que c’est un tout petit peu différent et plus complexe. Continuer à faire semblant n’est pas un crime mais ça n’est probablement pas la voie optimale !

Comment introduire ce modèle dans l’entreprise ?

En pratique, dans entreprise, les rappels théoriques ne sont pas indispensables, et nous posons directement la question suivante aux acteurs : « De quoi dépend la performance de votre entreprise ? »

Ce brainstorming conduit généralement aux réponses suivantes :

- de la réussite commerciale,

- de la qualité des prestations et produits,

- des personnes,

- des moyens matériels mis à disposition

- de la direction,

- de la bonne circulation des informations,

- des moyens financiers,

- du climat social,

- etc.

Nous leur disons : « Vous avez raison ! Et ce que l’on va faire ensemble va intégrer tout cela autour de trois domaines ou leviers d’actions :

- les processus pour développer l’esprit d’équipe et l’efficacité des activités (commerciales, techniques, administratives) au service des clients ;

- les métiers pour développer d’une part les savoir-faire et les compétences nécessaires aux processus et d’autre part votre capital-emploi ;

- le pilotage et les décisions parce que sans cela il n’y a pas de réussite possible ! ».

Pour conclure, c’est grâce à ces trois leviers de notre modèle et à ses déclinaisons et variations opérationnelles, intégrant notamment mais pas uniquement l’approche risques et le principe d’action PDCA, que nous construisons des systèmes de management de la qualité partagés par les acteurs de l’entreprise, contribuant efficacement aux performances et aux objectifs stratégiques des TPE – PME qui nous font confiance.

Par Olec Kovalevsky, Consultant en organisation et démarches qualité Pilote du groupement Performance Qualité TPE PME

Postface pour les sceptiques

Terminons, à l’attention de ceux qui pourraient douter de la pertinence de distinguer les éléments « Instances de pilotage et de décisions », « Processus » et « Métiers », par deux extraits de Michel Crozier et Erhard Friedberg dans « L’acteur et le système ».

« Le décideur ne cherche pas l’optimum, la meilleure solution dans l’absolu, qui est de toute façon hors de sa portée, mais il cherche pourtant toujours une solution « rationnelle ». Qu’elle sera-t-elle ? La première solution qui répond aux critères de rationalité qui sont les siens. L’homme n’est pas un animal qui cherche l’optimisation mais la satisfaction. » (cf. modèle de rationalité limitée introduit par Herbert Simon).

« Accepter de penser que c’est au niveau des capacités seulement que l’action sur les hommes ou pour les hommes a un sens pratique permet d’éviter ce piège de la morale éternelle : faire le bien des hommes sans leur demander leur avis. Agir sur les motivations, quelles que soient les intentions, entraîne à toutes les complaisances. Aider les hommes à développer des capacités nouvelles dont on accepte qu’elles puissent s’exercer contre vous offre un pari plus difficile mais raisonnable, et d’autant plus raisonnable qu’il est moins dangereux moralement. Ce pari est associé naturellement à la vision de rationalité limitée, de coopération impossible sans conflit et de relations de pouvoir universelles et inévitables. »

Références :

- « Le Macroscope » Joël de Rosnay – 1975 – Editions du Seuil

- « L’acteur et le système » Michel Crozier et Erhard Friedberg – 1977 – Editions du Seuil

- « Réconcilier la stratégie et l’opérationnel – l’approche « processus – compétences » René Demeestere, Vincent Genestet et Philippe Lorino – 2006 – Editions ANACT

- « Règles, Métier et Processus – trois explorations » Laurent Chiozzotto, Dominique Fauconnier, Michel Raquin – Editions L’Harmattan – 2013

- « Mettre à niveau son système de management de la qualité avec l’ISO 9001 : 2015 » Olec Kovalevsky – 2016 – Techniques de l’Ingénieur (Livre blanc téléchargeable)