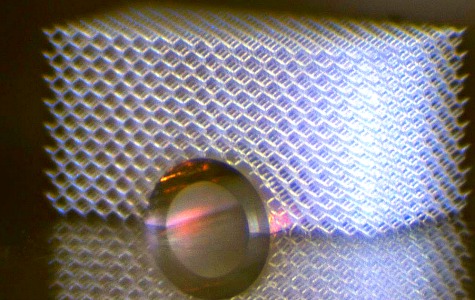

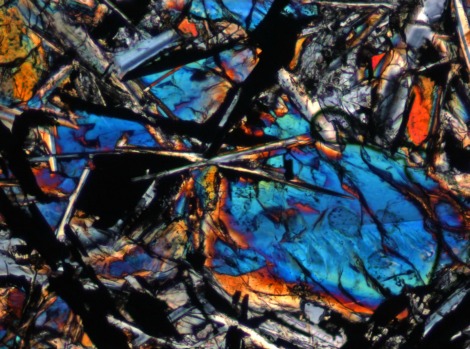

Du verre rendu plus résistant par des micro-fissures

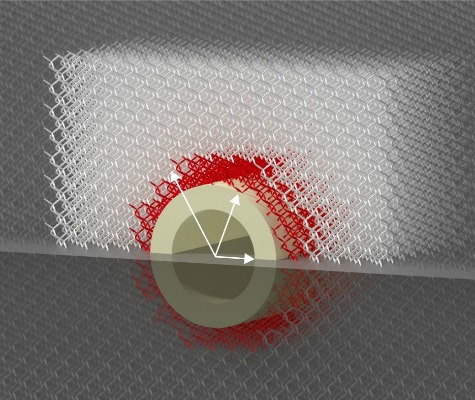

La nature est bien faîte et son observation peut se révéler très enrichissante comme le montre l’étude menée par des chercheurs de l’Université McGuill à Montréal et publiée dans la revue Nature Communications dans laquelle les travaux relatés spécifient qu’en s’inspirant des micro-fissures présentes dans la nacre ils ont pu obtenir un verre bio-inspiré 200 fois plus tenace qu’un verre classique.

Le verre est par nature fragile et il ne supporte pas bien les chocs. Pour remédier à ce fait, le chercheur François Barthelat explique avoir tracé des micro-fissures avec un laser dans des lamelles de verre; comme celles observées à l’intérieur de la nacre. Ainsi, en cas d’impact, l’énergie est davantage absorbée. Les fissures se déforment sous la pression mais ne se propagent pas, ce qui se traduit par une ténacité 200 fois plus importante que le verre de départ.

Cette technique devrait bientôt être vérifiée sur d’autres matériaux.

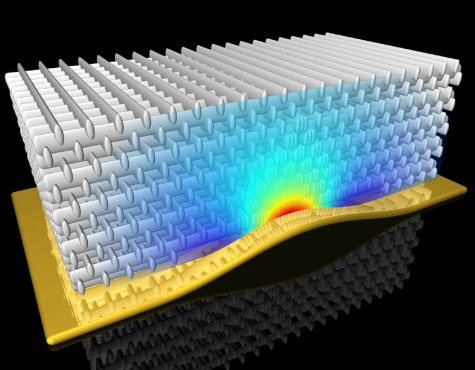

Quand les fenêtres font office de régulateur thermique

En hiver les déperditions de chaleur sont inévitables. Du coup, on chauffe plus que nécessaire. À l’inverse, l’été, on aimerait souvent que la température soit plus douce afin d’éviter de ressortir le ventilateur ou d’activer la climatisation quand on en dispose. Le professeur Ben Hatton de l’Université de Toronto a peut-être trouvé une solution à ce problème en créant un matériau bio-inspiré qui rendrait nos fenêtres moins coûteuses en énergie en les transformant en régulateur thermique.

Comme il l’explique dans un article écrit pour le journal scientifique Solar Energy Material and Solar Cells, le professeur Ben Hatton a utilisé une pellicule d’élastomère flexible et transparent, un polymère à base de polydimethylsiloxane (PDMS), qu’il a intégré aux fenêtres classiques. Or, les PDMS possèdent des vaisseaux à l’intérieur desquels circule de l’eau à température ambiante. À l’instar du réseau vasculaire interne de certains organismes, ces derniers peuvent agir comme un mécanisme de refroidissement. Le professeur prend d’ailleurs en exemple les « vaisseaux sanguins qui se dilatent pour augmenter le flux sanguin au contact de la peau afin d’augmenter le transfert de chaleur par convexion, tandis que la vasoconstriction (diminution du calibre des vaisseaux sanguins) limite le flux lorsque la peau est exposée au froid. »

Quand on sait que pour un bâtiment lambda, la facture est accaparée à 40% par ce problème de fenêtres, son idée s’avère des plus intéressantes. Mais cela en fera-t-il l’outil de contrôle thermique du futur ?

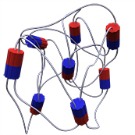

Le matériau céramique inspiré de la nacre

La résistance ne fait pas partie des avantages naturels des céramiques. Aussi il est fréquent de leur adjoindre des matériaux plus tenaces, d’origine métallique ou polymère, pour les renforcer. Malheureusement ce système à ses limites. C’est pourquoi une équipe de chercheurs français s’est inspiré du revêtement intérieur des ormeaux, composé à 95% de carbonate (l’aragonite), pour créer un matériau dix fois plus solide qu’une céramique, qu’elle ait été réalisée traditionnellement ou d’après une méthode plus sophistiquée.

Parue dans la revue Nature Materials, une étude réalisée par les équipes du Laboratoire de synthèse et fonctionnalisation des céramiques (CNRS/Saint Gobain) en collaboration avec le Laboratoire de géologie de Lyon : Terre, planètes et environnement (CNRS/ENS de Lyon/Université Claude Bernard Lyon 1) et le Laboratoire Matériaux : ingénierie et science (CNRS/INSA Lyon Université Claude Bernard Lyon 1) montre en effet comment ils s’y sont pris pour obtenir ce résultat.

Les chercheurs ont mis de l’alumine, une poudre céramique, en suspension dans de l’eau puis l’ont « congelé » progressivement jusqu’à obtenir des cristaux de glace. Cela a entraîné un auto-assemblage de l’alumine sous forme d’un empilement de plaquettes. En phase finale, le matériau a été densifié à haute température.

Voilà, il « suffisait » finalement d’inclure une étape de congélation dans le processus de création pour obtenir une céramique dix fois plus tenace que la moyenne. En bonus, cette méthode est applicable à d’autres poudres céramiques et son industrialisation ne semble pas poser de problèmes.

Des matériaux hydrophobe à l’effet lotus

Les feuilles de lotus ont la particularité de ne pas retenir les gouttes d’eau qui glissent sur leur surface. Des chercheurs de l’Institut de recherche et d’ingénierie des matériaux de Singapour se sont inspirés de cette capacité pour créer un matériau capable de faire la même chose avec de l’huile.

Il leur a fallu reproduire la surface de la feuille de lotus, faîte de micro-ruguosités, pour obtenir un revêtement superhydrophobe.

L’idée est de produire un matériau qui résiste à la pollution ou plutôt qui serait autonettoyant. Dans le cas d’un pare-brise par exemple, le passage de la pluie entraînerait les particules sales grâce à l’effet lotus. Cette faculté d’auto-nettoyage des surfaces hydrophobes a été observée dans les années 1970 bien que les premières utilisations dans le champ biomimétique n’aient eu lieu que vingt ans plus tard. Aujourd’hui, ces recherches intéressent toujours les industriels qui tentent toujours de découvrir de nouveaux matériaux aptes à rester propres.

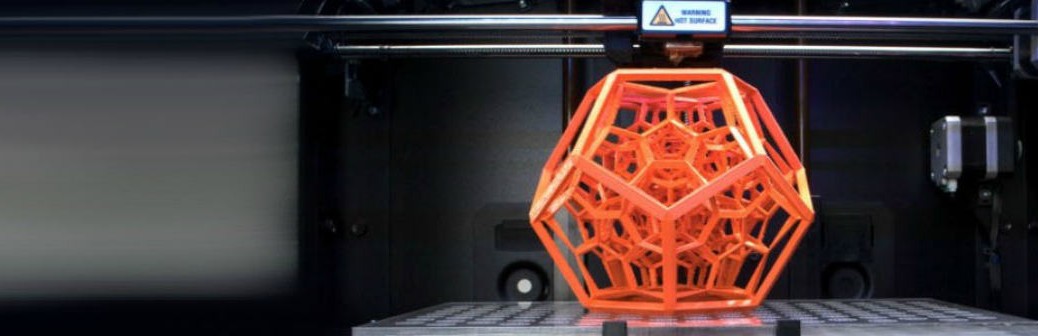

Light Cocoon, la voiture bio-imprimée en 3D et bio-inspirée

Conçu par la firme allemande EDAG, ce nouveau bijou de technologie s’inspire ici, aussi surprenant que cela puisse paraître, d’un squelette recouvert de peau. Le prototype baptisé Cocoon reprend la structure de l’édition précédente « Genesis » présentée au salon de Genève. Il s’agissait d’un squelette « bionic body structure » imprimé en 3D mais dépourvu de « peau ». Or, c’est précisément à ce niveau que se distingue Light Cocoon puisque le châssis 3D est ici recouvert d’une fine membrane textile imperméable qui le protège des intempéries.

EDAG s’est adjoint les services de Jack Wolfskin, marque allemande de vêtements d’extérieur, pour fabriquer ce matériau ultra-léger et résistant surnommé « Texapore SoftShell 02+ » que l’on pourrait comparer à un K-Way. Environ 25% du poids normal d’une voiture de cet acabit pourrait être économisé de cette manière. En outre, le tissu laisse la lumière le transpercer, ce qui permet de voir la structure, y compris la nuit avec les leds internes et confère à la Light Cocoon un design forcément original. Ce nouveau concept sera dévoilé au prochain salon de Genève en mars.

Par Sébastien tribot

Et aussi dans les

ressources documentaires :