La France s’enlise depuis deux ans dans les méandres politiques de la fameuse « transition énergétique » à horizon 2025. Et le champion du nucléaire AREVA pourrait annoncer plus de 3 milliards de pertes en 2014 en bonne partie à cause de l’EPR Finlandais. Pendant ce temps là, à Dubaï, au bord du Golfe Persique, un contrat portant sur une centrale photovoltaïque (PV) de 200 MW a été signé entre le Saoudien ACWA Power et la DEWA (Dubai Electricity and Water Authority) sur la base d’un prix de 5,84 US cents le kWh (5,2 c€/kWh). Soit 30% de moins que le prix de l’électricité obtenue à partir du gaz naturel dans ce pays.

D’autres contrats solaires PV aux USA (au Texas), en Afrique du sud, en Chine, en Inde (Andhra Pradesh) et au Brésil ont été signés récemment à des prix inférieurs à 8 cents le kWh. Ceci sans aucune subvention.

Il était objectivement coûteux il y a encore 5 ans, mais aujourd’hui le solaire PV est devenu très bon marché. L’important effort financier consenti par des pays comme l’Allemagne a permis la création d’un marché mondial, de stimuler en particulier l’industrie Asiatique, et ainsi de faire baisser massivement les coûts.

Un sérieux problème demeure: le solaire photovoltaïque ne produit de l’électricité que quand il fait jour. Avec le solaire CSP (Concentrated Solar Power), atout majeur, la chaleur obtenue par concentration de l’énergie solaire est stockable dans des cuves dédiées remplies de sels fondus et qui fonctionnent comme de gros thermos à café. La production électrique peut ainsi être différée. L’électricité solaire devient alors disponible en soirée ou durant la nuit si nécessaire.

Mais le CSP est deux à trois fois plus coûteux que le PV : le prix le plus bas du monde pour cette technologie, 12,4 cents par kWh, a été retenu début janvier 2015 dans le cadre d’un contrat entre le South Africa Department of Energy et le consortium ACWA-SolarReserve à propos du projet Redstone, centrale thermosolaire de 100 MW et qui permet 12 heures de stockage. Au Maroc, pour le projet Noor Ouarzazate, le prix a été fixé autour de 15 cents.

La symbiose PV + CSP, clé de la compétitivité du solaire face aux énergies sales

Bénéficier à la fois des avantages du solaire PV et CSP, c’est possible. Un système moitié PV moitié CSP permet théoriquement d’obtenir un kWh moyen coûtant entre 9 et 11 cents et disponible 24H/24. L’électricité PV est consommée en direct durant la journée tandis que l’électricité CSP est délivrée quand la production PV devient insuffisante ou nulle (durant la nuit). Le PV fait baisser les coûts et le CSP permet le stockage. Cette approche synergique est notamment encouragée par les experts de la division EnR de l’Agence Internationale de l’Energie. « Nous cherchons à intégrer solaire PV et CSP » a déclaré Paddy Padmanathan, PDG d’ACWA Power, lors du World Future Energy Summit qui a eu lieu à Abu Dhabi du 18 au 21 janvier 2015.

A présent l’espagnol Abengoa et le Californien SolarReserve associent également PV et CSP dans leurs projets. A l’occasion de la conférence INDIASOL 2014 qui a eu lieu les 8 et 9 octobre 2014 à New Delhi, Jose Manuel Millan Parellada, responsable du Développement du Business chez SolarReserve, a présenté l’intérêt de combiner PV et CSP pour offrir de l’électricité à la fois bon marché et disponible 24H24, y compris dans le cadre d’une approche OffGrid qui intéresse notamment l’industrie minière. En Afrique du sud la centrale CSP Redstone sera construite juste à côté des centrales photovoltaïques Lesendi (75 MW) et Jasper (96MW). SolarReserve a également monté un projet CSP-PV dans le nord du Chili pour fournir de l’électricité à une compagnie minière. Les mines sont bien souvent éloignées des réseaux électriques et consomment beaucoup d’énergie, d’où l’intérêt des solutions à base de ressources renouvelables disponibles en abondance localement. Selon Kevin Smith, PDG de SolarReserve, « nous avons configuré une centrale hybride CSP-PV avec 100 MW de CSP, 14 heures de stockages à base de sels fondus, et 75 MW de PV. Cette configuration est vraiment un générateur d’électricité en base (baseload generator), il délivre 100 MW ou davantage pour environ 90% des heures de l’année. L’aspect « renouvelable » de ce projet n’est pas important pour notre client, tout est basé sur les aspects économiques ». Pour les 10% d’heures où la production solaire est inférieure à 100 MW, comme le rappelle Jose Manuel Millan Parellada, un appoint à base de combustibles fossiles ou biomasse (par exemple du biodiesel) est possible pour faire fonctionner la turbine à vapeur de la centrale CSP. Depuis mars 2014 SolarReserve a commencé des négociations « avec des mines de fer, de cuivre, d’or, d’argent et d’uranium en Australie, au Chili, au Mexique, en Afrique du sud, en Arabie Saoudite et aux USA » a indiqué Kevin Smith au média Canadien spécialisé EnergyAndMines. Quant les industries minières produisent leur propre électricité à partir de générateurs diesel isolés, le coût du kWh est d’environ 30 cents.

De son côté Abengoa construit actuellement au Chili deux centrales CSP de 110 MW avec une capacité de 24 heures de stockage, en association avec une centrale photovoltaïque de 100 MW (projets Atacama 1 et 2). Le tout pour un prix de 11,5 cents le kWh. Dans cette région du nord du Chili le prix moyen de l’électricité sur le marché spot, principalement à base de charbon et de gaz, est de 15 cents. Le solaire est donc très compétitif.

Selon la cour des comptes le coût de production du kWh nucléaire historique Français déjà amorti est de 5,98 c€ (6,75 cents), un coût qui ne fait que monter année après année. En Grande-Bretagne, le tarif d’achat du MWh de la centrale nucléaire EPR Hinkley Point C a été fixé à £92.5 (14,1 cents le kWh), ce qui est bien supérieur au prix du kWh solaire PV qui a été fixé à Dubaï a osé remarquer Mark Lewis, expert de Kepler Chevreux, dans le cadre d’une interview pour RenewEconomy, média Australien spécialisé. L’Egypte vient de signer le 10 février 2015 un accord préliminaire avec la Russie pour la construction de la première centrale nucléaire du pays. Ceci alors que l’Egypte jouit d’une insolation solaire équivalente à celle des Emirats. Poutine a offert à son homologue Egyptien Al-Sissi une Kalachnikov AK-47 à l’occasion de cette signature, rappelant ainsi le lien fort entre nucléaire civil et nucléaire militaire. Le programme nucléaire iranien est par exemple un programme présenté comme civil mais à finalité également militaire. Le programme nucléaire civil Français s’inscrit lui-même dans la continuité d’un programme nucléaire militaire initié suite à la seconde guerre mondiale.

Selon ACWA Power le coût du kWh solaire PV va tomber à 4 cents d’ici quelques années, et celui du CSP à 9 cents. Autrement dit le coût moyen du système symbiotique CSP-PV sera de 6,5 cents, et ainsi proche de celui du nucléaire historique en France. Et deux fois inférieur à celui du nucléaire EPR. ACWA Power a d’ailleurs proposé à Dubaï un tarif de 5,4 cents le kWh (au lieu de 5,84 cents) dans l’hypothèse d’un élargissement du projet à 1000 MW de PV au lieu des 200 MW du contrat de référence.

Une troisième technologie, le CPV (Concentrated PhotoVoltaics), pourrait devenir aussi bon marché que le PV d’ici 2025-2030 selon une étude récente de l’institut Fraunhofer. Elle est aujourd’hui environ 50% plus coûteuse. Son intérêt est de réduire considérablement la quantité de cellules photovoltaïques nécessaires grâce à un système de miroirs concentrateurs. Ces cellules doivent cependant être adaptées à des températures élevées. Le CPV a permis d’atteindre une efficacité énergétique de 46% (cellule), record mondial. Dans les années qui viennent, il est fort probable qu’émergent des projets hybrides CSP-CPV.

L’électricité produite dans les régions fortement ensoleillées de la planète peut être exportée par câble HVDC vers les régions à forte demande électrique.

Thermique, gravitaire ou électro-chimique : il y a pléthore de solutions de stockage

Durant les longues périodes nuageuses les turbines des centrales CSP peuvent être alimentées par de la vapeur obtenue en brûlant des combustibles fossiles ou de la biomasse, ce qui garanti une production continue, indépendamment de la météo, et également une température optimale au niveau de l’efficacité de la conversion électrique. « Termosolar Borges » est la première centrale électrique du monde à avoir couplé solaire et biomasse. Elle est entrée en fonctionnement en décembre 2012 à Lleida en Catalogne et a une puissance de 22,5 MW. En Inde le CSTEP (Center for Study of Science, Technology and Policy) a annoncé fin 2014 la construction dans un village de l’état de Bihar, à la frontière du Népal, d’une centrale du même type, baptisée « SCOPEBI », et d’une puissance de 3 MW.

Dans le futur la baisse du coût des batteries lithium, notamment grâce au développement de la mobilité électrique, permettra probablement aux centrales PV de se passer de leur association avec les centrales CSP à stockage thermique et des contraintes inhérentes à cette technologie: il faut notamment un ciel très propre pour que l’insolation directe puisse être réfléchie avec précision par les miroirs, contrairement au PV qui fonctionne tout autant avec l’insolation directe qu’indirecte. A Hawaï et en Australie, comme le souligne le Rocky Mountain Institute d’Amory Lovins, le solaire PV + stockage est dès aujourd’hui compétitif avec l’électricité du réseau. Les avis des experts (BNEF, Navigant, AIE etc.) divergent concernant la cinétique de la baisse du coût des batteries dans les 5 à 10 ans à venir. La GigaFactory de Tesla actuellement en construction dans le Nevada commencera à délivrer des batteries dès 2016. Les super-condensateurs, y compris à base de graphène, n’ont d’ailleurs pas dit leur dernier mot.

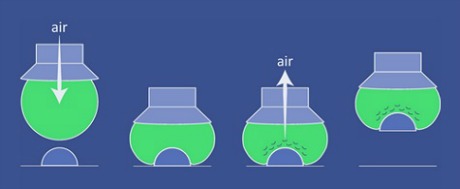

Une autre approche est actuellement en cours au Chili : coupler une centrale PV de 600 MW à une STEP à eau de mer de 300 MW. Il s’agit de stockage gravitaire, l’eau de mer est pompée vers un bassin perché en altitude quand l’électricité solaire est abondante, et est redirigée vers la mer dans le cas inverse, ce qui permet de produire de l’électricité comme avec les centrales hydroélectriques classiques. Sur l’île d’El Hierro (Canaries), c’est un parc éolien qui a été couplé à une STEP. L’efficacité d’un cycle de pompage-turbinage est de l’ordre de 80%, ce qui est très bon. Le coût du kWh global obtenu, annoncé par l’entreprise Chilienne Valhalla Energy à 10 cents, est cohérent avec les analyses des experts du stockage gravitaire et du solaire PV.

Le disque terrestre intercepte une puissance solaire de 175 millions de GW. Soit l’équivalent de celle délivrée par 106 millions de réacteurs EPR de 1650 MW pièce. Et 2,7 millions de fois la puissance électro-nucléaire totale installée en France (63,5 GW), le second pays le plus peuplé de l’Union Européenne. Puisse Râ, dieu du Soleil dessiné dans toutes les pyramides d’Egypte, illuminer l’esprit du président Al-Sissi.

Olivier Daniélo

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)

.jpg)