En 2050, l’humanité a atteint un niveau de développement ou tout le monde a accès à l’eau, en quantité suffisante. La qualité et la durabilité de l’eau sont également assurées, outils nécessaires à un développement serein des populations.

La population, elle, est protégée de la pollution et des maladies d’origine hydrique ainsi que des catastrophes liées à l’eau. La question de l’accès à l’eau n’est plus une problématique réservée au genre féminin. De ce côté-là aussi, l’accès à l’eau facilité l’inclusion sociale des femmes dans de nombreuses régions du monde.

Il y a moins de guerres. Les écosystèmes s’en trouvent mieux protégés et les économies locales et nationales sont plus robustes, sachant que les risques liés à la disponibilité des ressources en eau ont été pris en compte dans la planification à long terme pour la réduction de la pauvreté et le développement économique.

L’attitude et les normes ont changé suite à un travail éducatif de fond et aux évolutions engagées par nos institutions ; l’avènement des progrès scientifiques et techniques et les leçons tirées des erreurs passées sont l’illustration des nouveaux rapports de l’homme à l’eau.

L’accès à l’eau, l’assainissement et l’hygiène ont été rendus possibles à une si large échelle par le déploiement massif d’infrastructures hydrauliques en milieu urbain. Mais ce n’est pas tout. La technologie de purification de l’eau à petite échelle – décentralisée – dans les régions éloignées, a permis d’améliorer de façon évidente les conditions de santé et donc les conditions de vie en général.

Les innovations technologiques jouent une part prépondérante dans ce changement de paradigme : elles ont permis de réduire les consommations d’eau sur des postes très gourmands : par exemple en permettant la mise en place de circuits d’assainissement « sans eau », qui permettent de fournir de l’énergie et des produits divers à partir d’excréments humains, tout en éliminant la pollution de l’eau douce.

L’homme a réussi à bâtir un équilibre entre les eaux extraites du sous-sol et celles y retournant – milieux aquifères, écosystèmes aquatiques – assurant leur stabilité dans le temps.

Les eaux usées provenant des activités humaines sont toutes traitées pour être au maximum réutilisées et recyclées. Les circuits de traitement de l’eau assure une réutilisation et un relargage dans l’environnement des eaux traitées qui permet un dimensionnement des cycles suffisant pour une consommation raisonnée et pérenne.

La demande en eau par habitant et par unité de productivité est nettement inférieure à ce qu’elle était en 2015, dans les secteurs industriels, énergétiques et agricoles, permettant à la « ressource eau » d’être partagée plus équitablement.

La réduction de la concurrence entre les principaux consommateurs d’eau a également contribué à accroître leur performance économique à long terme, et de réguler leurs usages.

Les usages liés à l’eau dans l’agriculture se sont répandus à travers le monde : Que ce soit en agriculture pluviale, irriguée, les méthodes les plus innovantes sont désormais maîtrisées au sens large.

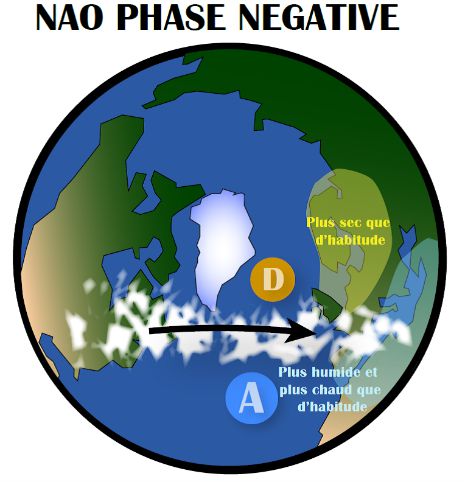

En fait, l’agriculture dans son ensemble est moins vulnérable à la variabilité des précipitations en raison de l’adoption généralisée de l’agro-technologie de pointe, des techniques d’irrigation très efficaces, d’une faible réutilisation des eaux usées, et d’un art avancé de la conservation des sols et des eaux.

La demande en eau pour les usages domestiques de tous les jours est atteinte grâce à l’utilisation de technologies efficaces et équitables, les tarifs adéquats sont en place.

Les techniques de production d’énergie adoptées sont majoritairement très économes en eau, et l’avènement des énergies renouvelables, très économiques à ce niveau-là, est très cohérent avec l’objectif final en matière d’accès à l’eau. Ainsi, la mise en place de centrale hydro-électriques en Afrique sub-saharienne et en Asie du sud-est, grâce à une efficacité améliorée et à la disponibilité en haut pérennisée, a permis d’apporter l’élect ricité à des millions de personnes qui n’en bénéficiaient pas.

Au niveau industriel, l’implémentation dans les process d’une politique de régulation des usages de l’eau, ajoutée aux progrès technologiques, permet d’économiser de plus en plus la consommation de l’eau pour l’industrie. Le développement des entreprises s’en trouve dopé.

La gestion environnementale basée sur la notion de résilience est largement adoptée à travers le monde. Les interventions de l’homme vont donc dans ce sens : protection des réserves en eau, des berges, des bassins versants, promotion des usages raisonnés de l’eau pour les agriculteurs et les acteurs de l’industrie. Et surveillance. Surveillance des consommations, et des impacts des usages sur l’environnement. A ce stade, nos sociétés ont réussi à casser le lien entre une croissance économique basée – entre autres – sur la consommation d’eau et la dégradation de l’environnement.

L’eau est devenue un facteur clé pour tous les secteurs qui l’utilisent comme une ressource. Cela peut être à travers le fonctionnement optimal des chaînes de production par exemple. Ce changement de paradigme a permis de développer un management de la demande en eau très précis.

Des mesures comme le stockage de l’eau de pluie et la réutilisation des eaux usées sont monnaie courante. Les marchés mondiaux et les flux commerciaux sont surveillés par un système de certification mondial de l’eau qui assure que les produits « gourmands » en eau sont exportés à partir de zones relativement peu ou pas exposées à un quelconque stress hydrique.

La valeur économique de l’eau a été reconnue et toutes les externalités – liées à la ressource eau – liées à la vie des entreprises sont désormais à sa charge et sous sa responsabilité juridique. Des mécanismes de régulation explicites, transparents et équitables sont en place pour répondre à la répartition de l’eau, la distribution, l’accès et la gestion…

Les ressources aquifères sont gérées de manière collaborative entre les multiples états impliqués, conduisant à une amélioration de la qualité de l’eau et de l’environnement en général, de fait, mais aussi des relations entre états par rebond. La capacité de ces derniers à collaborer pour améliorer l’usage d’une ressource commune en est la preuve !

Plus globalement, le rôle de l’eau dans les sous-tend tous les aspects du développement durable est devenu largement reconnu. Il est désormais universellement admis que l’eau est une ressource naturelle essentielle primaire sur lequel presque toutes les activités sociales et économiques et les fonctions des écosystèmes dépendent.

Cela n’a pas été facile.

Traduit par S.L

Source : ONU