Publication d’une étude trilatérale sur les centrales de pompage-turbinage en Allemagne, en Autriche et en Suisse

Le Ministère fédéral de l’économie et de l’énergie (BMWi) a publié, lundi 18 août 2014, une étude trilatérale sur les centrales de pompage-turbinage (ou STEP pour Stations de transfert d’énergie par pompage) en Allemagne, en Autriche et en Suisse [1].

Dans le cadre de cette étude, ont été analysés les aspects juridiques et économiques des centrales de pompage-turbinage dans les trois pays, ainsi que de futures possibilités de développement. Les experts ont conclu que l’importance à long terme des centrales de pompage-turbinage augmentera avec la part croissante des énergies renouvelables, et qu’elle doit être considérée en lien étroit avec le développement du réseau électrique.

L’étude publiée a été initiée sur la base de la « Déclaration de l’Allemagne, de l’Autriche et de la Suisse à propos d’initiatives conjointes pour le développement de centrales de pompage-turbinage », publiée en avril 2012, et contribue à la coopération renforcée dans ce domaine.

Le cadre juridique du pompage-turbinage a été examiné dans les trois pays, à la demande du BMWi, par le cabinet d’avocats Görg mbB. Le point de vue économique a été étudié par un expert des politiques économiques et d’infrastructure de l’Université technique de Berlin, à la demande de l’Office fédéral suisse de l’énergie. Enfin, l’Institut d’installations électriques et d’économie de l’énergie de l’Université technique RWTH d’Aix-la-Chapelle (Rhénanie du Nord-Westphalie) a mené une étude sur les contributions des stations de pompage-turbinage pour l’approvisionnement en énergie, pour le compte du Ministère fédéral autrichien de la science, de la recherche et de l’économie. En outre, à la demande de l’Office fédéral suisse de l’énergie, un rapport de synthèse a été réalisé par l’Energy Science Center de l’ETH de Zurich

Les exploits scientifiques russes de l’ère post-soviétique

Début juillet, l’agence Thomson Reuteurs a publié la liste des scientifiques les plus influents du monde de l’année 2014. Parmi ces héros d’aujourd’hui figurent huit. Les réalisations scientifiques russes des dernières années sont souvent peu connues, alors que certaines sont d’importance capitale. Voici 5 travaux, arbitrairement retenus mais très souvent cités par la communauté scientifique russe, qui illustrent les succès de la recherche post-soviétique.

En premier lieu, on relèvera les travaux des physiciens du laboratoire Flerov de l’Institut unifié de recherches nucléaires de Dubna, centre scientifique international située dans la banlieue moscovite, qui ont été les premiers à synthétiser les six éléments les plus lourds connus à ce jour et portant les numéros atomiques allant de 113 à 118. Pour l’instant seuls les flérovium (114)( Fl) et livermorium (116)(Lv) ont été reconnus par l’Union internationale de chimie pure et appliquée (UICPA). Leurs propriétés étonnantes permettent de spéculer sur la création de nouveaux types d’écrans souples, de batteries ou mêmes des vêtements.

En 2006, les physiciens de l’Institut de physique appliquée (IPA) de l’Académie russe des sciences de Russie à Nijni Novgorod ont créé le système PEARL (PEtawatt pARametric Laser). Ce laser, basé sur la technologie d’amplification paramétrique de la lumière dans les cristaux optiques non-linéaires, a été un temps, le laser existant le plus puissant avec une puissance de 0,56 petawatt. Ce laser permis à des chercheurs d’étudier des processus physiques extrêmes et des techniques de traitements des tumeurs cancéreuses.

Dans les années 90, les physiciens du Centre atomique russe à Sarov dirigée par Alexandre Pavlovsky ont réussi, grâce aux générateurs magnéto-cumulatifs à explosifs, à atteindre un champ magnétique de 28 megagauss. Ce méga-aimant donné lieu à de nombreuses études sur le comportement des supraconducteurs, qui jouent un role crucial dans la physique moderne (canon magnétique, accélérateur de particules…).

Dans le domaine des géosciences, les chercheurs de l’université russe d’Etat de pétrole et de gaz Goubkine ont invalidé la théorie selon laquelle pétrole et le gaz ne peuvent être produits que par décomposition de matières organiques. En effet, sous la croûte terrestre, à 100-150km de profondeur, selon Vladimir Koutcherov, professeur à l’Académie de technologie chimique fine de Moscou, la synthèse d’hydrocarbure lourd est possible. Selon le professeur Koutcherov, « une technologie de synthèse artificielle de pétrole permettrait de résoudre de nombreux problèmes économiques et écologiques ».

Enfin, En 2002, le mathématicien russe Grigori Perelman a démontré la conjecture de Poincaré, l’un des sept « problèmes du millénaire » recensés par l’Institut de mathématiques Clay. Cette conjecture, formulée pour la première fois par le mathématicien français Henri Poincaré en 1904, et s’énonce comme suit : « Soit une variété compacte V simplement connexe, à 3 dimensions, sans bord. Alors V est homéomorphe à une hypersphère de dimension 3. » Parmi les travaux présentés, ceux de Grigori Perelman ont été d’avantage médiatisés, moins par l’aboutissement d’un effort scientifique collectif sur près d’un siècle que par son double refus d’une part du prix de un million de dollars américains que Clay s’était engagé à remettre pour la résolution de ce problème, d’autre part de la médaille Fields.

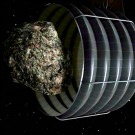

Un ballon d’hélium pour l’étude du sous-sol

Le 17 juillet 2014, l’Institut fédéral des géosciences et des ressources naturelles [1] a testé un système mobile et semi-aérien pour la réalisation de mesures géophysiques du sous-sol.

L’innovation pour ces mesures électromagnétiques réside dans l’utilisation d’un ballon d’hélium. Ce ballon, un boudin de 1 m de diamètre enroulé en forme d’anneau de 20m de diamètre, est équipé de bobines qui jouent le rôle d’émetteurs/récepteurs. Le dispositif permet ainsi l’étude du sous-sol géologique à des profondeurs de plusieurs centaines de mètres.

Le ballon est tracté par un véhicule et arrimé à un second afin de maintenir une direction rectiligne (voir la démonstration en vidéo proposée ci-dessus). L’avantage conféré par la mobilité est de pouvoir réaliser jusqu’à vingt fois plus de relevés du sous-sol qu’avec les dispositifs conventionnels.

Les premiers essais se sont déroulés à Döberitzer Heide, une zone d’entraînement militaire de la Bundeswehr dans le Brandebourg. Ces essais ayant été concluants, le BGR envisage une utilisation sur le terrain, en particulier pour l’exploration des eaux souterraines dans les pays en développement.

.jpg)