Véritable cerveau stratège portant le projet d’autonomie énergétique de la communauté de Communes du Mené au nord de la Bretagne, Marc Théry (ci-dessous) explique aux Techniques de l’ingénieur les lourdes difficultés qui pèsent en France quand une collectivité veut mettre le cap vers l’autosuffisance énergétique.

Techniques de l’Ingénieur : Comment est né le projet d’autonomie énergétique de la communauté de commune du Mené, et quelles étaient les motivations initiales ?

Marc Théry : Ce projet du Mené est le résultat d’un processus. Le point de départ c’était un souci économique. Ce territoire repose essentiellement sur l’agroalimentaire, un secteur, en Bretagne et à l’échelle de la France, de plus en plus difficile. Notamment l’élevage qui est assez en danger. Donc comme le Mené est un pays assez pauvre, les gens ont senti très tôt qu’il y avait un problème, et ils se sont demandé ce qu’ils pourraient faire pour améliorer la situation. On a ainsi lancé une étude qui a été faite en partie par Solagro et qui a assez vite aboutit a la conclusion qu’il y avait peut-être quelque chose à faire dans le domaine de l’énergie.

Techniques de l’Ingénieur : Vous êtes vous inspirés d’expériences menées dans d’autres pays que la France ?

Marc Théry : Le point de départ déclencheur a été une visite de trois jours en 2005 à Gussing, un territoire autonome en Autriche (En savoir plus). On devait visiter des territoires, des choses qui se faisaient ailleurs, cela fait partie de la culture ici, les gens travaillent en allant voir. J’avais des contacts à Gussing, et ce territoire était déjà organisé pour le tourisme éco-énergétique. On a vu un territoire qui était exactement dans la même situation que nous, c’est-à-dire un territoire tout à fait enclavé au fin fond de l’Autriche sans voies de communication. Isolé et en train de dépérir. Les gens ont dit que cela ne pouvait pas durer, qu’il fallait cesser d’importer les matières énergétiques et exploiter les ressources présentes sur le territoire. Et c’est ce qu’ils ont fait.

Quand nous y sommes allés, ils étaient dans la quinzième année de leur processus et étaient déjà autosuffisants dans certains domaines, comme par exemple les carburants (8 millions de litres par an). Et ils avaient créé 1200 emplois sur un territoire de 28000 habitants, ce qui est un niveau considérable. Les gens du Mené sont rentrés très motivés, d’ailleurs toutes les visites que j’ai organisées ont été profitables de ce point de vue. La visite de Gussing a été comme un coup de marteau qui est tombé sur la tête des gens, une prise de conscience immédiate, un déclic que c’était vraiment une piste extrêmement prometteuse, et qu’aucun des territoires comme le notre, territoires ruraux, ne pouvait passer à côté. C’était une évidence.

Mais malheureusement il est extrêmement difficile d’emmener des élus français voir des choses intéressants à l’étranger. C’est même quasiment impossible, je le dit franchement. Avec les élus du Mené, c’est un cas particulier. On avait un président de communauté de communes intelligent et entreprenant. J’ai proposé d’organiser des visites à des dizaines de collectivités, mais ils ne veulent pas y aller. On est obligé de tout leur apporter sur un plateau et encore ils disent « oui bon… ». Il manque un état d’esprit d’ouverture aux expériences extra-françaises et une volonté d’entreprendre, c’est à mon avis la chose la plus inexistante en France.

Dès que nous sommes rentrés de Gussing, les grandes lignes ont été tracées. La démarche a été balisée en 10 macro-projets, qui étaient pour l’essentiel d’exploiter les filières d’énergie renouvelable qui étaient à notre disposition, l’éolien terrestre, le bois-énergie, la biomasse-méthanisation, la biomasse-carburant. Pas le solaire à cette époque, car ce n’était pas frappant. Depuis nous avons évolué concernant le solaire. Il y a avait aussi les économies d’énergie, et enfin toute la partie animation économique et la création d’un centre de compétences. Le premier projet a été une huilerie. Voir les gens de Gussing rouler avec le carburant local (huile de colza et huiles recyclées) a été déterminant pour les élus du Mené.

Techniques de l’Ingénieur : Y a-t-il d’autres expériences que Gussing qui vous ont inspiré ?

Marc Théry : L’inspiration vient de nombreux endroits. Je suis en relation avec plusieurs territoires. Il y a, dans la région de Mecklenburg- Vorpommern, le district de Lübow-Krassow, un territoire historique au nord de l’Allemagne qui a démarré très tôt dans le domaine des énergies vertes. Brigitte et Ditmar Schmidt (Solarinitiative Mecklenburg-Vorpommern e.V. En savoir plus), deux ingénieurs, ont fait des choses vraiment superbes.

Nous avons également de nombreux contacts en basse-Bavière, notamment à Straubing, sur le Danube. Il y a un centre de compétence allemand tout à fait remarquable avec des chercheurs fondamentaux, des universitaires, et aussi un centre de recherche appliqué, qui s’appelle TFZ Straubing (En savoir plus). Ils font des choses fabuleuses notamment dans le domaine du bois-énergie, des chaudières, des combustions et surtout des huiles-carburant. C’est un creuset de référence où sont faites de nombreuses recherches dans ce domaine. Il y a aussi, à Straubing, le SonnenHaus Institute, l’institut des maisons solaires, une structure tout à fait remarquable également, qui nous a beaucoup inspiré pour les maisons zéro énergie et qui fait des choses vraiment impressionnantes.

Toutes ces initiatives allemandes nous inspirent et permettent aussi d’entretenir la flamme, car il n’est pas facile de tenir ce genre de projet dans le contexte franco-français. Tous les ans, je suis invité au congrès annuel à Lübow-Krassow, cela me permet de rencontrer d’autres acteurs, comme par exemple les chercheurs de l’université de Kassel. Cela fait vraiment du bien de rencontrer ces personnes.

Techniques de l’Ingénieur : Et Freiburg-im-Breisgau dans le Bade-Wurtemberg, avec son célèbre quartier Vauban ?

Marc Théry : Freiburg, c’est un contexte urbain, les enjeux sont différents. Le Mené est un territoire rural. Nous avons organisé des visites correspondant exactement aux besoins de notre territoire. Il y a bien entendu des idées très intéressantes mais ce ne sont pas les mêmes problématiques et les mêmes profils socio-économiques. La ville de Saint-Brieuc, près du Mené, s’y intéresse.

Techniques de l’Ingénieur : Y-a-t-il aussi des projets en France qui vous paraissent pertinents et qui vous inspirent ?

Marc Théry : Aujourd’hui, il y a une expérience qui me parait mieux amorcée que celle de la communauté de commune du Mené, c’est celle de la commune de Montdidier dans la Somme. Dans le Mené, nous nous nous heurtons au plafond de verre du carcan administratif et organisationnel hypercentralisé français. A Montdidier, ils ont plus de chance, ils ont une structure juridique adaptée. Ils ont conservé la Régie de distribution électrique municipale, et c’est le point clé.

Techniques de l’Ingénieur : Serait-il possible de créer aussi une régie chez vous au Mené ?

Marc Théry : Ce n’est plus possible, semble-t-il. La Loi de 1946, dans son interprétation par les hommes de loi, y est complètement opposée. Il y a aussi une autre régie du même type dans le département de la Vienne.

Techniques de l’Ingénieur : Quelles sont les filières renouvelables qui ont progressé au Mené ?

Marc Théry : Tout a bien progressé. Il faudrait faire un bilan fin, rien n’est complètement achevé. Il faut comparer par rapport aux ressources et par rapports aux besoins. Pour l’électricité, ce qui est gênant en France, c’est que l’on n’est pas vraiment dans une logique d’autonomie. Nous sommes au contraire, dans le modèle français, dans une logique « tu verses tout dans le grand pot et tu viens ensuite y puiser », ce qui est antinomique avec la philosophie de l’autonomie.

Techniques de l’Ingénieur : Le cadre réglementaire français n’est donc pas adapté aux projets d’autonomisation énergétique des territoires ?

Marc Théry : Complètement. C’est le plafond de verre. Au Mené, on a une production d’environ 30 GWh électrique par an. Tout ça part par le biais des systèmes de tarifs préférentiel chez EDF et cela ne s’inscrit pas dans une dynamique d’autonomisation.

Techniques de l’Ingénieur : Pensez-vous que ce cadre réglementaire puisse évoluer favorablement en France, notamment avec la transition énergétique affichée par François Hollande ? Un office franco-allemand des énergies renouvelables a par exemple été créé, et une réflexion sur la décentralisation est cours, pensez-vous que cela puisse faire bouger les choses ? Voyez-vous les premiers signes d’un progrès arriver ?

Marc Théry : Non, pas du tout, je ne vois pas ces premiers signes, au contraire. Je suis de ce côté-là très pessimiste. Tout se passe sous la coupe d’EDF. C’est antinomique avec la démarche d’autonomie, fondamentalement. Ce qui est en question ici ce n’est pas seulement de consommer localement l’électricité renouvelable produite localement. C’est toute la question du stockage et de l’équilibrage du réseau électrique.

Techniques de l’Ingénieur : Effectivement, une critique récurrente, concernant les énergies renouvelables, c’est leur nature fluctuante. Que répondez-vous à ces critiques ?

Marc Théry : Le 16 juin 2013, on s’est retrouvé avec un excès de production électrique en France, et comme l’a très bien montré Cédric Philibert de l’Agence Internationale de l’Energie, ce n’était pas du tout lié aux énergies renouvelables, contrairement à une dépêche de l’AFP reprise sans réflexion par de nombreux médias français. La question de l’équilibrage se pose en termes de flexibilité et peut se régler en stockage. J’ai, sur le Mené des projets qui permettraient d’équilibrer une capacité d’environ 30 MW éolien en puissance installée. Nous disposons de trois moyens pour réaliser l’équilibre.

Premièrement, l’électricité provenant de la biomasse, notamment la méthanisation (en cogénération), on peut l’utiliser comme moyen de lissage. Il faut dimensionner de manière intelligente la puissance de production et la capacité de stockage et il se pose la question du modèle financier. Ce sont deux choses qui n’ont pas encore été faites, nous avons déposé des projets pour obtenir des financements, mais les autorités nous ont répondu que l’autonomie énergétique, « cela n’a aucun intérêt ». Donc on le l’a pas fait dès le départ et après c’est plus difficile.

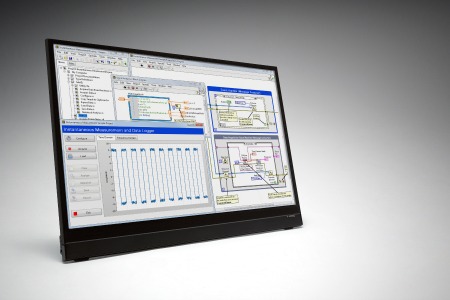

Deuxièmement la flexibilisation-modulation de la consommation, c’est toute la gestion smart grid, pas à la Linky, mais avec une gestion par effacement et anticipation de production et consommation. C’est un projet que nous avons en cours mais qui est complètement saboté parce que dans le contexte actuel ; c’est une voie qui n’est pas du tout favorisée par l’état. C’est catastrophique. Investir pour économiser est pourtant une approche très pertinente économiquement.

Techniques de l’Ingénieur : Il y a pourtant de grandes annonces gouvernementales concernant les économies d’énergie…

Marc Théry : Bien sûr. Mais concrètement, les acteurs sont confrontés à de vraies difficultés. Ce n’est pas une difficulté technique, mais de modèle économique. Tant qu’on restera dans la logique centralisée du grand pot, cela n’avancera pas. L’Allemagne, elle, a expérimenté d’autres modèles, il y a plusieurs expériences très concluantes.

Le troisième point, c’est le stockage, intégrant différentes technologies. En France, on bricole, rien n’est fait pour encourager le stockage, les modèles économiques ne sont pas adaptés. J’ai un projet de stockage de 10 MW, avec des temps de réponse adaptés, et permettant un stockage de court-terme, de quelques heures. Il s’agit d’un ensemble de technologies, c’est complexe, on intègre les problématiques de temps de réponse et de capacité de stockage.

Techniques de l’Ingénieur : Peut-on aussi miser sur l’interconnexion électrique des communes voisines, voir des régions voisines, tout en restant dans la logique de l’autonomie ?

Marc Théry : Oui, pour la communauté de communes du Mené, nous ne sommes pas dans une logique insulaire, on peut faire en effet beaucoup mieux. Nous ne sommes pas une île isolée, je ne suis pas dans cette logique d’absolu. Il serait tout à fait pertinent d’optimiser les échanges électriques entre territoires solidaires, avec toujours l’autonomie, relative, en perspective.

Un raisonnement régional permettrait sans doute des investissements communs, comme par exemple, en Bretagne, le projet de STEP de Guerlédan (700 MW), probablement plus judicieux que la multiplication de projets plus petits. Mais pour l’instant, c’est ni l’un, ni les autres. Les instances nationales et régionales préfèrent favoriser l’installation de centrales à turbine à gaz.

Techniques de l’Ingénieur : Vous resteriez alors face aux critiques de ceux qui estiment qu’une autonomie complète est impossible ?

Marc Théry : C’est une question de coût. L’autonomie complète est techniquement possible. Il n’est pas forcément pertinent d’installer d’énormes capacités de stockage qui ne serviront que quelques jours par an. 90% d’autonomie, c’est déjà très bien. Et l’électricité n’est qu’un volet de notre projet.

A des échelles plus petites, au niveau de maisons ou de bâtiments, il y a beaucoup à faire. Je pense d’ailleurs cesser de m’épuiser avec les collectivités pour privilégier à présent cet angle d’approche. Je travaille à présent beaucoup plus avec des particuliers, parce qu’il y a des gens qui sont beaucoup plus éco-conscients. Ces projets très locaux ne pourront qu’aider à l’atteinte des objectifs plus globaux. A titre d’exemple le danois Preben Maegaard, fondateur du Nordic Folkecenter, stocke le surplus d’électricité, surtout éolienne mais aussi solaire, en produisant de l’eau chaude par effet Joule. Je travaille à présent sur un projet où le surplus d’électricité éolienne et solaire sera stocké dans de l’eau chaude qui servira au chauffage. Le système de chauffage reposera sur un système de pompe à chaleur, on multiplie par quatre l’efficacité énergétique, d’où de précieuses économies. D’autres solutions sont aussi à l’étude.

Au Danemark, et aussi dans le Mecklenburg au nord de l’Allemagne, le solaire photovoltaïque est très important non pas pour l’électricité totale produite mais pour diversifier le mix électrique et avoir un certain lissage, éolien et solaire étant complémentaires. Au Danemark comme en Bretagne, en général quand il y a du vent il y a des nuages et donc pas ou peu de soleil. Et au contraire quand il n’y a plus de vent on a des chances d’avoir du soleil. Cette complémentarité n’est pas forcément vraie dans d’autres régions, comme par exemple en Provence où le vent souffle quand il y a du soleil. C’est à étudier en fonction du contexte local. A la communauté de Communes du Mené, nous développons le photovoltaïque dans la même finalité qu’au Danemark. Mais le cadre réglementaire français n’est pas adapté pour développer le solaire PV dans le nord de la France en tant qu’énergie complémentaire à l’éolien. Ce cadre est pensé à l’échelle nationale mais devient non pertinent à l’échelle locale dans une perspective de mix électrique équilibré. Depuis 2010, il n’y a presque aucun projet photovoltaïque au-dessus de 100 kWau nord de la Loire. On en revient au problème de fond, la logique centralisatrice.

Techniques de l’Ingénieur : en matière d’économies d’énergie, où en êtes-vous au Mené ?

Marc Théry : Dans le Mené, l’objectif c’est 2/3 de renouvelables et 1/3 d’économies d’énergie. Les économies se font au niveau de nos applications professionnelles et industrielles. Nous avons un très gros industriel qui est un abattoir, dont la consommation représente plus du tiers de la consommation du territoire. L’abattoir a un intérêt économique évident à réduire ses consommations énergétiques.

Les deux autres domaines d’économie sont le transport et l’habitat où nous visons une réduction de 40% de la consommation énergétique. Dans le domaine du transport, l’abattoir offre également de belles perspectives d’économies. Nous étudions la possibilité de passer en multimodal, c’est-à-dire d’abandonner son véhicule thermique à l’arrivée et d’effectuer les déplacements locaux en véhicule électrique, mais aussi de réduire les besoins de transport et de favoriser le covoiturage.

Techniques de l’Ingénieur : Et le vélo ?

Marc Théry : Malheureusement, chez nous, vélo, rollers, skateboard, trottinette et marche à pied sont difficiles car les routes sont dangereuses du fait du passage de camions. Il nous faudra à l’avenir favoriser ces transports doux, même si notre relief n’est pas plat et donc pas forcément adapté. Le problème principal reste la voirie non adaptée. L’habitat étant dispersé, les transports en commun ne sont pas développés.

Techniques de l’Ingénieur : Vous avez fait parti des pionniers du projet du Mené ?

Marc Théry : Au départ, j’étais intervenu en 2003 – 2004 pour expliquer aux élus du Mené que les parcs éoliens étaient extrêmement rentables, et qu’ils auraient bien tort de les laisser aux investisseurs financiers privés. J’avais déjà monté un parc éolien avec des membres de ma famille dans le Pas-de-calais et je savais que cela pouvait rapporter beaucoup, il y avait un retour sur investissement de 25% par an. Donc j’ai expliqué cela aux élus, j’avais soumissionné pour réaliser l’étude qui a été menée au final par Solagro, mais les élus ont considéré qu’il valait mieux que je me positionne de leur côté. Je suis à présent responsable du volet technique et j’effectue surtout les élaborations stratégiques, qui sont ensuite acceptées ou pas par les élus.

Techniques de l’Ingénieur : Un mot de conclusion ?

Marc Théry : Oui. En France, nous est complètement à côté de la plaque. Cela a été en fil rouge tout au long de notre échange. Tout se fait depuis Paris avec des idées loufoques qui favorisent les grosses boîteset qui stérilisent les ressources nécessaires aux projets locaux.

France et Allemagne (fédérale) n’ont pas du tout la même organisation territoriale. Il y a aussi de grosses entreprises de l’électricité en Allemagne : quatre grosses entreprises allemandes de l’électricité pèsent ensemble le même poids qu’EDF. Mais elles sont associées à de nombreuses Petites et Moyennes entreprises. En France, nous sommes complètement bloqués.

Propos recueillis par Olivier Daniélo

S’inscrire à la newsletter « EnergEthiques » mensuelle rédigée par Marc Théry et accéder aux archives (le mot « EnergEthique » est inspiré du livre « Der energethische Imperativ: 100 % jetzt », livre du député allemand Hermann Scheer, prix Nobel Alternatif, père des lois allemandes en faveur des énergies renouvelables et à l’origine du film-documentaire de Carl-A Fechner « La quatrième révolution : vers l’autonomie énergétique » qui a été diffusé sur ARTE en 2012)

Découvrez les bases documentaires

|