;Quand a-t-on commencé à produire des ondes térahertz ?

Surgies de l’oubli dans les années 1990, leur production a été un réel défi. Après dix ans de recherche en technologies semi-conducteurs, les ondes térahertz commençaient à être générées en continu grâce au développement des lasers à cascade quantique. Toutefois, les ondes térahertz émises par cette technique sont fortement absorbées par les molécules de vapeur d’eau, une fois transmises dans l’air… Pour résoudre ce problème et pouvoir transmettre les ondes térahertz sur des centaines de kilomètres sans qu’elles soient absorbées, une nouvelle technique a été développée il y a peu.

Quel est le spectre d’action des ondes Terahertz ?

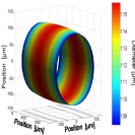

Le domaine des fréquences térahertz (THz, 1 THz = 1012 Hz) s’étend de 100 GHz à 30 THz environ, soit environ aux longueurs d’ondes entre 10 pm et 0,3 pm Il est historiquement connu sous la terminologie d’infrarouge lointain mais on le retrouve également aujourd’hui sous l’appellation de rayon T. Il se situe dans le spectre électromagnétique entre l’infrarouge (domaine de l’optique) et les micro-ondes (domaine de la radioélectricité). La bande inférieure à 100 GHz est en général définie comme radioélectrique, alors que les fréquences supérieures à 30 THz sont en général définies comme infrarouge mais ces frontières ne sont pas normalisées, car ce n’est qu’un changement de langage ou de technologie, et non de nature.

Quelles sont les propriétés spécifiques des ondes Terahertz ?

Les rayonnements térahertz ont un fort pouvoir pénétrant. Ils permettent potentiellement de voir à travers de nombreux matériaux non conducteurs (la peau, les vêtements, le papier, le bois (voir illustration ci-dessous), le carton, les plastiques…). Ils sont peu énergétiques et non-ionisants (1 THz correspond à une énergie de photon de 4,1 meV, soit sensiblement moins que l’énergie d’activation thermique à température ambiante) ce qui les rend à priori peu nocifs.

Ci dessus : vis et trou dans du bois : Vision Terahertz au travers 10mm de bois : Applications au CND et mesures en volume (CPMOH; PMounaix & E.Abraham)

Quelles sont les sources ? Les détecteurs ?

Voici une liste de sources possibles pour obtenir des ondes térahertz : les lasers à cascade quantique (lire l’article), les corps noirs, les diodes électroniques, les carcinotrons, les lasers à électrons libres, les lasers moléculaires et les sources optoélectroniques. Les bolomètres sont des détecteurs qui permettent de mesurer l’énergie du rayonnement mais pas sa phase (on les appelle des détecteurs « incohérents »). En revanche, les détecteurs optoélectroniques permettent de mesurer facilement la phase du signal. C’est le plus souvent la même source optique qui déclenche à la fois l’émetteur d’onde et le détecteur. (lire l’article)

Les ondes térahertz sont-elles nocives ?

Comme l’explique Guilhem Gallot, chargé de recherche CNRS : « Nous n’avons pas encore beaucoup d’informations sur la nocivité. L’énergie du photon est comparable à ce que l’on reçoit par rayon thermique dans une pièce à 20 °C. De plus, il n’y a pas de nocivité intrinsèque du photon. L’effet d’échauffement est très faible pour des sources conventionnelles. » (lire l’interview)

Le térahertz est-il sorti des labos ?

La technologie térahertz est en grande partie encore cantonnée aux laboratoires. D’après Optoélectronique térahertz (cf. encadré), l’évolution du nombre de publications dont le titre comporte le terme térahertz a connu une évolution exponentielle depuis 1992. La technologie s’est ainsi progressivement développée dans les laboratoires. Des applications commencent à voir le jour, notamment sous l’impulsion des besoins en sécurité.

Quelles sont les applications ?

- Contrôle qualité des chaînes de production

Comme l’explique les auteurs de Optoélectronique térahertz, le térahertz peut permettre de « contrôler l’intégrité ou le positionnement d’un objet ou d’un circuit placé derrière une surface opaque ». L’avantage étant que ce contrôle se fait sans contact. Par exemple, dans l’automobile, on pourrait analyser l’épaisseur de la peinture et le temps de séchage. On peut imaginer des applications dans de nombreux secteurs comme la pharmaceutique (voir illustration ci-dessous), l’agroalimentaire, la microélectronique…

Ci-dessus : Capsule plastique remplie de produit médical .Image spectro-chimique au travers d’encapsulation. (CPMOH ; PMounaix & E.Abraham)

Le térahertz peut conduire à une analyse volumique sans contact des objets, en profitant de ses deux grandes propriétés : la détection du métal et de la présence d’eau. Par exemple, dans l’aéronautique, on peut détecter de bulles d’air dans des mousses. Des technologies employant le térahertz ont permis de découvrir les causes de l’accident de la navette spatiale Columbia en février 2003. Autres secteurs : les BTP, l’agroalimentaire.

En sécurité, il existe des applications en détection proche (portiques d’accès dans les aéroports pour détecter des explosifs et les armes) et en détection lointaine (check-point, lieux publics). L’objectif est notamment de mettre au point un détecteur portable multi-composants (explosif, gaz, drogue, agent biologique…).

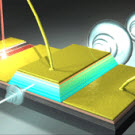

L’augmentation des débits de transmissions de données et la densité électromagnétique de la bande 0,5 à 6 GHz font que le térahertz pourrait constituer une solution pour la transmission haut débit. Il s’agit de développer la radio sur fibre, qui combine fibre optique et rayonnement d’une station de base vers les usagers. Autre domaine : l’utilisation de l’optoélectronique THz dans les circuits rapides pour les signaux numériques haut débit

La forte absorption de l’eau aux fréquences THz témoigne d’une forte interaction entre les échantillons biologiques et les ondes THz. En effet, ces ondes mettent en vibration/rotation les molécules d’eau polaire et excitent les liaisons de faible énergie intermoléculaires au sein de l’eau, des protéines… Se profilent ainsi de nombreuses applications de la spectroscopie THz au domaine biologique avec par exemple l’étude d’hydratation et de conformation de protéines, d’hybridation de l’ADN, la détection de certaines cellules cancéreuses (anormalement riches en eau).

La rédaction

Optoélectronique térahertz

EDP Sciences, avril 2008

Rédigé par 15 chercheurs français sous la direction de Jean-Louis Coutaz, ce livre a pour but de donner les bases et principes de la science et de la technologie des ondes térahertz, en présentant les principales applications entrevues aujourd’hui. L’ouvrage se limite aux techniques optoélectroniques, pour donner une cohérence thématique et lui conserver une taille raisonnable…

Il s’adresse à un public d’ingénieurs ou de scientifiques non spécialistes qui voudraient commencer des travaux dans le domaine térahertz, ou tout simplement mieux connaître ce que révèle l’expression « domaine térahertz ». Il sera aussi très utile aux étudiants (masters, dernière année d’écoles d’ingénieurs ou doctorants). |

|

Sommaire cahier térahertz

A la Une :

Comprendre :

Dans les labos :

.jpg)

.jpg)