Investir davantage dans les industries à valeur ajoutée technologique pour aider ce secteur, et plus largement l’économie française, à sortir de la crise… Tel est l’appel qu’une trentaine d’organisations coordonnées par la Fédération des industries électriques, électroniques et de communication (FIEEC) ainsi que l’Association française des éditeurs de logiciels (AFDEL) a lancé au gouvernement, mercredi 18 mars 2009, lors de la présentation de leur plan de conquête.Véritable plan de relance, celui-ci repose sur 10 projets qui couvrent un large spectre d’activités.

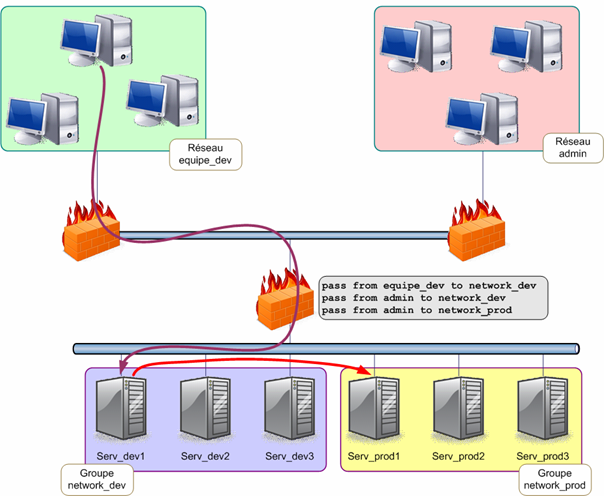

- Le premier propose la création d’un environnement numérique performant sur l’ensemble du territoire et dans les bâtiments. Objectif : permettre aux particuliers comme aux entreprises de disposer d’un accès Internet haut débit de 10 Mbits/s d’ici 2012 avant d’atteindre 100 Mbits/s en 2020. Pour y parvenir, les rédacteurs du rapport proposent deux types de mesures : améliorer la capillarité du réseau de fibres optiques et jouer sur la mixité des technologies (sans fil, ADSL, etc.) pour atteindre l’abonné ; libérer les fréquences nécessaires pour les technologies sans fil haut débit au plus vite et s’assurer que les réseaux de communication à l’intérieur des immeubles sont conformes. Un projet dont l’investissement de départ est évalué à 300 millions d’euros en 2009.

- Le deuxième vise à améliorer la qualité et la sécurité du réseau électrique. Objectifs : renforcer immédiatement la sécurité des installations électriques existantes, sécuriser d’ici 2015 120.000 km de lignes électriques contre les aléas climatiques et, d’ici 2018, accélérer le développement des énergies renouvelables et, parallèlement, travailler à l’intelligence d’un réseau électrique au service des citoyens et des entreprises (smart grid). Un projet dont le coût est évalué à 100 millions d’euros en 2009.

- Le troisième concerne l’e-santé. Objectifs : faire en sorte que d’ici 2012, 10% des patients soient suivis sur leur lieu de vie plutôt que dans un hôpital et que d’ici 2020, toutes les personnes fragilisées (vieillesse, handicaps, maladies chroniques…) puissent demeurer chez elles si elles le désirent. Pour y parvenir, le rapport propose de développer la télé-médecine et la télé-santé, ainsi que de lancer un programme d’équipement ambitieux pour soulager des pathologies spécifiques. La première année, ce projet pourrait être financé à hauteur de 50 millions d’euros.

- Le quatrième projet a trait à l’éco-responsabilité énergétique et au Green IT. Trois mesures phares sont proposées : accélérer dici 2015 a mise en oeuvre des décisions du Grenelle de l’environnement sur la rénovation des bâtiments tertiaires, industriels et résidentiels ; remplacer les équipements vétustes et énergivores et gérer les consommations d’énergie des bâtiments » intelligemment » grâce aux technologies innovantes ; et enfin, encourager le développement d’applications logicielles au service de l’éco-responsabilité. Un projet dont l’investissement pour 2009 est évalué à 200 millions d’euros.

- Le cinquième programme s’applique, quant à lui, au développement de systèmes d’éclairage plus économes et plus performants. Objectif : rénover, d’ici 2015, 80% des installations, publiques et privées, d’éclairage des bâtiments et voieries les plus dégradées et énergivores, et installer des systèmes de contrôle automatique du fonctionnement (détection de présence de personnes et de lumière du jour). Un projet évalué à 100 millions d’euros en 2009.

- Le sixième projet vise pour sa part à développer d’ici 2010 une véritable filière française de contenus audiovisuels et de jeux interactifs en Haute Définition (HD). Pour y parvenir, les auteurs du rapport proposent de redéployer et de compléter les aides du Conseil National de la Cinématographie (CNC) vers la filière HD, d’avancer sur le déploiement TNT, et de former et de sensibiliser l’ensemble de la filière. Coût de l’opération en 2009 : 30 millions d’euros.

- Le septième programme propose de réguler le trafic routier pour polluer moins et réduire les bouchons en généralisant les infrastructures intelligentes et le rechargement électrique. Pour y parvenir, le rapport propose de développer, dès 2009, un pilote grandeur nature dans une ville, une région ou un département, et de réunir les acteurs concernés. Un projet qui pour 2009 devrait représenter un investissement de 24 millions d’euros.

- Le huitième projet se place, lui, sous le volet de la sécurité. Objectifs : généraliser, d’ici 2015, les outils de sécurité des personnes et des biens grâce aux technologies à valeur ajoutée. Entre autres mesures, il s’agit essentiellement d’accélérer l’introduction de la carte nationale d’identité électronique et de la carte vitale 2 à base de puce. Coût de l’opération : 100 millions d’euros en 2009.

- Le neuvième programme est consacré à l’e-éducation et propose, d’ici 2015, de généraliser les outils numériques de soutien à l’enseignement en primaire et secondaire ainsi que dans la formation professionnelle. Le budget nécessaire à sa mise en oeuvre en 2009 est évalué à 50 millions d’euros.

- Enfin, le dixième projet propose de généraliser l’e-administration et d’encourager l’équipement numérique des entreprises d’ici 2011, l’investissement de départ étant évalué à 50 millions d’euros.

Au final, pour être lancé, ce plan en 10 points nécessiterait un investissement global de 1 milliard d’euros en 2009. Pour réunir cette somme, la FIEEC et l’AFDEL propose de créer un fond d’investissement spécifique au secteur des industries à valeur ajoutée : le FIVAT. Piloté par le gouvernement, mais cogéré par les différents acteurs publics et privés (incluant les centres de recherche et développement et les pôles de compétitivité pertinents), celui-ci sera alimenté par une mise initiale associant capitaux privés et publlics et serait, ensuite, alimenté par le privé et par les économies réalisées par la mise en place du plan de conquête. Reste à savoir si le gouvernement est prêt à financer un nouveau plan de relance en plus de ceux dans lesquels il est déjà engagé. Un plan de relance IT également aux Etats-UnisOutre-Atlantique aussi, des voix s’élèvent pour appeler le gouvernement à investir davantage dans les nouvelles technologies afin de sortir plus rapidement de la crise. Là bas, le projet est porté par Robert Atkinson, l’un des conseillers du président américain, fondateur et dirigeant de la Fondation pour l’innovation et les technologies. Celui-ci invoque la capacité de ce secteur à générer des gains de productivité. Le plan de relance économique américain prévoit pourtant d’allouer 7,2 milliards de dollars à la construction de réseaux. Mais pour Robert Atkinson, ce sont 15 milliards de dollars qui seraient nécessaires.