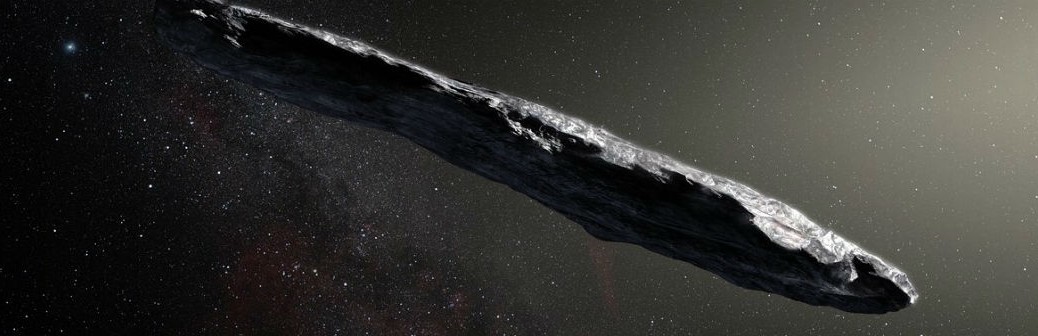

Ainsi la Pyramide de Khéops recèle-t-elle encore bien des mystères, d’après une étude publiée dans la revue Nature en novembre dernier. Initiée par la Faculté des ingénieurs de l’université du Caire et l’Institut HIP (Héritage Innovation Préservation), la mission ScanPyramids, avec le concours du CEA, avait annoncé la découverte de cavités inconnues jusqu’à présent. Les premiers résultats datent en fait d’octobre 2016 et, depuis lors, les équipes scientifiques s’interrogent sur la manière d’explorer l’intérieur de ces cavités en les laissant intactes. Un robot ne pourrait-il pas se faufiler dans un trou de souris, résultat d’un perçage minutieux, puis atteindre ces recoins de pyramide toujours cachés aux yeux du monde ?

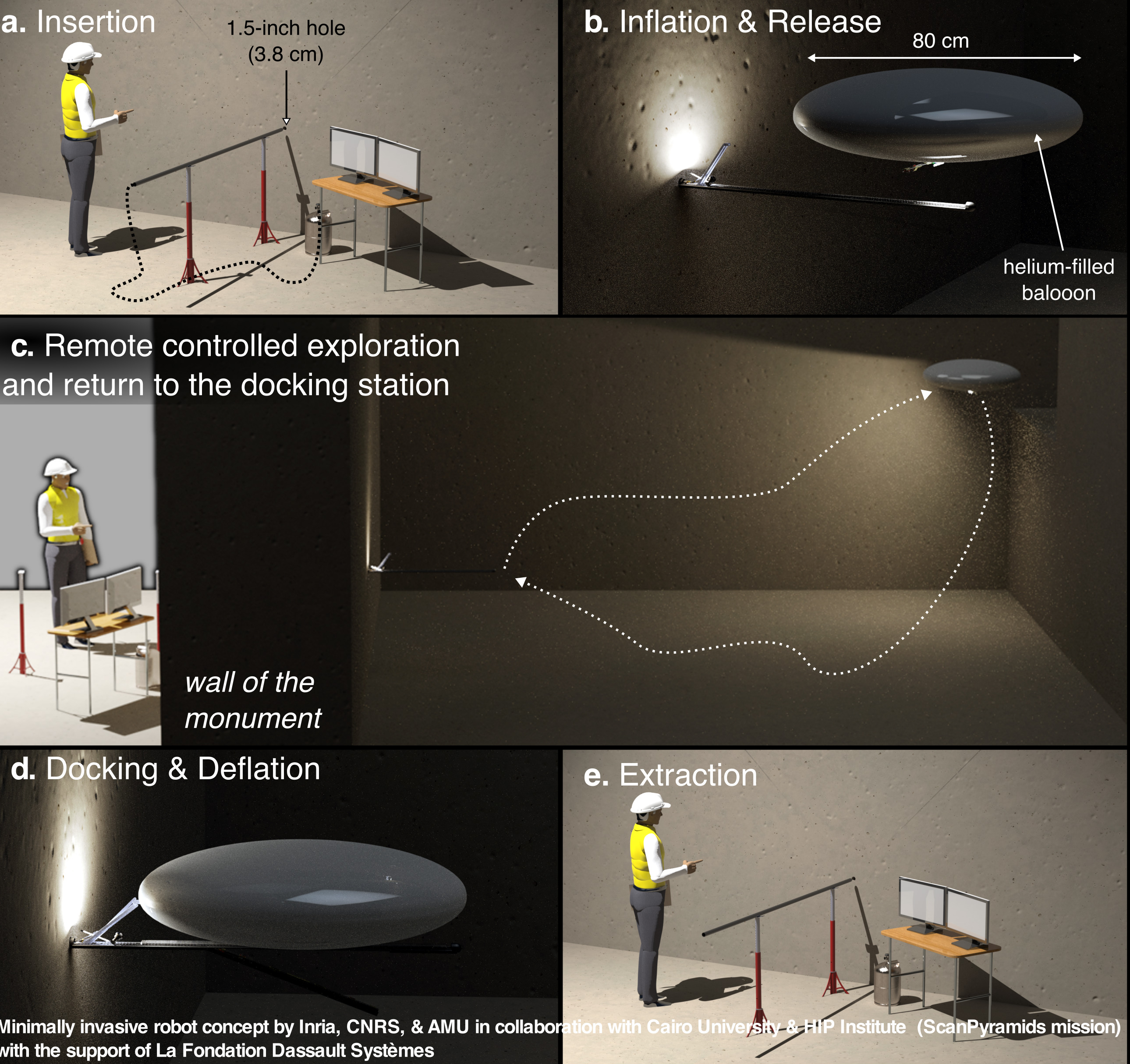

La mission ScanPyramids prend contact avec l’Inria (Institut national de recherche en informatique et en automatique) et ses experts-roboticiens. «A l’époque, nous ne savions pas réaliser ce genre de robot explorateur, admet Jean-Baptiste Mouret, chercheur et spécialiste en robotique et en intelligence artificielle. Mais le challenge était intéressant.» Le projet pour réaliser ce robot «minimalement invasif» est amorcé et, un an plus tard, les premiers détails techniques viennent d’être dévoilés : les chercheurs de l’Inria ne vont pas réaliser un seul robot miniature, mais deux. Le premier robot fait figure d’éclaireur et sert à établir l’état des lieux, en quelque sorte. Le second, qui ressemble à un petit dirigeable, est prévu pour se déplacer et examiner le site plus en détails, si possible ou si nécessaire.

Un défi de miniaturisation

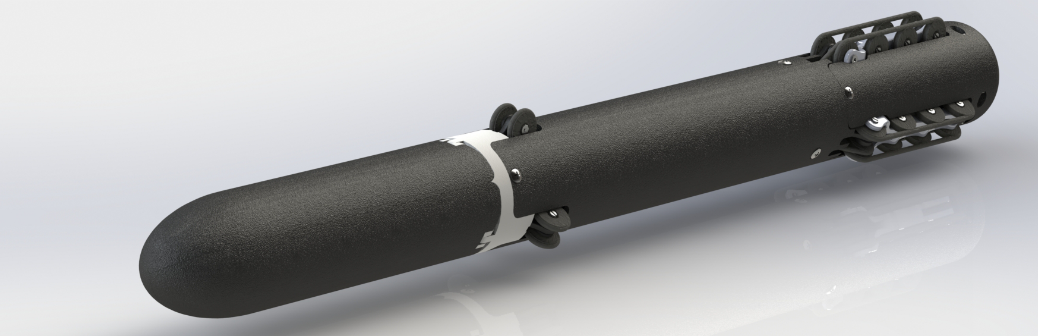

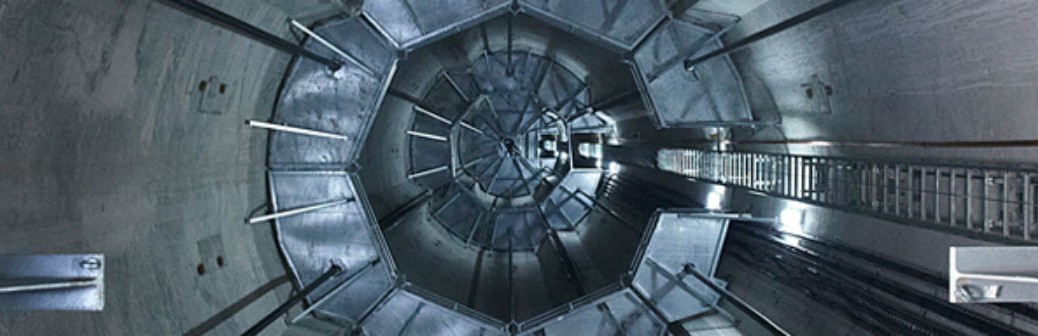

«Le robot de reconnaissance est équipé d’une caméra, orientable dans toutes les directions, qui permet de produire des images panoramiques de 15 000 pixels de large, explique Jean-Baptiste Mouret. Les trois torches bénéficient d’une puissance totale de 1500 lumens afin de percer l’obscurité. Le robot ne mesure que 3,5 centimètres de diamètre et il a fallu caser les moteurs, l’électronique… La miniaturisation a été un défi.» Relié à un câble transportant l’énergie et les données, ce robot se déplace à l’aide de roues et de chenillettes. «Celles-ci sont en contact permanent avec la paroi du trou pour assurer la propulsion, grâce au système de suspension que nous avons mis au point» détaille Jean-Baptiste Mouret. Le robot est aujourd’hui quasi-fonctionnel, bien qu’il demande encore à être éprouvé hors d’un laboratoire. A l’exception des composants électroniques et des axes, les prototypes ont été intégralement fabriqués en plastique, à partir d’une imprimante 3D Form 2.

Long de 30 à 35 centimètres dans sa configuration initiale, ce robot a l’avantage d’être modulaire. Les composants de propulsion sont indispensables, mais la plupart des autres pièces sont interchangeables. Une fois sa mission accomplie, le module de reconnaissance revient à son point de départ, est retiré puis remplacé par le robot d’exploration, qui emprunte le même chemin. Pour cette phase qui demande un robot mobile et même volant, les chercheurs de l’Inria ont imaginé et conçu un petit dirigeable, gonflé à l’hélium, et sa station d’accueil, autrement dit une mini-piste d’envol et d’atterrissage. Le dirigeable est piloté à distance par un opérateur à l’aide un émetteur-récepteur radio, logé dans la station d’accueil. La «nacelle» embarque plusieurs composants, pour certains issus du modélisme, dont quatre moteurs, des projecteurs, une caméra analogique, un micro-contrôleur et surtout plusieurs capteurs qui aident à la navigation. Car l’engin est conçu pour être partiellement autonome. «Si la liaison radio est perdue, le robot doit retourner à sa base de lui-même, commente Jean-Baptiste Mouret. Dans une situation normale, ces capteurs assistent le pilotage, pendant le vol, et l’atterrissage de précision sur la station d’accueil.»

Des déplacements analysés à l’aide d’une vision d’insecte

Les capteurs en question sont élaborés à l’Institut des sciences du mouvement de Marseille (CNRS/Aix-Marseille Université). «Le capteur de flux optique mesure la vitesse des objets sur sa «rétine» lorsque le robot se déplace, développe Jean-Baptiste Mouret. Si les parois d’un couloir défilent à la même vitesse à gauche et à droite, le robot-dirigeable en déduit qu’il évolue au milieu. Ce système s’inspire de la vision des mouches et des abeilles. Le second capteur, HyperCube, sert à calculer l’angle d’approche en phase d’atterrissage.» Tous les éléments qui composent la nacelle, y compris les 20 grammes de batterie lithium-polymère pour 15 minutes d’autonomie, pèsent au total 50 grammes. Ce poids n’a pas été décidé de manière arbitraire car il dépend du volume du ballon, lequel fait 80 centimètres de diamètre. Ceci pour une bonne raison : «Les couloirs dans la partie connue de la pyramide de Kheops mesurent un peu plus d’un mètre de large, constate Jean-Baptiste Mouret. La limite est donc imposée.» La quantité de gaz injectée dans le ballon, à partir d’une bouteille d’hélium située à l’extérieur, a également intérêt à être exacte au gramme près. Au-delà de 50 grammes, le ballon s’envole au plafond. En-dessous, il est incapable de soulever sa charge.

Le dépliement et le repliement de ce ballon, quand il est de retour sur la station d’accueil, donne toujours du grain à moudre aux chercheurs de l’Inria. «C’est en cours de réflexion, mais les astuces que nous mettons en œuvre commencent à fonctionner, se réjouit Jean-Baptiste Mouret. Le robot volant requiert encore au moins un an de travail avant que nous n’obtenions un prototype fiable. A ce moment-là, nous prévoyons d’inclure des algorithmes d’apprentissage pour que le robot puisse réagir à des situations imprévues, quand il subit un dommage par exemple. C’est aussi un axe de recherche.» L’ensemble du projet, s’il est lié à la mission ScanPyramids, a d’autres applications potentielles. «L’exploration des grottes ornées, difficiles d’accès ou préservées de l’influence humaine, et d’autres usages dans l’industrie sont envisageables, estime Jean-Baptiste Mouret. Ces robots répondent à un besoin que d’autres technologies actuelles ne peuvent assumer.»

Frédéric Monflier