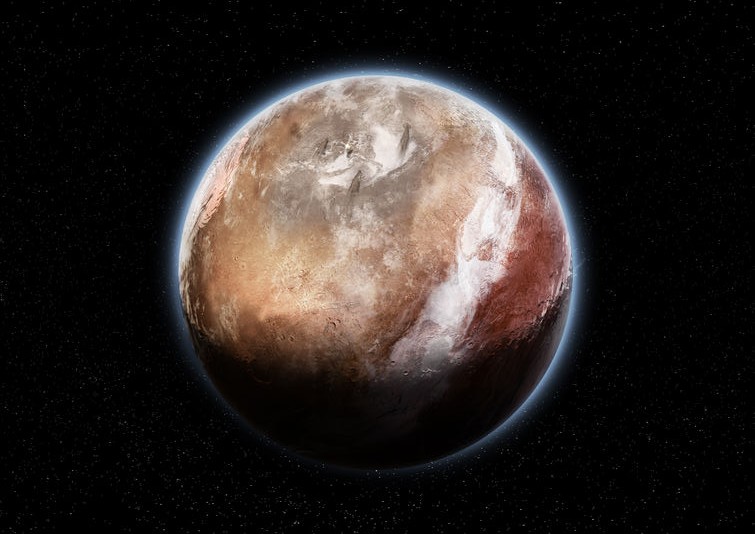

Par sa masse hors du commun, le dôme volcanique de Tharsis a entraîné la rotation des enveloppes superficielles de Mars (sa croûte et son manteau) autour de son noyau. L’existence de ce grand basculement donne un nouveau visage à la planète Mars durant le premier milliard d’années de son histoire, à un moment où la vie aurait pu apparaître. Elle offre aussi une réponse unique à trois mystères : on comprend enfin pourquoi les rivières se sont formées à l’endroit où on les observe aujourd’hui, pourquoi certains réservoirs souterrains de glace d’eau, qualifiés jusqu’ici d’anomalie, se situent loin des pôles de Mars, et pourquoi le dôme de Tharsis est aujourd’hui centré sur l’équateur. Ces résultats sont publiés le 2 mars 2016 dans la revue Nature, par une équipe essentiellement française comprenant des chercheurs de Géosciences Paris Sud (CNRS/Université Paris-Sud), de Géosciences environnement Toulouse (CNRS/Université Toulouse III – Paul Sabatier/IRD) et du Laboratoire de météorologie dynamique (CNRS/École polytechnique/UPMC/ENS), ainsi qu’un chercheur du Lunar and planetary laboratory (Université d’Arizona).

Mars n’a pas toujours eu le visage que nous lui connaissons. Il y a 3 à 3,5 milliards d’années, la planète a subi un grand basculement, que vient de mettre en évidence le travail conjoint de géomorphologues, géophysiciens et climatologues. Ce n’est pas l’axe de rotation de Mars qui a bougé (phénomène que l’on appelle variation de l’obliquité) mais les parties externes (manteau, croûte) qui ont tourné par rapport au noyau interne – un peu comme si l’on faisait tourner la chair d’un abricot autour de son noyau ! Ce phénomène avait été prédit théoriquement, mais jamais encore démontré. L’origine de ce basculement ? Le gigantesque dôme volcanique de Tharsis. Sa formation a débuté il y a plus de 3,7 milliards d’années, vers 20° de latitude nord et l’activité volcanique s’est poursuivie pendant plusieurs centaines de millions d’années jusqu’à former un plateau de plus de 5000 km de diamètre, environ 12 km d’épaisseur en moyenne et 1 milliard de milliards de tonnes (1/70e de la Lune). Une masse telle qu’elle a fait pivoter la croûte et le manteau de Mars. Le dôme de Tharsis s’est alors retrouvé sur l’équateur, ce qui correspond à sa nouvelle position d’équilibre.

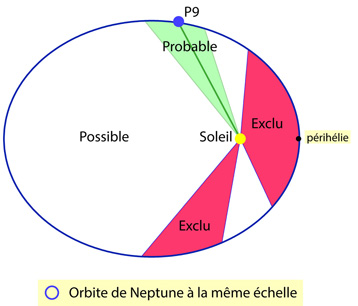

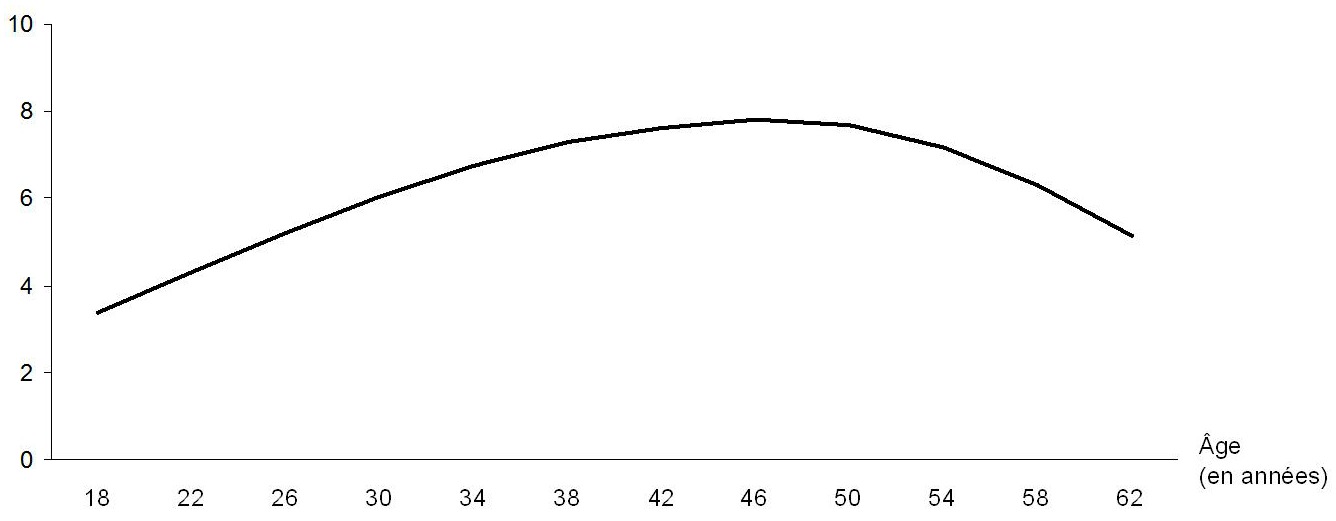

Avant ce basculement, les pôles de Mars étaient donc différents. En 2010, Isamu Matsuyama (Université d’Arizona) avait déjà démontré grâce à un modèle géophysique que, si on retire le dôme de Tharsis de la planète, celle‐ci s’oriente différemment par rapport à son axe. Dans cette nouvelle étude, les géomorphologues Sylvain Bouley (Université Paris-Sud) et David Baratoux (Université Toulouse III – Paul Sabatier) montrent pour la première fois que les rivières étaient à l’origine réparties sur une bande tropicale sud d’une planète Mars tournant autour de pôles décalés d’une vingtaine de degrés par rapport aux pôles actuels. Ces pôles sont cohérents avec ceux calculés de manière indépendante par Isamu Matsuyama. Cette corrélation remarquable est confortée par des observations d’autres équipes scientifiques qui avaient déjà observé dans la région de ces anciens pôles des traces de fonte et de retrait de glaciers, et des preuves de glace souterraine.

Un tel basculement n’est pas anodin sur la physionomie de la planète. La forme de la planète dans cette configuration primitive a été recalculée par Isamu Matsuyama, afin d’en examiner les conséquences sur le visage de la planète Mars primitive. Cette étude modifie profondément le scénario généralement accepté, selon lequel le dôme de Tharsis se serait majoritairement formé avant 3,7 milliards d’années et préexisterait aux rivières puisque c’est lui qui leur imprimerait leur sens d’écoulement. A partir de la topographie calculée, Sylvain Bouley, Antoine Séjourné (Université Paris-Sud) et François Costard (CNRS) ont démontré que malgré un relief différent avec ou sans Tharsis, la plupart des rivières coulent, dans les deux cas, des hauts terrains cratérisés de l’hémisphère sud vers les plaines basses de l’hémisphère nord. Cette observation suggère que les rivières peuvent tout à fait être contemporaines de la formation du dôme de Tharsis.

La topographie de Mars avant le basculement permet également d’étudier le climat primitif de la planète. En utilisant les modèles climatiques du Laboratoire de météorologie dynamique, François Forget (CNRS) et Martin Turbet (UPMC) mettent en évidence, en présence d’un climat froid et d’une atmosphère plus dense que celle d’aujourd’hui, une accumulation de glaces autour de 25° Sud, dans les régions qui correspondent aux sources des rivières aujourd’hui asséchées.

Cette étude bouleverse notre représentation de la surface de Mars telle qu’elle a dû être il y a 4 milliards d’années, et modifie aussi profondément la chronologie des évènements. Selon ce nouveau scénario, la période de stabilité de l’eau liquide permettant la formation de vallées fluviales est contemporaine, et sans doute une conséquence, de l’activité volcanique du dôme de Tharsis. Le grand basculement déclenché par Tharsis a eu lieu après la fin de l’activité fluviale (-3,5 milliards d’années) et a ainsi donné à Mars le visage qu’on lui connaît aujourd’hui. Désormais, quand on s’intéressera à l’époque primitive de Mars – pour chercher des traces de vie ou d’un océan, par exemple – il faudra apprendre à penser avec cette nouvelle géographie.

Source : cnrs

La route n’étant plus exposée au soleil, le bitume ne fond pas durant les périodes chaudes. Les agressions hydriques (érosion par ruissèlement) sont également éliminées. L’eau, absente, rend les périodes de gel moins dévastatrices. Les variations thermiques sont atténuées, réduisant ainsi les cycles de dilatation/contraction destructeurs. Et les très puissants Ultra-Violets sont stoppés.

La route n’étant plus exposée au soleil, le bitume ne fond pas durant les périodes chaudes. Les agressions hydriques (érosion par ruissèlement) sont également éliminées. L’eau, absente, rend les périodes de gel moins dévastatrices. Les variations thermiques sont atténuées, réduisant ainsi les cycles de dilatation/contraction destructeurs. Et les très puissants Ultra-Violets sont stoppés.