« Les robots nous volent notre travail ». « Les robots tuent l’emploi ». Depuis quelques jours, les robots sont devenus l’ennemi public n° 1 du travail. En cause, une étude du Cabinet Roland Berger sur la transformation digitale, c’est-à-dire l’intégration du numérique dans notre quotidien. D’après leurs travaux, de nombreux métiers pourraient être automatisés et donc disparaitre. Le Cabinet avance même le chiffre de 3 millions d’emplois volatilisés dans la prochaine décennie.

Toutefois, résumer l’étude à cette seule conclusion est erroné, car si de nombreux emplois ne seront plus assurés par des humains, d’autres métiers émergeront de cette fameuse transition digitale, une notion très large qui concerne évidemment les robots, mais aussi les logiciels, les algorithmes, les automates, les machines…

La robotisation reste faible en France

Ainsi, les tâches répétitives sont confiées à des machines plutôt qu’à des hommes, un phénomène à l’œuvre depuis le siècle précédent et qui touche principalement les ouvriers. Les machines outils ont révolutionné la production industrielle dans de nombreux secteurs comme l’automobile, l’agroalimentaire, la pétrochimie ou l’industrie pharmaceutique.

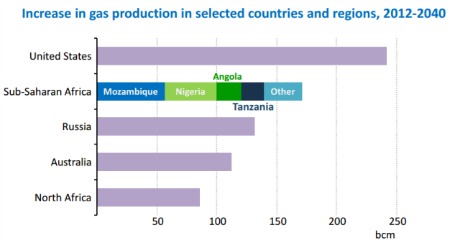

Toutefois, la France reste sous-équipée avec un parc de machines sous-dimensionné et vieillissant. Cette situation est d’ailleurs en partie responsable de la perte de compétitivité de la France face aux autres pays européens. A titre d’exemple, l’Allemagne compte 162 000 robots quand ils ne sont que 34 000 en sur notre territoire. Le Cabinet Roland Berger indiquait un taux de robotisation (nombre de robots installés pour 10 000 employés) français de 84 contre 125 en Allemagne. Ce retard peut s’expliquer par la réticence des français vis-à-vis des robots. Une défiance illustrée par un sondage réalisé en 2012 par la Commission Européenne dans lequel les français étaient 74% à dire craindre que les robots ne leur volent leur emploi.

Automatiser les services

Ainsi, la France reste timide quant à l’utilisation de robots. Pourtant, cette tendance devrait s’accélérer et s’élargir à d’autres métiers. Car c’est là toute la nouveauté de l’étude : l’automatisation va toucher les services.

Les métiers manuels ne seront plus les seuls à céder leur place aux machines, des actions comme le télémarketing, l’écriture de rapport, la distribution de médicaments peuvent être automatisée. Par exemple, le logiciel Quill permet la rédaction de contenus, l’algorithme News Digest écrit de véritables articles journalistiques, le robot TUG d’Aethon sait se déplacer dans un environnement réel et supplée les aides-soignants en apportant les repas aux patients.

Le développement fulgurant du Big Data, du Cloud mais aussi des objets connectés permet d’automatiser des actions comme la prise de décision, de quoi rendre les robots autonomes. Des robots d’accueil commencent à se démocratiser comme le robot Pepper que les amateurs de café pourront rencontrer dans les boutiques Nespresso dès décembre. Bien que moins séduisants que George Clooney, leur mission sera aussi de vendre les machines à café. Plus près de chez vous, depuis la rentrée les téléspectateurs de l’émùission télé Salut les Terriens peuvent regarder le robot Jean-Mi aux côté de Thierry Ardisson jouer le rôle de chroniqueur en posant une question à l’invité. Pour autant, l’animateur en noir n’est pas prêt à lui céder la place…

Le Cabinet auteur de cette étude sur la transformation digitale prévoit que 42% des emplois français sont potentiellement automatisables d’ici 20 ans, dont les emplois industriels peu qualifiés mais aussi les emplois intermédiaires comme les fonctions administratives, les métiers juridiques ou des fonctions d’encadrement. Toutes les tâches à caractère répétitif sont concernées, qu’elles soient qualifiées ou non. Pour résumer, les seuls travailleurs à l’abri sont ceux dont le job nécessite de la créativité ou de l’intelligence social, comme les enseignants, les chercheurs, les ingénieurs ou encore les fonctions régaliennes. Pour l’instant en tout cas…

Tirer profit de l’automatisation

Faut-il avoir peur et craindre un scénario à la Terminator ? Non, Skynet reste de la science-fiction. Mais consciente de ces évolutions technologiques, la France va devoir s’adapter et transformer le risque en opportunité. Car il y a beaucoup à gagner à réussir la transformation digitale : rehaussement des marges des entreprises, rentrées fiscales liées à la hausse des bénéfices, accroissement de la performance des services publics, création de nouvelles catégories d’emplois. La hausse de la productivité liée à la numérisation de l’économie pourrait même générer 30 milliards d’euros de recettes publiques. De quoi faire réfléchir.

Par Audrey Loubens