Cellules solaires organiques : des molécules simples comme alternatives aux polymères

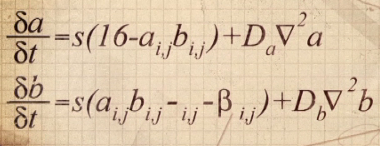

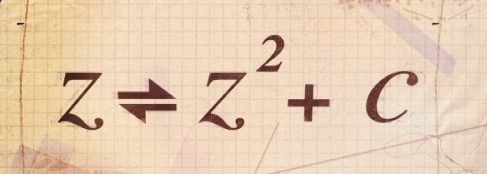

Utiliser des molécules organiques pour produire des cellules photovoltaïques aux performances comparables à celles, en silicium, des panneaux solaires proposés aujourd’hui sur le marché. Tel est l’objectif de nombreuses équipes de recherche dans le monde qui, depuis le début des années 2000, se livrent à une intense compétition. Si l’utilisation des polymères est la plus répandue des deux voies qui font actuellement l’objet de développements en laboratoire, l’autre voie, initiée en 2005 par Moltech-Anjou, l’Institut des Sciences et Technologies Moléculaires d’Angers (CNRS/Université d’Angers), qui consiste à utiliser des molécules organiques solubles de structures parfaitement définie, a été reprise depuis par de nombreux laboratoires. Soulignons que celle-ci a permis d’obtenir récemment des rendements de conversion électrique de plus de 7%, ceux des cellules à base de polymères se situant entre 8 et 9%.

Reste que la production de ces molécules est difficile, les plus performantes d’entre elles nécessitant 12 étapes de synthèse, qui plus est avec un rendement global inférieur à 0,10%, peu compatible avec une production à l’échelle industrielle. Aussi les chercheurs de Moltech-Anjou se sont-ils lancés dans la recherche de molécules plus simples présentant un effet photovoltaïque intéressant. D’où leur choix d’une famille de molécules à base de triarylamines, dont la synthèse ne nécessite que peu d’étapes. Dans un deuxième temps, ils ont cherché à optimiser certaines propriétés de ces molécules (capacité d’absorption de la lumière, niveaux d’énergie, stabilité ou encore mobilité des charges électriques). Un véritable travail d’ingénierie moléculaire consistant à ajouter, selon les besoins, certains types de liaisons ou de groupements chimiques, qui les a conduit à développer des molécules de faible masse moléculaire dont le rendement de conversion électrique est d’environ 4%. Notons qu’il s’agit là d’un des rendements les plus élevés obtenus avec des molécules de structure aussi simple.

Ces travaux, dont les résultats sont publiés en ligne dans Chemistry : A European Journal, se poursuivent aujourd’hui, l’objectif des chercheurs étant d’améliorer non seulement les performances des cellules photovoltaïques mais aussi des procédés de synthèse, notamment en limitant l’utilisation des réactifs ou de solvants toxiques mais aussi de catalyseurs coûteux.

En savoir plus

Un avion solaire traverse les Etats-Unis

Le 16 juin, l’avion solaire Solar Impulse HB-SIA a atterri à l’aéroport de Dulles (près de Washington, D.C.). L’avion est parti de San Francisco le 3 mai en direction du District de Colombia, faisant étape à Phoenix en Arizona, puis Dallas au Texas – battant au passage le record du monde pour un vol en avion solaire avec 1.541 kilomètres parcourus – et ensuite Saint Louis. Une étape supplémentaire a dû être effectuée à Cincinnati en Ohio en raison d’un fort orage les 12 et 13 juin, avant un vol de 14 heures et quatre minutes pour rejoindre Washington, D.C. Enfin, cet avion particulier devrait terminer son périple à New York début juillet. Solar Impulse aura alors fait la démonstration qu’il est possible de traverser les Etats-Unis, en volant de jour comme de nuit, sans utiliser de carburant fossile. L’avion avait déjà effectué plusieurs vols (dont un vol de 26 heures) en Europe en 2010 et 2011 et avait même effectué un voyage jusqu’au Maroc en juin 2012. Un deuxième avion est en construction avec pour objectif un vol autour du monde en 2015.

Solar Impulse HB – SIA

Cette traversée des Etats-Unis est l’aboutissement d’un projet commencé en 2003, qui a bénéficié d’un budget de 90 millions d’euros sur 10 ans. A l’origine suisse, le projet rassemble désormais de nombreuses associations, organisations et entreprises dans le monde entier. Sur les aspects scientifiques et techniques, de nombreuses entreprises et universités ont collaboré. Citons par exemple l’Ecole Polytechnique Fédérale de Lausanne, l’Agence Spatiale Européenne, Dassault Aviation, le groupe Solvay, Schindler ou encore Omega. Le projet est soutenu par la Commission européenne, il a été présenté en Suisse bien sûr, mais également en Chine et en Inde. Nous vous avions d’ailleurs parlé de plusieurs évènements et séminaires organisés sur ce sujet de part le monde [1].

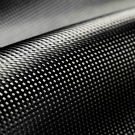

Le modèle HB – SIA pèse 1.600 kg (soit l’équivalent d’une petite voiture), grâce à une structure ultralégère en fibre de carbone et à des efforts constants pour réduire au maximum la masse de l’avion. Il est ainsi 5 fois plus léger qu’un planeur traditionnel. Son envergure est équivalente à un A340 (environ 63 mètres). Il fonctionne grâce à quatre moteurs, alimentés par 12.000 cellules photovoltaïques installées sur ses ailes qui rechargent simultanément des batteries. Celles-ci sont utilisées lorsque l’appareil vole de nuit. Sa vitesse moyenne est de 70 km/h, avec une vitesse au décollage de 44km/h. Il peut voler à une altitude maximum d’environ 8.500 mètres.

Les deux pilotes et fondateurs du projet, Bertrand Piccard et Andre Borschberg ont donc dû se former sur des simulateurs de vols pour faire voler cet avion ultra léger, très sensible aux vents (et autres perturbations) et très lent. En effet, la gigantesque envergure de l’avion (63,4 m de l’ordre de celle d’un Airbus A340) et son très faible poids le rendent difficile à piloter. Les deux pilotes ont témoigné de la difficulté, lors de simulations, à s’aligner avec la piste. Ils atterrissaient systématiquement à côté ! Avec de l’entrainement, ils comprirent que l’avion était très lent à réagir et qu’il fallait entamer toute manoeuvre bien à l’avance. La stabilité de l’avion est également différente. Alors qu’un avion de ligne classique peut prendre sans danger un virage avec un angle de 30 ou 35 degrés avec l’horizontale, Solar Impulse HB – SIA n’a qu’une marge de manoeuvre de 5 degrés. L’avion devenant instable au-delà d’une telle inclinaison. Il a donc fallu construire des capteurs très précis, réglés comme des horloges … et une horloge suisse puisque c’est la prestigieuse firme Omega qui leur est venue en aide en s’associant au projet !

It’s the chemistry, stupid!

Comment fait-on voler un avion solaire ? « Grâce à la chimie » ont répondu, lors d’une conférence de presse à Washington le 18 juin, George Corbin et Claude Michel [2], qui ont travaillé sur le projet Solar Impulse pour développer des composants et améliorer l’efficacité énergétique, au sein du groupe Solvay, leader mondial dans le domaine de la chimie.

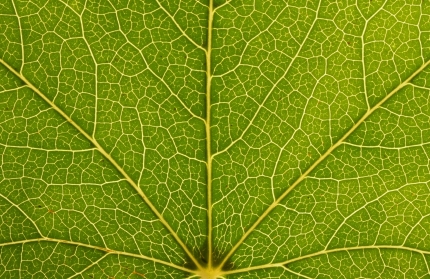

En effet, en moyenne sur 24 heures, un mètre carré de surface terrestre reçoit l’équivalent de 40 Watts d’énergie solaire, soit 250 fois moins que ce que permet de produire un litre de carburant traditionnel. Il faut environ 40 W pour faire voler 8 kg et il a donc fallu installer près de 200 m2 de cellules photovoltaïques sur les ailes de l’avion [3]. Le moteur de l’avion peut donc atteindre une puissance de 6 kW, soit l’équivalent d’un scooter.

Les ingénieurs du projet ont choisi d’utiliser des cellules photovoltaïques avec un rendement de 22%, fruit d’un compromis entre efficacité et poids (il aurait été possible d’installer des cellules photovoltaïques plus efficaces mais leur masse aurait été trop importante). Les batteries au lithium polymère représentent actuellement 400 kg, soit plus du quart de la masse totale de l’avion. Le poids de l’ensemble des autres composants de l’avion a été réduit au maximum, grâce à l’utilisation de matériaux avancés pour optimiser le poids total de l’avion, notamment en utilisant des fibres de carbone qui servent habituellement à construire des coques de bateaux à voiles.

Les batteries représentent une limite pour le développement des avions solaires et la plupart des défis restant à relever sont liés au stockage de l’énergie. Comme l’a expliqué George Corbin, cela relève directement de la chimie. Selon lui, pour améliorer cet avion solaire, il faut désormais concentrer les efforts sur la « densité énergétique », pour pouvoir stocker davantage d’énergie.

Améliorer l’efficacité énergétique dans les airs et au sol

Ernest Moniz, le nouveau secrétaire américain à l’énergie a salué ce projet lors d’une conférence de presse [4], lundi 17 juin à Dulles. Selon lui, ce vol solaire ne changera pas demain le transport aérien mais il pourrait en revanche contribuer à améliorer l’efficacité de nos véhicules et nos bâtiments.

Comme l’a rappelé André Borschberg dans une interview, en direct du cockpit, à près de 10 km d’altitude, l’aviation ne représente qu’une petite partie des émissions mondiales de gaz à effet de serre. Le potentiel est donc bien plus important au sol. Or, précisément, les innovations et les matériaux utilisés pour construire l’avion ne sont pas, pour la plupart, spécifiques au secteur aérien et ils pourraient être utilisés dans d’autres secteurs.

Par exemple, l’isolation de l’avion lui permet de conserver la chaleur dégagée par les batteries au lithium, alors que la température extérieure peut varier descendre jusqu’à -40°C la nuit. Ernest Moniz a également mentionné les recherches sur les batteries qui serviront pour les véhicules électriques, encouragés par le DOE [4] ainsi que pour les ordinateurs et téléphones portables. De même, le film protecteur transparent (composé de polymères fluorés) développé pour protéger les panneaux solaires situés sur les ailes des chocs et des altérations (corrosion, changements de température) sans les alourdir, pourrait trouver de nombreuses utilisations dans d’autres secteurs, notamment pour des panneaux solaires terrestres. Les polymères utilisés pour remplacer les différents composants de l’avion, qui sont d’habitude faits en métal, serviront pour différents appareils électroniques. Enfin, les recherches pour réaliser une structure à la fois légère et ultra-résistante (« nid d’abeilles » entre deux couches de fibres de carbone) pourront être utilisées pour des avions traditionnels.

En savoir plus

Toulouse, capitale européenne de l’océanographie spatiale opérationnelle

Il y a un peu plus de vingt ans, le 10 août 1992, était lancé le satellite franco-américain Topex-Poséidon à bord duquel se trouvait l’altimètre expérimental Poséidon développé par le Cnes, un étonnant outil permettant de mesurer non seulement la distance du satellite par rapport à la surface de la mer, mais aussi la hauteur des vagues et la vitesse du vent. « Une première », puisque que c’était alors une fusée Ariane 4 qui mis sur orbite ce satellite de la Nasa dont l’ambition était d’observer et de comprendre la circulation océanique. Une mission qui allait être « l’initiateur et l’élément déclencheur » de cette filière de l’océanographie spatiale opérationnelle dont Toulouse peut se targuer aujourd’hui d’abriter le pôle européen dans ce domaine. En effet, suite à cette première mission réussie, il y en a eu d’autres comme Jason-1, lancé en 2001, puis Jason-2, mis sur orbite en 2008, enfin Jason-3 qui, bientôt, prendra lui aussi les direction de l’espace, et entre temps Saral, fruit d’une coopération franco-indienne, lancé en février dernier. Autant de missions dont les données collectées, associées à celles d’autres types d’outils, ont permis, via l’intégrateur de données qu’est Mercator, de réaliser de la prévision océanique et de produire un premier bulletin global de l’océan dès 2005. Et c’est dans ce contexte qu’ont pu émerger progressivement de multiples application opérationnelles développées et proposées par des entreprises comme CLS. Prochaine étape, SWOT (Surface Water Ocean Topography), une mission, là encore, fruit d’un partenariat franco-américain, qui, avant la fin de la décennie, ne couvrira plus seulement l’océan mais aussi tous les lacs, les fleuves et les rivières.

« Tout a commencé il y a une trentaine d’années, au sein d’un groupe de géodésiens du groupe de géodésie spatiale du Cnes et une petite poignée d’océanographes visionnaires », se rappelle Annie Cazenave, chercheur au sein du Laboratoire d’Etudes en Géophysique et Océanographie Spatiales, le LEGOS (CNRS/CNES/IRD/OMP/Université Toulouse 3), professeur au Collège de France et membre de l’Académie des Sciences. « Ils prônaient l’utilisation du satellite pour étudier cet énorme milieu qu’est l’océan et que l’on ne connaissait pas du tout », précise-t-elle. En effet, les chercheurs disposaient bien de quelques mesures, notamment de température et de salinité, qui étaient effectuées parfois par des bateaux, le long des routes commerciales. Mais aucune vision globale en trois dimensions. Avec l’essor de l’océanographie spatiale, les chercheurs ont réalisé une énorme moisson de découvertes. « Nous avons découvert notamment que l’océan, comme l’atmosphère, est turbulent. Les grands courants, constitués de tourbillons qui naissent et meurent, transportent 90% de l’énergie cinétique de la circulation océanique », indique-t-elle. L’océan est apparu aussi comme un acteur majeur du système climatique. Les chercheurs s’en doutait. Mais l’océanographie spatiale a pu le confirmer. D’autre part, en poussant les performances du système altimétrique jusque dans ces derniers retranchements, les chercheurs ont pu, pour la première fois, mesurer de façon globale la hausse du niveau des mers qui est une des causes du réchauffement climatique. « Nous avons découvert alors que la mer ne monte pas partout à la même vitesse ».

Au-delà de tous les services que les données satellitaires ont pu générer depuis cet essor de l’océanographie spatiale, les chercheurs toulousain du LEGOS et leurs partenaires ont commencé, dès le début des années 2000, à utiliser l’altimétrie pour étudier non plus l’océan mais les eaux continentales. Le problème est que les missions en orbite ne sont pas optimisées pour ce type de travaux. Ce qui a conduit la communauté scientifique toulousaine a imaginer et proposer une nouvelle mission, avec le support technique du Cnes. Baptisée SWOT, celle-ci, dont la résolution au sol sera de 50 mètres partout sur la planète, annonce une nouvelle révolution, notamment en matière de gestion des ressources en eau. Ainsi l’aventure se poursuit, une aventure qui a été rendue possible il y plus de vingt ans en particulier par la mise en place d’une structure originale regroupant chercheurs, ingénieurs et industriels, tous travaillant ensemble avant, pendant et après chaque mission. Autre facteur de réussite selon Annie Cazenave, la création d’une structure opérationnelle de traitement et de distribution des données à laquelle les scientifiques ont été associés. Enfin, le fait qu’un certain nombre d’organismes implantés à Toulouse (Méteo France, Shom, Cerface …) aient été impliqués très tôt dans ces développements de l’océanographie spatiale, a joué un très grand rôle dans la réussite globale de cette filière. « Nous avons démontré que nous n’avions pas besoin d’avoir l’océan à Toulouse pour développer cette extraordinaire filière qu’est l’océanographie spatiale opérationnelle », se félicite Martin Malvie, Président du Conseil Régional de Midi-Pyrénées.

En savoir plus

Publié par Pierre Thouverez