Ixelles, octobre 2086. Les étangs de Flagey, bicentenaires, s’étendent à l’est du capitole. Après quelques jours de froid, la douceur est de retour et la surface de l’eau renvoie les couleurs flamboyantes de l’automne.

Les ruches artificielles bourdonnent de milliards d’abeilles électroniques qui produisent le miel et pollinisent les plantes. Dire qu’il a pratiquement fallu attendre la disparition de la dernière abeille organique pour trouver comment produire les enzymes nécessaires à la fabrication du vrai miel et à la pollinisation des plantes.

Depuis, grâce à ces petites merveilles de technologie, les arbres fruitiers venus remplacer les tours d’immeubles détruites pendant la guerre de 2017, font le bonheur des habitants du district.

Les autres districts ne sont pas en reste. À Uccle, la vallonnée, les vignes produisent de délicieux raisins. Et à Laeken, dans les anciens jardins du Palais royal, les champs de pommes de terre et de blé fournissent largement de quoi nourrir les habitants.

Pourtant, il n’en a pas toujours été ainsi. Séraphine Perrin, jeune archiviste, s’en souvient. Enfin, elle s’en souviendrait si elle était consciente parce que pour le moment, elle est alitée dans l’unité de soins B12, – comme la vitamine -, et plongée dans une sorte de coma. Cela fait près de deux jours qu’elle est dans cet état. Depuis qu’on l’a retrouvée, effondrée sur son poste de travail à l’Institut de l’Histoire et du souvenir.

Séraphine Perrin est chargée d’encoder numériquement les documents du passé, tous domaines et tous supports confondus, afin de créer une base de données collective accessible à tous. Elle adore son travail, il lui permet de découvrir des choses dont elle n’avait jamais entendu parler jusqu’ici.

Il faut dire que depuis que les écoles n’existent plus, on apprend selon ses envies, pour soi-même ou parce qu’on a été désigné par le district pour exercer tel ou tel métier. Aujourd’hui, on accède à la connaissance en achetant à volonté des crédits via sa puce : 10 crédits en math, 20 crédits en chimie, 5 crédits en mycologie ou 30 en peinture à l’huile. Et quand je parle de district, il faut voir cela comme ce qu’on appelait avant une « commune » ou une « ville ».

Il n’y a plus d’états, plus de pays, plus de régions. Enfin, officiellement. Après les bombardements des missiles russes et ses millions de morts, la population mondiale a fortement diminué. Au début du siècle, l’ONU estimait qu’on serait environ dix milliards d’êtres humains sur Terre en 2090 mais nous sommes à peine plus de la moitié.

La mondialisation n’est plus qu’un vague concept. Et nous sommes pratiquement revenus à un système féodal. La technologie moderne ayant remplacé les gardes armés et le bourreau. L’économie locale, les petits commerces de proximité… nous y sommes. Un peu forcés par la crise mondiale du pétrole et autres combustibles polluants mais nous y sommes. Les gens peuvent encore se déplacer sur de longues distances, le carburant à base de déchets et d’algues fonctionne parfaitement mais ils n’ont plus envie de partir loin. Et s’il leur prenait quand même l’envie de fuir, un petit réglage de la puce et c’est arrangé.

Ah ! La fameuse puce justement. Parlons-en ! C’est quand même à cause d’elle que Séraphine est dans cet état…

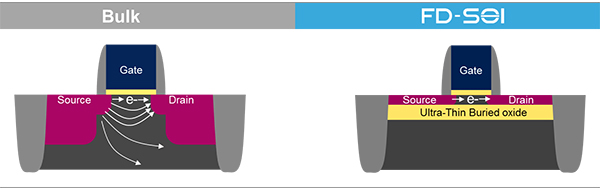

Chaque être humain vit avec une puce multifonctions, une cfH « chip for Humans » en anglais dans le texte, implantée dès la naissance au niveau du poignet. Elle contrôle tout, contient toutes les informations médicales, administratives, judiciaires et financières d’une personne. Pour effectuer une transaction, plus besoin de portée wifi. Il suffit de poser sa main sur un appareil ou directement sur le poignet de quelqu’un d’autre pour faire un transfert d’argent ou de données.

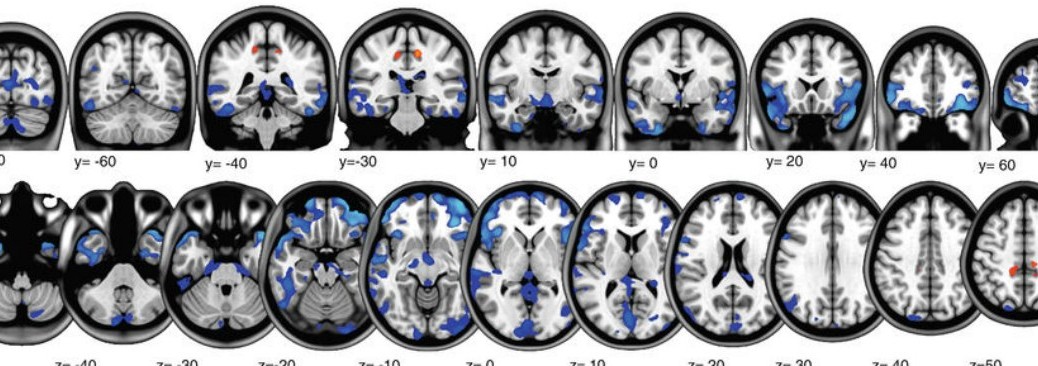

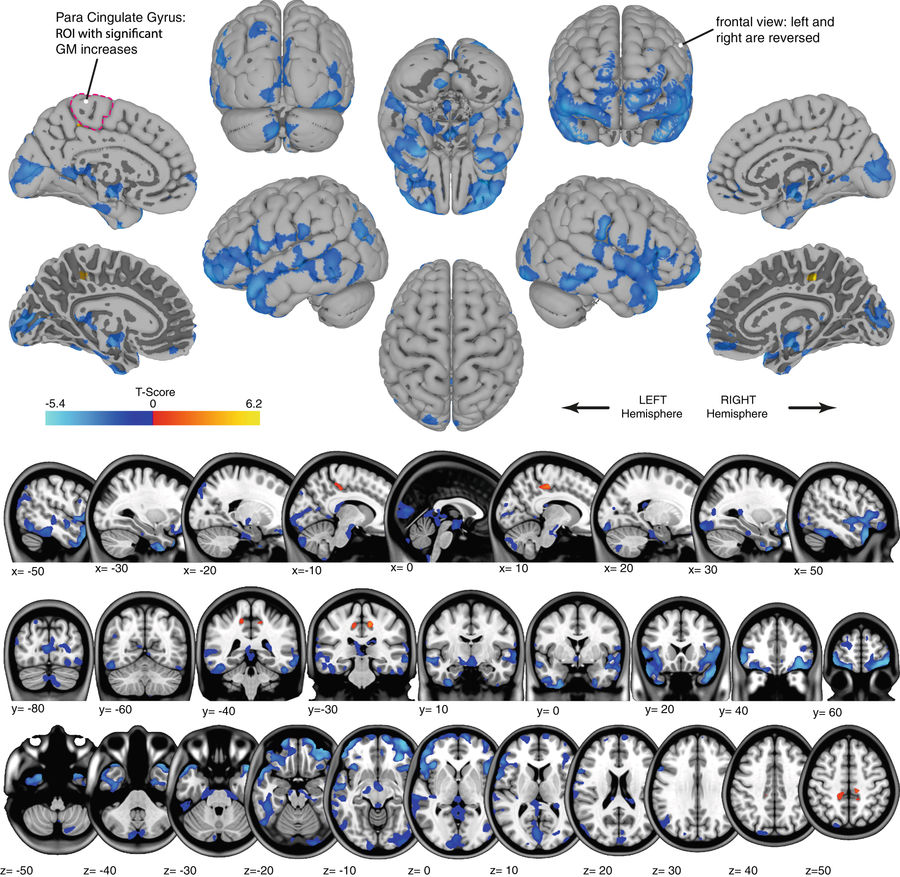

Pour faire simple, disons que la puce est reliée dans chaque district à un super ordinateur qui reçoit des données sur le rythme cardiaque, l’activité neurologique, le sang, et les pensées de chaque personne. La cfH envoie des informations, mais sert aussi à en recevoir, ce qui veut dire qu’avec la puce sous votre peau, vous êtes à la merci des chefs de districts : ils peuvent vous rendre au choix euphoriques, excités, déprimés, suicidaires, sereins voire dangereux si besoin.

Vous vous sentez triste et cela nuit à votre productivité ? Hop ! Un peu d’endorphine injectée à distance dans le cerveau via la puce et tout va mieux. Vous êtes fatigués et ne rêvez que de votre lit douillet ? Hop ! Un peu d’adrénaline via la puce et vous voilà frais et dispos.

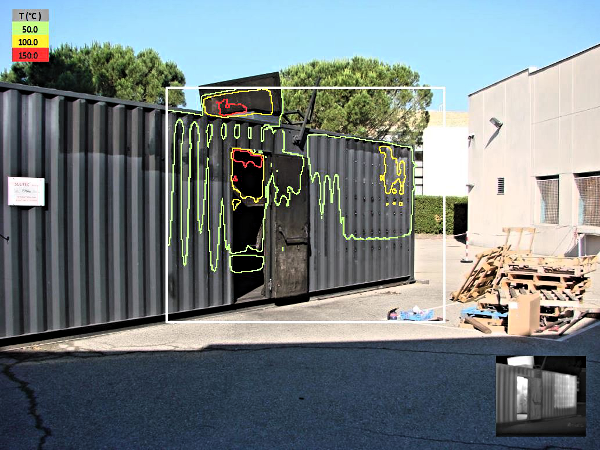

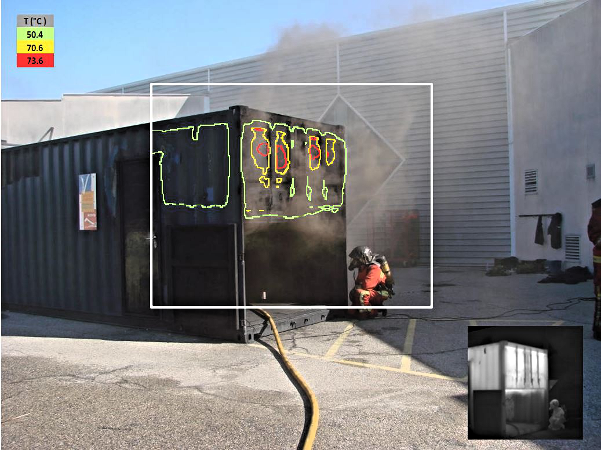

Fiévreuse et tremblante à la fois, Séraphine Perrin est au plus mal. Les médecins sont perplexes : de tels symptômes ont quasiment disparu à notre époque et ils s’interrogent sur ce qu’il convient de faire. Il semblerait que la jeune femme ait été victime d’une violente cyberattaque.

On raconte qu’un INI (individu non identifié) aurait trouvé le moyen de pirater à distance les puces pourtant ultra-sécurisées, de voler toutes les informations et crédits qu’elles contiennent et au final, de tuer les victimes en leur implantant un virus. Car si la puce soigne la plupart des maladies, elle peut aussi rendre malade voire tuer. Cela s’avère parfois pratique pour mettre de l’ordre dans les affaires des districts mais ici, au contraire, cela fait plutôt désordre… Surtout quand les victimes semblent être choisies de façon aléatoire.

Soudain, un bip aigu caractéristique se fait entendre à trois reprises. La patiente vient de se réveiller. C’est inattendu. Aucune des autres victimes ne s’en était sortie jusqu’alors. En fait, aucune n’a été retrouvée vivante avant Séraphine Perrin.

À son chevet, une policière la fixe en silence. Elle est arrivée dès que l’unité de soins B12 lui a signalé le réveil. Une victime vivante, c’est une chance inespérée de collecter des informations et de trouver le coupable.

– Que… Qu’est-ce que je fais ici ? Où suis-je ? demande Séraphine Perrin d’une voix pâteuse.

– Vous êtes à l’unité de soins B12. Je suis l’enquêtrice Miss Marple. Pouvez-vous décliner votre identité, s’il vous plaît, répond la policière.

– Mon identité ? Je ne comprends pas. Vous ne savez pas qui je suis ? Scannez ma puce ! s’étonne Séraphine.

– Vous avez été victime d’une cyberattaque. Votre puce a été gravement endommagée et les données ne sont plus lisibles. Nous allons devoir la retirer pour pouvoir procéder à une analyse complète, sans mettre votre santé en danger, annonce l’enquêtrice du ton le plus neutre possible.

– Retirer la puce ? C’est possible ? s’écrie-t-elle. Elle lance un regard inquiet vers le médecin. Celui-ci hoche la tête et lui sourit, comme pour lui signifier que tout ira bien. En fait, il n’en sait rien. Il n’a jamais pratiqué une ablation de cfH sur un être vivant. Le corps humain est tellement en symbiose avec la puce qu’en vérité, personne ne sait quelles conséquences cela pourrait avoir de la retirer. Il va falloir faire une anesthésie « extérieure », à l’ancienne et découper la chair. Heureusement, le robot chirurgien peut s’en occuper sans problème.

Rassurée par l’attitude encourageante du médecin, Séraphine accepte de collaborer à l’enquête. De toute façon, elle n’a pas vraiment le choix. Sans puce, elle est complètement démunie. Elle n’a plus d’argent, plus d’identité, plus rien.

– Je m’appelle Séraphine Perrin, n° 060.07.10.13864. Je travaille à l’Institut de l’Histoire et du souvenir. S’il vous plaît, aidez-moi à retrouver ma vie, implore Séraphine. Elle sent un drôle de picotement au niveau des yeux et de l’eau lui trouble la vue. Des larmes ? Oui, cela ressemble à ce qu’elle avait vu dans ce vieux film qu’elle a encodé dernièrement à l’Institut. Quelle étrange sensation…

On trouvera le coupable ! affirme avec assurance l’enquêtrice.

– Racontez-moi ce qui s’est passé en détail.

Séraphine se dit qu’elle a de la chance d’être tombée sur Miss Marple. Il paraît qu’elle traite bien les gens. Elle aurait pu tomber sur l’Inspecteur Harry ou sur Philip Marlowe qui se seraient montrés moins tendres avec elle.

Les inspecteurs de police ne sont plus ces humains aux tenues débraillés, mi-alcooliques, mi-colériques, intelligents mais brutaux. En fait, ils ne sont plus humains. Ce sont des robots capsuloïdes d’approximativement 1,5 m de haut, en métal blanc et blindés, bien sûr. On leur a donné les noms de détectives ou flics légendaires pour les rendre moins impressionnants pour le public. Leurs capacités sont sensiblement égales mais leurs caractères sont différents.

Ils ont deux bras articulés pour leur permettre de collecter et de manipuler les indices trouvés sur les lieux d’un crime. Ils ont un écran à hauteur du « visage » avec deux yeux et une bouche stylisés, de façon à être le plus multiculturel possible et ne froisser personne, c’est-à-dire qu’ils traitent tout le monde avec la même neutralité électronique. Cet écran sert aussi à montrer des images, prendre des photos, filmer les interrogatoires, une scène de crime ou à montrer les portraits de suspects aux victimes pour les rares lieux où il n’y a pas (encore) de caméras de surveillance ou en cas de panne de celles-ci.

Au niveau du « ventre », ils ont un mini-labo qui leur permet de faire des analyses et leur logiciel interne possède une base de données internationale qui peut mettre en relation des milliards de connexions. Si on trouve par exemple un poil de chien sur une scène de crime à New Paris, on peut aussitôt retrouver le chien et identifier son propriétaire dans la ville surpeuplée de Bakersfield en Californie. Enfin… On ne dit plus Bakersfield mais Second Chance depuis qu’ont échoué les survivants de Los Angeles et San Diego après l’horreur du Big One de la faille de San Andreas. On peut alors voir en direct des images du gars en train de manger une glace. Aussitôt, une alerte est transmise aux robots policiers locaux qui peuvent l’appréhender, si nécessaire.

Vingt-quatre heures plus tard, l’opération s’est bien passée et Séraphine est autorisée à sortir de l’unité B12. On ne peut pas encore lui remettre sa puce qui doit subir un examen poussé mais on lui donne une sorte de badge provisoire qu’elle pourra présenter pour prouver son identité et payer ses quelques dépenses quotidiennes. Le district lui accorde une petite prime, en récompense de sa collaboration à la capture du pirate.

Pour la première fois, Séraphine est envahie par ses propres pensées, ses propres émotions. Elle a peur. Avant, une pression sur la puce et elle se calmait. Elle a mal au ventre et elle ne peut rien faire d’autre que d’attendre que ça passe.

Pourtant, tout n’est pas négatif. Au travail, elle retrouve son collègue Antoine qu’elle côtoie pourtant chaque jour depuis des années mais quelque chose a changé. Elle ne le regarde plus : elle le voit. À son approche, elle ressent une bouffée de chaleur, des sensations bizarres dans l’estomac. Elle appuie par réflexe à l’endroit où se trouvait sa puce mais rien ne se passe.

Que faire ? Ses parents ne peuvent pas l’aider, ils ont toujours vécu avec la puce. Ils ne comprennent pas ce qu’elle veut dire.

Elle interroge alors sa vieille voisine, Manon est née juste avant la guerre, quand la puce n’était encore qu’un obscur projet. Elle lui explique comment c’était avant. Elle lui décrit ce sentiment étrange qui évolue tellement avec le temps mais qu’on ferait tout pour retrouver quand il disparaît. La plus forte des drogues.

Séraphine prend alors conscience d’un autre monde. Elle ne peut mettre des mots sur ce qui lui arrive mais déjà, elle est accro. Elle essaie d’en parler à Antoine mais il ne comprend rien. Des sentiments ? C’est quoi ? Comme dans ces vieilles histoires où les gens font des trucs bizarres ? À quoi ça sert ?

Alors, Séraphine Perrin a une idée folle : elle veut retrouver le pirate qui a pris le contrôle de sa puce. S’il a su faire cela, c’est qu’il a trouvé le moyen d’être hors de contrôle, de ne plus subir l’emprise du district et de se rendre anonyme. Lui seul pourra lui expliquer ces drôles de choses qu’elle sent dans son corps, dans sa tête à tout moment de la journée.

Aussi lorsque quelques jours plus tard, Miss Marple vient lui annoncer qu’elle pourra retrouver sa puce dans une semaine, Séraphine essaie de lui soutirer quelques informations sur l’identité du pirate, savoir si on a retrouvé sa trace.

Bien entendu, Miss Marple, adepte du mystère et surtout, incorruptible comme tous ses collègues, ne veut rien dire. Séraphine s’en doutait un peu mais il fallait qu’elle essaie. Sa décision est prise : elle va pirater le robot policier. Après avoir dépensé 10 crédits en robotique avancée, elle sait parfaitement comment neutraliser un robot policier de type Légende, comme Miss Marple. Appuyer sur une touche sensitive sur le côté droit suffit à désactiver la machine. Le seul hic, c’est que la touche garde en mémoire la trace de l’empreinte digitale. Dès son retour à l’atelier, le technicien de maintenance saura que Séraphine Perrin, n° 060.07.10.13864 a piraté Miss Marple. Tant pis, Séraphine prend le risque et la chance est avec elle.

Elle découvre ainsi l’identité du pirate. Il habite dans l’ancienne abbaye du district de Forest. Rare sont ceux qui osent s’aventurer dans ce quartier, mais Séraphine est déterminée.

À peine a-t-elle fait un pas dehors qu’elle aperçoit une sombre silhouette de l’autre côté de la rue. Le pirate est là ! Il a dû savoir qu’elle le cherchait et il l’a retrouvée, évidemment. Son cœur se met à battre plus fort, elle sent la sueur glacée lui descendre le long de l’échine et elle n’aime pas du tout cette nouvelle sensation.

Le pirate avance vers elle sans la quitter des yeux. Séraphine est pétrifiée. Elle attend tellement de cette rencontre. Quand enfin il est en face d’elle, un seul mot parvient à franchir ses lèvres : Pourquoi ?

L’homme lui explique avoir mené ces attaques pour faire pression sur les chefs de district. Il affirme vouloir retrouver l’humanité tel qu’elle existait auparavant et se sert de la technologie pour montrer les dangers de la modernité.

Choquée par les aveux de cet assassin assumé, Séraphine se précipite chez elle et active d’une voix tremblante le système d’alarme haut de gamme de son appartement.

Elle ne sait plus où elle en est.

Soudain, on sonne à la porte. C’est Miss Marple, en sa qualité d’agent assermenté qui vient lui implanter une puce toute neuve. Toutes ses informations ont été actualisées et son compte bancaire renfloué. Sa vie peut reprendre.

Vraiment ?

Véronique Goossens