- Techniques de l’Ingénieur : M. Saminadayar, vous êtes professeur à l’Université de Grenoble et chercheur à l’Institut Néel au département des nanosciences, c’est bien ça ? Quel est votre champ d’études ?

Laurent Saminadayar : Oui, je travaille depuis 15 ans sur ce qu’on appelle la physique mésoscopique, c’est un des champs dans lesquels ont émergé les ordinateurs quantiques et tout ce qui concerne la cohérence quantique.

- Selon vous, qu’est-ce qui différencie un ordinateur quantique d’un ordinateur classique ?

C’est un problème fondamental. C’est tout l’intérêt de l’ordinateur quantique.

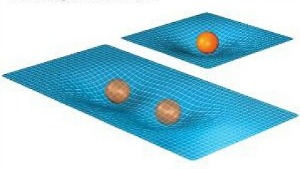

Avec un ordinateur classique, vous effectuez des opérations avec des bits qui seront 0 ou 1. L’ordinateur quantique s’inscrit quant à lui dans un système où le bit se trouve dans un état qui est une superposition de 0 ou 1. Donc au lieu d’avoir 0 ou 1, vous avez une proportion de 0 et de 1.

Quel est l’intérêt ? Ce n’est pas simplement un jeu d’écriture ! Quand votre système est une superposition d’états, c’est un petit peu comme si vous faisiez des calculs parallèles, donc vous allez beaucoup plus vite sur certains calculs. S’il n’y avait que cela, ce ne serait pas très intéressant.

Donc pourquoi est-ce que cela a suscité autant d’engouement ? Parce que cela vous donne la possibilité de changer complètement certains algorithmes, c’est-à-dire la façon-même d’effectuer certains calculs.

En informatique, il existe des problèmes dits « NP complets ». Comment se caractérisent-ils ? Imaginons que vous vouliez faire une opération sur un nombre, par exemple factoriser un nombre en produits de facteurs premiers. Ce problème peut paraître très simple, nous avons tous réalisé des exercices de ce type au collège. Pourtant, pour un ordinateur classique, ce problème est délicat. Pourquoi ? Simplement parce que le nombre d’opérations qu’il lui faudra faire va croître exponentiellement avec la taille du nombre à factoriser. Donc, pour factoriser un grand nombre, c’est long… Et c’est là le principe de la cryptographie, qui permet de coder nos échanges (numéros de cartes de crédit ou données encore plus sensibles…).

Supposons que je veuille vous envoyer un nombre a. Je le multiplie par un nombre premier b, et je vous envoie le résultat c. Mais vous, vous avez la clef, c’est à dire le nombre b ; quand vous recevez c, vous le divisez par b (votre clef), et voilà, vous avez le nombre a que je voulais vous transmettre en toute sécurité. Si je suis un pirate malveillant, j’intercepte le nombre c que vous envoyez ; mais comme je suis un pirate malveillant, je n’ai pas la clef, c’est à dire le nombre b. Donc e demande à mon ordinateur (classique) de factoriser c en produits de nombres premiers, pour récupérer a et b. Si a et b sont des nombres assez grands… je n’arriverai pas à casser le code en un temps… raisonnable.

La sécurité du cryptage est entièrement basée sur cet aspect du problème.

L’ordinateur quantique, lui, n’aurait besoin que de beaucoup moins d’opérations élémentaires pour factoriser mon nombre c en produit de facteurs premiers (en fait, guère plus qu’il ne vous en faudra à vous qui avez la clef, pour diviser le nombre c par votre clef, le nombre b). Là, ça devient très intéressant, car plus besoin de clef pour voir ce que vous avez voulu envoyer ! Donc, dit un peu brutalement :

« Quelqu’un qui sait créer un ordinateur quantique sait créer à peu près tous les codes qui existent actuellement »

- On considère donc qu’il existe un seul modèle d’ordinateur quantique ? Ou plusieurs modèles sont possibles ?

Il y a des variantes autour des algorithmes mais la grande différence intervient au moment où vous passez des bits de 0 et 1 à cette superposition de 0 ou 1.

Il y a des problèmes que les ordinateurs ne peuvent pas résoudre, comme le fameux problème du « voyageur de commerce ». Je suis un voyageur de commerce, je dois passer pour mon travail par un certain nombre de villes. Je me demande donc comment passer par toutes ces villes mais en faisant un minimum de kilomètres ; c’est ce qu’on appelle un problème d’optimisation. C’est un problème difficile à résoudre pour un ordinateur classique car quand vous augmentez le nombre de villes, le nombre de calculs élémentaires nécessaires à la résolution du problème croît exponentiellement. Grossièrement, on peut dire qu’il essaie tous les chemins et qu’il regarde quel est le plus court, car il n’y a pas d’autre façon de faire.

Ce qui a vraiment motivé la communauté scientifique, c’est la factorisation en produits de nombres premiers. Des sommes d’argent énormes ont été investies par les industriels et l’armée qui s’y sont évidemment intéressés de très près car s’ils peuvent factoriser en produits de nombres premiers en un temps « polynomial », ils peuvent casser tous les codes. Au niveau de la cryptographie, si vous savez faire cela, il n’y a plus aucun code qui tient, vous pouvez casser tous les codes, tels qu’ils sont conçus actuellement en tout cas, il faudrait en concevoir d’autres. Actuellement, casser un code est une opération très longue à réaliser. Si vous la rendez beaucoup plus courte, c’est gagné.

Un autre aspect fondamental du problème repose sur la sécurité de la transmission de l’information elle-même. Si vous utilisez un système quantique pour coder et transmettre une information, on peut voir très facilement si votre transmission a été interceptée. C’est le principe même de la mécanique quantique : si je regarde un objet je le modifie, j’agis sur lui… Et je laisse donc ma signature !

- Il n’y a aucun moyen de le voir sur un ordinateur classique ?

Non, si votre transmission est vue, vous ne le savez pas.

Avec l’ordinateur quantique si quelqu’un nous espionne, on le voit tout de suite ! C’est donc très intéressant au niveau de la sécurité des transmissions…

- Que peut nous apporter un ordinateur quantique en dehors de la cryptographie ?

Pour nous, en tant que particuliers, je pense que cela ne nous apportera rien. Parce qu’on n’a aucun algorithme qu’on ne peut pas faire avec un ordinateur classique. En revanche, pour la communication et la cryptographie, c’est vital. Donc cela va plutôt intéresser les gros systèmes, comme l’armée et les banques.

- Est-ce que cela pourrait remplacer des supercalculateurs ?

Pour la plupart des problèmes, un ordinateur quantique n’apporterait aucun avantage par rapport aux supercalculateurs actuels.

« La question importante est : qu’est-ce que vous ne savez pas faire avec un ordinateur classique et que vous pourriez faire avec un ordinateur quantique ? »

Pour les chercheurs, dans certains domaines très spécifiques, un ordinateur quantique peut se révéler intéressant : en effet, il existe certains systèmes physiques très compliqués à simuler avec des ordinateurs classiques, alors que ce serait beaucoup plus efficace avec des algorithmes quantiques.

Mais de façon générale, je pense que si des ordinateurs quantiques voient le jour, ce sera pour répondre à des besoins très spécifiques qui concerneront la recherche, l’armée, les banques, mais sans doute pas les particuliers…

- Même s’il y a une plus grande puissance, une plus grande capacité de calcul ?

Pour faire des calculs classiques, il n’ira pas plus vite qu’un ordinateur classique. Il y a des problèmes qu’il sait résoudre qu’un ordinateur classique ne sait pas résoudre. Mais sur les problèmes standards qu’un ordinateur sait parfaitement bien gérer, il ne saura pas faire grand-chose de plus…

- L’ordinateur quantique est basé sur un principe de probabilité, c’est bien ça ? Comment peut-on faire confiance à un ordinateur basé sur quelque chose de probable ?

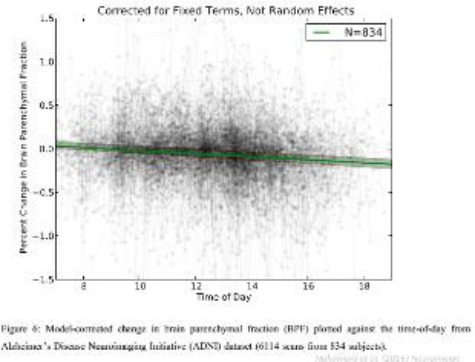

On répète l’expérience. On le fait plusieurs fois en parallèle pour en en sortir les probabilités. Donc cela fonctionne bien, ce n’est pas un gros problème. Mais ce qui est important, c’est que le support de codage que vous utilisez, le fameux « bit quantique », ne soit pas altéré trop vite. Au départ, on crée une superposition de 0 et de 1. Mais malheureusement, ce genre d’objet quantique n’a qu’une envie, c’est de redevenir un bête 0 ou 1 : c’est ce qu’on appelle la décohérence. Il faut donc que notre superposition dure assez longtemps, que son « temps de cohérence » soit assez long, pour qu’on ait le temps de faire les calculs souhaités… et ça, c’est un problème très compliqué.

Il faut sans cesse vérifier que votre système reste dans le même état quantique, qu’il n’a pas été perturbé ! Parce que le problème, c’est qu’il faut qu’il reste dans cet état quantique suffisamment longtemps pour qu’on ait le temps de faire le calcul et c’est un énorme problème actuellement. On ne sait pas le faire.

- Parce que cela bouge tout le temps ?

Disons que la moindre perturbation extérieure transforme votre superposition initiale en un simple 0 ou 1. Imaginons qu’on commence un calcul, tout se passe bien ; et puis, par exemple, votre q-bit va être heurté par un photon (une particule de lumière). Pour lui, c’est un grand coup sur la tête. Au beau milieu du jeu, votre superposition de 0 et de 1 devient un simple 0 ou un simple 1. Le carrosse se transforme en citrouille, le calcul ne peut plus se faire, c’est perdu.

C’est le problème contre lequel tout le monde lutte actuellement et que personne n’arrive à résoudre.

Pour être plus précis, il existe différentes sortes de q-bits. D’une part, vous avez des q-bits réalisés (presque) de la même façon que les circuits intégrés actuels. Donc, on sait en faire un très grand nombre sur une toute petite surface, et on peut aisément envisager de les utiliser dans un ordinateur. Mais voilà, ce sont aussi les plus sensibles aux perturbations extérieures, disons que leur temps de cohérence est de l’ordre de la micro-seconde, et il semble difficile de résoudre ce problème. Et puis il y a des systèmes plus « exotiques », comme des ions piégés dans des « pièges optiques ». Ces systèmes sont beaucoup moins sensibles aux perturbations extérieures, ce qui est un gros avantage. Mais voilà, le problème est qu’ils ne sont pas très pratiques à manipuler : mettre 5 q-bits ensemble prend une pièce entière, alors des millions… Bref, des deux côtés, l’affaire semble buter sur des problèmes sérieux…

- Qu’est-ce que le temps de cohérence exactement ?

C’est simplement le temps où le système va rester dans un état de superposition entre 0 et 1. En général, vous n’avez pas le temps de finir votre opération qu’il va se mettre dans un bête état de 0 ou 1. Cela limite énormément les possibilités de ces systèmes-là.

- Donc l’optique et le solide sont deux sortes d’ordinateurs quantiques ?

Oui tout à fait, mais « ordinateur », c’est un grand mot, là on parle de 3 ou 4 q-bits… Un ordinateur classique actuel, ce sont des millions de bits… Et dans le cas de l’ordinateur quantique, on a déjà du mal à faire marcher ces 3 ou 4 q-bits ensemble…

- Et il en faudrait combien pour que cela fasse un ordinateur ?

Je dirais… des dizaines pour que cela commence à être intéressant. En tous cas, plus que 2…

- Parce que là, avec 2 ou 3, les performances sont très limitées ?

Non… vous savez le mieux qui a été réalisé de mieux, avec des des q-bits faits d’ions piégés, a été de factoriser 15 en 3 x 5. C’est une preuve de principe, cela fonctionne. On peut dire que c’est un début…

Ce qui est intéressant en revanche, et très mystérieux, c’est ce qu’on appelle le projet D-Wave de Google. Ils prétendent que cela fonctionne. Le seul problème, c’est que personne n’a le droit de voir ce qu’il y a dedans. Ils n’apportent pas de preuve définitive qu’il s’agit bien d’un ordinateur quantique. Il y a des gens qui pensent que c’est uniquement une opération marketing. On vous montre une belle voiture, on vous dit que le moteur est révolutionnaire, mais on n’a pas le droit de soulever le capot pour voir ce qu’il y a dedans. Donc on peut avoir de très sérieux doutes. En laboratoire, on ne parvient pas à faire marcher 3 q-bits et eux prétendent en faire marcher 500 ? Soit ils ont réussi là où tout le monde a échoué, à savoir résoudre ce fameux problème de la décohérence, soit il s’agit d’une immense opération d’intox….

- Ce sont les seuls qui sont en train de développer un ordinateur quantique actuellement ?

Oui, ce sont les seuls au niveau industriel. Sinon, c’est dans les laboratoires. Après, vous avez toujours des effets d’annonce. IBM avait annoncé qu’ils développaient un ordinateur quantique, on n’a encore jamais rien vu. C’est un peu du business, pour prendre position sur tel ou tel domaine.

- Vous avez dit que cela avait surtout un intérêt pour les chercheurs et les banques, quel serait l’intérêt pour Google de développer un ordinateur quantique ?

S’ils sont les seuls à savoir le faire, on sera tous obligés de passer par eux.

« Celui qui sait créer un ordinateur quantique a tiré le jackpot. »

- Pourrait-on un jour imaginer une application au niveau des particuliers ?

Non actuellement je ne connais personne qui imagine une application au niveau des particuliers. On reste au niveau des grands organismes, banque, armée… Le marché est énorme et comme, en plus, il y a un aspect militaire c’est stratégique. C’est ce qui fait couler beaucoup d’encre… On a réalisé ce que cela représentait, même si la probabilité que cela marche est extrêmement faible. Mais si jamais cela marche, les conséquences sont énormes.

- Mais qu’est-ce qui nous bloque actuellement ?

Le principal obstacle, c’est que ces systèmes de bits quantiques ne restent pas cohérents assez longtemps. Il y a 10 ans, les gens disaient : il n’y a aucune raison que cela ne dure pas plus longtemps. Ils ont raison sur le principe ! Mais dans la réalité personne n’y arrive, pourquoi ? On ne sait pas…

- Ils sont trop perméables à ce qui se passe à l’extérieur ?

Oui ils sont trop perméables à l’environnement, donc on essaie de fabriquer un joli bit quantique, d’assurer la superposition de 0 et de 1 et puis, à un moment, vous avez quelque chose qui va rompre cet équilibre. Imaginez que vous faites un château de cartes : si quelqu’un ouvre la fenêtre et qu’il y a du vent, tout se casse la figure. C’est trop fragile. Ce sont des constructions qui ne sont pas stables. Et actuellement, elles tiennent debout seulement quelques microsecondes. Il y en a qui se sont lancés dans des calculs savants pour savoir le temps de cohérence minimal qu’il faudrait atteindre pour que le système soit utilisable, éventuellement en incluant des systèmes de corrections d’erreur etc. Mais on est encore loin du compte !

- Mais par quoi est-ce perturbé ?

Par la chaleur, le rayonnement électromagnétique, et aussi un facteur important qu’on ne sait pas trop quantifier : il y a des charges électrostatiques qui se promènent dans les puces. Il faut savoir qu’il y a toujours des petites charges qui bougent à la surface, ces charges créent un champ électrique qui perturbe énormément le système. Donc de nombreux chercheurs travaillent là-dessus dans le but d’éliminer toutes les charges en surface… C’est une des hypothèses pour expliquer que cela ne marche pas pour le moment.

- On pourrait envisager un ordinateur quantique d’ici combien de temps ?

Je crois que maintenant plus personne ne fixe de délais… Nous sommes vraiment sur un os. Donc arriverons-nous à le surmonter ou pas ?

En fait, je comparerais un peu le système aux débuts de l’ordinateur. A l’origine, les ordinateurs étaient dans de grandes armoires qui prenaient énormément de place. Et un jour, on a créé le circuit intégré. Si on n’avait pas créé le circuit intégré, et qu’on n’avait pas eu la possibilité de graver tout cela sur une puce de 2 cm, on n’aurait jamais eu l’évolution qu’on connait car cela aurait été ingérable. Cela a vraiment été une révolution.

Pour l’instant, on en est à une preuve de principe. Tant qu’on n’aura pas trouvé la solution pour garder un temps de cohérence suffisamment long, cela n’ira pas plus loin. Actuellement, on ne connait pas la solution, mais peut être qu’elle sortira un jour…

Au niveau de la cryptographie, cela aurait des conséquences énormes car dans nos sociétés où tout est codé : communications bancaires, commerciales, mots de passe sur ordinateur, etc. si quelqu’un était capable d’intercepter tous les codes… Une armée qui communique à distance c’est toujours codé…

L’ordinateur quantique permettrait un énorme saut. Ce ne serait pas une amélioration, mais un saut !

Il faudra trouver une façon complètement différente de crypter. Pour le moment, on n’a aucune idée de la façon dont on pourrait crypter. Car tous les cryptages actuels sont plus ou moins compliqués mais ils sont tous basés sur le même principe. Si ce principe ne fonctionne plus, vous ne savez plus coder.

- Donc l’ordinateur quantique pourrait être dangereux…

C’est justement pour cette raison que cela intéresse les gens…

Actuellement, si vous envoyez un code et qu’il faut dix jours pour le décoder, ce n’est pas forcément intéressant. S’il faut dix minutes, là c’est autre chose ! C’est ce qui est en jeu. Si on peut faire cela, cela changera énormément de choses au niveau mondial, militaire, etc.

Je pense que les milliards qui ont été engloutis là-dedans, ce n’est pas pour rien. Derrière, les enjeux sont faramineux. Et c’est pour ces enjeux que les gens sont prêts à payer énormément. Même s’il y a une chance infime que ça marche, comment passer à côté de cela ?

C’est vraiment stratégique au niveau de tous les domaines importants de notre société : défense et banques notamment. Actuellement, quand vous envoyez un ordre à une armée, le problème n’est pas tant d’intercepter le message mais plutôt de le décoder.

Le tournant de la guerre du Pacifique, cela a été le moment où les alliés ont réussi à décoder les messages des Allemands. C’était fini, on savait où étaient les sous-marins. Là nous sommes un petit peu dans le même enjeu.

« Si vous avez un ordinateur quantique, c’est comme si vous possédiez la machine Enigma, vous savez tout décoder. »

Actuellement, on sait décoder bien sûr, mais on se heurte toujours au même problème : c’est long, car factoriser en produits de nombres premiers est quelque chose d’intrinsèquement long, on ne sait pas faire autrement avec un ordinateur classique. Si vous avez un outil qui réalise cela beaucoup beaucoup vite, vous avez gagné. Et là c’est évident que ça intéresse tout le monde…

Propos recueillis par Iris Borel

Et aussi dans les

ressources documentaires :