Søren Hermansen est le directeur de la Samsø Energy Academy. Samsø est la première île au monde où 100 % de l’électricité provient des énergies renouvelables.

Parlez-moi de Samsø

Samsø est une île danoise de 100 km2 et de 3700 habitants. Elle a conservé son statut de municipalité insulaire lors des réformes structurelles après la crise grâce aux conditions très spéciales de l’île. Cela nous a donné l’autonomie de prendre des décisions localement.

L’énergie de l’île provient à 100 % d’énergies renouvelables. De quels types d’énergie renouvelables parlons-nous ?

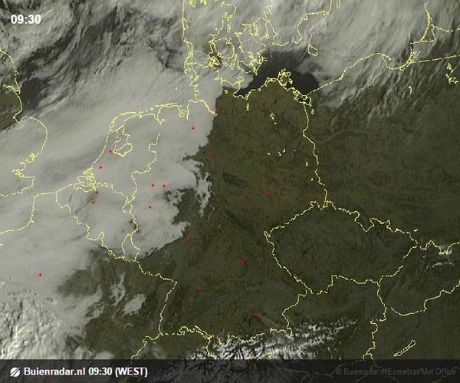

Le plus grand changement a été de passer de l’électricité importée des centrales à charbon à l’électricité produite localement par les éoliennes. Nous avons également environ 10 % d’énergie solaire, mais le reste provient de l’éolien.

Pour le chauffage, nous sommes passés du chauffage au mazout à un nouveau système. Nous n’avons pas de gazoduc, comme ailleurs au Danemark, où le gaz naturel arrive de la mer du Nord. Désormais, les maisons des zones densément peuplées sont toutes chauffées grâce à un système de chauffage urbain, qui envoie de l’eau chaude à tous les foyers Ce système est alimenté par de la paille locale, des copeaux de bois provenant des forêts et des panneaux solaires thermiques.

+Efficacité+

J’imagine que l’efficacité énergétique est également un facteur clé de ce nouveau système ?

Oui, nous nous sommes fixés un objectif de réduction de 20 % de notre consommation d’énergie. C’était très intéressant, car lorsque nous avons mis en place les installations énergétiques dans les maisons, nous devions parfois rappeler aux habitants qu’ils devaient équiper leurs maisons pour recevoir le chauffage du quartier. Les gens se sont laissés convaincre facilement qu’installer de nouvelles fenêtres, isoler les toits et les murs étaient de bonnes idées.

La durée d’amortissement des rénovations pour l’efficacité énergétique est de 2 à 5 ans, il est donc incroyable que les gens ne l’aient pas fait avant, mais c’est seulement par manque d’information.

Actuellement, Bruxelles a placé l’efficacité énergétique dans les priorités de son programme de travail.

Nous devons réfléchir aux façons de convaincre les gens que c’est à eux de prendre ces mesures.

Il faut les encourager à acheter des parts dans l’éolien afin de dépasser la mentalité « pas dans mon jardin ».

Beaucoup de projets échouent car les gens ont peur des changements. Les bénéfices potentiels ne font pas le poids face à la peur du changement. J’ai fait face à ce problème tant de fois que j’ai su qu’il était temps de le prendre à bras-le-corps et de trouver un moyen de le résoudre. Les gens s’intéressent beaucoup plus à un projet s’ils y prennent part, s’ils y ont investi une partie de leurs économies.

Quel est le retour sur investissement ?

Il se situe entre 6 et 8 %.C’est donc mieux que de laisser son argent à la banque.

On dit souvent que le problème avec les renouvelables c’est que ce sont des sources d’énergie inconstantes. Est-ce un problème sur l’île ?

Il y a toujours du vent, beaucoup plus qu’ailleurs, et il y a également plus de soleil qu’ailleurs. Nous avons une brise marine constante et pendant l’été nous avons beaucoup plus de soleil que le reste du pays. Ce n’est pas que sur les cartes postales, c’est vrai !

Qui paye pour tout cela ?

Les citoyens, mais ils n’ont pas rassemblé assez de ressources, alors les banques ont largement contribué aussi. Mes amis ingénieurs ont réalisé les plans d’aménagement et mon rôle a été d’établir le plan structurel, en intégrant les permis de construire, les plans des ingénieurs et l’aspect financier du projet.

Étant donné que les banques ne prêtent plus autant qu’avant, y avait-il une garantie de fonds publics pour ce projet ?

Voilà pourquoi c’est bien d’être Danois ! Nous avons un tarif de rachat garanti pour l’énergie éolienne. Donc à partir du moment où vous signez un contrat, vous avez un prix minimal garanti par Kw/h pour les dix prochaines années.

Le nouveau projet d’Union de l’énergie s’oppose vivement aux tarifs de rachat nationaux.

Oui, à plusieurs reprises le Danemark s’est retrouvé en difficulté à cause de cela. Le souci c’est qu’ils envisagent le problème à l’envers. Si vous avez un objectif écologique, le marché ne vous aidera pas à l’atteindre. Et si le marché dit non, s’il y a déjà trop d’énergie sur le marché, alors l’UE s’est tirée une balle dans le pied en disant qu’elle n’était pas d’accord avec les tarifs de rachat. Je pense que c’est une approche ignorante.

Grâce aux interventions de l’État, le Danemark est désormais numéro 1 de l’énergie éolienne dans le monde.

C’est peut-être pour cela que certains États membres n’apprécient pas ce système mais je crois que nous devons nous accrocher à cela et nous demander où nous voulons arriver en 2020. Si nous voulons atteindre nos objectifs, nous devons trouver les instruments et les moyens pour y arriver. Et si un tarif de rachat minimal est un moyen suffisant pour susciter l’intérêt des banques dans ce domaine et donc pour que tous ceux qui ont un projet de développement qui intègre des éoliennes puissent aller à la banque et obtenir l’argent dont ils ont besoin, alors nous devrions utiliser cet outil.

À Bruxelles, les importations d’énergie sont devenues un sujet brûlant avec le conflit ukrainien. De quelles leçons pouvons-nous tenir compte ?

C’est la même chose mais à plus grande échelle. Ici, nous craignons aussi de dépendre de quelqu’un que nous ne pouvons pas contrôler. Comme de nombreuses zones rurales dans l’UE, Samsø est une commune à faible revenu, l’argent est donc à dépenser avec parcimonie. Si vous voulez développer des zones rurales, vous devez trouver de l’argent, et cet argent peut provenir des économies réalisées en évitant d’importer des combustibles couteux et en les produisant soi-même. Cela signifie que vous créez des emplois et donc des revenus imposables dans ces régions et que vous ne laissez plus le marché décider pour vous.

Peut-on transposer les pratiques de Samsø à la politique de l’environnement urbain de l’UE ?

Bien sûr, mais si on ne les envisage pas dans les milieux ruraux, alors elles ne seront jamais appliquées en ville car les enjeux sont trop importants. Les grandes entreprises n’apprécient pas ce système car elles veulent contrôler le marché. Si nous sommes responsables de notre propre production et distribution d’énergie, alors nous ne voulons pas dépendre des aides d’État car si le marché est présent nous pouvons contrôler les coûts et l’administration et ainsi de suite.

Je suis en faveur de l’explosion des sièges sociaux ! Je ne suis pas un terroriste, mais je crois en la décentralisation. Il y a énormément d’argent dans les caisses, qui attend d’être investi, mais les entreprises ne s’intéressent pas aux projets individuels, tout ce qu’elles voient, ce sont votre consommation et vos factures.

Regardez le Royaume-Uni, l’efficacité énergétique y est très limitée. Si vous vous rendez dans de nombreux villages isolées, les logements sont dans de très mauvaises conditions, mal isolées et n’ont pas de chauffage urbain alors qu’il y a des bois juste derrière le village. Pourquoi n’ont-ils pas tout ça ? Parce que nous n’avons pas d’outils pour les aider à mettre en place des solutions plus efficaces.

Quelle aide est attendue de la part des décideurs politiques de l’UE à l’avenir ? Que diriez-vous aux responsables de la DG Environnement ou au commissaire en charge de l’action pour le climat ?

Je me suis adressé à eux à maintes reprises mais ils n’écoutent pas ! Je leur ai fait le même genre de discours et ils ont ri. Ils pensent que je suis un plaisantin.

Ils se confortent dans leur idée que les géants de l’industrie et les structures d’urbanisation sont les facteurs les plus importants, que tout est déterminé par le marché. Les conditions sociales et culturelles de l’UE influencent aussi beaucoup de secteurs. Il faut qu’ils remarquent à quel point les petites structures indépendantes ont soutenu de grandes perspectives pendant des années et des années.

Le local est la clé du succès et du développement. Nous devrions souligner le ridicule du marché. L’UE le contrôle déjà tellement que nous ne pouvons plus le qualifier de marché libre.

Pourquoi ne pas changer d’attitude et se dire, « ok, peut-être que les tarifs sont différents dans l’UE mais ce n’est pas grave » ? C’est plus cher au Danemark, ok, c’est moins cher dans le sud de la France, ainsi soit-il. Nous ne devons pas être si tatillon à propos du marché, mais peut-être l’ouvrir un peu et accepter l’idée d’une UE variée et avec des solutions multiples.

En résumé, tout l’opposé de l’Union de l’énergie

Je sais, tout le contraire ! Je déteste l’admettre ! Ce que nous craignons le plus, c’est que Poutine coupe les robinets de gaz. Pourquoi sommes-nous tant obnubilés par ça ? Pourquoi ne créons-nous pas notre propre réseau énergétique indépendant, et pourquoi ne l’avons-nous pas fait il y a des années déjà ?

Consulter le site de : Samsø Energy Academy

Source : EurActiv. fr (James Crisp, traduit de l’anglais)