Quelle quantité d’énergie produit-on en investissant $100 milliards dans le solaire photovoltaïque (PV) ?

Kepler-Cheuvreux part des données observées dans le monde réel. En 2013, 39 GW de PV ont été installés dans le monde, à un coût moyen de 3 dollars par watt installé. Ceci tous pays et toutes catégories confondus : solaire résidentiel et commercial, ainsi que grandes centrales au sol. En 2012 le facteur de capacité moyen du parc PV mondial était de 13%. Un dixième des 100 milliards est utilisé pour financer la maintenance des installations. Avec l’ensemble de ces hypothèses la production électrique est alors de 35 TWh par an. Pendant plus de 20 ans.

Il s’agit ici de l’énergie « brute ». Kepler-Cheuvreux s’est intéressé également à l’énergie réellement disponible en sortie de moteur thermique ou électrique, c’est-à-dire à l’énergie « nette ». L’efficacité énergétique de la prise à la roue d’un véhicule électrique est de 70 à 75%. Celle d’un moteur thermique de 20 à 25%. Kepler-Cheuvreux a retenu volontairement une hypothèse défavorable à l’électrique, 70%. Et favorable au moteur thermique, 25%. Pour le PV il faut aussi tenir compte des pertes électriques en transmission qui sont d’environ 2,5%: la consommation a souvent lieu à proximité de la production. Ce qui fait un rendement depuis la sortie du panneau PV jusqu’à la roue du véhicule électrique de 67,5%. Sur les 35 TWh bruts d’électricité PV obtenus chaque année, il reste 24 TWh nets.

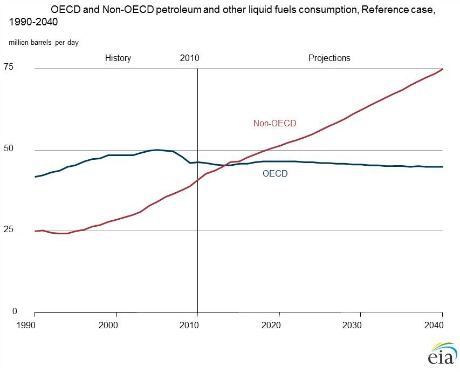

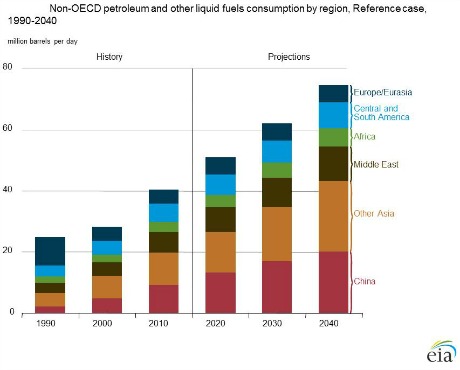

Pétrole offshore profond ou des sables bitumineux : extraire le précieux liquide fossile devient de plus en plus difficile. Avec un coût d’équilibre des projets pétroliers à 100 dollars le baril, en investissant 100 milliards de dollars on peut extraire 1 milliard de barils, c’est-à-dire 85 TWh par an pendant 20 ans (1 million de barils = 1,7 TWh). A noter que la productivité des puits pétroliers durant les 10 premières années est meilleure que celle des 10 suivantes. En tenant compte du rendement de 25% du moteur thermique, il ne reste que 21 TWh nets sur les 85 TWh bruts.

Avec une période de référence de 20 ans, $100 milliards investis dans le PV permettent ainsi d’obtenir 14% d’énergie nette en plus que $100 milliards investis dans le pétrole.

Des hypothèses conservatrices

Le coût du watt PV installé varie selon les pays. En 2013, pour le solaire résidentiel (le plus coûteux), il était de $4,4 aux USA, $4 en France, $2,9 au Royaume-Uni et $2,1 en Allemagne. En 2013 le coût des grandes centrales solaires PV au sol aux Etats-Unis était inférieur à $2/W. Soit un tiers meilleur marché que l’hypothèse retenue par Kepler-Cheuvreux.

La faiblesse du facteur de capacité moyen retenu, 13%, qui est celui de l’année 2012, est lié au fait qu’une bonne partie des capacités PV dans le monde à cette époque étaient installées en Allemagne, où l’insolation est relativement faible. Le solaire PV se développe à présent partout dans le monde, y compris dans les pays du sud bien ensoleillés, ce qui fait monter le facteur de capacité moyen.

De grandes centrales PV au sol construites dans des régions très ensoleillés, comme par exemple dans le désert d’Atacama au Chili, permettent de produire bien davantage d’énergie qu’estimé par Kepler-Cheuvreux. Le facteur de capacité du solaire PV est dans cette région au ciel très pur supérieur à 30 %. Et non de 13%. Cela change sérieusement l’équation économique. Ce n’est pas un hasard si le géant français Total construit actuellement de grandes centrales PV dans ce désert Chilien. Ceci sans aucun système de subvention. L’électricité solaire sera vendue directement sur le marché. Total, avec ces projets solaires qualifiés de « marchands », envoie un signal très fort.

L’éolien est vraiment dans le vent

Concernant l’éolien terrestre, un investissement de $100 milliards permet de produire 117 TWh bruts par an pendant 20 ans. Et 76 TWh nets en sortie de moteur électrique. Autrement dit l’éolien terrestre est encore plus intéressant que le solaire PV et trois fois plus que les carburants pétroliers ! L’éolien offshore, même s’il est environ deux fois plus coûteux que l’éolien terrestre, reste cependant pertinent comparativement au pétrole.

L’ensemble du calcul Kepler-Cheuvreux (disponible pages 116 à 128 du rapport « Toil for oil spells danger for majors » publié le 15 septembre 2014 sous la direction de Mark C. Lewis) ne prend pas en compte les taxes sur les carburants pétroliers qui rendent l’électro-mobilité solaire ou éolienne encore plus séduisante pour le consommateur. Par exemple en France, les taxes (TVA et TICPE) doublent le prix du carburant, tandis que la production électro-solaire en autoconsommation n’est pas taxée. En outre « notre analyse ne prend pas en compte les avantages fiscaux dont bénéficient les voitures électriques comparativement aux véhicules au pétrole » précisent les experts. Il s’agit donc d’un comparatif vraiment fair play.

Le coût des batteries lithium, clé du basculement du monde vers l’électro-mobilité solaire

Mais le calcul de Kepler-Cheuvreux ne prend pas en compte non plus le différentiel de coût entre un véhicule thermique et un véhicule électrique équivalent, différentiel qui est lié au coût de la batterie. Tesla-Panasonic (technologie Lithium NCA) produit aujourd’hui les batteries automobiles les meilleures marché du monde, à environ 300 dollars par kWh de stockage, contre environ 500 $ pour la concurrence qui utilise des chimies différentes. L’objectif est de réduire de 30% ces coûts et ainsi de tomber à 200 $ grâce à une production en masse au niveau de la GigaFactory Tesla qui est en construction dans l’état du Nevada et qui délivrera 500 000 batteries par an. Le coût pourrait même tomber à 100$/kWh d’ici 2025 selon les analystes de Bloomberg Energy Finance et de Tesla Motors. A partir de ce seuil le prix d’achat d’un véhicule électrique, batterie de 60 kWh comprise ($6000, 4600€), sera similaire à celui d’un véhicule thermique équivalent, hors primes gouvernementales. La motorisation d’un véhicule électrique est bien plus simple que celle d’une voiture thermique.

Une batterie de 60 kWh permet d’avoir une autonomie de plus de 200 miles (321 km), ce qui est suffisant pour circuler partout grâce à un réseau de super-chargeurs de 130 kW. Trente minutes de charge, le temps d’un café et d’une petite pause recommandée par la sécurité routière, permettent de capter l’équivalent de 270 kilomètres. Le coût par automobiliste du réseau de super-chargeurs est modeste, de l’ordre de 5% du prix moyen d’un véhicule neuf en France. L’option d’accès aux super-chargeurs, option choisie par 90% des clients ce qui traduit une forte demande, est facturé 2000 dollars par Tesla. Mais l’électricité est alors offerte à vie. L’ensemble de l’Europe, des USA, du Japon et de l’est de la Chine seront couverts fin 2015. Il est dès à présent possible d’effectuer le trajet d’Oslo à la Côte d’Azur ou de Los Angeles à New-York.

L’infrastructure électrique pour répondre aux besoins de charges ordinaires hors grands trajets, est déjà partiellement en place : les véhicules électriques peuvent être chargés sur de simples prises domestiques.

Que les prix du baril montent ou baissent, la filière pétrolière est dans l’impasse

Si la demande en pétrole faiblit, ou si l’offre en carburants liquides est gonflée en injectant des agrocarburants, les prix du baril diminuent sur le marché des matières premières ce qui compromet l’équation d’équilibre financier des nouveaux projets d’extraction du pétrole, projets de plus en plus difficiles et coûteux.

Mais à l’inverse, dans le cas d’une forte demande mondiale les prix du baril de pétrole grimpent. Ce qui plombe la compétitivité de la thermo-mobilité pétrolière face à l’électro-mobilité solaire et éolienne.

Que les prix du baril soient à la baisse ou à la hausse, il n’y a pas d’issue de secours pour l’industrie pétrolière. L’électro-mobilité éolico-solaire devient ainsi l’investissement le plus intelligent, raison pour laquelle Kepler-Cheuvreux en informe ses clients. Les flux solaires et éoliens sont disponibles partout sur Terre, évitant ainsi les tensions pour l’accès aux ressources énergétiques.

Kepler-Cheuvreux a également réalisé des estimations sur des investissements qui seront menés en 2020 ou en 2035, et non en 2014. L’écart se creuse considérablement en faveur de l’électro-mobilité éolico-solaire. En 2035 l’EROCI net pour un investissement de 100 milliards de dollars sera pour le solaire PV de 33 TWh par an et sur 20 ans, contre 15 TWh pour la filière pétrole avec le baril à 145 dollars et 17 TWh avec le baril à 125 $. Et de 95 TWh pour l’éolien terrestre, soit environ 6 fois plus qu’avec le pétrole ! « Il est presque indécent de comparer les EROCI nets du pétrole et des renouvelables en 2035 » écrivent les analystes de Kepler-Cheuvreux tant ces énergies durables écrasent ce combustible fossile par leur compétitivité.

La flexibilité des batteries est utile pour favoriser l’intégration de hauts niveaux de solaire et d’éolien

Kepler-Cheuvreux souligne que, contrairement au réservoir de pétrole, la batterie des véhicules électriques n’a pas seulement un intérêt pour le véhicule lui-même, mais pour le système électrique dans son ensemble. Il est en effet possible de mettre les véhicules en charge précisément quand la production solaire ou éolienne est importante. Et à l’inverse d’injecter l’énergie électrique stockée dans les batteries (le Soleil en bouteille) vers le réseau électrique quand le vent et le soleil manquent. C’est le principe du V2G-G2V (Vehicule-to-Grid / Grid-to-Vehicule). Les propriétaires de véhicules électriques pourront ainsi s’enrichir en rendant service au réseau électrique. La valeur des batteries est donc double comparativement aux réservoirs de carburants pétroliers. « La flexibilité des batteries des véhicules électriques comparativement aux voitures à pétrole sera un avantage qui ira croissant » affirment les experts.

Un milliard (taille du parc automobile mondial en 2010) de batteries de 60 kWh constituent un réservoir de 60 TWh équivalent à 24 heures de demande électrique globale. Les voitures sont en moyenne garées 23 heures sur 24. Si les 2/3 des véhicules sont connectés à des prises de seulement 3 kW la puissance disponible est alors de 2000 GW. De quoi gérer les fluctuations d’un mix électrique global à très haute teneur en PV et éolien. La voiture électrique devient ainsi un cheval de Troie pour que les énergies renouvelables puissent conquérir le mix électrique mondial et repousser les centrales fossiles à une simple fonction de back-up de sécurité. Les centrales non flexibles, et donc inadaptées, disparaîtrons.

Au-delà des écologistes le PV et l’éolien suscitent un intérêt croissant des spécialistes de la finance

Kepler Cheuvreux, entreprise de services financiers, est le résultat de la fusion entre Kepler Capital Market et Crédit Agricole Cheuvreux opérée en avril 2013. Kepler Cheuvreux a conclu des partenariats avec UniCredit et Crédit Agricole CIB, deux des plus grosses banques européennes, pour leurs opérations sur les marchés de capitaux. Les experts de cette entreprise ne sont pas les seuls à souligner l’intérêt économique majeur et croissant du solaire PV et de l’éolien.

Citi Group, banque d’investissement basée à New York, a publié en août 2014 un rapport soulignant que d’un point de vue « purement économique », le solaire PV est appelé à jouer un rôle majeur dans le mix électrique global.

Début 2014 la banque britannique Barclays a dévalué les centrales thermiques des grands groupes électriciens Américains soulignant la menace croissante que fait peser le PV sur leur équation économique. Certains sauront s’adapter à cette révolution solaire. Les autres, par le simple mécanisme de la sélection naturelle, disparaîtront.

Enfin la banque Lazard vient de publier en septembre 2014 un rapport où elle estime que le PV et l’éolien terrestre sont à présent meilleurs marché que le gaz naturel aux USA, pays qui a lourdement investi dans le gaz de schiste. Selon le Financial Times les experts de Lazard ont constaté que le coût du MWh éolien non subventionné est tombé de $101 en 2009 à $37 en 2014 tandis que celui du PV non subventionné a chuté de $323 à $72 sur la même période. Le coût du MWh des centrales à gaz est de $61 à $87 aux USA, selon le prix du gaz et le facteur de capacité des centrales.

Le groupe français EDF a comme objectif de vendre en Grande-Bretagne le MWh du nouveau nucléaire (EPR) à un tarif d’achat (marketisé sous le terme de « strike price ») d’environ £92.50 ($150) à partir de 2023 et pour une durée de 35 ans, ce qui a été considéré par de nombreux experts Anglais, Allemands, Américains et Finlandais comme particulièrement anti-économique. Différents analystes estiment que le coût de production du MWh EPR sera de 80 à 100 € ($102 à $128). Le coût du MWh des anciennes centrales nucléaires Françaises déjà amorties est estimé par la Cour des Comptes à 59€ ($77).

Indépendamment des aspects sécuritaires, sanitaires, environnementaux et démocratiques, le coût et la lenteur de déploiement du nucléaire sont de sérieux obstacles pour l’avenir de la filière. Il est difficile de rivaliser avec le plus grand réacteur nucléaire naturel, libre et ouvert à tous : le Soleil.

Par Olivier Daniélo

.jpg)

.jpg)