Le GIEC est organisé en trois groupes de travail. Le Groupe I synthétise la littérature scientifique concernant les bases physiques de l’évolution climatique de telle façon que la synthèse cadre avec la politique climatique fixée par l’ONU. Son rapport a été publié en 2013.

Le Groupe II étudie les impacts, la vulnérabilité et l’adaptation au changement climatique. Son rapport a été publié en mars 2014. Enfin le Groupe III a pour mission de dresser un panorama des différents outils permettant d’atténue (mitigation) le réchauffement climatique. Son rapport sera publié le 13 avril 2014.

Les USA ont demandé au groupe III qu’il présente ses chiffres de manière standard. Au lieu de se référer au PIB le GIEC parle de « consommation », sans définir de manière précise ce mot.

Les représentants officiels de la Suisse ont déclaré que « la question centrale », pour les acteurs politiques, les législateurs et les investisseurs, était de comparer les coûts et les bénéfices des différents leviers disponibles pour contenir les émissions de gaz à effet de serre.

La réponse du président du GIEC, Rajendra Pachauri a été pour le moins évasive : « La valeur monétaire n’est qu’une petite partie. Quid des pertes de vies, des pertes de services écologiques ? ». De beaux sentiments. Mais à quand un peu de pragmatisme ?

Les auteurs du rapport déclarent ne pas donner de ligne directrice économique dans la mesure où il est difficile de donner une valeur sur le risque d’une fonte plus rapide de la calotte glaciaire du Groenland qui fera augmenter le niveau des mers, sur l’arrêt du Gulf Stream ou sur un assèchement soudain de la forêt tropicale amazonienne.

Non, le Gulf Stream ne va pas s’arrêter

Le rapport du groupe I du GIEC indique pourtant clairement que ces risques sont extrêmement faibles. « Il est extrêmement improbable que l’AMOC (Atlantic Meridional Overturning, courant majeur lié à la circulation thermohaline et dont le Gulf-Stream est une branche) subira une transition rapide (Confiance élevée) » a écrit le groupe 1. « Il est exceptionnellement improbable qu’aussi bien les calottes glaciaires du Groenland que de l’Antarctique Ouest subiront une désintégration complète (Confiance élevée) ».

Et il y a une « faible confiance dans les projections des variations de la fréquence et la durée des méga-sécheresses. Faible confiance dans les projections d’un effondrement de la circulation des moussons. Faible confiance dans les projections qui prévoient un effondrement de grandes zones des forêts tropicales. Faible confiance dans les projections qui prévoient un effondrement de grandes zones des forêts boréales. » Pourquoi le rapport du groupe III ne se base-t-il pas sur ces conclusions du groupe I ?

Pour l’intellectuel danois Bjorn Lomborg, directeur du Copenhaguen Consensus Center, certains calculs frisent l’absurde. Par exemple, pour la Pologne, une hausse d’un mètre du niveau océanique aurait un impact évalué à entre 28 et 46 milliards de dollars. Mais les études gouvernementales polonaises montrent qu’une protection complète contre cette montée du niveau marin coûterait moins de 6,1 milliards de dollars.

Et avec une montée de 30 centimètres (soit 50% de plus qu’au cours du XXème siècle), le coût de la protection complète serait de 2,3 milliards. « La Pologne va-t-elle dépenser entre 2 et 6 milliards de dollars pour sauver entre 28 et 46 milliards de dollars ? » demande avec ironie Bjorn Lomborg dans le journal Herald Sun australien. « Bien sûr que oui. Ils s’adapteront comme l’humanité l’a toujours fait au cours de l’histoire. Cela ne veut pas dire qu’il n’y a pas de problème. La montée du niveau marin causera des problèmes, mais cela coûtera entre 2 et 6 milliards, et non pas 46 milliards ».

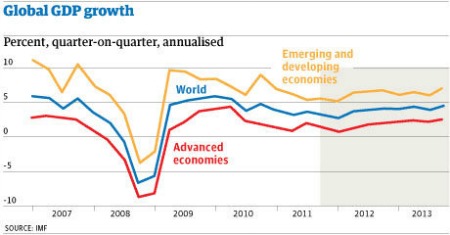

Entre 0.2 et 2% du PIB mondial

Le rapport du groupe II du GIEC publié le mois dernier indiquait qu’un réchauffement hypothétique de 2,5°C réduirait a terme le PIB mondial entre 0,2 à 2,0% par an. Le taux de croissance annuel du PIB mondial sera d’environ 3,7% en 2014. Il était de 7,7% en Chine et de 0.1% en France en 2013. Il sera de 5,2% en Afrique sub-saharienne et de 7% en Afrique de l’ouest (Cédéao) en 2014, record du continent africain. Le FMI espère que la France parviendra à un taux de 1% en 2014, et de 1,5% en 2015.

« L’OCDE estime que 82% de la croissance mondiale aura lieu dans les pays « pauvres » du monde entre 2013 et 2030 » souligne Roger Pielke Jr, professeur de sciences environnementales à l’université du Colorado, dans une tribune publiée dans l’Earth Island Journal où il analyse la doctrine de la décroissance. «Seulement 18% de la croissance mondiale aura lieu aux USA, en Europe de l’ouest, au Japon et dans quelques autres pays riches ».

Dans son « Energy Outlook to 2035 » le groupe pétrolier BP estime que 95% de la croissance de la demande énergétique mondiale d’ici 2035 aura lieu dans les pays «pauvres ». « Etre anti-croissance aujourd’hui, implique en réalité souhaiter que les pauvres restent pauvres » conclut Roger Pielke Jr.

L’énergie clé de la croissance

Les USA considèrent le gaz de schiste comme une technologie propre étant donné qu’il permet de réduire le recours aux centrales à charbon dont l’impact sanitaire est lourd. Ils demandent que le groupe 3 du GIEC élargisse sa liste de technologies considérées comme « propres ».

La France continue de faire la promotion du nucléaire, dont le bilan environnemental et sanitaire n’est pourtant pas brillant dans les études multicritères, d’où le danger de ne focaliser que sur le seul critère CO2.

La baisse considérable des coûts du solaire ces dernières années permet d’espérer que la croissance économique mondiale devienne peu à peu moins grise et plus verte. A Austin, au Texas, le kWh photovoltaïque coûte déjà moins de 5 cents.

Par Olivier Daniélo

Et aussi dans l’actualité :

Techniques de l’Ingénieur : Mireille Defranceschi, vous co-animez chez Techniques de l’Ingénieur un nouveau cycle de formation intitulé Analyse des métaux. A quelles problématiques répond-il ?

Techniques de l’Ingénieur : Mireille Defranceschi, vous co-animez chez Techniques de l’Ingénieur un nouveau cycle de formation intitulé Analyse des métaux. A quelles problématiques répond-il ?