« De nombreuses études récentes pointent le rôle de l’Oscillation Décennale du Pacifique (PDO) dans la pause du réchauffement » écrit Lisa Goddard, climatologue de l’université Columbia spécialiste des oscillations océaniques et directrice de l’IRI, l’International Research Institute for Climate and Society.

La PDO est une oscillation océanique naturelle dont la période moyenne est d’environ six décennies. Pendant environ trois décennies l’effet de la PDO est réchauffant, puis l’inverse le reste du cycle. Le passage d’une phase à l’autre se fait de manière progressive, la transition prend la forme d’un plateau.

Durant les phases PDO échauffantes les épisodes El Niño, qui durent en moyenne 12 à 18 mois, sont deux fois plus fréquents que les épisodes La Niña. C’est l’inverse durant les phases PDO refroidissantes.

D’autres études, ajoute Lisa Goddard, soulignent que l’on a déjà connu dans les années 50 et 60 une pause du même genre que celle que l’on observe aujourd’hui. Il s’agit de publications d’auteurs cherchant à relativiser la durée bientôt bi-décennale du hiatus actuel. Dans les années 50 et 60, tout comme aujourd’hui, la pause correspondait à une phase PDO froide.

« Il est intéressant de constater que personne n’évoque ouvertement l’autre versant de cette situation : l’accélération du réchauffement climatique » ose écrire la chercheuse. « Les années 1970 jusqu’au milieu des années 1990 ont connu une période positive de la PDO et une accélération du réchauffement. Si vous acceptez qu’une phase négative de la PDO puisse avoir un effet sur le réchauffement, alors une phase positive de la PDO aurait dû avoir un résultat opposé. »

Assainir le débat climatique

Avec ces propos Lisa Goddard fait tomber un tabou. Et elle détoxifie un débat pollué depuis plusieurs années par des affrontements stériles entre extrémistes, climato-exagérateurs d’un côté et les climato-négateurs de l’autre. Nature Climate Change est un journal mensuel peer-reviewed crée en 2011 par Nature Publishing Group et regroupant des articles scientifiques de haute qualité ayant pour thème le climat.

Si l’on admet que la PDO, en phase refroidissante, est assez puissante pour contrebalancer le forçage échauffant induit par les gaz à effet de serre anthropiques, on peut difficilement nier, sauf à faire preuve de mauvaise foi climato-exagératrice, que la PDO, en phase échauffante, peut exercer un effet du même ordre de puissance mais de signe opposé.

Et on peut difficilement nier, sauf à faire preuve de mauvaise foi climato-négatrice, que le réchauffement reprendra probablement de plus belle quand la PDO passera de nouveau en phase échauffante d’ici environ deux décennies. Car alors le forçage anthropique et la PDO pousseront tous les deux dans le même sens.

Une question de sensibilité

Si le réchauffement observé dans les années 70-90 est en partie lié (pour moitié ?) à la PDO, cela a d’importantes conséquences. Cela implique que l’estimation de la sensibilité climatique au CO2 a été surestimée par les modèles informatiques qui servent de référence au GIEC, organisme au service des politiques climatiques de l’ONU.

Contrairement à ce qu’essayent de faire croire les climato-négateurs une sensibilité climatique plus basse ne signifie pas qu’elle est nulle. Mais cela conduit à revoir les prédictions d’amplitude de réchauffement global pour le futur. Les prédictions seraient alors moins inquiétantes qu’avec les modèles informatiques actuels, ce qui ne constitue en aucun cas un blanc-seing pour l’inaction en matière de réduction des gaz à effet de serre.

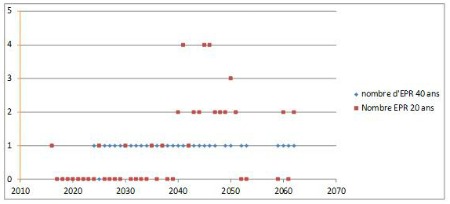

Plusieurs équipes scientifiques, notamment norvégiennes, japonaises et américaines estiment que la sensibilité climatique retenue par le GIEC est surévaluée. Pour le professeur Michael Schlesinger, directeur du Climate Research Group du Département des sciences de l’atmosphère de l’Université de l’Illinois, avec une sensibilité climatique plus basse « parvenir à limiter le réchauffement anthropique à 2°C devient possible ». Ceci tout en permettant le développement économique des pays dits « du sud ».

« Les informations requises pour gérer les risques et les opportunités des futurs changements climatiques, qu’ils soient naturels ou résultent de l’action humaine, doivent reposer sur une science solide » estime Lisa Goddard. « La science part de bonnes observations et d’une bonne synthèse. Mais les choses ne doivent pas d’arrêter là. Elle doit servir aussi à une meilleure compréhension, à un meilleur suivi et à des prédictions qui vont de la variabilité interannuelle aux décennales et de ses manifestations quant à un changement de la moyenne climatique. »

Et le niveau marin ?

La pause du réchauffement climatique ne concerne pas uniquement la température de surface terrestre. « Depuis le début de la décennie 1990 le taux moyen d’élévation du niveau marin a été de 3,1 mm par an. Cependant durant la dernière décennie une baisse de 30% de ce taux a été observé » constatent la scientifique française Anny Cazenave et ses collègues dans un article publié dans Nature Climate Change en février 2014 et intitulé « Le taux de la montée du niveau marin », où les chercheurs tentent de trouver des hypothèses explicatives et soulignent l’importance probable des oscillations océaniques. Alors que le taux d’élévation moyen du niveau marin global était compris entre 3 à 4 mm par an avant 2005 (moyenne glissante sur 5 ans), il est tombé à entre 2 et 3 mm par an depuis 2005.

Le 4ème rapport du GIEC (2007) indiquait qu’« aucune accélération du niveau de la mer à long terme n’a été identifiée en utilisant uniquement les données du XXème siècle ». Et dans l’AR5 publié en 2013 on peut lire qu’« il est probable que le niveau moyen marin global ait augmenté entre 1920 et 1950 à un taux identique à celui observé entre 1993 et 2010 ». A l’évidence, le signal anthropique n’est, du moins à ce stade, pas perceptible.

Le boom de la surface de la banquise du pôle sud qui a battu cette année un record est également surprenant. Un bateau russe avec à son bord des écologistes est d’ailleurs resté bloqué par la banquise Antarctique en janvier 2014, c’est-à-dire en plein été austral. Et le déclin de la banquise Arctique (pôle nord) semble s’être affaiblit ces dernières années.

Des tempêtes causées par l’homme ?

On objectera que l’Europe a connu une série de tempêtes aux lourdes conséquences cet hiver, et que c’est la preuve d’une action néfaste de l’homme sur le climat. Un élu anglais a très sérieusement affirmé que les tempêtes qui ont frappé le Royaume-Uni cet hiver constituent une punition de dieu suite à la décision du gouvernement de légaliser le mariage homosexuel le 17 juillet 2013. Un nouveau Sodome et Gomorrhe ? La terre et dieu se vengent-ils des méchants êtres humains trop jouisseurs ? Il convient de dépasser les schémas mentaux punitifs et d’adopter une approche rationnelle.

Le 15 février 2014 le journal L’Express a posé la question: ces tempêtes sont-elles causées par l’homme ? « Non, on ne peut pas attribuer pour l’instant tous ces évènements au réchauffement climatique » a répondu Jean Jouzel, vice-président du GIEC. « Je ne suis pas sûr qu’il y ait une explication autre que météorologique. Il y a une variabilité naturelle du climat » a affirmé avec une grande honnêteté le scientifique, ne cédant pas à la facilité du populisme catastrophiste. « Le réchauffement planétaire annuel est de l’ordre de 0,01 ou 0,02 degré, bien loin des écarts que l’on voit cet hiver en France » a précisé l’expert. « Même si le réchauffement climatique est inéluctable, il s’est ralenti ces 15 dernières années en termes de températures ».

Mais où est donc passée la fameuse « chaleur manquante » ?

La question reste entièrement ouverte. Le débat scientifique est loin d’être clos, « the science is not settled ». C’est grâce au scepticisme que les connaissances progressent. Pour Denis Diderot, philosophe des Lumières auteur de la célèbre Encyclopédie, « le scepticisme est le premier pas vers la vérité ». Le scepticisme n’est pas seulement « l’ami de la science », c’est la substantifique moelle du scientifique.

« Même dans celles de nos théories qui ont été les mieux corroborées, des fautes peuvent se cacher ; et il est du savoir spécifique du scientifique de rechercher de telles fautes. En ce qui concerne ce devoir, une nouvelle théorie alternative peut nous être d’une grande aide » affirmait le philosophe des sciences Karl Popper. « Cela signifie que nous devons être tolérants à l’égard de telles alternatives. Nous devons adopter une attitude tolérante, avant que la théorie dominante ne soit en difficulté ».

Pour Richard Feynman « la Science c’est la croyance dans l’ignorance des experts ». Même les plus grands climatologues du monde ont le droit de se tromper. « Il n’y a aucune autorité qui tienne. Cela vaut également pour les spécialités » estimait Karl Popper.

Le droit au doute

Il est regrettable que certains journalistes travaillant pour de grands médias français essayent de faire croire que le scepticisme est anti-scientifique et s’acharnent contre les scientifiques qui osent remettre en cause les dogmes climatiques en cherchant à les faire passer pour des personnes forcément malhonnêtes, corrompues ou alors farfelues.

« Avec l’idole de la certitude (qui inclut celle de la certitude imparfaite ou probabilité) tombe l’une des défenses de l’obscurantisme, lequel met un obstacle sur la voie du progrès scientifique » soulignait Karl Popper. « Car l’hommage rendu à cette idole non seulement réprime l’audace de nos questions, mais en outre compromet la rigueur et l’honnêteté de nos tests. La conception erronée de la science se révèle dans la soif d’exactitude. Car ce qui fait l’homme de science, ce n’est pas la possession de connaissances, d’irréfutables vérités, mais la quête obstinée et audacieusement critique de la vérité. »

Par Olivier Daniélo

L’étude « Heat hide and seek » publiée dans Nature Climate Change

Limiter le réchauffement à 2°C est possible selon une étude américaine

Y a-t-il accélération ou décélération du niveau des océans ?

.jpg)

.jpg)

.jpg)