Des textiles photovoltaïques

Des scientifiques du Centre de Recherche sur les Matériaux de l’Université technique de Brno [1] travaillent à l’élaboration de textiles photovoltaïques. Ces recherches s’inscrivent dans le cadre d’un projet pilote qui vise à développer, à l’échelle européenne, une industrie capable de produire des textiles générant de l’électricité.

A la base de l’idée : les matériaux intelligents. Ces matériaux sont capables de modifier leurs propriétés physiques en réponse à des stimuli extérieurs. Dans le cas des textiles photovoltaïques, il s’agit de polymères qui peuvent se comporter comme des semi-conducteurs et trouvent, de fait, de nombreuses applications en électronique.

Solubles dans les pâtes et les encres, ces polymères peuvent être appliqués aux textiles selon les techniques classiques d’impression. Des cellules photovoltaïques, des capteurs ou d’autres éléments électroniques peuvent être intégrés au tissu, sans qu’il ne perde ses caractéristiques. Pour l’heure, il n’est pas question de mettre de tels textiles au lave-linge mais les chercheurs espèrent, à terme, trouver un moyen de les rendre résistants à l’épreuve des lavages machine.

L’enjeu lié au développement de la technologie est majeur d’autant que le nombre d’applications que l’on peut y trouver n’a pour limite que la variété de tissus que l’on peut produire : une veste qui permettrait de recharger son téléphone portable, une sacoche à ordinateur portable qui ferait office de chargeur, des rideaux ou encore des tenues militaires qui permettrait de générer de l’électricité… Les constructeurs automobile se disent aussi très intéressés.

L’un des principaux inconvénients de ces textiles photovoltaïques reste leur durée due vie, qui ne dépasse pas deux ans. Mais les chercheurs ont bon espoir que les avancées technologiques en la matière permettront de rallonger considérablement celle-ci.

Source : www.bulletins-electroniques.com

Le projet EcoGrid à Bornholm désigné comme l’un des plus prometteurs au monde

L »île de Bornholm, a été choisie pour héberger le projet européen EcoGrid. Ce test grandeur nature est un prototype de réseau de distribution d’électricité « intelligent » basé sur les énergies renouvelables mais surtout capable de s’autoréguler en utilisant les logiques de marchés comme la loi de l’offre et de la demande.

Le but est à terme de créer un système à la fois fiable et durable basé sur les énergies renouvelables. Le projet est actuellement finalisé et la phase de démonstration, qui devrait durer de 2 à 3 ans, est en préparation. Celle-ci impliquera quelques 2000 utilisateurs, résidentiels et commerciaux (sur un total de 28000 habitants) qui testeront donc un système de demande flexible basé sur des indicateurs de prix variant en temps réel.

Le projet a récemment été selectionné pour faire partie de la liste des 10 nominés du Sustania Award [2] parmi une liste de 100 projets identifiés comme importants pour la promotion du développement durable mais a surtout reçu le label EEGI (European Electricity Grid Initiative) lui ouvrant la voie à de nouvelles aides européennes.

Source : www.bulletins-electroniques.com

90 % moins d’énergie pour produire du silicium ?

La société norvégienne DYNATEC et l’Institut de Technologie de l’Energie (IFE) développent depuis deux ans un concept de production de silicium qui pourrait révolutionner l’industrie du solaire photovoltaïque.

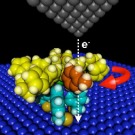

La production de silicium polycristallin utilise aujourd’hui majoritairement le procédé de dépôt chimique en phase vapeur (chemical vapor deposition – CVD). Ce type de réacteur, développé par Siemens dans les années 50 (et d’ailleurs également appelé « réacteur Siemens »), représente plus de 80 % de la production mondiale de silicium polycristallin aujourd’hui. Cette méthode consiste à évaporer un gaz contenant du silicium (silane), et donc à le surchauffer (650° – 1100°), pour précipiter le silicium sous forme solide. Il est également nécessaire de refroidir les parois du réacteur pour empêcher les dépôts indésirables. Tout cela engendre une consommation d’énergie très importante. « C’est comme mettre un chauffage chauffé à blanc dans un congélateur ! », dit Werner Filtvedt, qui coordonne le projet à l’IFE.

Le réacteur développé par DYNATEC et l’IFE permettrait de consommer 90% moins d’énergie pour produire la même quantité de silicium. La différence avec un réacteur classique est que le dépôt a lieu à l’intérieur d’une chambre chauffée de l’extérieur, et non sur une surface chauffée dans une chambre dont les parois sont refroidies à l’eau. Cela permet de limiter les pertes de chaleur. Les chercheurs semblent également avoir corrigé un problème avec les gaz dans le réacteur. Des gaz de centrifugation pressent le silane contre la paroi chaude du réacteur, où le silicium est précipité. Cela évite que la réaction se produise dans le volume du réacteur, ce qui produit beaucoup plus de poussière de silice, poussière qui n’est ensuite pas utilisée dans la production cellules solaires.

La prochaine étape du projet, supporté par le Conseil Norvégien de la Recherche (RCN) [6], est la construction d’un réacteur à pleine échelle, qui pourrait débuter cette année ou l’année prochaine.

Source : www.bulletins-electroniques.com

Publié par Pierre THOUVEREZ