Pour François Lempérière, expert hydraulicien président de l’association à but non lucratif Hydrocoop, les Stations de Transfert d’Energie par Pompage (STEP) peuvent être des alliés très précieux dans cette perspective.

E.T.I : Comment fonctionne une STEP et à quoi servent-elles ?

F.L : Une Station de Transfert d’Energie par Pompage est constituée d’un grand bassin haut et d’un grand bassin bas. Le pompage de l’eau vers le bassin supérieure permet d’accumuler de l’énergie potentielle et le turbinage permet de récupérer l’énergie stockée. Le rendement d’un tel cycle, pompage puis turbinage, variable en fonction des sites et des technologies, est de 80% en moyenne. Cette forme de stockage peut avoir trois objectifs. Stocker une partie de l’énergie intermittente éolienne ou solaire pour l’adapter aux besoins. Ou stocker pendant la nuit ou le week-end du courant qu’on réutilisera en heures de pointes. Et enfin améliorer la qualité et la sécurité du réseau électrique par réglage de la fréquence et par adaptation rapide en cas de défaillance d’une autre source d’énergie.

E.T.I : Dans sa roadmap sur l’hydroélectricité qu’elle vient de publier fin octobre 2012, l’Agence Internationale de l’Energie estime que 140 000 MW de STEP sont aujourd’hui en place dans le monde, constituant 99% de la capacité de stockage mondiale disponible pour le réseau électrique. Comment expliquez-vous un tel succès et une part aussi faible pour les autres technologies de stockage comme les batteries ou l’hydrogène ?

Les solutions concurrentes sont pénalisées soit par leur rendement, soit par leur coût, soit par leur durée de vie. Il est probable que les batteries s’amélioreront et prendront une part plus importante. Mais il est très probable que les STEP resteront la solution essentielle, même en 2050. Une STEP peut fonctionner pendant des siècles à un coût d’exploitation très faible. Il existe déjà des usines hydroélectriques qui ont plus de 100 ans, qui continuent à produire et qui continueront à le faire. Le taux de 99% dont fait écho l’AIE, c’est la situation actuelle mais c’est aussi ce qui s’est passé depuis deux ou trois ans dans les réalisations supplémentaires.

E.T.I : Donc la tendance est conservée ?

F.L. Tout à fait. Il peut y avoir un miracle sur une autre technologie dans les années ou décennies à venir, mais à ce stade la tendance concernant les STEP reste intacte. Le nombre de STEP va très probablement être multiplié par 3 à 5 dans le monde d’ici 2050.

E.T.I : Les STEP aujourd’hui installées en France seront-elles suffisantes si l’on souhaite que l’éolien et le solaire occupent une part appréciable dans le mix électrique français ?

On peut retarder un peu l’utilisation des STEP en développant du gaz pour équilibrer les fournitures intermittentes. Les 5 GW de STEP que nous avons dans le sud de la France devraient passer à au moins une dizaine de GW dans 10 ans, et à 15 ou 20 GW en 2030. C’est un ordre de grandeur tout à fait raisonnable et qui, je crois, n’est pas très discuté. On peut faire 3 à 4 GW de plus dans le sud, et pour bien faire d’ici une vingtaine d’années il faudrait en avoir 5 à 10 de plus dans le nord.

E.T.I : En France, où serait-il possible d’installer ces 5 à 10 GW de STEP ?

F.L. : Dans le sud de la France on peut avoir une dizaines de GW au total. Dans le nord de la France, qui n’est pas très montagneux, on a intérêt à rechercher des STEP en bord de mer. On trouve des sites possibles sur les 500 kilomètres de bord de mer, aussi bien en Bretagne qu’en Basse-Normandie, en Haute Normandie, et jusque dans la région de Boulogne.

Avec les STEP en bordure de falaise, on opère sous une charge d’une centaine de mètres, alors que dans les STEP de montagne on a plutôt 300 mètres en moyenne, ceci en général dans le monde. Il existe dès à présent des STEP opérant avec une centaine de mètres au Japon, notamment à Okinawa, et aussi en Russie, à Zagorsk, à environ 100 kilomètres de Moscou. C’est un peu plus cher au kilowatt comparativement, mais en bord de mer on n’a pas besoin d’aussi longs tunnels que dans le cas des STEP de montagne pour relier les deux bassins.

E.T.I : Dans le sud, l’ Assemblée Corse semble intéressée par les STEP en bord de mer. Un projet piloté par EDF SEI est également en cours en Guadeloupe…

F.L. : Ce sont effectivement dans les îles que les premiers développements français de STEP en bordure de mer seront réalisés.

E.T.I : Un article du journal Le Monde daté du 7 novembre 2012 et intitulé « Le stockage de l’électricité, véritable enjeu des énergies renouvelables » fait écho d’un projet de STEP au niveau des falaises d’Etretat ? Que pensez-vous de ce projet ?

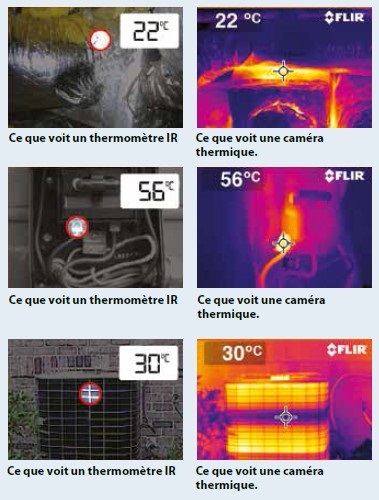

F.L. : Il n’existe évidement aucun projet de STEP au voisinage des falaises d’Etretat. L’article du Monde serait parfait si on y ajoutait une phrase et une photographie. Cet article comporte une phrase qui peut être mal comprise : « Si, sur le papier, les massifs montagneux ou le littoral de la Manche se prêtent à merveille à la construction de STEP, on imagine mal une station de pompage-turbinage accrochée à un lac de la Vanoise ou aux falaises d’Etretat… ». Il faudrait y ajouter : mais entre Brest et Boulogne il existe plus de 10 fois plus de sites favorables aux STEP que nécessaire. Et il faudrait joindre une photo de la STEP d’Okinawa qui permet d’illustrer le faible impact d’une telle STEP sur un paysage de falaise. L’impact sur l’environnement est plus faible qu’avec une STEP de montagne.

E.T.I : Est-il possible d’optimiser l’intégration des STEP dans les paysages ?

F.L. : Une STEP comprend une usine souterraine et une sortie en mer peu importante, donc le problème paysager c’est le lac supérieur à quelques centaines de mètres du bord de la falaise. Ce lac est entouré par une digue d’une vingtaine de mètres de haut, dont l’extérieur sera en pente douce, revêtu de terre végétale, engazonné et arboré. D’autre part la plupart des sites inventoriés ne déplacent aucune habitation. Il n’est pas indispensable de se mettre en bordure immédiate de falaise, on peut se mettre à 200 ou 300 mètres, ce qui signifie que pour apercevoir la digue, il faudra être très loin en mer.

E.T.I : Et même s’éloigner encore davantage du rivage ?

F.L. : Dans ce cas on allonge la longueur de tunnels. 200 ou 300 mètres, cela parait raisonnable.

E.T.I : Les bassins étant remplis d’eau de mer, n’y a t-il pas un risque de contamination des nappes phréatiques ? Et cela ne risque-t-il pas d’abimer les usines ?

F.L. : Le fonctionnement de l’usine de la Rance depuis 50 ans en Bretagne montre que l’on sait très bien résoudre le problème de la corrosion marine. Concernant l’étanchéité des bassins, il convient si nécessaire de protéger la partie basse du bassin supérieur par géomembranes. Cela coûte moins de 5% de l’investissement. Quelques pourcents.

E.T.I : Les communes littorales concernées ont-elles intérêt à accepter de tels projets ?

F.L. : Les communes littorales auront les mêmes avantages que les communes voisines d’un grand aménagement hydroélectrique, ce sont des communes très riches grâce aux compensations économiques qu’elles touchent. Et en plus ces communes auront la possibilité d’utiliser un lac de quelques kilomètres-carrés pour l’aquaculture ou les sports nautiques comme la planche à voile et le canoë. De quoi vivifier l’activité touristique locale.

E.T.I : Finalement, ces projets peuvent être très attractifs ?

F.L. : Il y a une trentaine de sites possibles le long de la Manche, je pense que cela ne sera pas difficile de trouver un ou deux sites au départ très acceptés, et une fois que les autres communes verront comment cela se passe, pour les suivantes cela ne sera pas difficile de choisir.

E.T.I : Comparativement aux STEP classiques, qu’en est-il au niveau des coûts avec ce type de STEP en bordure de mer, avec un dénivelé plus faible, mais un bassin inférieur déjà en place étant donné que c’est la mer ?

F.L. : Cela sera un peu plus cher ou un peu moins cher suivant les cas. Le coût des STEP de montagne est assez variable suivant les sites, les estimations actuelles arrivent à la conclusion que c’est du même ordre de grandeur dans certains cas, un peu plus cher ou moins cher dans d’autres. Ceci avec moins d’impacts environnementaux. En Montagne, dès qu’on touche à une rivière, cela crée beaucoup de problèmes.

E.T.I : Quel est le surcoût engendré sur le kWh éolien ou solaire avec ce type de stockage ?

F.L. : En kilowatt investi, que ce soit en STEP de montagne ou en STEP de bord de mer, c’est entre 1000 et 2000 euros. L’impact total du stockage sur le coût de fabrication de l’énergie, en supplément du coût de production de l’énergie est inférieur à deux centimes d’euro par kWh. Cela permet tout à fait le développement des énergies renouvelables variables. Et d’avoir du courant de bonne qualité pour le réseau électrique.

E.T.I : Il est également possible de placer les STEP entièrement en mer…

F.L : Oui, mais c’est plus coûteux de construire les digues en mer qu’à terre. Par contre cela peut tout à fait être envisagé sur l’on construit de grande usine marémotrices dans le futur et on pourra alors associer de telles STEP en pleine mer.

E.T.I : Installer à ces systèmes combinés des éoliennes, en tirant profit des digues, serait-il possible ?

F.L. : On peut le faire, mais ce n’est pas fondamentalement important.

ETI : Parmi toutes les options possibles, pour commencer, quel est celle qui vous semble la plus pertinente ?

F.L. : Cela dépendra de l’acceptation locale. Il me semble qu’une première STEP en Haute-Normandie, sur les 100 kilomètres du pays de Caux, cela parait bien situé, près des centrales nucléaires qu’on peut moduler. Une autre STEP en Bretagne, ou l’on peut faire beaucoup d’énergie éolienne intermittente, cela serait assez logique. Il y a d’autres sites dans le Cotentin près de Flamanville, il y a d’autres sites dans le Pas-de-Calais. Trouver deux sites à réaliser d’ici une dizaine d’années parmi la trentaine possibles ne devrait pas être très difficile.

Ce grand stockage économique bien situé pourrait être la meilleure solution pour permettre réellement un programme d’énergies renouvelables important. Les sites français sont assez proches des Pays-Bas et de la Ruhr allemande, et il est possible que l’on utile les sites français non seulement pour la France mais aussi pour l’Europe.

Propos recueillis par Olivier Daniélo

François Lempérière est ex-président du Comité Français des Grands Barrages (CFGB) ainsi que de plusieurs comités au sein de la Commission Internationale des Grands Barrages (CIGB), et est également lauréat de l’Académie des Sciences.

La CIGB a été fondée en 1928 et est destinée à favoriser l’échange des connaissances et de l’expérience dans le domaine de l’ingénierie des barrages. Elle rassemble 95 Comités Nationaux qui comportent au total environ 10 000 membres individuels.

.jpg)

.jpg)

.jpg)