Qualité de l’air intérieur : Les produits de construction et de décoration affichent leurs performances en matière de santé environnementale

Nous passons en moyenne 70 à 90 % de notre temps dans des espaces clos, en ignorant souvent que cet environnement est également pollué. Notre intérieur contient en effet de nombreux produits nous exposant à des substances irritantes, allergisantes voir cancérogènes. Les peintures, isolants, cloisons, revêtements de sols, vernis, colles, adhésifs émettent des polluants de type formaldéhyde, toluène, styrène, etc., qui présentent des risques pour la santé. Une étude de l’Observatoire de la qualité de l’air intérieur, menée dans 567 logements français, a montré que pour 9 % d’entre eux, les concentrations de ces polluants étaient élevées.

Afin de lutter contre ce problème de santé publique, Nathalie KOSCIUSKO-MORIZET, ministre de l’Écologie, du Développement durable, des Transports et du Logement Christine LAGARDE, ministre de l’Économie, des Finances et de l’Industrie et Xavier BERTRAND, ministre du Travail, de l’Emploi et de la Santé, ont signé un décret imposant le premier étiquetage en matière de santé environnementale, pour les produits de construction et de décoration. Ainsi, à partir du 1er janvier 2012, chaque consommateur pourra choisir, dans les rayons, les produits induisant le plus faible impact possible sur l’air intérieur de son foyer.

L’étiquette indiquera, de manière simple et lisible, le niveau d’émission de polluants volatils. Elle constituera pour le consommateur un nouveau critère de sélection en fonction de son usage : chambre pour les enfants, pièce de vie commune…

Une note allant de A+ (très faibles émissions) à C (fortes émissions) et le schéma d’une maison contenant un nuage de polluants, permettront d’identifier rapidement la qualité du produit. « Pour la première fois, une étiquette va permettre d’informer les consommateurs, donc d’orienter leurs achats vers des produits moins nocifs pour la qualité de leur air intérieur. La publication de cet arrêté constitue un signal fort vis à vis des industriels, afin de les inciter à faire évoluer leur production vers une offre plus respectueuse de la santé », précise Nathalie Koscuisko-Morizet.

Innovation photovoltaïque : Q-Cells lance une nouvelle génération de cellules

Fort de son expertise dans la production de cellules photovoltaïques, Q-Cells développe et met en place depuis plus de 10 ans les standards industriels relatifs à la puissance, la fiabilité, la dimension, l’esthétisme et les processus de fabrication.

Pour poursuivre cet objectif d’innovation constante, Q-Cells introduit aujourd’hui sur le marché français trois nouvelles cellules photovoltaïques : les cellules monocristallines carrées Q6LMXP3 (jusqu’à 18,8% de rendement), les cellulesmulticristallines Q6LPT3-G2 et Q6LTT3-G2 (jusqu’à 17,4% de rendement).

Les nouvelles cellules photovoltaïques Q-Cells possèdent les caractéristiques suivantes :

- une résistance série réduite grâce à un nouveau design avec 86 fingers et 3 busbars ;

- un tri positif +0,2 / -0% ;

- une technologie anti PID (APT) qui évite la dégradation des rendements dans les premiers mois d’activité, due aux tensions élevées du système et à la dispersion du courant dans le module ;

- une protection contre les points chauds pour une sécurité anti-feu et une efficacité accrue (Hot Spot Protect – HSP) ;

La technologie de marquage laser, « Traceable Quality », brevetée par Q-Cells, présente sur chaque cellule et permettant une traçabilité et une sécurité contre les falsifications à toutes les étapes de la chaîne de valeurs photovoltaïque, depuis le wafer de silicium, jusqu’aux grandes centrales solaires, en passant par les cellules et les modules

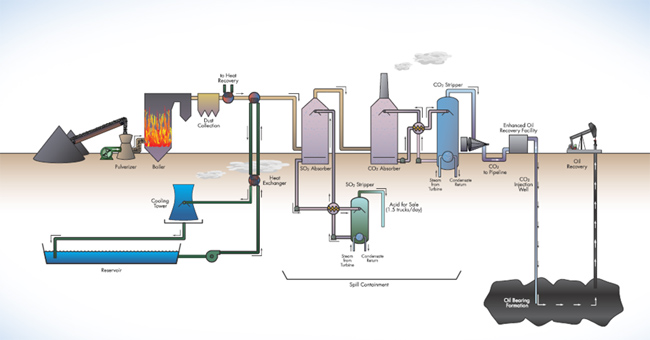

Investissements d’avenir : Lancement de l’appel à manifestations d’intérêt « Captage, transport, stockage géologique et valorisation du CO2 »

L’appel à manifestations d’intérêt (AMI) publié par l’ADEME doit contribuer à diminuer le coût du captage du CO2 et la dépense énergétique liée à cette activité, – garantir la flexibilité des procédés de captage, – valider la faisabilité technique du stockage géologique du CO2, – valider de nouvelles voies de valorisation du CO2 capté sur des sources fixes d’émissions, – maîtriser les impacts environnementaux et sanitaires du captage, du transport, du stockage géologique et de la valorisation du CO2.

Les technologies visées dans le cadre de cet AMI pourront donner lieu à des expérimentations sous la forme de :

-

démonstrateurs dédiés aux procédés de captage de 2ème génération (par exemple : solvants de seconde génération pour la postcombustion, boucle chimique pour l’oxycombustion, voies cryogéniques…), plateformes technologiques permettant de tester, de mutualiser et de développer différents outils, techniques (métrologie, monitoring, …), ainsi que des méthodologies pour le transport par canalisation et le stockage géologique du CO2 en aquifères salins profonds4 ou gisements de pétrole et de gaz naturel épuisés.

-

démonstrateurs dédiés aux voies de valorisation du CO2 sans transformation (fluide dans l’industrie) ou par transformation chimique (synthèse de produits chimiques de base, des produits à valeur énergétique ou des matériaux inertes) ou encore par transformation biologique (synthèse de produits à valeurs ajoutées, production d’énergie, traitement de l’eau, …).

La technologiques de ces expérimentations, d’en réaliser les bilans économiques et énergétiques, les études d’impacts environnementaux et sanitaires, d’accélérer leur mise sur le marché et enfin d’évaluer leur acceptabilité sociale.

Cet AMI rentre dans le cadre de l’action « démonstrateurs et plateformes technologiques en énergies renouvelables et décarbonées et chimie » du Programme d’Investissements d’Avenir et dont l’enveloppe budgétaire est de 1,35 milliard d’euros.

Le montant définitif consacré à cet appel à manifestations d’intérêt dépendra de la qualité des projets retenus.

Zoom sur l’Allemagne

Conception d’une voiture électrique à 5.000 euros à l’Université technique d’Aix-la-Chapelle

Une équipe constituée de PME, designers, développeurs et constructeurs travaille sous la conduite d’Achim Kampker de l’Université technique d’Aix-la-Chapelle (RWTH, Rhénanie-du-Nord-Westphalie) à la conception particulièrement innovante d’un véhicule automobile électrique. « Notre but est d’éclairer une nouvelle facette de l’électromobilité qui n’a jusqu’à présent guère été prise en considération », explique Achim Kampker, à la tête de la chaire de management de production au laboratoire des machines-outils (WZL).

« En effet, nous intégrons d’une part de manière ciblée des entreprises de taille moyenne et nous les qualifions pour des étapes hautement complexes de développement et production à travers leur collaboration au sein du consortium. D’autre part, le savoir acquis à travers ce projet pourra être transféré à toute l’économie, notamment aux grands constructeurs automobiles », décrit le même directeur de StreetScooter GmbH. Selon lui, la compétitivité des sites de production allemands s’en trouvera alors renforcée.

La stratégie de développement du StreetScooter repose sur le prix de vente du véhicule, fixé dès le début du projet à 5.000 euros pour une production en une série de 2.000 exemplaires. Afin de parvenir à un tarif aussi compétitif, il est prévu de mettre en place un système de location de batteries, le composant le plus onéreux des voitures électriques à ce jour. En fonction de leurs besoins, les acheteurs de ce véhicule urbain à quatre places modulables auront ainsi la possibilité de louer deux ou trois batteries, disposées dans le soubassement de la voiture et possédant chacune une autonomie de 45 km. La construction des cellules lithium-ions est assurée par une entreprise de taille moyenne de Lübeck (Schleswig-Holstein).

Avec une tension de batterie s’élevant à 60 V, aucun danger n’est à craindre pour les équipes de secours en cas d’accident du StreetScooter, et le personnel des ateliers de réparation n’aura pas besoin de formation particulière à cet effet. De plus, un système intelligent de management thermique sera installé afin de garantir une température agréable à l’intérieur de l’habitacle. En effet, en cas de température extérieure très basse ou très élevée, les systèmes de chauffage ou de climatisation habituels risqueraient de consommer autant d’énergie qu’il en est nécessaire pour le fonctionnement du système de propulsion électrique.

Disposant de deux airbags frontaux, des systèmes ABS et ESP, le StreetScooter respecte les standards de sécurité et de confort. La chaîne de montage innovante de ce véhicule électrique sera composée de 20 stations au lieu de 100 habituellement, participant ainsi à la réduction des coûts de production du véhicule.

En savoir plus : http://www.bulletins-electroniques.com/actualites/66745.htm

Construction d’une usine pilote de batteries lithium-ion à Ulm

Anette Schavan, Ministre fédérale de l’enseignement et de la recherche (BMBF), a convenu avec le réseau de compétences KLiB [1] d’un programme de construction d’une usine pilote de batteries lithium-ion à Ulm (Bade-Wurtemberg). Cet accord s’inscrit dans les objectifs de la Plateforme Nationale pour l’Electromobilité (NPE) [2] mise en place en mai 2010 à l’initiative de la Chancelière Angela Merkel. »Des batteries performantes et à un coût abordable sont une condition centrale pour les véhicules électriques destinés à la vie quotidienne. La future usine pilote à Ulm est un grand pas en direction de l’électromobilité », a déclaré Anette Schavan. Le BMBF finance ce projet à hauteur de 45,2 millions d’euros dans le cadre des fonds débloqués par le second plan de relance national.

Avec l’institut Helmholtz pour la recherche en batteries fondé le 1er janvier 2011 [3] et le projet de construction de l’usine-pilote de batteries lithium-ion, Ulm se positionne ainsi en centre spécialisé dans le développement des batteries. Le principal enjeu de la future usine consistera au transfert de nouvelles techniques de production en matériaux, composants et systèmes vers un processus industriel de fabrication en série de batteries pour les véhicules électriques. Les 25 entreprises et organismes membres du KLiB, parmi lesquels figurent BASF, Deutsche Accumotive, VARTA, Evonik, SGL Group et le ZSW veulent dans un premier termps débuter la planification de la construction de l’usine pilote au courant de l’année 2011.

En savoir plus : http://www.bulletins-electroniques.com/actualites/66784.htm

Lancement officiel du premier parc éolien offshore en mer baltique

L’ouverture du premier grand parc éolien en mer baltique allemande tombe à point nommé pour la Chancelière Angela Merkel qui n’aurait su manquer l’opportunité, en cette période de débats face à la sortie accélérée du nucléaire, de souligner l’engagement du gouvernement dans les énergies renouvelables. C’est donc symboliquement qu’elle a déclenché le fonctionnement de ce nouveau parc nommé « Baltic 1 ». Celui-ci s’étend sur une surface de 7km2, comprend 21 mats de 70m de haut et dont le diamètre du rotor mesure 93m et devrait fournir 185GWh par an.

L’Allemagne avait jusqu’à présent peu développé son potentiel offshore. Les entreprises étaient en effet réticentes à investir dans cette technique. Le gouvernement avait donc subventionné le test de 12 turbines mené par EWE, E.on et Vattenfall l’année dernière, mais celles-ci fonctionnaient « plus ou moins à la demande du gouvernement ». C’est pourquoi Baltic 1 est le premier parc « commercial », puisqu’il a été construit sans subvention par l’entreprise EnBW.

Le projet Baltic 2 serait déjà en route, et la construction de 80 mats d’éolienne devraient démarrer en 2011. Le groupe EnBW aurait investi 1.2 milliard d’euro dans ce projet.

En savoir plus : http://www.bulletins-electroniques.com/actualites/66744.htm

Par S.B

LES BILANS :