En 1909, le chimiste Fritz Hofmann parvenait à produire une substance élastique, le méthylisoprène, posant ainsi la première pierre de l’édifice des caoutchoucs synthétiques. F. Hofmann était chercheur dans les laboratoires du fabricant de colorants « Farbenfabriken vorm. Friedr. Bayer & Co. », d’Elberfeld, une entreprise dont le groupe chimique de spécialités Lanxess AG est l’héritier.

Fritz Hofmann

Il est impossible d’imaginer le monde moderne sans le caoutchouc. Ce matériau est en effet indispensable, que ce soit pour les supports de machines ou de moteurs, la transmission des forces, le transport de liquides, l’étanchéification d’arbres en rotation ou de systèmes sous pression. Les élastomères hautes performances actuels n’ont pourtant pas beaucoup de points communs avec les matériaux obtenus à partir de caoutchouc naturel.

Nous n’irions pas très loin aujourd’hui avec les produits à base de caoutchouc naturel. En effet, depuis l’époque où l’on produisait les premiers manteaux, bottes, encriers et même peignes en caoutchouc (durci) obtenu par vulcanisation du caoutchouc naturel, la technique et les exigences requises de ce matériau ont énormément changé. Les températures plus élevées, les machines toujours plus rapides et les exigences croissantes en matière d’efficacité énergétique et de rentabilité font que les ingénieurs ont de plus en plus souvent recours à des types spéciaux. Même les pièces en caoutchouc banales, de faible coût, sont un facteur décisif pour la rentabilité de biens d’équipement onéreux : en effet, les produits à plus grande longévité, comme les joints et paliers particulièrement robustes, permettent de réduire les coûts de maintenance et donc d’assurer la rentabilité.

Au commencement du caoutchouc de synthèse…

Avant l’invention du caoutchouc synthétique par Hofmann, l’industrie a été pendant longtemps tributaire du caoutchouc naturel. Cette matière première, d’origine végétale, était soumise à des fluctuations de qualité et de prix. De plus, elle était pratiquement impossible à modifier chimiquement et s’est donc trouvée de plus en plus inadaptée aux besoins croissants de la technique. Les Farbenfabriken d’Elberfeld avaient donc offert une récompense de 20.000 marks au scientifique qui trouverait avant le 1er novembre 1909 « un procédé de fabrication de caoutchouc ou d’un substitut équivalent ».

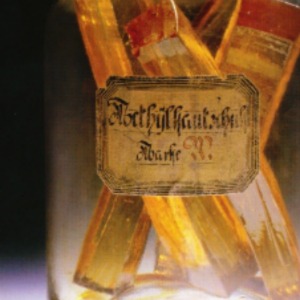

À l’époque, les connaissances sur le caoutchouc étaient assez rudimentaires et il avait fallu attendre 1905 pour comprendre que les molécules linéaires de ce matériau élastique étaient constituées de multiples composants constituant une chaîne et appelés « isoprènes ». On ne savait pourtant pas comment les réticuler, mais Hofmann s’attela tout de même à la tâche. Comme il était difficile de se procurer de l’isoprène, ce « composant du caoutchouc naturel », Hofmann se rabattit sur un parent chimiquement proche, le méthylisoprène, dont la production était plus aisée. Il remplit des boîtes métalliques de cette substance, les chauffa et attendit, des semaines, parfois même des mois. Selon la température de polymérisation, le contenu des boîtes se transforma en un matériau plus ou moins mou, mais toujours élastique, le caoutchouc méthyle. Le premier caoutchouc synthétique fut breveté il y a cent ans, le 12 septembre 1909.

Echantillons originaux de méthylcaoutchouc

Dès 1910, la société Continental, qui était déjà une grande usine travaillant la gomme, fabriquait les premiers pneumatiques de voiture à partir de ce nouveau matériau. Carl Duisberg, le patron d’Hofmann, parcourut 4.000 km « sans crevaison » dans un véhicule chaussé de pneumatiques en élastomère synthétique et même l’empereur allemand était « plus que satisfait » des pneumatiques du même type qu’il avait fait monter sur sa voiture personnelle.

L’empereur Guillaume II et ses nouveaux pneus

Découvrez les formations Techniques de l’ingénieur

… à son développement

Le caoutchouc synthétique a vu son importance croître encore quand les chercheurs, utilisant du sodium, sont parvenus à réaliser une polymérisation plus rapide et plus performante des composants du caoutchouc comme le méthylisoprène d’Hofmann. Dans les années 20 du siècle dernier, le sodium et les innombrables astuces utilisées par les successeurs d’Hofmann ont même permis de produire une autre gomme synthétique à base de butadiène, un parent chimiquement proche, mais « plus simple », de l’isoprène, le composant de base du caoutchouc naturel. Ce nouveau matériau allait devenir légendaire sous le nom de « Buna » (pour Butadien et Natrium, « sodium » en allemand).

Le caoutchouc Buna !

Pendant le premier tiers du siècle dernier, les chimistes ne cessèrent d’améliorer les caoutchoucs produits à partir du butadiène, la nouvelle matière de base. Quelque temps plus tard, les chimistes Walter Bock et Eduard Tschunkur franchirent l’étape suivante. C’est notamment à Walter Bock que l’on doit l’utilisation d’un autre additif très prometteur, le styrène, qu’il a associé au butadiène, créant ainsi le Buna S. Ce « caoutchouc styrène-butadiène » est encore aujourd’hui, sous une forme améliorée, l’un des principaux composants des pneumatiques de voiture. Dès leur commercialisation en 1936, les premiers pneumatiques à bande de roulement en Buna S ont très vite fait sensation, car ils duraient beaucoup plus longtemps. Le brevet portant sur la copolymérisation du butadiène et du styrène a été enregistré le 21 juin 1929.

Bock et Tschunkur, découvreurs de la copolymérisation Butadiène-Styrène : le Buna S

À cette époque, un autre élastomère issu des laboratoires de Leverkusen fit parler de lui, surtout en raison de sa résistance à l’huile : il s’agissait du caoutchouc nitrile Buna N, fruit des recherches effectuées par les chimistes Eduard Tschunkur, Helmut Kleiner et Erich Konrad. Leur équipe avait trouvé le « nitrile acrylique » alors qu’elle cherchait de nouvelles solutions intéressantes. Une fois de plus, c’est en variant les composants chimiques que les chercheurs purent obtenir un nouveau caoutchouc doté de propriétés tout à fait inédites. En effet, le nitrile acrylique est « polaire » et donc oléophobe. Le brevet correspondant a été enregistré le 26 avril 1930. Ce nouvel élastomère changea de nom en 1938, trois ans après le début de la production à grande échelle, et fut dès lors commercialisé sous le nom de Perbunan, pour mieux le distinguer du Buna S.

Et maintenant ?

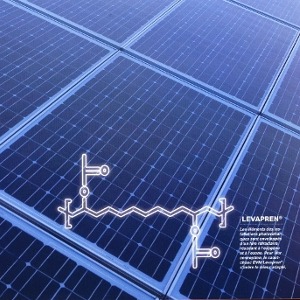

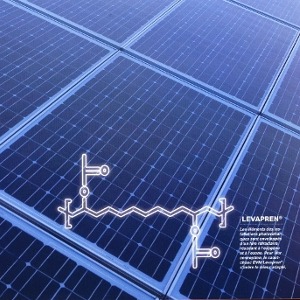

De plus en plus de caoutchoucs issus des réacteurs de l’industrie chimique, porteurs de nouvelles propriétés techniques, furent commercialisés. On peut citer le Baypren, le Levapren ou le Buna EP, utilisés dans les adhésifs, les tuyaux, les gaines de câble ignifuges, les joints résistants aux intempéries ou aux U.V. ou les articles en gomme translucide. À cela sont venues s’ajouter d’innombrables innovations dans le domaine des produits chimiques nécessaires à la production de caoutchouc, comme les antioxydants (agents antivieillissement) et les accélérateurs de vulcanisation comme le Vulkanox et le Vulkacit. Parmi ces développements, bon nombre sont dus aux études des chimistes et des techniciens travaillant dans les laboratoires de Lanxess.

Le caoutchouc Levapren enveloppant les installations photovoltaïques d’un film réfractaire, résistant à l’oxygène et à l’ozone.

En 2007, les industries du monde entier ont absorbé près de 13,6 millions de tonnes de caoutchouc synthétique et « seulement » dans les 9,7 millions de tonnes de caoutchouc naturel. Les spécialistes estiment qu’en raison de leurs propriétés, la part des caoutchoucs de synthèse augmentera plus rapidement que celle du caoutchouc naturel.

Le caoutchouc synthétique constitue aujourd’hui la base d’un grand nombre de produits hautes performances et restera à l’avenir indispensable à de nombreuses possibilités et applications.

Source : culturesciences.chimie.ens.fr