Qu’arriverait-il si l’humanité décidait de lancer des avions pour répandre des particules de dioxyde de soufre ou de calcium dans le ciel ? C’est la réponse que cherchent des scientifiques d’Harvard, du MIT et de Princeton dans une nouvelle étude parue dans Nature Climate Change.

Entre réduction des effets et nouveaux risques

La théorie est connue : ces particules renverraient une partie de la lumière du soleil dans l’espace, augmentant l’albédo planétaire. L’effet direct serait de refroidir temporairement la planète. En utilisant un modèle informatique dernier cri (HiFLOR), les chercheurs ont examiné les effets de cette technique si elle était utilisée pour réduire de moitié la hausse de la température mondiale due au réchauffement climatique.

Alan Robock, professeur de sciences de l’environnement à Princeton, a évalué 27 risques potentiels liés à cette technologie. De l’appauvrissement de la couche d’ozone à des sécheresses accrues, en passant par la réduction de la production d’énergie solaire. En pratique, le fait de réduire les températures de l’air en surface pourrait « réduire ou inverser les effets négatifs du réchauffement planétaire, notamment les inondations, les sécheresses, les tempêtes plus fortes, la fonte des glaces de mer et l’élévation du niveau de la mer ». Si la technique était globalement déployée, elle serait bénéfique à la majeure partie de la population. À la marge, moins de 0,5% de la population mondiale pourrait constater une augmentation des impacts du changement climatique.

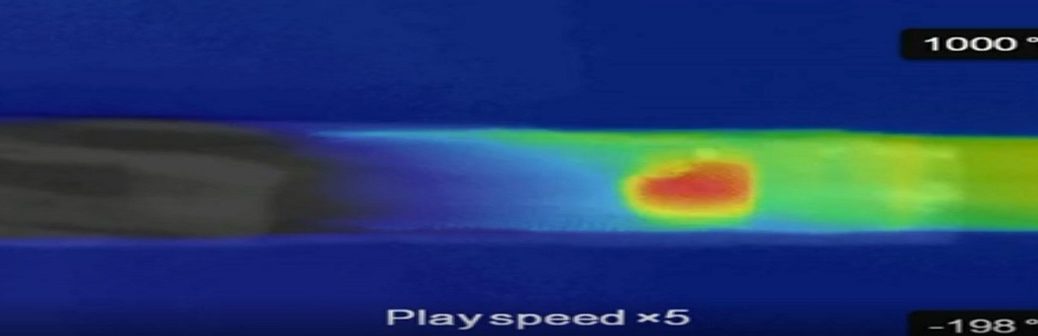

Des tests avec du carbonate de calcium

Plutôt que le dioxyde de soufre qui peut accélérer la destruction de la couche d’ozone, les chercheurs d’Harvard étudient la possibilité d’utiliser du carbonate de calcium. Ce produit peu dangereux – composant de la craie ou présent dans les dentifrices – pourrait éviter certains risques.

L’équipe réfléchit ainsi à effectuer une expérience sur le terrain. Elle consisterait à lancer un ballon dans la stratosphère. Suite à la libération d’une petite quantité de carbonate de calcium, les chercheurs mesureraient la dispersion de la lumière et les modifications de la chimie atmosphérique. L’équipe espère réaliser l’expérience cette année, mais attend l’avis d’un comité consultatif externe indépendant.

Une gouvernance à définir

« Pour nous, la gouvernance de ceci est tout aussi importante que les objectifs scientifiques de l’expérience », déclare Elizabeth Burns, directrice du programme de recherche en géo-ingénierie d’Harvard, à Fast Company. La question de la gouvernance est en effet fondamentale. Le coût du processus est estimé à moins de 10 milliards de dollars par an, contre des centaines de milliards de dollars pour s’adapter au réchauffement climatique. Alors qu’il pourrait affecter toute la planète, un seul pays pourrait donc décider d’agir unilatéralement.

« C’est une technologie très effrayante, reconnaît Elizabeth Burns. Mais le monde avec de graves impacts du changement climatique peut aussi être très effrayant. C’est nous effectuons des recherches afin de mieux comprendre les avantages potentiels ainsi que les risques potentiels liés à cette technologie. »

Un moyen temporaire pour mieux s’adapter

La géo-ingénierie est un domaine d’étude restreint qui renferme de nombreuses inconnues. « La géo-ingénierie ne peut se substituer à la réduction des émissions, car elle ne s’attaque pas à la cause fondamentale du changement climatique, rappelle Elizabeth Burns. Donc, si nous voulons instaurer un climat stable, nous devons réellement réduire les émissions à zéro, puis éliminer également le dioxyde de carbone présent dans l’atmosphère et le stocker sous terre ou ailleurs ». Alan Robock complète : « Cette solution ne pourrait être utilisée que temporairement, pendant que nous réduirions rapidement nos émissions dans l’atmosphère et trouverions des moyens peu coûteux de séparer le dioxyde de carbone. »