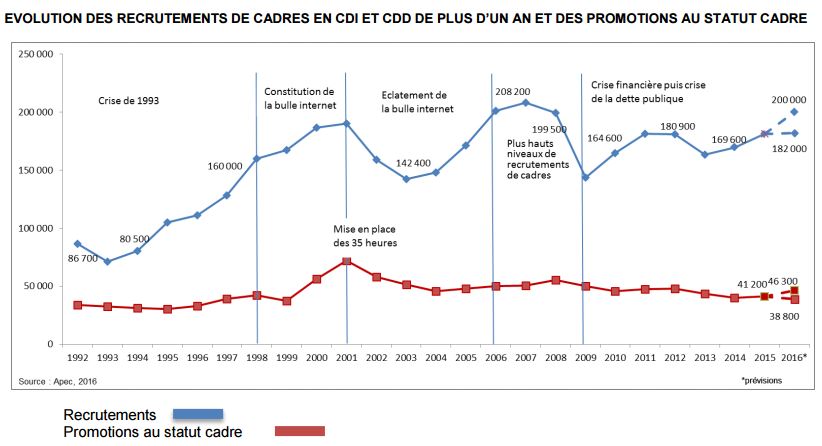

La confiance des entreprises, dans un contexte économique un peu plus favorable, s’améliore. Ainsi, 8% d’entre elles prévoient d’augmenter leur effectif cadre au cours de l’année, soit 1 point de plus qu’en 2015, et 5% d’entre elles envisagent de le réduire.

Contrairement à l’année 2014, caractérisée par un marché de l’emploi cadre à plusieurs vitesses, la dynamique à l’œuvre depuis 2015 concerne quasiment tous les secteurs de l’économie.

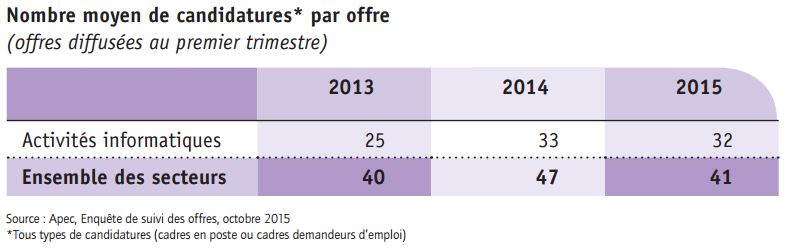

Les recrutements de cadres dans les Services, « locomotive » du marché, progresseraient jusqu’à +11% portés par les activités informatiques – télécommunications, l’ingénierie – Recherche et Développement, les activités juridiques, comptables-conseil et Gestion des entreprises et la Banque-Assurance.

L’Industrie tirerait son épingle du jeu, avec une croissance des embauches pouvant aller jusqu’à +9%.

En 2016, les jeunes diplômés, qui avaient déjà profité d’une situation plus favorable en 2015, bénéficieraient de l’amélioration du marché. Ainsi, de 39 500 à 43 400 débutants pourraient être embauchés durant les 12 prochains mois.

Les cadres ayant acquis de 1 à 10 ans d’expérience seraient toujours les plus courtisés, représentant un peu plus d’un recrutement sur deux.

En revanche, les embauches de cadres de plus de 16 ans d’expérience seraient en baisse.

Les fonctions les plus « porteuses » du marché seraient celles de l’Informatique (jusqu’à 42 300 embauches), du Commercial (jusqu’à 37 500) et des Etudes-recherche et développement (jusqu’à 32 400 embauches). Par ailleurs, la fonction Administration, RH, communication, droit atteindrait des hauts niveaux de recrutements, proches de ceux atteints en 2006-2008 (20 000).

Quasiment toutes les régions de l’Hexagone seraient bien orientées en 2016. Quatre territoires concentrent près de 3 embauches sur 4 : Ile-de-France, Auvergne-Rhône-Alpes, PACAC, Nord-Pas-de-Calais-Picardie. Seules deux régions devraient afficher une stagnation de leurs recrutements de cadres : la BourgogneFranche-Comté et la Normandie.

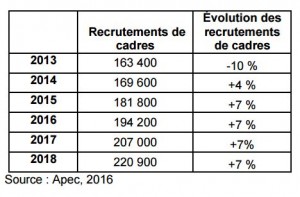

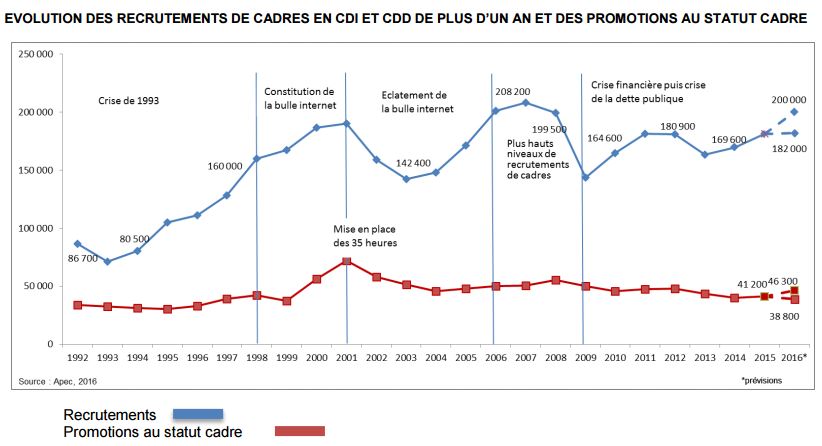

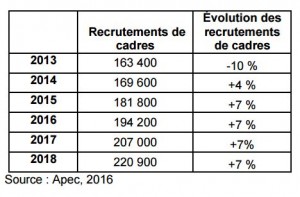

Enfin, le bilan de l’année 2015 est positif avec 181 800 cadres recrutés, soit 7% de plus qu’en 2014, et une sensible augmentation du nombre de postes cadres créés 1 : 28 800. Ce bon résultat est principalement lié à la performance des activités informatiques (+8%), de l’ingénierie-Recherche et Développement (+16%), des activités juridiques-comptables- Conseil (+14%) et de la Banque-Assurance (+11%). Ces quatre secteurs ont concentré 1 embauche sur 2 en 2015. Dans ce contexte, 38 200 jeunes débutants ont été embauchés en 2015, soit une hausse de +9%, pour retrouver le niveau d’embauches de 2012.

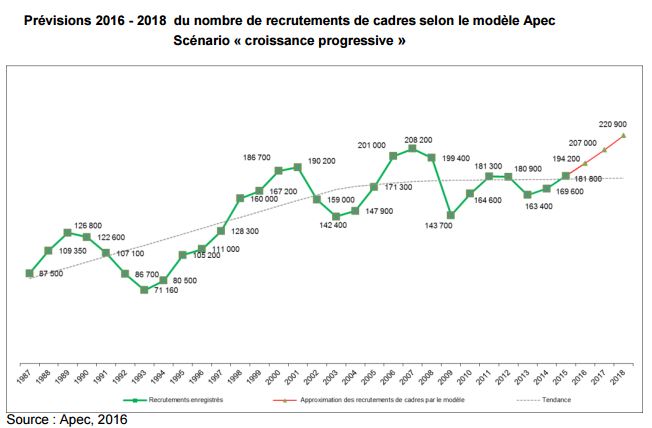

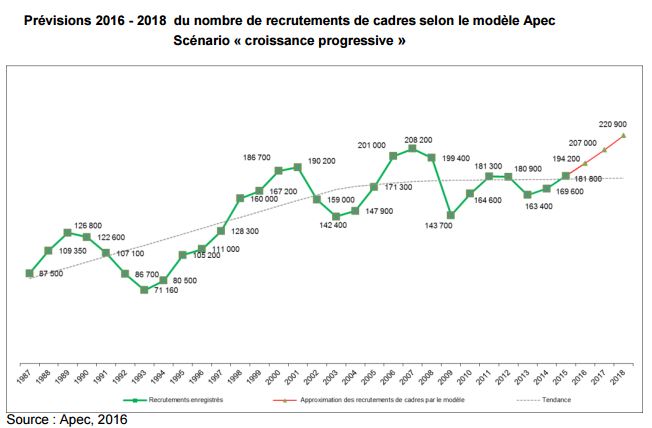

Prévisions à horizon 2018 : les résultats issus du modèle économétrique de l’Apec.

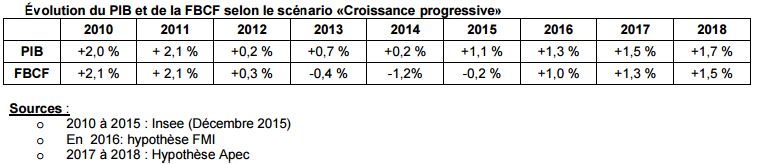

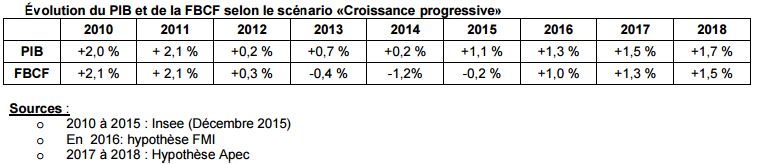

Le modèle construit en 2009 par l’Apec est le fruit des travaux de son Département Etudes & Recherche. Il a permis de montrer que l’investissement, mesuré par la formation brute de capital fixe (FBCF2 ), est au cœur de la dynamique de l’emploi en général et de l’emploi cadre en particulier.

Le modèle intègre également le niveau du PIB ainsi qu’une dimension démographique en tenant compte des départs à la retraite de cadres en emploi. Afin d’élaborer le plus précisément possible des scénarios, l’Apec s’est intéressée aux prévisions établies par différents instituts de conjoncture nationaux ou internationaux (INSEE, OCDE, OFCE, FMI, COE REXECODE).

Ces prévisions concernent le PIB et ses principales composantes (FBCF, dépenses de consommation, variations des stocks, exportations et importations.

Le scénario retenu table, pour les trois prochaines années, sur une « croissance progressive », avec des hypothèses de progression du produit intérieur brut de +1,3 % en 2016, +1,5 % en 2017, et +1,7 % en 2018, et s’appuie sur les analyses du FMI et de l’Insee.

En 2015, la conjonction de facteurs exogènes favorables (baisse continue du prix du pétrole, dépréciation de l’euro, taux d’intérêt très faible), qui avait boosté la croissance économique durant le premier trimestre, n’a pas été relayée par une reprise significative de l’investissement (la FBCF s’inscrit à la baisse pour la 3e année consécutive). Si, dans les entreprises, l’investissement productif a enregistré une nette progression, l’investissement public s’est contracté trimestre après trimestre. Quant à celui des ménages, il s’est stabilisé après deux ans de recul ininterrompu.

La croissance actuelle est adossée aux dépenses de consommation des ménages particulièrement dynamiques au 1er et 3e trimestre 2015. Mais les attentats de novembre 2015 ont eu de sévères répercussions sur les activités de services (restauration, loisirs, transports) et ont significativement érodé la consommation des ménages au 4e trimestre 2015 (-0,1 %).

Au final, la croissance économique s’est établie autour de +1,1 % en 2015. Dans ce scénario, elle se renforcerait sensiblement en 2016 (+1,3%). Ainsi, les effets des dramatiques évènements de novembre 2015 s’estomperaient au cours du 1er semestre 2016. Du côté des entreprises, les conditions seraient réunies (redressement des taux de marge, montée en charge du CICE et du pacte de responsabilité et de solidarité, faible coût du capital) pour enclencher, enfin le cycle d’investissement. La FBCF progresserait ainsi de +1 % en 2016 et s’inscrirait sur un sentier de croissance solide les années suivantes : +1,3 % en 2017 et +1,5 en 2018.

Quant au PIB, sa progression avoisinerait les +1,7 % en 2018 (après +1,5 % en 2017).

Dans ce contexte d’amélioration modérée du marché de l’emploi, la part des cadres en poste au moment de leur départ à la retraite progresserait et s’établirait à 54 % en 2018 (contre 50% en 2015).

Le taux de chômage devrait s’établir à 10 % (France métropolitaine) courant 2016. La consolidation de la croissance en 2017 et surtout en 2018 associée à une hausse de l’emploi supérieure à la variation de la population active pourrait permettre à l’économie hexagonale d’enregistrer un recul sensible du chômage à l’horizon de notre prévision.

Ces prévisions sont toutefois soumises à différents aléas. L’environnement économique international pourrait ainsi être affecté par un nouvel accès de faiblesse des pays émergents, et notamment de la Chine.

En 2016, le nombre de recrutements de cadres augmenterait de 7 %, à près de 195 000. Cette estimation dépasse la médiane des prévisions recueillies auprès des entreprises fin 2015 dans le cadre de l’enquête annuelle de l’Apec (de 182 000 à 200 000, médiane : 191 000). Elle demeure toutefois nettement inférieure au haut de la fourchette. Si la reprise progressive de l’investissement se confirme jusqu’en 2018, elle pourrait permettre de dynamiser les embauches de cadres. Les niveaux d’avant la crise de 2008 seraient largement dépassés en 2018.

Note méthodologique :

- Cette enquête a été réalisée auprès d’un échantillon permanent de 11 000 entreprises du secteur privé.

- Cet échantillon est représentatif de la répartition par région, par taille et par secteur d’activité des salariés du secteur privé.

- Les résultats présentés sont issus du traitement et de l’analyse des réponses de ces 11 000 entreprises représentant 1 130 000

salariés dont 208 600 cadres.

- Les entreprises ont été contactées du 15 octobre au 8 décembre 2015.

Source : Apec