“Terminator”, “2001, l’odyssée de l’espace”, “I, Robot” sont autant de films de science-fiction montrant comment l’intelligence artificielle deviendra un jour consciente d’elle-même, jusqu’à nous supplanter et menacer notre intégrité physique. Pourtant, dans la réalité, nous sommes loin, très loin de ce type de scénario.

Jean-Gabriel Ganascia, expert en intelligence artificielle et philosophe, chercheur au LIP6, le Laboratoire d’informatique de Paris 6, raconte l’histoire de l’I.A. : “ce terme est né en 1955, aux États-Unis. Il s’agissait d’étudier l’intelligence avec les machines, en simulant ses différents aspects”. Mais rapidement, déplore-t-il, “ce terme est devenu ambivalent, avec d’un côté le projet scientifique d’étude de l’intelligence avec des moyens artificiels (l’l.A. faible), et de l’autre, l’idée (entretenue par des chercheurs passionnés de science-fiction) de créer une intelligence avec les moyens de l’artificiel (l’I.A. forte)”.

Pour l’expert, l’idée qu’une machine “va tout à coup raisonner comme un homme et qu’un jour une intelligence artificielle générale aura conscience d’elle-même” n’est qu’un “pur fantasme”, qui n’existe pas sur le plan scientifique. Ainsi, il n’existerait, indique Jean-Gabriel Ganascia, qu’une seule intelligence artificielle : l’I.A. faible. Autrement dit, la simulation de l’intelligence et des capacités cognitives de l’être humain, via des techniques informatiques (algorithmes, programmation).

“C’est cette I.A. que l’on retrouve dans les systèmes de recommandation, dans les voitures intelligentes, dans les drones militaires, dans les systèmes de reconnaissance d’empreintes, ou dans la traduction automatique”, explique le chercheur.

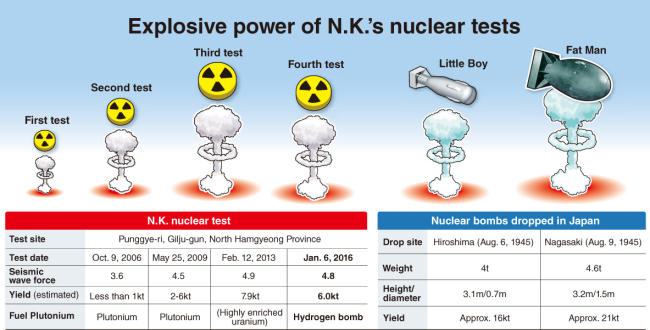

“L’I.A. est plus dangereuse que les armes nucléaires”

Pourtant, si l’on en croit des scientifiques réputés, en majorité anglo-saxons, l’I.A. forte, c’est pour demain. Elon Musk, président-fondateur de Tesla Motors et de SpaceX, estime ainsi qu’il faut rester “très prudent” à propos de l’intelligence artificielle. “Si je devais miser sur ce qui constitue notre plus grande menace existentielle, ce serait probablement ça”, a-t-il lancé en 2014 lors de l’AeroAstro Centennial Symposium du MIT. Pour lui, “L’I.A. est plus dangereuse que les armes nucléaires”.

De son côté, Stephen Hawking, physicien théoricien de renommée mondiale, joue au prophète : “le développement d’une pleine I.A. pourrait signifier la fin de la race humaine. Si elle finissait par devenir autonome, ce qui est probable, les humains, limités par leur lente évolution biologique, ne pourraient pas rivaliser”.

Avec Elon Musk et 700 autres scientifiques, Stephen Hawking a publié une lettre ouverte sur les dangers de l’I.A, qui se veut alarmiste : “en raison de son grand potentiel, il est important de se demander comment nous pourrons en profiter tout en évitant les pièges possibles”.

I.A. “superintelligente” et robots assistants

En 2014, le philosophe suédois Nick Bostrom, connu pour être un des penseurs du transhumanisme, a publié un ouvrage intitulé “Superintelligence”, dans lequel il analyse les bienfaits et les dangers de l’apparition d’une I.A. “superintelligente”.

Pour Nick Bostrom, si une telle entité venait à s’en prendre à l’homme, c’est surtout à cause de “l’orthogonalité” entre volonté et intelligence : pour poursuivre un but simple, une superintelligence choisira une solution simple. “Imaginons par exemple que nous lui demandions de fabriquer le plus grand nombre de trombones possible. Obnubilée par sa tâche, elle en viendrait à considérer que l’humanité est un obstacle à la production de trombones puisqu’elle peut décider à un moment ou à un autre que le compte y est. Logiquement, la super-intelligence se dirait que les humains ne sont après tout qu’un amas d’atomes qui, reconfigurés autrement, permettraient d’obtenir d’excellents trombones”, écrit le philosophe.

Les recherches en robotique faisant des pas de géant, le pire est-il à craindre ? Nous sommes encore loin d’avoir chacun un robot assistant à la maison, mais peu à peu, les robots commencent à investir notre quotidien.

Au Japon, dans l’usine de la société Glory, en banlieue de Tokyo, des humanoïdes-ouvriers font leur gym le matin en même temps que leurs collègue humains. En Allemagne, le robot de service “Max” aide des personnes âgées dans des maisons de retraite, comme le montre le documentaire édifiant d’Arte, “Au coeur des robots”.

Dans le domaine civil, nous n’en sommes encore qu’aux prémices d’une société robotisée. Mais en ce qui concerne le secteur militaire, c’est une autre histoire.

Robots tueurs et machines “autonomes”

Certes, il n’existe pas encore de “robots tueurs” autonomes, capables de décider seuls s’ils doivent tirer ou pas. Mais les chercheurs des armées du monde entier, à commencer par la DARPA, l’agence de recherche de l’armée américaine, travaillent à créer des “armes semi-autonomes” : ces avions ou frégates sans pilote, ces robots et ces machines nouvelle génération analysent une situation donnée, décident de la réponse à apporter, et en dernier ressort, un humain valide ou non la suite à donner.

En Corée du Sud, les SGR-A1, des “robots sentinelles” armés de lance-grenades et de mitrailleuses, défendent les frontières. La décision finale dépend d’un opérateur humain, mais rien ne dit que cette situation ne changera pas un jour.

Alors que depuis deux ans, Human Rights Watch (HRW) mène une campagne pour stopper ces “robots létaux autonomes” (RLA), Elon Musk et Stephen Hawking ont publié cet été une autre lettre ouverte, pour réclamer l’interdiction des armes autonomes et stopper une potentielle “course à l’armement” dans ce domaine.

Ces machines autonomes, qui existeront “probablement d’ici quelques années”, seraient là encore, pour Elon Musk et Stephen Hawking, “plus dangereuses que les armes nucléaires”. Pour Hod Lipson, ingénieur en robotique et directeur du Creative Machines Lab de l’Université Cornell, à New-York, “combinée avec des robots physiques, l’I.A. pourrait effectivement être dangereuse”. D’où l’idée que nous devrions nous “préparer dès maintenant” à l’arrivée de l’I.A. forte, et penser aux moyens de la canaliser.

“Rendre une machine consciente, c’est de la pure science-fiction”

Jean-Gabriel Ganascia insiste : “il est facile de simuler l’intelligence et des émotions, mais rendre une machine consciente, c’est de la pure science-fiction”. Et de constater : “il y a derrière tout cela une croyance en la toute-puissance de la technologie, très proche d’une religion… peut être celle des transhumanistes”.

En revanche, l’expert estime que l’I.A. véritable, la “faible”, comporte des risques à ne pas négliger. “Comment réagira une voiture sans chauffeur confronté à un dilemme, comme choisir entre un carambolage et écraser un piéton ? Les machines demeurent imprévisibles, elles peuvent faire des erreurs”, explique-t-il.

Restent des risques “plus factuels”, comme l’utilisation de nos données par les fabricants des systèmes d’I.A. – en premier lieu, des robots de compagnie, qui en sauront beaucoup sur nous : “les données utilisées par les systèmes d’I.A. se propagent, se dupliquent, et sont forcément stockées quelque part pour être réutilisées. Il ne faut pas oublier le scénario d’une utilisation à mauvais escient de ces nouveaux outils, par des personnes mal intentionnées”, remarque Jean-Gabriel Ganascia.

Au delà du scénario d’une intelligence artificielle inamicale façon Terminator, c’est bel et bien “l’impact de l’I.A. faible sur nos vies qui mérite d’être posé”, conclut-il. D’où son idée d’instaurer “un certain nombre de règles et principes éthiques” – pourquoi pas inspirés des lois d’Asimov.

Par Fabien Soyez, journaliste scientifique

.jpg)