Les prothèses métalliques remplacent des fonctions mécaniques. Dans ce cas, les médecins utilisent principalement du titane. Face aux propriétés mécaniques insuffisantes du titane sur le long-terme pour de grandes prothèses, et face à son prix extrêmement élevé, les chercheurs se sont tournés vers des alliages de ce métal. L’alliage le plus couramment utilisé est le TiAl6V4, à base de titane, d’aluminium et de vanadium.

Pour favoriser l’ancrage osseux du métal de la prothèse et maintenir le plus longtemps possible un os vivant autour de l’implant, les chercheurs s’intéressent aux traitements de surface. S’ils ont commencé par des traitements de surface avec des biocéramiques en phosphates de calcium déposés par torche à plasma, la maîtrise du procédé a pris du temps. Au-delà de 1300°C, les phosphates de calcium se décomposent et perdent leur propriétés biologiques. « Aujourd’hui, ces procédés sont mieux maîtrisés mais ce ne sont pas les meilleures solutions pour l’avenir, car les dépôts peuvent avoir plusieurs micromètres d’épaisseurs et, en l’absence de liaisons chimiques entre le titane et le phosphate de calcium, il y a des risques de fissures et libération de débris« , explique Guy Daculsi, Directeur de Recherche Inserm de classe exceptionnelle (DRE) à l’Université de Nantes, l’un des pères de l’os artificiel et des nouveaux biomatériaux, récompensé du prix George Winter de la Société Européenne des Biomatériaux en 2014.

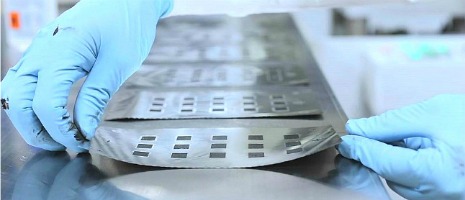

Pour éviter les couches épaisses, les spécialistes s’orientent plutôt vers des dépôts électrolytiques: ils déposent des phosphates de calcium par électrolyse à l’échelle nanométrique. Les ions ainsi déposés vont interagir avec les milieux biologiques et améliorer l’ancrage. Depuis quelques années, il existe aussi une troisième méthode permettant de créer des matériaux poreux métalliques. On parle de « métal trabéculaire« . Il s’agit de préparer l’implant en intégrant à la poudre de métal, un porogène ou une matrice poreuse. Lors du frittage, le porogène ou la matrice est calcinée, laissant en place la porosité. On obtient ainsi une mousse de titane ou de tantale. « On s’est aperçu que le traitement de surface microstructuré, avec des micro-porosités permettait d’améliorer l’hydrophilie de la surface des matériaux pour l’adhésion cellulaire, ou que le métal trabéculaire favorisait la colonisation cellulaire et la formation de tissu osseux dans les porosités « , nous livre Guy Daculsi.

Régénérer des pertes de substance, des tissus endommagés grâce aux cellules souches

Au lieu d’utiliser des prothèses métalliques pour remplacer des greffes osseuses, il est également possible d’utiliser des biomatériaux résorbables permettant de reconstituer les tissus osseux. La recherche est particulièrement riche dans ce domaine. Les chercheurs considèrent notamment des matériaux biodégradables associées à des cellules souches, qui se résorbent progressivement au fur et à mesure de la reconstruction des tissus.

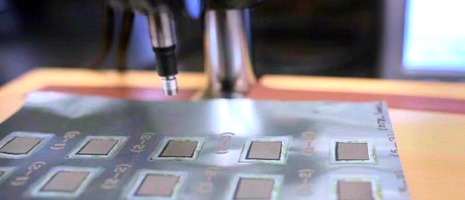

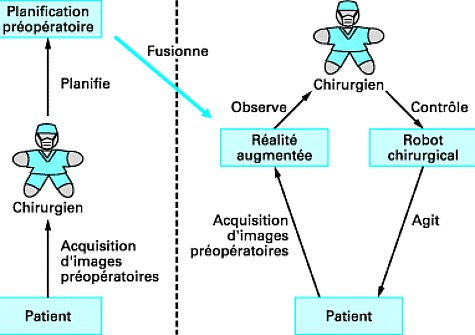

Grâce à la multiplication en laboratoire de cellules souches prélevées au niveau de la moelle osseuse du patient, il est possible de régénérer n’importe quel tissu. Sur ce point, le projeteuropéenREBORNEa permis de réaliser les premiers essais cliniques concluants. Il a notamment mis au point une matrice (un support) permettant de promouvoir ou d’induire la différenciation des cellules souches. La clé du succès est le contrôle de cette matrice qui sert de support, d’échafaudage à la différenciation cellulaire, et à l’expression phénotypique.

« Dans le cadre du projet REBORNE, une matrice très particulière a été utilisée, à savoir une matrice biocéramique en phosphates de calcium nano, micro et macro-structurée, capable d’être rapidement colonisée par les cellules souches, de façon à ce qu’elles puissent exprimer leur phénotype et s’orienter pour faire du tissu osseux« , explique Guy Daculsi. Pour reconstituer un os vivant, il faut également régénérer la vascularisation afin qu’il puisse apporter les nutriments. « Avec des phosphates de calcium, on est proche de la phase minérale de l’os naturel, on a aussi des micro-structures, des micropores qui peuvent aller de la dizaine de nanomètres jusqu’au micron, qui vont permettre d’absorber des fluides biologiques, un peu comme un buvard, et des macro-pores, de l’ordre de 100 à 600 microns qui vont être colonisées par les cellules et le tissu osseux néo-formé », ajoute-t-il.« Il y a alors des niches avec des populations cellulaires qui vont produire des ostéoclastes pour résorber l’implant, des ostéoblastes pour former de l’os nouveau, mais aussi des cellules pour régénérer une vascularisation« , poursuit-il. « L’avantage de cette matrice est qu’elle libère des ions calcium et phosphate qui vont aider les cellules à reconstruire le tissu osseux, à le minéraliser : ils sont totalement absorbés pour en refaire un os naturel« , affirme-t-il. Au final, « d’un matériau totalement synthétique, avec les apports cellulaires et des fluides biologiques, on a un matériau qui se résorbe, qui est absorbé progressivement et va se transformer en os naturel« , résume-t-il.

Si cette solution est particulièrement intéressante, le projet REBORNE a montré que ce traitement peut coûter plus de 20 000 euros par patient. De plus, les centres habilités à manipuler les cellules souches sont extrêmement rares. « On ne pourra faire que 200 à 400 patients dans toute l’Europe, donc cela ne sera pas démocratisable« , déplore le chercheur de l’Inserm.

En parrallèle de ce projet, on peut noter le développement des cellules souches allogéniques. Dans ce cas, les cellules souches vont être extraites de la moelle osseuse d’un donneur, au lieu d’être extraites directement du patient, puis être multipliées. On peut imaginer ici le développement de banques de cellules souches allogéniques, d’ici quelques années. Celles-ci seront prêtes à être utilisées dans le même type de matrice que dans le cas précédent. « Avec la multiplication de cellules de donneurs universels, on va entrer dans une généralisation des biotechnologies, et cela sera une complète démocratisation de la technique pour des coûts beaucoup moins élevés« , prévoit Guy Daculsi.

Et si on utilisait simplement de la moelle osseuse totale ?

En attendant cette généralisation,lamatrice développée dans le cadre du projet REBORNE peut déjà être directement utilisée au bloc opératoire de n’importe quel hôpital en faisant un simple prélèvement de moelle osseuse. Par centrifugation, les cellules blanches (dont une partie est constituée de cellules souches) sont ainsi extraites puis concentrées (technique MOCA Moelle Osseuse Concentrée Autologue). Des pionniers utilisent déjà cette technique à l’établissement français du Sang, au CHU de Tours et de Nantes, au CHU Henri Mondor et beaucoup d’autres centres hospitaliers en France, en Europe, mais aussi largement aux Etats-Unis. Dans ce cas, le prix de la procédure se situe autour de 2 000 euros et est donc 10 fois moins chère qu’avec des cellules souches prélevées sur le patient.

Cependant, « La qualité de la moelle et la quantité de cellules souches est très dépendante de l’état de santé du patient et de son âge. Chez un patient jeune, cela marche bien, mais chez un patient de 80 ans, le nombre de cellules souches est assez faible, et comme il n’y a pas de multiplication par culture cellulaire, le potentiel de réparation est moindre », prévient Guy Daculsi.La technique de concentré de moelle osseuse ne sera donc pas forcément très efficace. « En revanche, si on envoie les quelques cellules souches prélevées dans un centre de thérapie cellulaire, il va y avoir une multiplication d’une dizaine de cellules et en 3 semaines on va en avoir plusieurs millions, avec un potentiel de réparation plus important« , déclare-t-il . Mais cela reste très coûteux.

Là encore pour que cette technique fonctionne, il faut que la matrice soit résorbable, mais aussi soit nano, micro et macro structurée. Il faut savoir que sur les 70 à 75 substituts osseux de ce type développées dans le monde, seulement quelques uns ont démontré leur capacité et leur efficacité à être combinées aux cellules souches, ou avec les techniques de concentré de moelle osseuse. Elles sont commercialisées par les sociétés Xpand Biotechnology (Hollande) et BIOMATLANTE (France) partenaires du projet REBORNE.

Par Matthieu Combe, journaliste scientifique

Et aussi dans les

ressources documentaires :