Cette semaine dans la revue du Web :

- « Tippe Top », la toupie sens dessus dessous ;

- L’anagyre, la toupie qui ne tourne que dans un seul sens ;

- Jeu égal ? Un robot super champion de air-hockey ;

- Un bateau décharge sa cargaison de bois de manière spectaculaire

- Le gadget (inutile ?) de la semaine : une machine pour trier les Skittles et les M&M’s par couleur ;

- Et en bonus : l’art délicat de ramasser un marteau sur le sol lunaire.

« Tippe Top », la toupie sens dessus dessous

Triviales, les toupies ? Pour vous convaincre du contraire, débutons notre cinquante-sixième Revue du web avec « Tippe Top », une toupie pas vraiment comme les autres. Enthousiaste mais quelque peu malhabile, le testeur de la vidéo qui suit doit tout de même s’y reprendre à trois fois pour donner l’impulsion caractéristique à son petit joujou, tout juste déballé de son écrin, lui permettant d’effectuer les premiers tours comme l’une ou l’autre de ses consœurs toupies. Il ne faut pourtant pas beaucoup plus de quelques secondes pour voir « la magie » opérer : la toupie en aluminium semble perdre son équilibre, puis se dresse enfin… en se retournant ! C’est bien sur sa pointe, son manche, que la toupie à base sphérique termine son parcours, et ce pendant une petite dizaine de secondes, avant de se coucher comme une toupie classique.

Sujet d’étude depuis le début du dix-neuvième siècle, notamment par une Munichoise, Helene Sperl, la physique derrière la toupie « Tippe Top » n’est pas sans nous rappeler un autre phénomène physique, la « rotation de l’œuf dur » : un œuf dur mis en rotation à une vitesse d’environ dix tours par seconde se dresse, contre toute attente, à la verticale. L’élévation du centre de gravité de l’œuf serait directement liée à la transformation de l’énergie cinétique en énergie potentielle, due à un effet gyroscopique produit par le frottement entre l’œuf et la surface sur laquelle il tourne.

L’anagyre, la toupie qui ne tourne que dans un seul sens

Toujours pas convaincu(e)s ? Continuons alors avec une toupie d’un tout autre genre, répondant au doux nom d’« anagyre » : lancée dans un sens que nous qualifierons – évidemment – de bon sens, la toupie tourne sans aucun problème, avec majesté. Pourtant, une fois lancée dans l’autre sens, la toupie devient revêche, se rebelle et s’arrête de tourner pour finalement repartir… en sens inverse.

Redécouverte dans les années 70 par une équipe d’archéologues qui, pour tromper l’ennui, firent tourner nonchalamment des pierres de hache sur un plan de travail, pierres qui ne manquèrent pas de s’arrêter de tourner pour reprendre de plus belle en sens inverse, cette famille de toupie a donc un sens de rotation privilégié.

Prenant assez souvent la forme d’un ellipsoïde aplati, la plupart des anagyres cachent leur secret dans la distribution de leur masse interne : pour un anagyre d’apparence symétrique, les masses sont réparties de manière différente, selon que l’on se place sur l’un ou l’autre des axes de symétrie horizontal ; pour un anagyre d’apparence asymétrique, la répartition inégale des masses saute aux yeux.

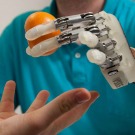

Jeu égal ? Un robot super champion de air-hockey

Lorsque Jose Julio réunit tous les composants nécessaires à la construction d’une imprimante 3D, la dernière chose que cet internaute espagnol semble vouloir faire est celle qui coule pourtant de source… Débrouillard comme pas deux, le petit génie ibérique désire se lancer dans un projet innovant, tout en faisant plaisir à sa fille, fan de air-hockey – un jeu assez populaire que l’on retrouve régulièrement dans les salles d’arcade, où un disque est maintenu en l’air à l’aide du souffle généré par de petites aérations aménagées dans la table de jeu. L’idée est lancée…

Une table, quelques trous à la perceuse, deux ventilateurs PC, et le terrain de jeu est prêt. Le robot est lui composé de trois moteurs, un pour se déplacer sur l’axe des abscisses, deux sur l’axe des ordonnées. L’algorithme de mouvement de l’imprimante 3D ne lui semblant pas assez réactif pour être efficace au air-hockey, il le modifie pour que chaque nouvelle commande de mouvement annule la précédente, ce qui permet au robot de rejoindre la position désirée le plus rapidement possible. Pour la détection du palet, il se sert d’une « Playstation Eye », la caméra numérique dédiée à la Playstation 3 qui utilise la vision par ordinateur et la reconnaissance des mouvements. Perfectionniste, la mise en œuvre de la stratégie et de la « science » de la trajectoire est une vraie réussite. Jose Julio a bel et bien créé un monstre, un Zubizarreta du air-hockey qui, non content d’être presque imbattable, se fend d’un petit « Can you beat me ? » qui saura ravir tous les mauvais perdants.

Un bateau décharge sa cargaison de bois de manière spectaculaire

Le transport du bois au Canada peut être beaucoup plus palpitant qu’une simple succession de camions sur les réseaux routiers ou que quelques barges se déplaçant en rang d’Oignon. Dans la province occidentale de Colombie-Britannique, le « Seaspan Survivor » livre sa gigantesque cargaison de rondins de bois de manière assez spectaculaire : s’inclinant peu peu jusqu’à atteindre un angle de près de 30 degrés par rapport au niveau de l’eau, le Seaspan Survivor abandonne sa cargaison en donnant l’impression de chavirer tout entier.

Après cette opération délicate, un second bateau viendra pousser les rondins vers le rivage pour en faciliter la collecte.

Le gadget (inutile ?) de la semaine : une machine pour trier les Skittles et les M&M’s par couleur

Dans la droite lignée de David Neevel – cet artiste farfelu qui s’était fixé pour objectif la mise au point d’une machine permettant de se débarrasser de la crème d’un Oreo, dont nous vous parlions déjà ici – notre gadget (inutile?) de cette semaine se propose lui aussi de résoudre un problème absolument majeur : pouvoir trier des petites confiseries (des Skittles et des M&M’s) par couleur, et les ranger dans de petits récipients dédiés à leur couleur respective.

Équipée d’un module Arduino Uno – lui-même construit autour d’un micro-contrôleur Atmel AVR – d’un capteur de couleurs, d’un capteur de mesure de distance, de plusieurs servomoteurs, et enfin complétée par quelques pièces conçues sur mesure sortant tout droit d’une imprimante 3D, la machine infernale peut venir à bout d’un sac d’un kilo et demi de ces petites gâteries en approximativement cinq minutes. Une découverte primordiale pour tout ceux qui ne supportent à aucun prix les M&M’s rouges. Ou jaunes. Étonnant, non ?

Bonus : de l’art délicat de ramasser un marteau sur le sol lunaire

Avec une gravitation près de six fois moins élevée que sur Terre, le moindre mouvement effectué sur le sol lunaire devient une expérience ô combien différente que sur notre bonne vieille planète. Pour conclure notre cinquante-sixième Revue du Web, jetons un œil dans le rétroviseur avec cette vidéo de l’astronaute américain Charles Duke, dixième homme a avoir foulé le sol sélène (en 1972), luttant comme un beau diable pour tenter de récupérer un marteau qu’il vient tout juste de faire tomber.

Copilote du module lunaire d’Apollo 16, Charles Duke passa un peu plus de 71 heures sur la Lune, dans une région de hauts plateaux, aux environs du cratère Descartes. L’une des missions de Duke était de collecter des échantillons, ce qui ne devait pas être chose simple au vu de la mésaventure du marteau, qui lui échappe des mains. S’ensuivent alors quatre tentatives infructueuses pour le récupérer à terre… pour qu’il finisse par abandonner, se dirigeant vers le rover à la recherche des pinces. Opération qui, cette fois-ci, fut couronnée de succès, bien que non filmée.

Par Moonzur Rahman

Et aussi dans les

ressources documentaires :

Et aussi dans l’actualité :