1,4 GW/2,3 GWh installés en 2017

Les vendeurs de batteries ont connu une année record en 2017. Ils ont installé l’équivalent de 1,4 GW de batteries en capacité représentant 2,3 GWh en énergie. Le marché a été porté notamment par l’Australie qui remporte la palme en termes de capacité (246 MW) et les Etats-Unis en termes d’énergie (431 MWh). Ces deux pays sont particulièrement propices à l’implantation de stockages par batteries, en raison d’une réglementation favorable et des prix de l’électricité élevés. En troisième position se trouve l’Allemagne puis la Chine. Selon le dernier rapport publié par GTM Research, l’Empire du Milieu devrait rapidement rattraper son retard et devenir le premier marché mondial d’ici 5 ans.

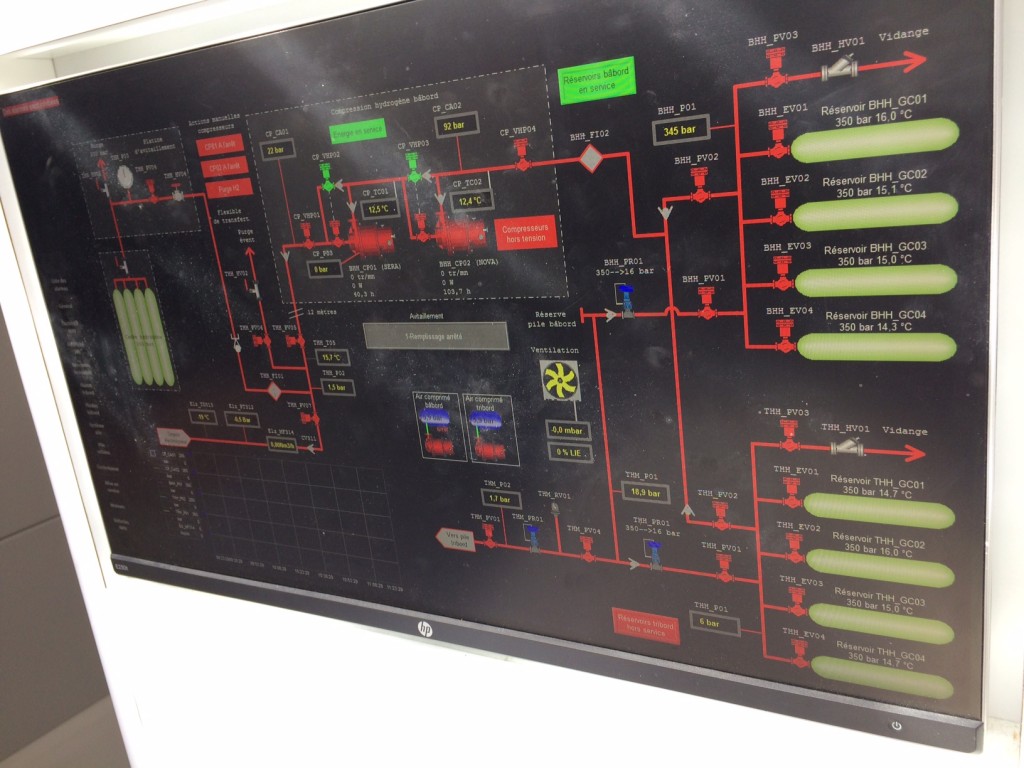

Mais en attendant, c’est l’Australie qui fait beaucoup parler d’elle. Elle a été le théâtre d’une compétition entre deux poids lourds du secteur : Elon Musk, pdg de Tesla, Solarcity et SpaceX, et Sanjeev Gupta, autre milliardaire, pdg de Simec Zen Energy. Ce dernier a annoncé en mars dernier la construction d’une batterie de 120 MW/140 MWh quelques mois seulement que le premier ait finalisé la construction de ce qui devait être la plus puissante batterie du monde (100 MW/129 MWh). Une course à la puissance qui s’est faite sous l’œil bienveillant des autorités australiennes qui subventionnent en partie ces installations pour éviter que ne se reproduise le black-out de 2016 qui avait privé d’électricité de très nombreux Australiens. Dans les deux cas, le stockage est couplé à des énergies renouvelables (EnR). En l’espèce, Elon Musk a choisi le parc éolien de Hornsdale (307 MW) exploité par le développeur français Neoen.

Couple renouvelables/batteries

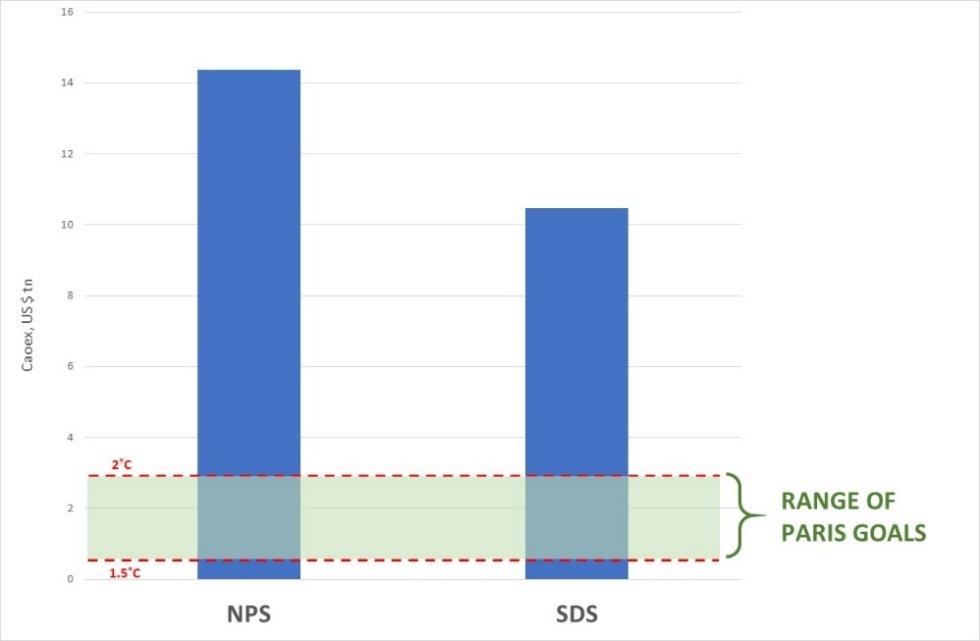

Selon un autre rapport publié par Bloomberg New Energy Finance (BNEF), le marché mondial du stockage par batterie devrait être multiplié par 64 entre 2016 et 2030, pour atteindre une puissance installée totale de 125 GW et une production de 305 GWh. Une croissance exponentielle qui n’est pas étrangère à la montée en puissance rapide des énergies renouvelables. Ces dernières, notamment le solaire photovoltaïque, ont dépassé toutes les prévisions des experts et pourraient rendre très difficile le contrôle de fréquence des réseaux électriques. C’est pourquoi les gestionnaires de réseaux multiplient les initiatives sur les batteries à l’instar de RTE en France qui développe le projet Ringo, visant à implanter des batteries faisant office de « lignes virtuelles ». Au niveau des gouvernements, de plus en plus d’appels d’offres EnR comportent dans leurs cahiers des charges un volet stockage pour réduire à la source le risque lié à l’intermittence. C’est notamment le cas lorsque ceux-ci concernent des zones non-interconnectées (ZNI) tels que les îles, dont les réseaux sont particulièrement vulnérables.

Gigafactories

Autre facteur de la montée en puissance du secteur des batteries : la baisse des coûts. Comme toujours, les économies d’échelle liées à la hausse des volumes ont fait baisser les coûts marginaux ouvrant de nouveaux marchés qui à leur tour ont élevé les volumes, etc. Cet effet d’entraînement a conduit à la création de Gigafactories telle que celle de Tesla aux Etats-Unis, ou encore, voire surtout celles de LG Chem et Samsung en Corée du sud. L’Europe, malgré des discours ambitieux, reste largement à la traîne. Le cercle vertueux des économies d’échelle laisse présager encore une baisse des coûts estimée entre 10 % et 36 % dans les cinq prochaines années.

Ces réductions des prix des batteries permettront d’alimenter une autre dynamique en cours : l’électrification des usages qui consiste à substituer l’électricité à d’anciennes sources d’énergie telle que pétrole. Le véhicule électrique en est l’une des meilleurs illustrations.

Par Romain Chicheportiche

Une équipe de l’Université technologique de Nanyang a programmé un

Une équipe de l’Université technologique de Nanyang a programmé un  La société de données politiques Cambridge Analytica a discrètement cherché à développer sa propre

La société de données politiques Cambridge Analytica a discrètement cherché à développer sa propre