La loi EEG avait été conçue par Hermann Scheer, député et prix Nobel alternatif pour son action en faveur des énergies renouvelables, à une époque où la part des ENR dans le mix électrique allemand était nulle. Des tarifs d’achats généreux avaient été accordés aux filières ENR débutantes, ce qui a permis leur émergence. D’abord en Allemagne, puis, grâce à la baisse des coûts de production engendrés, dans le monde entier.

Le pari a été réussi : en 2013 les ENR ont pesé 23% du mix électrique de l’Allemagne, ce qui est remarquable pour ce grand pays qui est la première puissance industrielle de l’Europe. « L’EEG ne va pas être réformée parce qu’elle a échoué, mais au contraire car elle a été un énorme succès » déclare le Ministère de l’économie et de l’énergie (BMWI) sur son site officiel.

Les tarifs d’achats des ENR, financés par les consommateurs par l’intermédiaire de leur facture d’électricité, sont aujourd’hui en moyenne, toutes filières confondues, de 17 centimes le kWh. D’une situation de niche, les ENR constituent à présent une composante majeure du mix électrique allemand. D’où la nécessité de revoir la Loi pour poursuivre la transition énergétique tout en veillant à une optimisation de son coût. L’objectif est de parvenir à un niveau d’ENR de 40-45% en 2025 et de 55-60% en 2035, ceci sans augmenter la facture des consommateurs. Compte-tenu de ce poids croissant des ENR dans le mix électrique, la note des consommateurs grimpe. Le gouvernement souhaite stopper la hausse de cette surcharge tout en poursuivant l’« EnergieWende », la transition énergétique allemande. Et c’est possible.

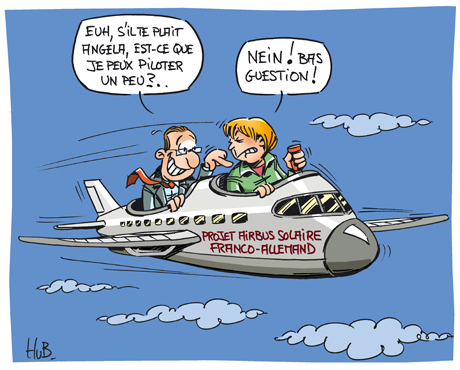

Comment ? En focalisant sur les filières qui ont vraiment du sens sur le plan économique : l’éolien terrestre et le photovoltaïque. Et en révisant à la baisse les dispositifs de soutien de l’éolien maritime et du biogaz. Pour Rainer Baake, il convient de « garantir que la transition énergétique soit un succès non seulement sur le plan écologique mais aussi économique ».

Vers un tarif d’achat unique à 9 centimes le kWh pour toutes les filières ENR

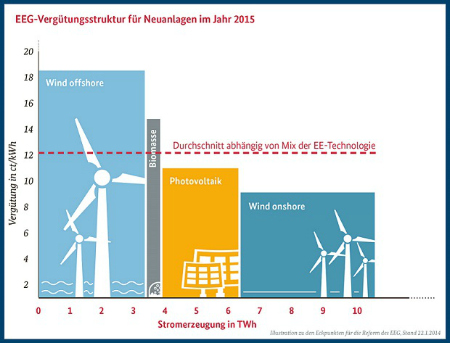

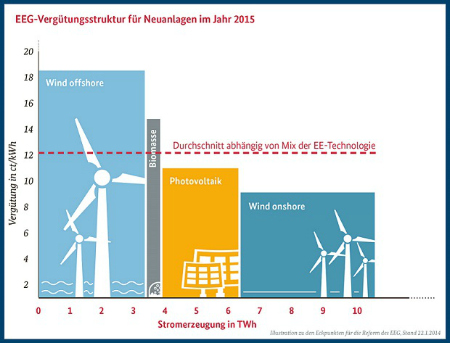

Dès 2015 l’objectif de l’EEG 2.0 est de faire baisser le niveau moyen des feed-in tarifs à 12 centimes. Quelques années plus tard, un tarif unique sera appliqué pour toutes les filières ENR : il sera de 9 centimes, ce qui sera inférieur au tarif d’achat du nouveau nucléaire EPR, 10,9 centimes le KWh, en Grande-Bretagne.

A partir de 2015 l’éolien terrestre sera acheté 9 centimes le kWh, le solaire PV 11 centimes, la biomasse 15 centimes et l’éolien offshore 18 centimes. Pourront bénéficier chaque année de cette rémunération 2500 MW d’éolien terrestre (équivalents à une production d’environ 4 TWh/an), 2500 MW de solaire photovoltaïque (environ 2,5 TWh/an) et 100 MW de biomasse (environ 0,5 TWh/an).

Pour l’éolien offshore, particulièrement coûteux, l’objectif initial de 10 GW pour 2020 a été ramené à 6,5 GW. Les Lands du nord de l’Allemagne, qui sont directement concernés par l’éolien offshore, s’opposent à cette réduction. Le gouvernement cherche un compromis mais il est clair que la logique de la rationalité économique n’est pas favorable à cette filière.

La réforme EEG 2.0 est indispensable pour que la transition énergétique allemande soit un succès. Soutenir de manière trop généreuse des filières coûteuses conduirait à une surcharge trop importante. Le risque serait alors un découragement des citoyens et ainsi une érosion de leur soutien qui reste cependant à ce jour très fort.

Le coût du solaire PV en forte baisse : le monde peut dire merci aux allemands

En Allemagne, le tarif du kWh électrique réseau est aujourd’hui entre 12 à 25 centimes hors taxes, et de 24 à 40 centimes TTC selon le volume de consommation. Le tarif d’achat réglementé du kWh PV était en 2013 de 10,25 à 14,80 centimes selon la taille des installations, et il suit étroitement le prix de revient. La parité réseau a donc été franchie. L’autoconsommation, qui permet d’éviter d’acheter l’électricité du réseau, est donc très avantageuse.

Il y a 10 ans les tarifs d’achat du PV s’élevaient entre 45 et 58 centimes, soit bien supérieurs à aujourd’hui. C’est grâce à cette politique de soutien volontariste qu’une importante industrie du PV a pu se mettre en place en Allemagne, puis en Chine, et permettre une baisse massive des coûts. C’est le monde entier qui, grâce à la politique énergétique allemande, va à présent bénéficier de panneaux solaires bon marché.

Ce fort soutien initial en faveur du solaire continuera de peser sur la facture des consommateurs allemands pendant 20 ans. Autrement dit les parcs solaires installées en l’an 2000 ne bénéficieront plus de tarif d’achat en 2020 et à partir de cette date ils produiront de l’électricité pour un prix de revient proche de zéro.

Une surcharge ENR qui va se stabiliser

La surcharge ENR sur la facture des consommateurs allemands est de 5,3 centimes par kWh en 2013. Le gouvernement souhaite qu’elle ne dépasse pas 6 centimes dans les années à venir.

Une analyse détaillée de cette surcharge est très instructive. Les tarifs d’achat proprement dits représentent 2,3 centimes. 0.2 centime pour l’éolien (première des ENR allemandes en volume de production), 0.6 pour la biomasse, 1.4 pour le solaire PV. C’est donc le solaire qui pèse le plus lourd. L’Allemagne a choisi de miser massivement sur cette future poule aux oeufs d’or dans l’intérêt général étant donné que cette filière a un énorme potentiel pour le monde entier. Cet effort s’inscrit dans une dimension éthique.

Sur le reste de la surcharge 0.8 centime correspond à la baisse du prix de l’électricité sur le marché. Ceci du fait notamment de la compétition solaire / gaz. La baisse se répercute sur la facture du consommateur compte-tenu du mode de calcul de la surcharge basé sur le différentiel entre le tarif d’achat et le prix du marché. La fermeture d’une partie des centrales au gaz devrait conduire peu à peu à une évaporation de cet effet de surcapacités.

Enfin 1,2 centime de la surcharge correspond à ce que payent les particuliers du fait de l’exemption dont bénéficient les industriels. Elle est considérée comme anormale par une large majorité d’allemands et qui fait l’objet d’un conflit avec la Commission européenne. Certes, comme le souligne Amory Lovins du Rocky Mountain Institute (Colorado), la baisse du prix de l’électricité sur le marché grâce aux ENR est positive pour l’activité industrielle allemande ainsi que pour les exportations d’électricité. Néanmoins une meilleure équité dans la répartition de la surcharge rendrait la transition énergétique moins onéreuse pour les citoyens allemands et serait alors perçue comme plus juste.

Décentralisation

84% des allemands veulent passer à une électricité 100% ENR le plus rapidement possible selon un sondage de septembre 2013. Mais les 4 plus grands groupes de l’énergie en Allemagne (ces « Große 4 » sont équivalents à EDF) ont très peu investi dans le solaire PV : seulement 0.2% du total du parc PV installé fin 2010. Ce sont les particuliers (39,3%), les agriculteurs (21,2%), les fonds et les banques (8,1%), les porteurs de projets (8,3%) et les commerçants (19,2%) qui ont le plus investi. Comme le soulignent dans un rapport du 12 septembre 2013 les experts de l’Institut Fraunhofer (point 8, page 31), « le solaire PV menace le business-model des 4 gros ».

La transition énergétique allemande est une lutte citoyenne pour l’émancipation vis-à-vis des grands groupes en situation de monopole. Le pays s’est fixé comme objectif 1/3 d’ENR en 2020, 1/2 en 2030, 2/3 en 2040 et 4/5 en 2050. Le système fédéral en place en Allemagne accorde une forte autonomie aux régions.

La culture allemande a permis l’émergence de cette dynamique d’autonomisation énergétique, dynamique qui est en revanche complètement étouffée en France comme en témoigne Marc Théry de la Communauté de communes du Mené au nord de la Bretagne. Selon l’Agence Fédérale Allemande des Réseaux, 32,4 GW de modules PV étaient installés fin 2012, répartis sur 1,3 million de centrales solaires dans toute l’Allemagne. La production électrique devient ainsi chaque année de plus en plus décentralisée.

Par Olivier Danielo

Et aussi dans les

ressources documentaires :

.jpg)

En décembre, c’est encore à Techniques de l’Ingénieur qu’Axon Cable fait appel, pour une formation d’une journée concernant le Value Stream Mapping (VSM), qui consiste à cartographier l’ensemble d’un cycle de production, pour mettre en exergue celles apportant une réelle valeur ajoutée, et travailler à la réduction des étapes sans valeur ajoutée. « Il s’agissait là d’une formation d’une journée pour ingénieurs et techniciens qualité et production, nécessaire car un de nos clients, grand groupe de l’aéronautique, exigeait que l’on adopte cette méthode, que de manière générale, de plus en plus de clients demandent », explique Bettina François. La formation VSM a été suivie de deux jours d’accompagnement par l’expert mobilisé par Techniques de l’Ingénieur, directement sur le cas concret de ce client.

En décembre, c’est encore à Techniques de l’Ingénieur qu’Axon Cable fait appel, pour une formation d’une journée concernant le Value Stream Mapping (VSM), qui consiste à cartographier l’ensemble d’un cycle de production, pour mettre en exergue celles apportant une réelle valeur ajoutée, et travailler à la réduction des étapes sans valeur ajoutée. « Il s’agissait là d’une formation d’une journée pour ingénieurs et techniciens qualité et production, nécessaire car un de nos clients, grand groupe de l’aéronautique, exigeait que l’on adopte cette méthode, que de manière générale, de plus en plus de clients demandent », explique Bettina François. La formation VSM a été suivie de deux jours d’accompagnement par l’expert mobilisé par Techniques de l’Ingénieur, directement sur le cas concret de ce client.