Les ouragans deviennent-ils plus fréquents à l’échelle du siècle ?

Pour les auteurs de l’AR5 « les bases de données existantes ne montrent aucune tendance significative dans la fréquence des cyclones tropicaux durant le siècle dernier » et « aucune tendance robuste dans le nombre des cyclones tropicaux, des ouragans et des ouragans les plus forts, n’a été identifiée lors des 100 dernières années dans le bassin Nord Atlantique ». Les experts du GIEC ajoutent que « la confiance est faible dans des changements à grande échelle de l’intensité des cyclones extra-tropicaux extrêmes depuis 1900 ».

Va-t-on subir une montée apocalyptique du niveau marin, comme dans le film d’Al Gore ?

Le film « Une vérité qui dérange », dont le visionnage conduit les spectateurs à frémir d’angoisse et à sombrer dans une grave dépression devant les conséquences d’une hausse catastrophique de 6 mètres du niveau marin, c’est-à-dire 35 fois plus que durant tout le XXème siècle, du jamais vu depuis plus de 10 000 ans, est-il scientifiquement fondé ?

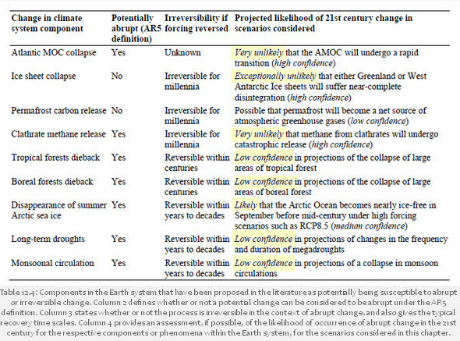

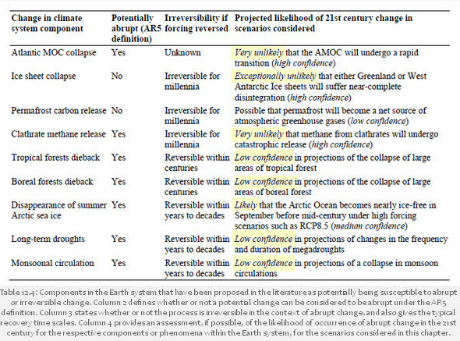

Après tout, c’est mathématique, une fonte de la calotte de l’Antarctique-ouest conduirait à une élévation d’environ 6 mètres du niveau marin, et celle du Groenland d’environ 7 mètres. Mais « il est exceptionnellement improbable qu’aussi bien les calottes glaciaires du Groenland et de l’Antarctique Ouest subiront une désintégration complète (Confiance élevée) » peut-on lire dans l’AR5 (chapitre 12. Table 12.4 page 78, rapport disponible librement en ligne depuis le site www.ipcc.ch). Ce point est très important du fait de ses conséquences sur le niveau marin, car ce sont les calottes polaires qui feront toute la différence.

Selon les scientifiques du programme Ice2sea (2013), dont les travaux n’ont pas pu être intégrés par le GIEC car parvenus trop récemment, le niveau marin pourrait monter entre 16,5 et 69 centimètres d’ici 2100, hypothèse haute qui ne fait pas consensus au sein de la communauté scientifique.

Entre d’une part 69 cm (au pire), soit la longueur d’une raquette de tennis standard ou 20 fois moins que l’amplitude des marées naturelles dans la baie du Mont Saint Michel et d’autre part l’amplitude retenue dans le film holywoodien d’Al Gore, il y a vraiment la marque du coefficient amplificateur des marchands de la peur. Le film de science-fiction de cet homme politique et businessman américain est d’ailleurs interdit de projection dans les écoles et les universités en Grande-Bretagne (et malheureusement pas en France), sauf si est indiquée au prélable aux jeunes esprits la liste des nombreuses affirmations non scientifiquement fondées qu’il comporte.

Va-t-on vers un arrêt du Gulf Stream, thème du film « Le jour d’après » ?

Absolument pas selon les scientifiques: « il est extrêmement improbable que l’AMOC (Atlantic Meridional Overturning, courant majeur lié à la circulation thermohaline et dont le Gulf-Stream est une branche) subira une transition rapide (Confiance élevée) » affirment-ils, toujours dans le chapitre 12.

Le GIEC estime en outre « faible » la probabilité « que le pergélisol devienne une source nette de gaz à effet de serre atmosphérique » et qu’ « il est très improbable (confiance élevée) que le méthane issu des clathrates subira un relargage catastrophique »

Voilà de quoi rassurer les plus angoissés. « Le sujet le plus intéressant du changement climatique du point de vue scientifique et le plus important du point de vue sociétal est la possibilité de changements climatiques brutaux avec des conséquences sociétales véritablement massives » commente Judith Curry, climatologue du Georgia Institute of Technology. « Le GIEC a une grande confiance dans le fait que nous n’avons pas de soucis à nous faire pour ces scénarios réellement dangereux (par exemple, la fonte des continents englacées et l’effondrement de l’AMOC) sur un échelle de temps du siècle » souligne cette experte indépendante de l’organisme onusien. Elle souligne en outre que le changement du climat n’est pas nouveau et est éternel: « ces catastrophes ont eu lieu dans le passé, sans intervention du réchauffement climatique anthropique, et elles se produiront inévitablement dans le futur, avec ou sans réchauffement climatique anthropique »

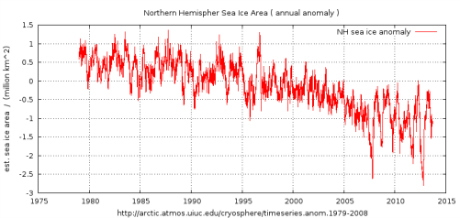

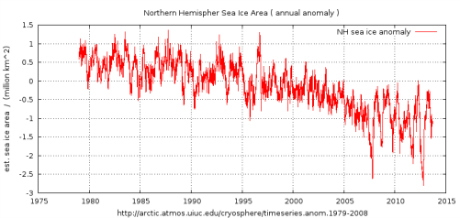

La banquise Arctique d’été va-t-elle disparaître dès 2016 ?

Après un article daté du 18 septembre 2012 intitulé « La banquise arctique pourrait complètement disparaître d’ici à quatre ans », dans un nouvel article du Monde paru le 12 septembre 2013 et intitulé « Polémique sur la fonte de la banquise arctique en 2013 », une journaliste du Monde met en avant, en conclusion de son exposé, les propos d’un scientifique qui prophétise une disparition totale de la banquise Arctique dès 2016. L’objectif de la journaliste était , selon-elle, de corriger le traitement du dossier banquise dans la presse anglophone suite au boom spectaculaire de la surface de la banquise Arctique d’été en 2013.

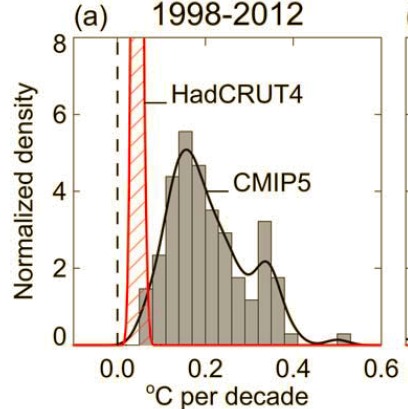

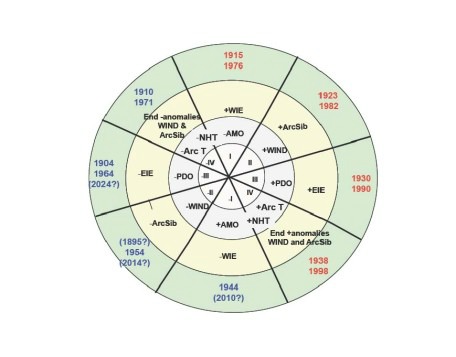

Pour de nombreux climatologues, au contraire, compte-tenu des oscillations naturelles du couple océan-atmosphère, la banquise Arctique pourrait voir sa surface augmenter durant les deux à trois décennies à venir. Il est pour ces chercheurs très improbable que la banquise Arctique d’été devienne libre de glace avant 2050. La théorie de « l’onde de stade [Stadium Wave Hypothesis] permet de prévoir que la banquise Arctique va se remettre de son minimum actuel, d’abord dans sa partie eurasiatique, puis ensuite dans la région sibérienne » affirme Marcia Wyatt , climatologue de l’université du Colorado. « Par conséquent, le minimum de banquise observé en 2012, suivi d’une augmentation de la banquise en 2013, est suggestif et cohérent avec le timing de l’évolution du signal de l’onde de stade ». La tendance est d’ailleurs clairement à la décélération depuis 2007, c’est à dire depuis 7 ans.

Il n’y a ainsi pas du tout consensus à ce sujet entre les scientifiques. Dans l’AR5, les auteurs affirment avoir une « confiance moyenne » sur l’hypothèse que « l’Océan Arctique devienne presque libre de glace en Septembre avant 2050 dans le cas des scénarios à forçage élevé comme ceux du RCP8.5 ». Il s’agit de 2050, pas de 2016, de « presque libre de glace » et non pas «complètement disparaître» et enfin cela ne fait pas consensus. Une confiance moyenne signifie que les avis sont partagés (Lire à ce sujet : La longue pause du réchauffement qui dure depuis plus d’une décennie et demie à l’échelle globale pourrait se prolonger jusqu’à la décennie 2030).

En 2007, la BBC, information reprise sans aucune réflexion par de nombreux médias francophones, faisait écho d’une étude prophétisant la disparition totale de la banquise d’été dès 2013. Cela ne s’est pas du tout produit, au contraire, on assiste depuis 2007 à une décélération du rythme du déclin de la banquise d’été, et le boom de 2013 est spectaculaire (+ 60% comparativement à 2012). Il était donc légitime que les journalistes anglais bien informés réagissent et ironisent. Il est regrettable que cela n’ait pas servi de leçon aux prophètes de malheur français qui croient bon exagérer systématiquement pour effrayer leurs lecteurs.

Va-t-on subir des sécheresses intenses ?

C’est un point qui inquiète en particulier les agriculteurs. Selon le GIEC, il y a une « faible confiance dans les projections des variations de la fréquence et la durée des méga-sécheresses. Faible confiance dans les projections d’un effondrement de la circulation des moussons. Faible confiance dans les projections qui prévoient un effondrement de grandes zones des forêts tropicales. Faible confiance dans les projections qui prévoient un effondrement de grandes zones des forêts boréales. » En résumé, on ne sait pas. Il n’est pas scientifiquement fondé d’affirmer que nous allons subir des méga-sécheresses plus fréquentes et plus intenses. Ceux qui affirment le contraire sont des militants qui ne respectent pas l’éthique scientifique.

A propos des inondations les experts du GIEC considèrent qu’ « en résumé, le manque de preuve persiste en ce qui concerne le signe et la grandeur et/ou la fréquence des inondations à l’échelle globale, ce qui se traduit par un indice de confiance faible ». Il ajoutent qu’« en résumé, il y a une faible confiance dans les tendances observées pour les phénomènes météorologiques violents à petite échelle tels que les grêles, les orages, à cause de l’inhomogénéité des données et de l’inadaptation des systèmes de suivi ».

Les scientifiques reconnaissent d’ailleurs avec honnêteté, mais ces propos sont perdus au milieu de deux milliers de pages, qu’« au vu des études mises à jour, les conclusions de l’AR4 (Le rapport 2007 du GIEC ndlr) concernant une augmentation des sécheresses depuis les années 1970, ont été probablement surestimées ».

Séparer le bon grain de l’ivraie et de l’ivresse catastrophiste

Le décalage est déjà appréciable entre les conclusions des scientifiques dans le volumineux AR5 et le petit résumé destiné aux décideurs, dont chaque phrase est destinée à être techniquement relativement exacte mais tournée de façon à ce que l’effet sur les lecteurs soit le plus amplifié possible.

Mais l’écart avec ce qui est transmis par les grandes agences de presse, puis dans une bonne partie des grands médias français, dont les journalistes bien souvent sans formation scientifique sont parfois aidés de climatologues politisés qui acceptent de sacrifier l’esprit scientifique au nom d’une conception personnelle de l’éthique environnementale, est encore plus grand.

« Ce tableau [du rapport scientifique du GIEC, ndlr] devrait vous permettre d’apaiser les angoisses des nombreux alarmistes du pergélisol, des clathrates, de l’arrêt du Gulf-Stream, du dépérissement des forêts, des sécheresses à répétition, des moussons interrompues etc. qui s’expriment fréquemment dans les médias et sur la toile » estime Jacques Duran, ancien Vice-Président, Chargé de la Recherche, de l’Université Pierre et Marie Curie, qui, à présent à la retraite, est devenu spécialiste en correction des propos tenus par les exagérateurs climatiques.

« Quelle meilleure réponse peut-on leur apporter que le rapport AR5-2013 du GIEC lui-même ? » s’interroge le Professeur, soulignant l’écart considérable dans le traitement du dossier climatique entre d’un côté la France et de l’autre la Grande-Bretagne et l’Allemagne, où les citoyens ont accès à une information bien plus complète et équilibrée. « Il se pose un problème de déontologie journalistique » a estimé récemment Vincent Courtillot, Directeur de l’Institut de Physique du Globe de Paris et membre de l’Académie des Sciences.

L’espèce humaine est-elle « menacée de disparition » ? Allons nous « droit dans le mur ? » Les mots sont violents. Il est essentiel, pour tout citoyen éclairé, de distinguer ce qui relève de la science climatique, jeune et balbutiante, de ce qui relève de considérations politiques personnelles. Fussent-elles diffusées par des journaux dits « de référence ». Si la science « ne ment pas », la politique, elle, fait du biais, de l’approximation, voir du mensonge éhonté, notamment par omission, un véritable art. Al Gore en est l’une des illustrations les plus caricaturales.

Par Olivier Daniélo

Et aussi dans les

ressources documentaires :