Le courant continu consiste en un mouvement des charges dans un seul sens, avec une tension constante. C’est ce type de courant qui est par exemple généré par la première pile du monde, celle mise au point par Alessandro Volta (1800). C’est aussi celui qui est délivré par les modules photovoltaïques et qui utilisé par les ordinateurs, les téléviseurs et les téléphone portables.

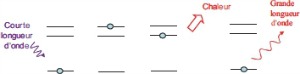

Avec le courant alternatif, les charges se déplacent successivement dans un sens puis dans l’autre. Ceci au rythme d’un alternateur, constitué d’un rotor aimanté qui tourne à une fréquence donnée et d’un stator, permettant l’induction électromagnétique.

Les alternateurs de bicyclette, les éoliennes ainsi que toutes les centrales thermiques génèrent ce type de courant. La tension obtenue est sinusoïdale et les fréquences (nombre de tours par seconde) utilisées aujourd’hui dans le monde sont le 50 Hz et le 60 Hz.

Le courant continu possède une « tare congénitale », qui sera fatale aux efforts d’Edison : il est en effet impossible d’augmenter directement sa tension. Or, à puissance délivrée égale, augmenter la tension permet de diminuer l’intensité et donc de diminuer à la puissance 2 les pertes par effet Joule ((P = U x I) où U est la tension et I l’intensité. L’effet Joule (RI2) est l’effet thermique associé à la résistance électrique (R). Plus les pertes par effet Joule sont importantes, moins loin pourra être transférée l’énergie électrique.

L’Edison Illuminating Company parvient en 1884 à alimenter 508 clients (10.164 lampes) localisés sur un rayon d’environ 1,5 kilomètre autour d’un générateur à courant continu (110 volts) installé à Pearl Street, au coeur de Manhattan, New York. L’exploit est historique et marque le début d’un business très prometteur. Mais Edison ne parvint pas à dépasser cette distance très limitée.

L’invention du transformateur ouvre le règne de l’alternatif

Parallèlement, le Français Lucien Gaulard et l’Anglais John Dixon Gibbs réussirent les premiers, en 1883, grâce à un courant alternatif et une tension de 2.000 volts, à transporter de l’énergie électrique sur une distance de 40 km, pulvérisant l’exploit d’Edison. Plus encore, Lucien Gaulard réalise une véritable rupture technologique en mettant au point en 1886 le transformateur. Il devient ainsi possible d’augmenter la tension du courant alternatif et d’allonger considérablement les distances de transfert électrique.

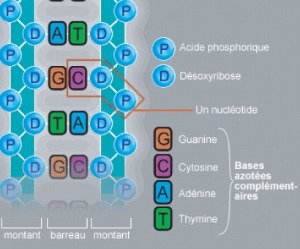

Le transformateur, constitué de deux bobines de cuivre au nombre de spires différent, permet d’augmenter ou d’abaisser la tension alternative par induction électromagnétique. Étant donné qu’il n’y a pas de variation de champ magnétique avec le courant continu, variation nécessaire à l’induction, le transformateur ne peut donc fonctionner qu’avec du courant alternatif.

Facteur aggravant pour Edison, en 1887, une autre innovation apparaît avec Nikola Tesla : celle du courant triphasé (trois sinusoïdes) qui économise entre 30 et 50 % de matériau au niveau de la ligne électrique, facilitant la construction des lignes et la réduction des pertes.

L’homme d’affaires Westinghouse saisit immédiatement l’opportunité, dès 1887, fait breveter un transformateur, puis réalise à Buffalo le premier réseau à courant alternatif du monde pour l’éclairage.

En 1891, la première expérience pour le transport d’énergie sur longue distance est faite en Allemagne, avec une ligne électrique de 175 kilomètres entre la centrale hydroélectrique de Lauffen sur Neckar et Francfort, avec seulement 25% de perte. Battu sur le plan technologique, Edison, qui est allé jusqu’à électrocuter un éléphant pour monter les dangers inhérents au courant alternatif, perd alors l’énorme marché américain de l’électrification.

Les redresseurs au secours du courant continu

Les défenseurs du courant continu ne s’avouent pas vaincus pour autant et poursuivent leurs recherches. Mais par quel artifice augmenter la tension du courant continu ? Le Suisse René Thury, surnommé le « roi du courant continu », propose alors de brancher plusieurs générateurs en série. En 1906, une liaison de 200 km, sous 75 kV, est construite avec succès entre la centrale hydroélectrique de Moutiers et Lyon. L’approche montre toutefois ses limites et se révèle rapidement non compétitive. Pendant ce temps, le courant alternatif continue sa fulgurante progression.

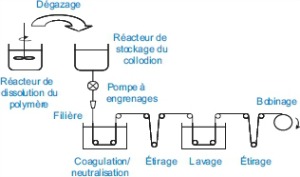

Une seconde stratégie émerge alors, notamment de la part des Suédois: utiliser du courant alternatif, augmenter la tension avec un transformateur puis redresser et lisser (le redressage et le lissage de tension, c’est l’inverse de ce que fait un onduleur dans une installation photovoltaïque) le courant alternatif haute tension obtenu pour en faire du courant continu haute tension. Une évolution qui n’a été possible qu’avec l’apparition des premiers redresseurs de tension aux vapeurs de mercure (il s’agit de diodes, c’est-à-dire de dipôles non linéaires et polarisés.) au milieu du XXe siècle. Mais le coût de ce lourd arsenal technologique était rédhibitoire.

Atlantropa ou l’émergence du concept de supergrid

A l’issue de la Première Guerre mondiale, l’état de l’Europe inquiétait de nombreux intellectuels, comme l’architecte allemand Herman Sörgel. Ce dernier rencontra Oswald Spengler, l’auteur du livre Le Déclin de l’Occident, et craignit que l’Europe ne sombre dans une pénurie de ressources alimentaires et énergétiques provoquant un nouveau conflit planétaire.

Né d’un père constructeur de barrages hydroélectriques en Bavière, Herman Sörgel élabore alors un plan pour donner un nouveau souffle le à l’Europe : construire un énorme barrage hydroélectrique au niveau du détroit de Gibraltar pour fermer la mer Méditerranée, et créer ainsi, du fait de l’évaporation solaire, un dénivelé d’une dizaine de mètres avec l’océan Atlantique ! Un débit d’eau de mer équivalent à 12 fois les chutes du Niagara aurait alors permis de générer des quantités phénoménales d’électricité hydrosolaire, qu’il fallait ensuite distribuer. Herman Sörgel conçut alors en 1928 un réseau d’autoroutes d’électricité haute tension à l’échelle de l’Afrique et de l’Europe qu’il baptisa « Atlantropa ». Il est le premier à avoir imaginé un supergrid à l’échelle continentale. Atlantropa suscita, à l’époque, une véritable passion. l’hydroélectricité, cœur des premiers projets de super-réseaux.

Quelques années après, en mai 1929, à l’occasion d’un colloque organisé par le groupe du sud-est de la Société française des électriciens, un certain Georges Viel présente un plan visant à construire en Europe un réseau de 3.000 km sous 400 kV. Cet ingénieur français soulignait qu’avec du 220 kV seulement, il était difficile d’envisager l’exploitation de ressources hydroélectriques éloignées de 1.000 km, mais que cela devenait possible avec un réseau 400 kV. Il comprit que l’interconnexion de la France avec l’Italie, l’Espagne et l’Allemagne permettrait de mutualiser les réservoirs hydroélectriques, et d’économiser la ressource charbon. Dans les années 1930, l’Allemand Oskar Oliven proposa un réseau de 9.750 km sous 200 et 400 kV, permettant de relier le Portugal, la Norvège et la Russie.

Le Suisse Ernst Schönholster vint avec un plan similaire. L’Allemagne hitlérienne, qui avait l’ambition de construire la « Neuropa » (Nouvelle Europe), reprit les idées d’Oliven. Le régime nazi élabora alors un plan de supergrid s’étalant entre Londres, Oslo, Barcelone et Donetzk en Ukraine. Le projet fut abandonné suite à la victoire des Alliés en 1945.

20.000 lieues sous les mers

Ce sont les liaisons électriques sous-marines qui ont permis au HVDC de démontrer sa compétitivité pour la première fois. En effet, dans ces conditions, le courant alternatif souffre de l’effet capacitif (l’effet capacitif, quand il est parasite, désigne l’accumulation de charges entre deux lignes conductrices).

La première ligne HVDC sous-marine commerciale du monde, entre l’île suédoise de Gotland et le reste du pays, a été inaugurée en 1954. Le HVDC s’imposa alors dans les liaisons sous-marines et souterraines de plus de 50 km. De nombreuses autres liaisons sous-marines HVDC ont été construites depuis, notamment celle r e l i a nt l a France à l’Angleterre (1961) et celle reliant le Danemark à la Norvège. La plus longue du monde, NorNed 1, mesure 480 kilomètres et relie les Pays-Bas aux réservoirs hydroélectriques norvégiens. Dans les années à venir, une liaison HVDC de plus de 1.000 km reliera l’Islande à la Grande-Bretagne. La conquête terrestre par le HVDC n’arrivera

qu’ensuite.

HVDC : la sortie des eaux

Si le HVDC remporte sa première victoire sous l’eau, sur terre, en revanche, il faut attendre l’arrivée de progrès technologiques sur les redresseurs permettant de travailler à des tensions plus élevées (en électronique de haute puissance) pour que débute son développement. Dans les années 1970 apparaissent les semiconducteurs, et notamment les thyristors, qui se déclinent au début du XXIe siècle en de nombreuses variantes. Aujourd’hui encore, le fait que, par unité de puissance transférée, les pertes par effet Joule soient deux fois plus faibles en courant continu qu’en alternatif ne suffit pas, pour les distances inférieures à environ 500 km, à rendre le HVDC économiquement pertinent. Le HVDC nécessite en effet la construction de deux convertisseurs de tension à chaque extrémité de connexion, l’un convertissant le courant alternatif en courant continu, l’autre faisant l’inverse, tout ceci avec une électronique de haute puissance coûteuse. Pour les projets portant sur de très grandes distances, comme par exemple relier les centrales solaires d’Afrique du Nord à l’Europe, le HVDC est en revanche tout à fait pertinent.

« Il est aujourd’hui possible de transmettre 6.000 MW par ligne entre le Sahara et l’Europe centrale et même le nord de l’Europe », affirme le Suédois Gunnar Asplund, directeur R&D chez ABB Power Technologies Grid Systems. « Transmettre 700 TWh (environ 20% de la demande électrique de l’Europe, ndlr) requiert une capacité de transmission d’environ 150 GW. 25 lignes seraient donc nécessaires à un coût total (conditions européennes) d’environ 60 milliards d’euros. Cela correspond à un coût par kWh d’approximativement un demi-centime d’euro. » Autrement dit, compte tenu de la différence significative d’ensoleillement direct annuel, l’électricité thermosolaire saharienne, coût de l’infrastructure de transport et pertes d’énergie inclus (environ 10% sur cette distance), est plus économique que le solaire produit dans le sud de l’Europe. Et a fortiori ailleurs en Europe.

Le SuperGrid, catalyseur d’une europe de l’énergie durable

De 1945 à nos jours, des liaisons électriques ont été établies au coup par coup entre les différents pays européens, mais sans cohérence d’ensemble à l’échelle européenne. Les centrales nucléaires et celles à combustibles fossiles peuvent être construites à proximité relative des lieux où sera consommée l’énergie, ce qui a réduit l’intérêt de l’approche SuperGrid.

Même si l’électricité est le premier secteur industriel à avoir instauré une véritable politique européenne, ceci avant même la mise en place de la Communauté européenne du charbon et de l’acier (CECA), il a fallu attendre, d’une part, l’émergence des préoccupations environnementales face aux risques associés au nucléaire et aux énergies fossiles, et, d’autre part, la prise de conscience du colossal potentiel du solaire et de l’éolien pour qu’une véritable renaissance de l’intérêt envers le concept de SuperGrid paneuropéen apparaisse.

Avec la montée des énergies renouvelables fluctuantes dans les mix électriques de nombreux pays et la concrétisation du courant continu à haut voltage, l’approche d’un super-réseau mutualisant les outils de stockage devient particulièrement pertinente.

Par Olivier Daniélo

.jpg)