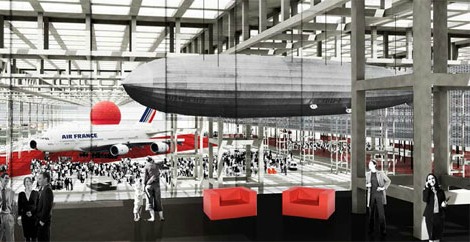

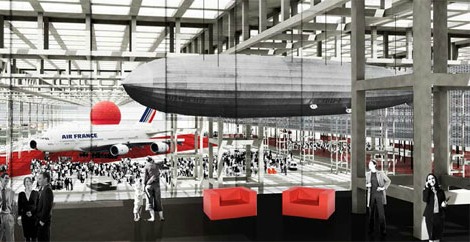

Le futur ministère de la Défense, « le projet Balard »

Le site Balard devrait être effectif d’ici 2015. Il réunira les états-majors (EMA, EMAT, EMM, EMAA), la Direction Générale pour l’Armement (DGA) ainsi que les directions et services du Secrétariat Général pour l’Administration (SGA). Par la mutualisation des moyens de fonctionnement, le site devrait être ainsi plus économe : le ministère doit vendre plusieurs sites parisiens dont il n’aura plus l’utilité pour une somme comprise entre 700 et 800 millions d’euros.

Le futur ministère de la Défense est un projet architectural ambitieux, qui accueillera 9 300 personnes pour une surface de 330 000 m2. Les conditions de travail du personnel se verront améliorées par la création de centres de restauration, de chambres d’hébergement pour le personnel militaire, d’une piscine, de crèches, de centres de soins, d’amphithéâtres, de salles de conférence, etc.

Les travaux ont débuté en mars dernier. Outre la conception de nouveaux bâtiments, le projet prévoit la réhabilitation de bâtiments existants. La conception et la réalisation de la construction ont été confiées à Bouygues Bâtiment Ile-de-France.

La maintenance et les services des bâtiments seront assurés pendant 27 ans par Exprimm, Thales et Sodexo. Ce regroupement d’entreprise porte le nom d’« Opale Défence ». Quant aux financements, il s’agit d’un contrat de partenariat public-privé (PPP). Ce n’est qu’en 2045 que l’État en sera propriétaire, au terme d’un loyer de 3,5 milliards d’euros.

[1/9]

Le Centre Hospitalier Sud Francilien

Le Centre Hospitalier Sud Francilien, situé entre les villes d’Evry et de Corbeil-Essones, devait être le projet emblématique des PPP (partenariat public-privé), témoin de « la modernisation de l’État ». Le groupe privé Eiffage, en charge de la construction de cet hôpital ambitieux et moderne, avait pour mission de réunir plusieurs établissements en un site unique. Pas moins de 110 000 m2 de surface pour ce nouvel ensemble et plus de 1 000 places disponibles.

Un projet pharaonique, que certains qualifient aujourd’hui de « scandale d’État ». En cause, la non-utilisation de cet hôpital depuis un an. Aux 8 000 erreurs constatées par les huissiers, 130 sont des défauts de construction importants : une biberonnerie oubliée au service de néonatalogie, des installations électriques hors-norme, ou encore des meubles en aggloméré vecteur de microbes.

Résultat, Eiffage réclame 175 millions d’euros à l’État pour les travaux demandés par le Centre hospitalier, qui n’a qu’un souhait depuis juin 2011, sortir du PPP. En attendant l’ouverture du Centre, l’affaire est portée devant les tribunaux.

[2/9]

Le futur zoo de Vincennes

Créé en 1934, puis fermé depuis novembre 2008, le parc zoologique de Vincennes avait débuté sa rénovation en décembre 2011, par la pose symbolique de la première pierre. La transformation du parc se poursuit et d’ici fin 2012, le bâtiment des girafes pourrait être livré. Puis, en novembre et décembre 2013, la volière et la serre tropicale devraient être finalisées.

L’objectif du futur zoo est d’immerger le spectateur dans un voyage à travers la planète, de lui faire découvrir des espèces menacées d’extinction. Les cinq continents seront représentés pour témoigner de la différence des écosystèmes. La biodiversité animale ne sera pas en reste, puisque le projet compte 175 espèces et plus d’un millier d’animaux, de quoi sensibiliser le public à la préservation de la nature et des espèces.

La rénovation représente un coût de 167 millions d’euros, dont 30 millions sont financés par l’État et 10 millions par le Muséum d’Histoire naturelle. Le reste, à savoir 127 millions d’euros, sera financé par Bouygues, le Crédit Foncier et la Caisse des Dépôts.

L’ouverture au public est prévue pour 2014 avec l’espoir d’atteindre une moyenne annuelle d’1,4 millions de visiteurs.

[3/9]

Le nouveau parc des expositions de Toulouse

Situé sur l’île du Ramier à Toulouse, classé « zone inondable », le parc actuel ne peut s’agrandir. Pour répondre aux ambitions de Toulouse, quatrième ville de France, le nouveau parc des expositions doit être implanté à Aussonne, aux côtés du Cancéropôle et de la Fabrique urbaine. Il disposera de 100 000 m2 de surface utile comprenant une grande halle de 15 000 m2, 40 000 m2 de halls ainsi qu’une aire d’exposition extérieure de plus de 15 000 m2 et des espaces complémentaires d’accueil, de restauration et de billetteries. Le parking silo aura une capacité de 4 500 visiteurs. La proximité de l’aéroport est un argument de taille pour l’organisation de manifestations à vocation nationale ou internationale.

C’est l’agence néerlandaise, Office for Metropolitan Architecture, qui a remporté l’appel à projets lancé en 2009 par le Grand Toulouse. La construction débutera fin 2013. Le coût des travaux est estimé à 191 millions d’euros, auquel vient se greffer une enveloppe de 40 millions d’euros afin de couvrir les accès et les dessertes.

[4/9]

Le nouvel Hôtel de Région pour la région Rhône-Alpes

Conçu par l’architecte Christian de Portzamparc, le nouvel Hôtel de Région pour la région Rhône-Alpes a d’ores et déjà été investi en mai 2011 par 1 400 agents et 156 élus. Situé au sein du quartier Confluence de Lyon, l’édifice créé en considérant les principes de développement durable et de qualité architecturale, est ouvert sur toutes ses faces, utilisant le vide entre les espaces.

Sur les 25 000 m2 de bureaux que comprend l’hôtel régional, s’articule une salle de délibérations de 1 570 m2 et des salles de commissions. Le coût de la construction s’est élevé à 147,1 millions d’euros. Néanmoins, la collectivité espère réaliser 79 millions d’euros d’économies de loyer sur 20 ans en mettant un terme à la location de sept sites, laissant 25 à 30 millions d’euros à la charge de la région.

[5/9]

Le nouvel hôtel de ville de Montpellier

Situé dans le quartier de Port Marianne, au sud de Montpellier, le nouvel hôtel de ville regroupe la plupart des services municipaux depuis son ouverture en novembre 2011. Sa construction a nécessité 39 mois de travaux et 130 millions d’euros (116 initialement).

La conception de l’édifice est signée par les architectes Jean Nouvel et François Fontès : une structure moderne en acier et en verre, dont les façades du cube affichent les couleurs gris, noir et bleu. Contemporain et écologique, le bâtiment dispose de 1 300 m2 de panneaux photovoltaïques intégrés sur les toits afin de limiter les dépenses en énergie. L’emplacement n’est pas anodin puisqu’il est tourné vers la mer, « son destin historique » selon François Fontès, symbole de la volonté d’extension de l’agglomération vers le Sud.

Désormais, 960 agents ainsi que 61 élus investissent les 500 bureaux répartis sur les 12 niveaux que comprend la surface de 27 000 m2.

[6/9]

Le futur hôtel de la région Auvergne

À la suite de difficultés financières et d’incertitudes sur l’avenir des collectivités territoriales, les travaux du futur hôtel du Conseil Régional d’Auvergne avaient stoppé. La première pierre a été posée en décembre 2011 et le nouveau siège devrait voir le jour fin 2013.

L’objectif est de regrouper les services pour une meilleure gestion du travail et de l’information et de réduire les coûts de loyer à 2,23 millions d’euros. L’architecte Bruno Mader s’est vu sélectionné pour imaginer le bâtiment qui doit comprendre 10 000 m2 de surface utile, une passerelle d’1,3 hectares et un parking sous-terrain de 7 500 m2 pouvant accueillir 300 véhicules.

Le projet se pose sur la base « haute qualité environnementale » en optant pour une démarche de développement durable. Construit à Montferrand, le long du boulevard Léon Jouhaux, il prévoit l’utilisation importante de bois, l’optimisation des consommations énergétiques ainsi que la pérennité des performances environnementales. Le Conseil Régional d’Auvergne entend ainsi servir d’exemple concernant les exigences liées au développement durable à prendre en compte dans les projets de construction.

[7/9]

Le nouvel hôtel du département de Gironde

Inauguré à Bordeaux, le 15 novembre 2011, le nouvel hôtel du département de Gironde s’élève sur 6 étages, pèse 42 000 tonnes et dispose de 18 368 m2 de surface utile. Les travaux d’extension ont nécessité 600 pieux, soutenus par plus de 100 tonnes de ferraillage afin de rendre le sol stable. Un hall de 1 000 m2 s’ouvre sur la ville par de larges baies vitrées, le bâtiment jouit ainsi de la lumière naturelle pour éclairer les bureaux. Par ailleurs, un espace d’exposition fait la jonction entre le hall et un amphithéâtre de 250 places. Le Conseil Général bénéficiera ainsi d’un meilleur cadre de travail et pourra libérer des surfaces de bureaux, économisant ainsi d’importantes charges locatives. Cela permettrait à l’extension d’être amortie en moins de 25 ans.

La conception du nouvel hôtel aura nécessité 9 ans, afin de respecter les principes de « haute qualité environnementale ». Le choix de la géothermie, qui consiste à utiliser la chaleur du sol en profondeur, illustre bien cet esprit écologique. Fin 2012, 850 des 1 700 agents départementaux quitteront le quartier Mériadeck pour s’installer dans ce nouveau bâtiment.

[8/9]

De nouveaux ensembles culturels à Quimper

Trois ensembles culturels et touristiques complémentaires sont au programme pour la ville de Quimper. Notamment, le projet participatif du Pôle Max Jacob dédié à l’expérimentation, qui accueillera des expositions et des spectacles vivants. Il se veut un espace de vie et de rencontres, tourné vers les arts plastiques, les musiques actuelles et la culture bretonne. Sa construction s’élève à 11,9 millions d’euros.

Par ailleurs, le centre-ville de Quimper devrait voir naître un centre des congrès au sein du « Chapeau Rouge » entre 2012 et 2015. Il a pour but de développer le tourisme d’affaires, en apportant un ensemble cohérent aux événements d’envergure nationale ou internationale. Cela représente un budget de 5 millions d’euros.

Enfin, il y a le projet de réhabilitation de Penvillers. Le projet a pour vocation de transformer le parc des expositions, autrefois vétuste, en un lieu attractif, fonctionnel et convivial. Coût des travaux : 8 millions d’euros.

[9/9]

Par Sébastien Tribot, journaliste

.jpg)

.jpg)

.jpg)