Petite station d’épuration à lit flottant

aAVE présente les produits standards ou sur mesure de sociétés innovantes dans le domaine des systèmes d’aération pour le traitement des effluents, des petites stations d’épuration ainsi que des pompes et aérateurs submersibles. Avec son partenaire Bluevita, aAVE propose le premier système de STEP à lit flottant à être introduit et obtenir l’agrément en France (agrément CSTB en cours).

Le procédé de lit flottant Tornado constitue la dernière génération des techniques de traitement en termes d’assainissement autonome (ou ANC). Il offre les caractéristiques suivantes :

- Des performances de traitement particulièrement élevées, valables sur le long terme ;

- Un volume de boues – élément critique de tout système d’ANC – parmi les plus faibles du marché (50 % de moins qu’un procédé SBR) ;

- Une cuve au procédé unique de PEHD à double paroi avec mousse « en sandwich » ;

- Une grande stabilité ;

- Un système très compact qui permet de traiter jusqu’à 16 EH avec une seule cuve ;

- Une technologie prévue pour une longue durée de vie et une maintenance minimum : 30 ans de garantie d’étanchéité ; pas de renouvellement ni de nettoyage externe nécessaire pour le lit flottant (cf. procédé autonettoyant) ; des équipements électromécaniques de haute qualité (surpresseur à piston au lieu des habituels compresseurs à membrane et pompes) et de durée de vie deux fois supérieure aux équipements habituellement utilisés ;

- Une installation rapide et aisée : système « clé en main », de faible encombrement ;

- Un système économique en termes de coûts totaux (achat + installation + entretien) ;

- Des services et conseils apportés par des professionnels expérimentés du traitement des effluents.

Le savoir-faire et l’expérience de aAVE en matière de conception, de dimensionnement et de réhabilitation de systèmes de traitement des effluents, associés à la gamme des produits de haute technologie et de grande fiabilité Bluevita permettent ainsi une offre à forte valeur technique et compétitive sur le long terme sur un marché en pleine structuration.

En savoir plus

Les data centers représentent 1 % de la consommation électrique mondiale, ce qui est considérable. Spécialiste des instruments et des solutions d’analyse par empreinte chimique, Alpha Mos a mis au point un système permettant de sécuriser le dispositif de climatisation par « free cooling » afin de s’assurer que les polluants potentiellement présents dans l’air extérieur ne pénètrent pas à l’intérieur des locaux techniques accueillant des équipements sensibles.

Appelé RQ Box Energy Saver, ce système assure la mesure continue des odeurs et polluants gazeux. Il comprend des nez électroniques RQ Box, un système de communication sans fil ainsi que le logiciel RQ Net d’acquisition et de visualisation des résultats.

Chaque analyseur, positionné au niveau d’une entrée d’air, pilote un dispositif de refroidissement : lorsque le seuil prédéfini de pollution de l’air extérieur est dépassé, une alarme désactive le « free cooling » et enclenche le système de climatisation « traditionnel ». Le RQ Box Energy Saver autorise ainsi la protection des équipements sensibles et la réduction de l’empreinte carbone. Il utilise la qualité de l’air extérieur comme paramètre de pilotage du dispositif de refroidissement. Il permet une réactivité immédiate grâce aux alertes en temps réel. Et surtout il autorise une réelle amélioration de l’efficacité énergétique du data center : la sécurisation de son fonctionnement favorise l’utilisation du « free cooling » direct qui contribue à atteindre un PUE* cible de 1,5 (PUE d’un data center classique : 2,5) avec contribution directe aux 5 000 tonnes de CO2 non rejetées dans l’atmosphère. La technologie de détection de polluants est adaptée aux besoins de l’hébergeur. Ce couplage RQ Box Energy Saver « Free cooling » offre ainsi efficacité et fiabilité.

* Le PUE (Power Usage Effectiveness) est l’indicateur de mesure de l’efficacité énergétique d’un data center.

En savoir plus

Premier nez électronique dédié aux émissions de gaz humides

La gestion de la problématique des odeurs et COV (composés organiques volatils) est un enjeu majeur pour les industriels oeuvrant dans la valorisation des déchets (centre de stockage, compostage, STEP,…). Les sources d’odeurs sont de plusieurs types (diffus, volumique) mais aussi canalisées (sortie bio-filtre ou laveur acido-basique). Il est important de pouvoir assurer un monitoring des émissions de gaz humides ou concentrés.

Alpha Mos propose la première solution nez électronique pouvant être installée au coeur des sources humides, ce qui permet enfin aux industriels d’assurer un suivi sur tous les types de sources sans exception. Le nouveau système d’échantillonnage « Dry and Dilute System »(DND) assure le séchage et la dilution des gaz avant analyse par le nez électronique RQ Box. Le bilan « odeur » sur site est ainsi complet.

En savoir plus

Service de bio-surveillance de l’environnement par l’abeille

Depuis longtemps, des organismes vivants sont utilisés pour caractériser l’état et le fonctionnement d’un milieu (eau, air, sol) et pour en déceler les éventuelles modifications, qu’elles soient naturelles ou non. Ces organismes « sentinelles » – les bio-indicateurs – peuvent être végétaux (mousses, algues, lichens, écorces, feuilles,…) ou animaux (mollusques, poissons, cloportes, escargots, lombrics,…).

Informant sur les transferts de polluants, la bio-surveillance permet une évaluation toxique globale des écosystèmes, d’où la complémentarité avec la métrologie classique. De nombreuses études scientifiques ont déjà démontré la sensibilité particulière des abeilles aux polluants xénobiotiques (métaux lourds, PCB, dioxines/furannes, HAP, phytosanitaires,…) et à d’autres contaminants comme, notamment, les radionucléides. Lorsqu’elles sont soumises à des concentrations même très faibles et non encore toxiques pour l’homme, les abeilles peuvent présenter des troubles de comportement, un ralentissement de leur activité, voire une certaine mortalité. L’intérêt de les surveiller est donc considérable en termes de gestion des risques sanitaires et pourtant ce n’était pas encore le cas au-delà de simples expérimentations.

Spécialiste de la filière apicole, le bureau d’études Apinov a lancé cette année Apilab, un service de bio-surveillance de l’environnement par l’abeille, qui propose deux prestations :

- Apidiag, une évaluation ponctuelle de l’état sanitaire d’un milieu donné basée sur l’installation d’un rucher bio-indicateur sur un site choisi en fonction de sa représentativité, des prélèvements après renouvellement de la colonie, des analyses par un laboratoire accrédité COFRAC puis une interprétation et des recommandations ;

- Apialerte, un suivi à distance de l’évolution des conditions environnementales de colonies grâce à différents capteurs (balance de suivi de poids de ruche, température interne et compteur d’abeilles, celui-ci étant issu d’un transfert de technologie de l’INRA). Si plusieurs valeurs anormales sont enregistrées, une alerte est transmise et une intervention se fait rapidement.

Rappelons que les abeilles effectuent des milliers de micro-prélèvements par jour et ce, pas seulement dans les fleurs (pollens, nectar,…) : elles prélèvent aussi de l’eau (flaques, fossés) et peuvent capturer (par leur corps velu) des particules en suspension dans l’air ou dans le sol quand elles s’y posent. Elles peuvent donc déceler la présence de particules dans l’eau, l’air et les sols de friches, de sites industriels ou encore de grands espaces publics aux alentours de zones habitées.

La bio-surveillance apicole peut ainsi être utilisée en stratégie d’entreprise (ex. : mesure préventive, communication) ou dans le cadre de la politique d’une collectivité (ex. : révision de schéma d’aménagement, évaluation de la qualité environnementale d’un territoire, etc.). L’abeille peut donc servir d’indicateur de performance dans les actions et politiques de développement durable.

En savoir plus

Broyeur universel et rapide pour déchets verts et bois

Depuis plus de quinze ans, Hantsch est le partenaire en France de Komptech, fabricant autrichien de machines destinées à la préparation de produits dédiés à la biomasse. Parmi les derniers nés de la gamme Komptech, figure l’Axtor 8012, un broyeur universel pour déchets verts et bois qui permet d’obtenir un broyat pour le compostage grâce à un mode broyeur rapide. L’Axtor permet également, en passant en mode déchiquetage avec réduction de vitesse, de produire une plaquette de chauffage de première qualité. Il suffit d’utiliser un outil de broyage ou de déchiquetage en fonction du produit entrant.

Ainsi, le spectre des produits entrants s’étend du déchet vert jusqu’au bois A, en passant par les bois d’élagage, les écorces, les billons, les souches, les rémanents, etc. L’entraînement direct par courroies à nappe vient d’un moteur C18 Caterpillar positionné en partie basse pour faciliter les entretiens sous la trémie d’utilisation. Ce concept permet ainsi un accès libre au groupe moteur. La trémie d’alimentation est ouverte à l’avant et permet un rendement élevé de plus de 100 tonnes par heure en application pour les déchets verts.

Enfin, l’Axtor peut être facilement déplacé grâce à une remorque à 3 essieux centraux, une semi-remorque surbaissée ou encore un train de chenilles.

En savoir plus

Procédé de remise à neuf de batteries industrielles

La gestion de la fin de vie des batteries acide-plomb est une problématique récurrente chez les industriels, à la fois sur le plan environnemental et économique. BSI France (groupe Battery Solutions International) propose un service complet de remise à neuf permettant de donner une seconde vie aux batteries industrielles et par conséquent de réduire les coûts et les déchets. Le procédé développé par BSI comprend trois étapes : mécanique, électrique puis chimique – et va bien au-delà de la régénération.

D’abord, le traitement mécanique couvre le démontage complet des batteries, l’ouverture des éléments, la mise à nu des plaques, le nettoyage et l’inspection de tous les composants internes des éléments et le remontage complet de la batterie. Ensuite, le traitement électrique fait intervenir des cycles de charge et de décharge spécifiques, afin de redonner aux batteries leur capacité (cf. remise à niveau et reconstruction de la capacité des batteries). Enfin, le traitement chimique consiste en l’ajout de l’additif BSI qui renforce les éléments et les protège de manière à pérenniser l’action du traitement.

Cet additif 100 % écologique est réalisé à partir de polymères organiques (dérivés de carbone), il est donc inoffensif et neutre pour l’homme et pour la nature. Formant une membrane microporeuse sur les plaques de plomb, il permet de réduire l’accumulation des cristaux de sulfate de plomb sur ces plaques (une des causes majeures de perte de capacité des batteries). La membrane ainsi formée va également permettre de maintenir l’intégrité de la matière active. Cet additif s’alliera aux grilles des plaques négatives pour offrir une protection contre la corrosion.

Les batteries traitées par le procédé BSI retrouvent des performances pratiquement équivalentes aux batteries neuves (entre 95 % et 100 % de leurs capacités) et sont couvertes par une garantie complète d’au moins 12 mois, voire 24 ou 36 selon les cas. Ce système permet aux entreprises de réduire leurs déchets et l’impact sur l’environnement – eau, sols – imputable au recyclage des batteries au plomb mais aussi de faire des économies substantielles puisque le traitement coûte environ 50 % du prix d’une batterie neuve. À noter : les composants et produits non récupérables (ex. : acide sulfurique) sont envoyés dans les filières de valorisation appropriées.

Première installation de méthanisation 100 % végétaux en France

En 2010, la société GreenWatt a présenté à Pollutec Lyon sa technologie de bio-méthanisation en plusieurs étapes ne nécessitant pas d’effluents d’élevage (lisiers). Equipée du digesteur à haut rendement Hyfad qui optimise l’efficacité de l’action des microorganismes, cette technologie est principalement destinée aux IAA, à la grande distribution et aux chaînes de restauration (cf. épluchures, refus de tri de fruits et légumes, etc.). Depuis, la société belge a conçu et construit à Moissac (82) la première unité de méthanisation de France fonctionnant uniquement à partir de déchets végétaux (fruits et légumes), donc sans lisier.

Son procédé se base sur le couplage de deux étapes séparées : l’acidogénèse (après liquéfaction par hydrolyse, d’où la forte acidité) puis la méthanogénèse sur lit bactérien fixe au sein du réacteur Hyfad, ce qui permet de maîtriser le niveau d’acidité. Un réacteur de post méthanisation est également utilisé. Installée directement sur le site industriel du client, cette unité traite, en fonction de la saison, des déchets de melon, de pommes ou prunes avec des équipements adaptés. Elle produit à la fois de l’énergie utilisable en autoconsommation sur le site et un digestat réutilisable comme amendement organique en agriculture biologique car parfaitement tracé, n’étant issu que de fruits et légumes.

Le procédé de GreenWatt permet ainsi de traiter tout type de déchets agri/agro-alimentaires sans limite et sans avoir à gérer de « recettes » tout en limitant les émissions de CO2 grâce aux économies de transport générées (tout se fait sur site), à la production d’énergie renouvelable (rendement élevé de biogaz) et à la production d’un amendement organique d’origine végétale tracé (valorisation en agriculture bio). Selon les estimations, le potentiel pour l’hexagone s’élèverait à 9 000 installations, soit une puissance installée de 900 MWe. Le procédé pourrait également être utilisé dans le cadre du traitement des algues vertes.

En savoir plus

Véhicule utilitaire 100 % électrique, compact et à rayon de braquage court

Depuis près de dix ans, la société Mega propose des véhicules utilitaires compacts électriques et diesels pour le transport de proximité. Elle complète sa gamme cette année avec un modèle disponible exclusivement en version électrique et au design entièrement nouveau (cf. cabine panoramique, portes entièrement vitrées). En effet, le e-Worker est un modèle électrique à propulsion, doté d’un rayon de braquage très court (3 à 4 mètres selon l’empattement). Ses dimensions extérieures contenues lui permettent de se faufiler partout. Par sa robustesse, ses capacités de charge et de remorquage ainsi que son comportement dynamique, cet utilitaire 100 % électrique se veut polyvalent et répond aux besoins des professionnels exigeants, quelle que soit leur activité.

Sa cabine panoramique et ses portes entièrement vitrées offrent une visibilité optimale pour une sécurité accrue. Son volume intérieur général, son habitabilité – notamment avec le plancher plat et le poste de commande qui tombe parfaitement sous la main – , font de l’e-Worker un utilitaire compact efficace. Comme tous les utilitaires Mega, il se décline en plusieurs versions et possède de nombreux équipements. Il est disponible en deux types d’homologation (VASP et TQM), deux longueurs d’empattement et peut être livré avec un choix de trois packs de batteries (batterie de traction type chariot élévateur), composés de 36 éléments plomb ouvert de 2V en série pour des puissances de 8,6 kWh, 11,5 kWh et 17,3 kWh.

Caractéristiques techniques : 40 km/h pour la version quadricycle ; 25 km/h pour la version chariot porteur – Autonomie : de 40 à 100 km – Charge utile : de 600 à 850 kg – Masse remorquable (freiné) : jusqu’à 1 425 kg – Rampe mini au PTAC : sup. à 15 % – Rayon de braquage entre trottoirs : de 3 à 4 mètres – Dimensions : Longueur hors tout : 3 165 à 3 874 mm – Largeur (sous hauteur 750 mm) : 1200 mm – Largeur hors tout et hors rétroviseurs : 1 272 à 1 326 mm – Hauteur hors tout : 1 895 à 1 922 mm – Dimensions utiles : Longueur env. 2 300 mm x largeur env. 1 300 mm – Volume utile : 3 m3 environ selon version – Seuil de chargement : env. 700 mm. Existe en différentes versions : Fourgon rigide ; Fourgon bâché ; Fourgon isotherme ; Plateau ridelles fixe (équipé de ridelles amovibles et rabattables) ; Plateau basculant (équipé de ridelles amovibles et rabattables) ; Benne à déchets ; Équipement nettoyage / arrosage.

En savoir plus

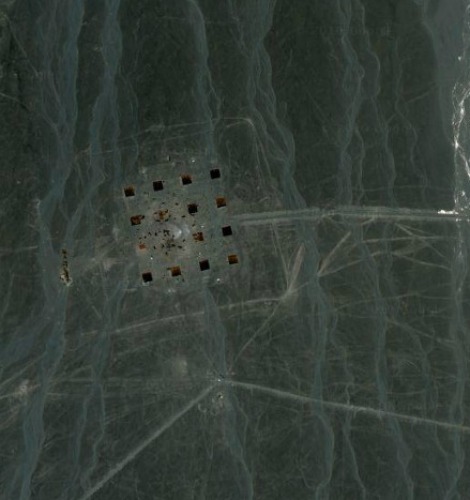

Jusqu’ici, pour redonner sa pleine valeur à un terrain pollué (dépollution totale), seule la désorption thermique dans des usines de retraitement était envisageable pour un prix acceptable. Spécialiste de la remédiation thermique des sols, TPS Tech innove avec le système NSR City qui chauffe le sol au moyen de brûleurs individuels et récupère l’énergie du polluant comme carburant complémentaire.

La dépollution est garantie dans un délai de quatre à six semaines, sans excavation ni transport des terres (d’où une suppression du risque de stabilité et des nuisances pour les riverains) et ce, avec une flexibilité totale permettant d’intervenir dans les sous-sols les plus difficiles d’accès ou sous un immeuble. Après traitement, les tubes de chauffage peuvent servir de base à une installation de géothermie. Les coûts de dépollution sont ainsi rentabilisés sur le long terme. À noter : le système NSR City a reçu le Prix de l’Innovation à « Milieu 2011 », salon de l’environnement aux Pays-Bas.

En savoir plus

Alors qu’ils travaillaient depuis 2009 sur un projet de récupération de l’énergie cinétique générée par les passants et les véhicules sur les voies à forte circulation, les deux porteurs de projet ont reçu en 2010 le Prix Richard Branson de l’Innovation. Ils ont, depuis, créé la société Waydip en vue de commercialiser leur technologie innovante directement applicable sur les sols. Le système qu’ils ont mis au point repose sur une technologie électromagnétique et non plus piézoélectrique comme ceux qui existaient déjà. Ce qui lui autorise un rendement nettement plus élevé (jusqu’à dix fois plus d’électricité générée par m2) et ce, à des coûts nettement moindres (- 50 %) pour la même puissance installée.

Résultat, les lieux à forte affluence peuvent produire eux-mêmes leur électricité. C’est le cas par exemple des entrées d’entreprises ou de mairies, des salons commerciaux, des halls de gares, stations de métro ou autres aéroports, mais aussi des passages pour piétons. Des applications « piétons » (Waynergy People) ont déjà été mises en place dans un salon, dans des aéroports et sur des passages protégés à proximité d’écoles. Et des pilotes du domaine « véhicules » (Waynergy Vehicles) sont en cours de mise en œuvre, principalement avec la société qui détient les routes nationales du Portugal.

À l’heure où chacun se doit de réduire ses consommations d’énergies fossiles et ses émissions de CO2, les systèmes Waynergy de Waydip semblent particulièrement prometteurs. Outre l’autonomie qu’ils apportent, ils permettent de réduire les distances entre production et consommation de l’énergie, ce qui autorise une diminution des pertes d’électricité dans les réseaux. Au final, les factures d’énergie sont considérablement moins élevées.

En savoir plus

(Sources : Pollutec)

Pour aller plus loin :

Découvez les fiches pratiques Techniques de l’Ingénieur :

470.jpg)