Lorsque l’empereur Napoléon III recevait des invités de marque, ils étaient servis dans de la vaisselle en aluminium. Les autres devaient se contenter de vaisselle en or. Cette anecdote illustre le fait qu’au milieu des années 1800, l’aluminium était considéré comme un métal précieux, ce qui est étonnant quand on sait que l’aluminium est l’élément métallique le plus abondant de la croûte terrestre.

Mais il y existe non pas à l’état pur, mais combiné à d’autres éléments, comme l’oxygène dans l’alumine Al2O3.2H2O ou le fluor dans la cryolite (AlF3.3HF). Et l’aluminium est si intimement lié à ces autres éléments qu’il est très difficile de l’isoler, ce qui explique pourquoi l’aluminium est un métal « jeune ». Alors que des métaux comme le cuivre et l’étain sont utilisés depuis des millénaires, l’aluminium, lui, n’est disponible que depuis moins de 200 ans.

Le chimiste danois Hans Christian Œrsted a été le premier, en 1825, à préparer le métal en traitant du chlorure d’aluminium avec un mélange de mercure et de potassium. L’Allemand Friedrich Wöhler, puis le Français Henri Sainte-Claire Deville, améliorèrent le processus au cours des années suivantes. Mais cette démarche fondée sur des réactions chimiques complexes était très coûteuse, d’où la rareté du métal. Tout changea en 1886 quand deux chimistes, l’Américain Charles Martin Hall et le Français Paul Héroult introduisirent presque simultanément un processus faisant appel à l’électrolyse.

Un mélange d’alumine dissoute dans de la cryolite est soumis à un courant électrique, ce qui a pour conséquence la libération du métal à l’état pur. La simplicité de ce processus fit qu’en moins de 50 ans, le cours du métal tomba de plus de 1000 dollars à moins de 50 cents le kg. Aujourd’hui, le processus d’électrolyse « Hall-Héroult » est toujours la seule méthode commerciale utilisée pour la production de l’aluminium. Ironiquement, Charles Martin Hall et Paul Héroult sont liés plus que par le trait d’union qui décrit leur procédé. Ils sont nés la même année (1863) et décédés la même année (1914) aussi. De plus, ils ont tous deux fait leur découverte au même âge, 22 ans.

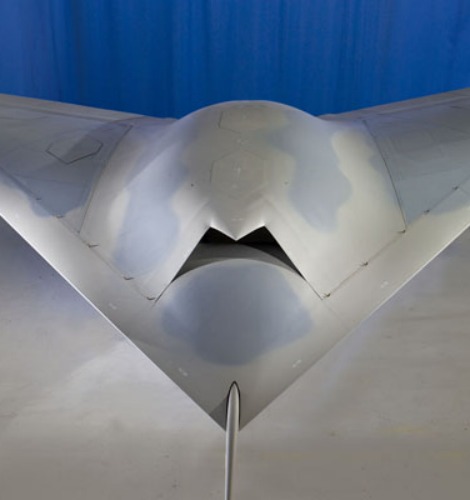

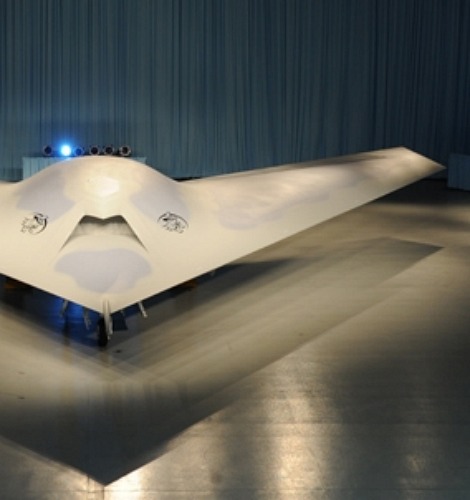

Le processus Hall-Héroult a mis à la portée de tous les multiples qualités du métal, et elles sont nombreuses. Sa densité est environ trois fois plus faible que celle de l’acier, ce qui explique son utilisation dans l’aviation. De plus, quand l’aluminium est exposé à l’air, il forme une mince couche d’oxyde d’aluminium en surface. Cette couche d’oxydation de quelques nanomètres d’épaisseur, contrairement aux autres métaux comme le fer, ne progresse pas et prévient une d’oxydation en profondeur. C’est pourquoi l’on peut dire que l’aluminium ne « rouille » pas.

Une autre qualité de l’aluminium est son excellente conductivité électrique. Bien que la conductivité de l’aluminium n’atteigne que 60 % de celle du cuivre, sa masse spécifique ne représente que le tiers de celle de ce dernier. C’est pourquoi l’aluminium est utilisé dans les lignes électriques à grandes distances où le poids est un facteur. Comme les propriétés thermiques et électriques des métaux sont intimement liées, l’aluminium est aussi un bon conducteur de la chaleur. Ce qui explique son utilisation dans les casseroles pour la cuisson, mais aussi pour la fabrication des cannettes de boissons gazeuses, qu’on veut garder fraîches.

C’est la grande malléabilité de l’aluminium qui permet sa transformation en « papier » d’aluminium. Pour la petite histoire, c’est un Suisse, Robert Victor Necker, qui, en 1910, créa la première usine de fabrication de papier d’aluminium. Il fut utilisé pour la première fois – ce qui n’est guère surprenant étant donné que notre histoire se déroule en Suisse – pour l’emballage… du chocolat ; plus particulièrement, le fameux chocolat triangulaire Toblerone. Aux États-Unis, par contre, le papier d’aluminium a été d’abord utilisé comme bague d’identification des pigeons voyageurs ! Je me suis toujours demandé – j’espère que c’est aussi votre cas – pourquoi un des deux côtés du papier d’aluminium est mat, alors que l’autre est brillant.

En fait, cela provient du système de production des feuilles. Lorsque l’aluminium est laminé successivement en couches de plus en plus fines, les rouleaux en contact des deux côtés avec le métal le polissent pour lui donner un aspect brillant. Mais au dernier passage, les feuilles sont devenues si minces qu’elles se briseraient si elles étaient polies individuellement. Pour prévenir cette éventualité, deux feuilles sont mises l’une contre l’autre avant de passer entre les rouleaux. Quand elles sont ensuite séparées, les faces extérieures qui ont été en contact avec les rouleaux sont brillantes, alors que les faces intérieures sont mates. Néanmoins, pour la cuisson, le côté avec lequel cela vous enveloppez votre nourriture avant de la passer au four n’a aucune importance.

Le papier d’aluminium a une myriade d’utilisations. Il vous permet notamment de nettoyer vos bijoux en argent. Avec le temps, l’argent se ternit lorsqu’il réagit avec l’anhydride sulfureux (H2S) de l’air pour produire une couche sombre de sulfure d’argent (Ag2S). On peut éliminer cette couche en polissant l’objet. Mais, ce faisant, on perd une quantité du métal. La solution consiste à déplacer le soufre pour former à nouveau de l’argent pur. Pour cela, déposez votre bijou dans de l’eau chaude avec un peu de papier d’aluminium et une cuillérée à thé de bicarbonate de soude. Après quelques minutes d’immersion, le ternissement aura disparu. Chimiquement, le soufre du sulfure d’argent s’est déplacé vers l’aluminium pour former avec ce dernier du sulfure d’aluminium. La réaction requiert un milieu basique, d’où l’addition de bicarbonate de soude.

À suivre… Dans une prochaine tribune, on retrouve encore l’aluminium, mais cette fois, nous traiterons des aspects plus controversés de son utilisation.

Par Ariel Fenster, professeur à l’Université McGill (Canada), et membre fondateur de l’Organisation pour la Science et la Société

.jpg)