Toute entreprise responsable se doit de lutter contre le réchauffement climatique. Il y a, bien sûr, plusieurs manières de le faire : encourager le télétravail, réduire les émissions de gaz à effet de serre sur les différents sites de l’entreprise, réduire aussi la consommation d’énergie ou encore acheter de l’électricité « verte » lorsque cela est possible. Agir en faveur d’un changement environnemental implique de collaborer avec de nombreux partenaires, et notamment les pouvoirs publics régionaux ou nationaux.

S’engager en faveur de l’environnement est essentiel pour chaque entreprise. Cependant, pour significatives que soient ces actions, elles ne représentent qu’une toute petite contribution à la lutte contre le réchauffement climatique. Les fabricants de microprocesseurs, eux, ont un pouvoir d’action bien plus étendu : concevoir des produits capables de traiter des données extrêmement volumineuses, de prendre en charge les éléments graphiques sur des ordinateurs et des serveurs de plus en plus puissants et économes en énergie à la fois – et qui soient parfaitement adaptés au Cloud Computing, dont l’importance s’accroît chaque jour.

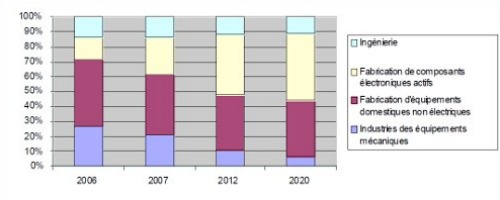

L’expression « Cloud Computing » désigne le stockage, la manipulation et le traitement de données à distance par le biais d’Internet, qui connecte des serveurs situés dans des centres de données à des utilisateurs répartis dans le monde entier. Selon le cabinet IDC, en 2020, une part significative de l’environnement numérique sera hébergé, géré ou stocké de manière centralisée dans des centres publiques ou privés que nous désignons aujourd’hui sous le terme de « services Cloud ». Selon toute vraisemblance, même les données qui ne se trouvent pas en environnement Cloud y transiteront à un moment ou à un autre.

Soulignant la vitesse à laquelle la demande croît, IDC prévoit que les services Cloud publics, c’est-à-dire ceux qui sont vendus aux particuliers et aux entreprises, progresseront de 34 % au niveau mondial en 2010 pour dépasser les 22 milliards de dollars, suivis d’une croissance supplémentaire de 98 % d’ici 2013. Ces chiffres n’intègrent pas les Clouds privés qui sont la propriété des gouvernements et des entreprises. Les microprocesseurs constituent des composantes clés de cette transformation de l’informatique.

En associant sur une seule puce deux capacités distinctes – celles du processeur central (CPU) et celle du processeur graphique (GPU) – la technologie « Accelerated Processing Unit » (APU) représente une modification importante de l’architecture des microprocesseurs. Cela permet de gérer simultanément des tâches graphiques et des tâches de traitement de données intensif pour atteindre des performances énergétiques jamais atteintes jusqu’à présent.

Ce développement prend une signification encore plus importante dans la croissance du Cloud Computing pour les particuliers, les entreprises et les gouvernements. Par exemple, la vidéo représente aujourd’hui près d’un tiers de tout le trafic des particuliers sur Internet. Dès lors, les processeurs capables de traiter de la vidéo et des données de manière plus performante sont une aide précieuse pour les particuliers, comme pour les opérateurs des centres de données qui diffusent ce contenu vidéo sur Internet.

La technologie au service de la lutte contre le réchauffement climatique

Ces découvertes intéressent également les pouvoirs publics. Vivek Kundra, responsable fédéral des systèmes d’information aux États-Unis, a évoqué cette réalité dans un discours prononcé en avril 2010, en soulignant que le Cloud Computing promettait des économies conséquentes. Il a cité l’exemple d’un département dans lequel la migration vers un environnement Cloud de 80 000 comptes de messagerie allait réduire les coûts de 66 %.

« L’Agenda numérique » de la Commission européenne, adopté en mai 2010, indique qu’il est nécessaire de mettre en oeuvre une stratégie pour le Cloud à l’echelle de l’Europe, qui mette l’accent sur les pouvoirs publics et la science : « L’économie du futur sera une économie de la connaissance centrée sur Internet et fondée sur des réseaux. » Cet agenda reconnaît notamment que les technologies de l’information constituent une composante essentielle de la lutte contre le réchauffement climatique.

Il est très vraisemblable que chaque internaute utilise le Cloud Computing plusieurs fois par jour sur Internet, en effectuant une recherche, en envoyant un courrier électronique, en téléchargeant un livre, en lisant le journal, en achetant un produit, en regardant une vidéo ou en vous connectant à réseau social. La croissance du future sera tirée par l’utilisation accrue de serveurs distants permettant d’améliorer la performance énergétique des bâtiments, de faire fonctionner les réseaux de transport et de livraison et de gérer les réseaux et les compteurs électriques.

Une consommation électrique maîtrisée

La croissance des centres de données, nécessaire pour gérer la demande, signifie que de petites améliorations au niveau des processeurs multiplieront les économies : près de la moitié de l’énergie consommée dans un centre de données sert à assurer son refroidissement. Les derniers développements permettent désormais de prévoir la consommation électrique des processeurs, et de gérer la consommation énergétique même pendant les pics d’activité : certains processeurs à coeurs multiples sont programmés pour mettre hors tension les composants non utilisés afin de mieux maîtriser la consommation électrique et le dégagement de chaleur.

Pour permettre d’améliorer les performances énergétiques des processeurs, leurs fabricants doivent rester en permanence à la recherche de nouvelles solutions, inventer de nouveaux outils et faire preuve de créativité. Il s’agit d’une nécessité qui doit être intégrée à leurs stratégies d’entreprise. Ce doit être leur principale contribution à la lutte contre le réchauffement climatique.

Par Jérôme Carpentier, Président Directeur Général d’AMD France