Un séisme de magnitude 9.0 !

Vendredi 11 mars, 14h46 (heure locale), la terre tremble au Japon. La magnitude du séisme, dont l’épicentre se trouve à 130 kilomètres au large de Sendai et à 370 kilomètres de la capitale, est de 9, ce qui en fait un séisme libérant 30 fois plus d’énergie et ayant une amplitude 10 fois supérieure à celle d’un séisme… de magnitude 8. C’est le plus gros séisme jamais enregistré au Japon depuis le début des prises de mesure… Ce tremblement de terre est suivi d’un tsunami dévastateur (une vague allant jusqu’à 10 mètres de haut par endroit), et de son habituelle cohorte de répliques. Des localités entières, pourtant construites aux normes anti-sismiques, sont rayées de la carte, le bilan humain faisant état pour le moment de plus de 5 100 morts, 8 000 disparus et 2 000 blessés, mais il est probable qu’il avoisine ou dépasse les 20 000 victimes… alors même que nous prenons tout juste la mesure d’une « situation » nucléaire préoccupante, en passe de devenir catastrophique. Certains experts évoquant d’ores et déjà les accidents de Tchernobyl et de Three Mile Island à titre de comparaison, alors qu’aucun élément ne permet pour l’instant d’accréditer ces analogies.

Fukushima Daiichi, Fukushima Daini

Les centrales nucléaires de Fukuchima Daiichi et de Fukuchima Daini (distantes l’une de l’autre d’une douzaine de kms) sont deux centrales nucléaires qui se trouvent sur l’île d’Honshu, au bord de l’océan Pacifique. La centrale de Fukushima Daiichi (n°1, en japonais) est constituée de six Réacteurs à Eau Bouillante (REB) construits entre 1970 et 1979, celle de Fukushima Daini (n°2 en japonais) est elle constituée de quatre REBs, vieux d’un peu moins d’une trentaine d’années. Elles sont toutes les deux exploitées par la TEPCO (la Compagnie d’électricité de Tokyo).

Ces deux centrales ont plutôt bien résisté au séisme, et se sont arrêtées automatiquement. Le tsunami qui a suivi, par contre, a gravement endommagé l’alimentation électrique des systèmes de refroidissement ainsi que les systèmes de secours (des générateurs au fuel), censés prendre le relais en cas de panne majeure. Cette impossibilité de refroidir correctement les réacteurs est le point de départ de l’accident nucléaire majeur que nous sommes en train de vivre.

Un réacteur nucléaire à eau bouillante (REB)

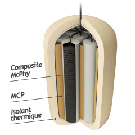

A l’intérieur d’un REB, le combustible est sous forme de « crayons » (des tubes de quatre mètres de long, dont la gaine est faite d’un alliage de zirconium, contenant les pastilles d’uranium ou de plutonium). Ces crayons, au nombre de 40 000, sont immergés dans de l’eau, le tout dans une cuve en acier; la chaleur engendrée par la réaction nucléaire à l’intérieur des crayons transforme l’eau en vapeur, qui alimente la turbine générant de l’électricité. Cette vapeur est refroidie et donc transformée en eau, qui est alors réinjectée dans la cuve pour réalimenter la réaction et se retransformer en vapeur. Cette cuve est placée dans une enceinte de confinement en acier et en béton, d’une épaisseur d’un mètre, censée circonscrire et prévenir tout incident. Enfin, pour sécuriser le confinement, la « piscine de suppression » est indispensable car elle récupère la vapeur libérée par le système de refroidissement. Il est à noter qu’au Japon, l’enceinte de confinement se trouve elle-même dans un bâtiment, dit lui aussi de confinement.

Lors de l’arrêt du réacteur, des crayons de contrôle contenant du bore s’intercalent entre les crayons de combustible, afin de stopper la réaction nucléaire. Bien que les contrôles se mettent en place et que la réaction s’arrête, le combustible délivre toujours une énorme quantité de chaleur, chaleur que l’on surveille et que l’on diminue en laissant les crayons dans de l’eau enrichie avec de l’acide borique (le bore étant utilisé comme ralentisseur ou absorbeur de neutrons lents, neutrons qui provoquent la fission des atomes d’uranium ou de plutonium en dégageant de la chaleur, permettant d‘éviter ou de ralentir l‘emballement du réacteur).

Les premiers incidents

A la centrale de Fukushima Daiichi, les systèmes de refroidissement étant pris en défaut, les techniciens décidèrent de rajouter de l’eau de mer, et essayèrent d’évacuer la vapeur produite pour la remplacer au fur et à mesure de son évaporation. Mais l’eau s’évaporant plus vite qu’ils ne purent la remplacer, les crayons s’échauffèrent, d’autant plus vite qu’ils n’étaient plus du tout immergés, donc exposés à l’air de la cuve. Les gaines de zirconium, soumises à une température bien trop élevée, commencèrent à fuire et à réagir avec le combustible et l‘eau, dégageant des gaz radioactifs et de l’hydrogène, augmentant la pression à l’intérieur de la cuve. Pour abaisser la pression et protéger le cœur du réacteur, les techniciens de la centrale n’eurent guère le choix : ils durent dépressuriser en laissant s’échapper des vapeurs radioactives, chargées de césium 137 et d‘iode 131 ainsi que de l’hydrogène très pur. C’est cet hydrogène (rôle de carburant), en contact avec de l’oxygène ambiant (rôle du comburant) et à haute température (comme dans les moteurs de fusée, car la liaison H-H est très faible, et que la molécule d‘eau formée est très stable), qui est responsable de la première explosion, celle qui souffla le toit du bâtiment de confinement du réacteur n°1, le samedi suivant le séisme, et de celle du toit du réacteur n°3 le lundi d‘après.

La fusion du cœur du réacteur, dans tous les esprits

Si on ne parvient pas à abaisser la température à l’intérieur de la cuve, les crayons de combustible se mettent alors à fondre à l’intérieur du réacteur nucléaire, une fois leur température de fusion atteinte, se mêlant à tous les éléments avec lequel il rentre en contact, notamment ceux composant la gaine, formant un magma dont la température est très élevée. En cas de fusion totale du cœur, ce magma (autour de 3000 degrés), appelé « corium », à la très importante puissance résiduelle due aux désintégrations des produits de fission, deviendrait un élément extrêmement radioactif, chaud et dangereux, pouvant traverser à terme la cuve comme l’enceinte de confinement, et ainsi représenter un immense danger en se répandant. Il devient alors impossible de retirer le corium, l’installation ne pouvant être que condamnée par un sarcophage (comme pour la centrale de Three Miles Island, Pennsylvanie, en 1979).

Certains forment l’hypothèse du « syndrome chinois », lorsque le corium se répand dans l’environnement, nom venant de l’idée saugrenue que cette matière en fusion s’enfonçant dans le sol, puisse traverser la croute terrestre « des Etats-Unis jusqu’en Chine ».

La situation dans les réacteurs

Même s’il est vain d’essayer de décrire des évènements qui évoluent d’heure en heure, nous pouvons faire un rapide point sur les réacteurs japonais concernés (16/03/11) :

Sur les quatre réacteurs de la centrale Fukushima Daini, trois ont présenté des problèmes de refroidissement préoccupants, avec des hausses de température significatives, mais les installations seraient intactes.

Sur les six réacteurs de la centrale de Fukushima Daiichi, trois d’entre eux (numéros 4, 5 et 6) étaient en maintenance au moment du séisme, ce qui ne veut pourtant pas dire qu’ils ne contiennent pas de combustible. Les réacteurs 1, 2 et 3, eux, étaient en fonctionnement :

Le réacteur 1, dont la fusion partielle mais avancée du cœur (70 %) a été confirmée, mais dont l’enceinte de confinement serait intacte, malgré l’explosion ayant endommagé le toit du bâtiment.

Le réacteur 3 serait plus ou moins dans la même situation, bien qu’il soit alimenté en « MOX », un mélange d’oxydes de plutonium et d’uranium appauvri, moins stable qu’un combustible classique. Son enceinte de confinement est peut-être endommagée.

La situation du réacteur 2 est plus grave, car l’enceinte de confinement a été endommagée et a perdu son étanchéité lors de deux explosions survenues mardi 15, entrainant des rejets radioactifs dans l’atmosphère.

Le réacteur 4, à l’arrêt, a connu des problèmes avec sa piscine d’entreposage de combustible usé, qui se trouve à l’extérieur du réacteur et non confinée, une partie de ce combustible n’étant plus immergée, les rejets radioactifs entrainant donc une hausse très significative de la radioactivité.

Les réacteurs 5 et 6, à l’arrêt aussi, connaissent « seulement » de légères hausses de températures.

Les situations de ces réacteurs sont différentes, mais l’enjeu est le même pour tous, refroidir le combustible.

Ces graves incidents ont conduit l’Autorité de Sûreté Nucléaire (ASN) à classer cette catastrophe en niveau 6 sur l’échelle INES, comprenant des paliers allant de 0 (aucune importance) à 7 (accident majeur), censés illustrer l’importance des conséquences à l’intérieur du site nucléaire, la dégradation des lignes de défense en profondeur de l’installation, et les conséquences à l’extérieur du site nucléaire.

Une première conséquence évidente : la hausse de la radioactivité

Les fuites, rejets et autres émissions provenant des réacteurs ou des piscines de stockage ont provoqué depuis samedi une hausse conséquente de la radioactivité autour de la centrale, entre autres due à la présence de césium 137 et d’iode 131 radioactifs.

Le césium 137, qui a une demi-vie de 30 ans, c’est-à-dire qu’il faut 30 ans pour que son activité radioactive diminue de moitié, est très toxique, comme l’iode 131, dont la demi-vie est très courte (environ 8 jours, ce qui fait de lui un élément très radioactif).

Cette radioactivité se déplace, sous forme de « panache » radioactif, au gré des vents et de la météo, vers le Pacifique ou vers les terres (hausse de celle-ci à Tokyo, où elle était dix fois supérieure à la normale). On parle ici de panache plutôt que de nuage, pas uniquement pour jouer sur la sémantique, mais parce que les émissions radioactives sont peu denses et continues, contrairement au « nuage » de Tchernobyl car il s’agissait d’émissions massives et très concentrées ,du fait de l’explosion puis de l’incendie.

Bien qu’il faille lire entre les lignes de la communication gouvernementale japonaise et de TEPCO, la radioactivité a beaucoup augmenté (jusqu’à 1500 milliSievert par heure autour de la centrale), mais apparait comme très changeante, soit à cause de la situation très évolutive et non circonscrite des réacteurs, soit en raison d’incohérences dans la communication officielle, tendant à filtrer ou à minimiser certaines informations.

Incidences sur la santé et l’environnement

Le sievert (Sv) mesure l’impact biologique d’une exposition à des radiations, c’est-à-dire la quantité de radiations absorbées par le corps humain. La radioactivité naturelle nous expose à un peu plus de 2mSv par an, une radiographie de la poitrine à 0,02 mSv. A partir d’une dose de 100mSv, on observe une augmentation significative du nombre de cancers. D’après les études sur les liquidateurs de Tchernobyl, de très nombreux décès sont survenus peu après la catastrophe (dans les 30 jours), ainsi qu’un nombre de pathologies et de cancers très supérieur à la moyenne.

Ici, un niveau de 752 mSv par heure a été enregistré à l’entrée principale de la centrale…

Les éléments radioactifs rejetés rendent donc possible de nombreuses mutations dans les cellules irradiées. Parmi ces éléments, l’iode 131, fixé par la thyroïde, provoque de nombreux et graves cancers. En effet la thyroïde synthétise des hormones nécessaires au bon fonctionnement du corps à l’aide de l’iode, provenant de l’alimentation. Il convient alors de saturer la thyroïde d’iode stable, sous forme de pastilles, idéalement une heure avant la possible contamination, ce qui empêche l’iode 131 de se fixer.

La meilleure des préventions une fois le pire arrivé, outre le souvent dérisoire calfeutrage, reste l’évacuation des zones dites sensibles. Les autorités japonaises ont ici évacué les populations civiles, après de multiples tergiversations, dans un rayon de 20 kilomètres autour des centrales Fukushima Daiichi et Daini, ce qui ne semble pas suffisant pour les instances américaines.

Il ne faut toutefois pas oublier les techniciens restés sur place pour tenter d’endiguer la catastrophe, faisant face à une contamination extrêmement élevée, à priori mortelle.

Les particules radioactives présentes dans l’air peuvent contaminer le sol (notamment le césium 137, qui met du temps avant de disparaitre comme vu précédemment) et peuvent ainsi contaminer des êtres vivants par ingestion ou par simple contact. Elles peuvent contaminer l’eau de mer, de manière directe (celle utilisée pour refroidir les réacteurs) ou indirecte.

Coût économique et énergétique

La reconstruction post-tremblement de terre et tsunami va représenter un cout exorbitant, tant les dégâts paraissent gigantesques. Des villes entières à reconstruire, des pans entiers de l’économie à remettre sur pied.

Les populations des larges environs de la centrale risquent de ne plus vouloir revenir chez eux après ce traumatisme, il faudra donc investir pour leur fournir des solutions de logement.

La bourse tokyoïte dévisse, et la BoJ, la banque nationale japonaise, doit injecter des centaines de milliards d’euros pour alimenter le système bancaire et « rassurer les marchés ».

Le gouvernement japonais va en outre devoir assurer la sécurisation des installations nucléaires sur son territoire, et dans la foulée trouver une alternative énergétique au nucléaire, un scepticisme voire de l’hostilité et un refus catégorique d’utiliser cette technologie risquant de voir le jour au Japon dans les prochaines semaines.

Il ne faut pas oublier que le Japon est au troisième rang mondial des producteurs d’électricité nucléaire, avec ses 55 réacteurs nucléaires répartis sur 17 centrales en activité, qui lui permettent de fournir environ 35 % de ses besoins en électricité, ce qui risque d’être énorme à remplacer, s’il s’avère que cette vision est juste.

La peur ou du moins la suspicion gagne en même temps les capitales étrangères, en résonance avec les dramatiques évènements japonais, ce qui, on peut le gager, va réinviter le débat sur le nucléaire sur la place publique, et au premier plan.

En Allemagne, Angela Merkel a déjà suspendu la prolongation d’activité de leurs centrales, et ce pendant 3 mois (à une semaine des élections…).

En Suisse, les nouvelles centrales initialement prévues pour remplacer celles obsolètes risquent de ne pas naitre.

Aux États-Unis, plusieurs élus du Congrès ont demandé une « pause de réflexion », sur la construction de nouvelles centrales (23 sur les 104 réacteurs américains sont similaires à ceux de Fukushima…).

En France, les écologistes demandent un référendum sur le nucléaire, tandis que Nicolas Sarkozy a assuré que la France devrait prendre toute la mesure de l’ « exemple » japonais… Au-delà de l’évolution dramatique des événements au Japon, c’est donc bien toute une filière qui va, dans les semaines à venir, se remettre en cause.

Par M.R.

Déjà publié :

Centrale nucléaire de Fukushima : Le point

Et aussi dans les

ressources documentaires :

.jpg)