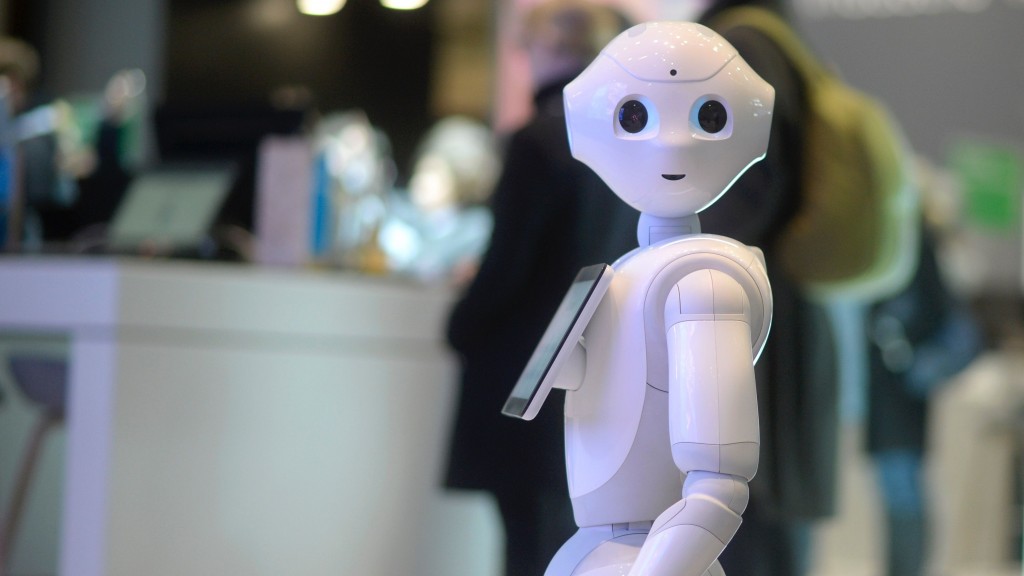

Yvonne est la belle-mère de Franck Cherel, Directeur général de Parade, fabricant français de chaussures de sécurité et de travail depuis 1978. À 79 ans, elle adore voyager à l’étranger. Suite à une chute dans son jardin, Franck a imaginé une chaussure connectée pour les seniors. Parade a réutilisé une technologie développée pour ses chaussures de sécurité afin de détecter les chutes. Le nom était tout trouvé : place à E.vone pour les femmes et à E.van pour les hommes.

Plus d’inquiétude à avoir, le dispositif électronique envoie automatiquement un message d’alerte aux proches et aux services d’urgence en cas de chute. Les chaussures E.vone et e-Van sont fabriquées dans une usine de Jarzé (49), dans le Maine et Loire. Pour laisser libre cours à l’imagination des seniors, les stylistes ont imaginé 26 modèles et déclinaisons.

Une chaussure connectée pour rassurer

La semelle d’E.vone et d’E.van renferme un petit dispositif électronique. Il contient une batterie, une carte SIM et un GSM pour pouvoir lancer l’alerte dans plus de 120 pays. S’y ajoutent un GPS pour fournir la géolocalisation et plusieurs capteurs (gyroscope, accéléromètre, capteur de pression) pour suivre les mouvements. Enfin, le dispositif renferme un vibreur pour informer et rassurer le porteur en cas de besoin.

Lorsqu’un mouvement jugé anormal est détecté, le vibreur s’actionne. Le porteur a quelques secondes pour se relever ou taper trois fois du pied sur le sol. Sans réponse, le dispositif appelle les numéros préprogrammés. Un appel pour appeler au secours, avec une géolocalisation précise. Lorsque l’alarme est bien prise en compte à l’autre bout de la chaîne, la chaussure vibre à nouveau pour notifier au porteur que des secours sont en route.

E.Vone primée et en route pour Las Vegas

Dévoilée en février 2017, E.vone a reçu le Trophée SilverEco de l’innovation en mars 2017. « Désormais, nous cherchons à présenter notre invention au CES de Las Vegas 2018 », prévient Anne Bluteau, directrice marketing de Parade. Sa commercialisation débutera d’ailleurs à cette occasion, en janvier 2018.

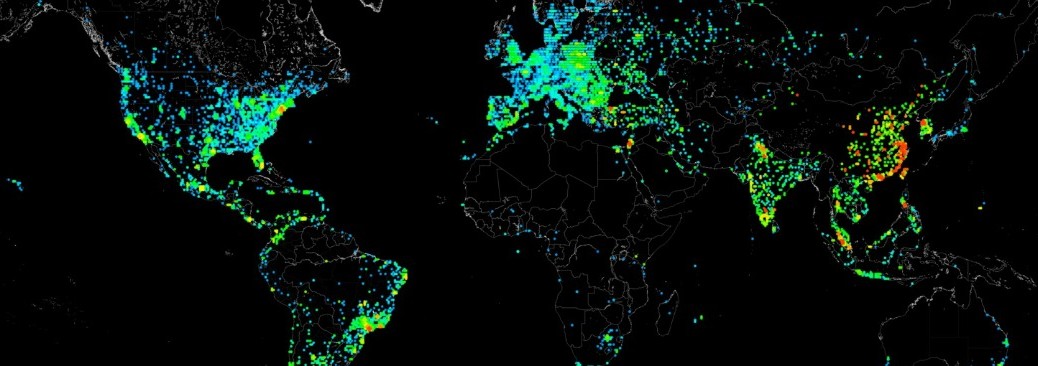

Pour le moment, l’autonomie de la batterie s’élève entre 15 jours et 1 mois. Il faut donc la recharger sur un port USB. « Pour la version 2, notre objectif est d’atteindre une autonomie d’au moins un an en passant sur les nouveaux réseaux moins énergivores, détaille Julien Fortumeau, responsable Marketing digital de Parade. Au lieu de s’accrocher au réseau 2G/GSM nous allons travailler sur les réseaux LORA ou SigFox développés spécifiquement pour les objets connectés ». Grâce à une communication à bas débit et sans passer par un téléphone mobile, l’utilisation de ces réseaux demande beaucoup moins d’énergie. L’autonomie des périphériques qui y sont connectés est ainsi largement augmentée.

Pour acheter une telle paire de chaussure, il faudra débourser entre 110 et 150 euros. Un prix auquel il faudra ajouter un abonnement mensuel, compris entre 40 et 60 euros.

Par Matthieu Combe, journaliste scientifique