Un dispositif développé en Espagne élimine les émissions de CO2 industrielles

Une collaboration entre le Centre des Lasers Pulsés (CLPU), le Service Général de Spectrométrie de Masse de la plate-forme d’appui à la recherche (NUCLEUS) de l’université de Salamanque, et l’entreprise espagnole Iberdrola Ingénierie a permis le développement d’un dispositif qui pourrait éliminer presque 100% des émissions de gaz à effet de serre émises par les industries dans l’atmosphère, principalement des émissions de CO2. Les chercheurs ont déjà présenté un brevet national pour le premier prototype du système, qui est le résultat du projet de R&D SIGMA débuté il y a deux ans. Le système utilise la radiation laser pour ioniser les gaz et les extraire au travers de champs électriques et magnétiques.

Un dispositif peut-être révolutionnaire, puisqu’il permettrait d’affronter, sous un nouvel angle, les problèmes environnementaux et climatiques causés par les émissions de CO2. Eviter que ce gaz résultant des différentes activités humaines ne s’accumule dans l’atmosphère représente un immense défi à la fois scientifique et technologique, auquel existent trois pistes de réponse : capturer le CO2 émis avant son entrée dans l’atmosphère, miser sur les énergies non carbonées, et augmenter l’efficience énergétique de nos industries.

Le prototype breveté par le CLPU s’inscrit dans la première option, et présente l’avantage d’être beaucoup moins coûteux que les autres voies qui ont été explorées jusqu’à présent dans ce domaine.

La première partie du processus mis en place consiste en une « photo-ionisation » des molécules de la phase gazeuse, c’est à dire d’une ionisation de ces molécules grâce à l’action d’un laser. Après cette opération, une spectrométrie de masse permet de séparer les différents composants de la phase gazeuse. C’est en fait cette phase du processus qui représentait le plus grand défi scientifique et technologique pour les chercheurs, car jusqu’à maintenant la spectroscopie de masse avait surtout été utilisée pour travailler avec de très petites quantités de gaz (analyse de composés chimiques par spectroscopie de masse à partir de petites quantités d’échantillon). Dans le cas présent, l’objectif du projet est au contraire de réussir à appliquer ce processus à de grandes quantités de gaz, ce qui n’avait encore jamais pu être obtenu auparavant.

Un des principaux obstacles à franchir était le cout énergétique de la spectroscopie de masse appliquée à des quantités importantes de gaz, qui aurait pu annuler les bienfaits du procédé en termes de bilan carbone. Cette difficulté a pu être surmontée grâce à l’utilisation d’un laser, qui permet dans le prototype de séparer électrostatiquement les molécules ionisées, sans qu’elles se heurtent à d’autres particules. Obtenir que les molécules circulent dans la bonne direction à pression atmosphérique et en temps voulu pour réaliser le processus est une opération extrêmement complexe que les scientifiques du projet travaillent encore à optimiser.

La séparation par spectrométrie de masse génère de nouvelles molécules, comme par exemple de l’oxyde de soufre ou de l’oxyde d’azote, qui peuvent être employés dans l’industrie chimique ou comme fertilisants. De cette manière, le prototype présenté pourrait permettre à la fois de résoudre le problème environnemental de l’émission industrielle de gaz à effet de serre, et aussi de générer des produits dérivés de haute valeur commerciale.

L’avenir dira si ce système peut s’avérer rentable pour les entreprises, mais ses inventeurs sont convaincus qu’il pourra permettre de grandes économies de coûts, tout spécialement pour les grandes entreprises, qui doivent payer des redevances liées aux émissions de polluants. L’objectif de ses promoteurs est de pouvoir lancer d’ici 4 ans sa commercialisation auprès des petites industries.

Source : bulletins électroniques

Gestion des risques liés aux nanotechnologies. Une coopération Europe-Etats-Unis

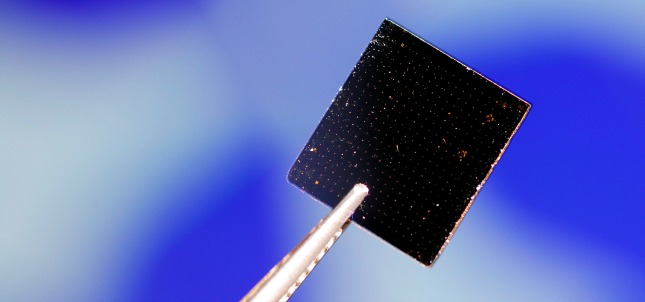

Sans que l’on s’en aperçoive vraiment, les nanotechnologies et les nanomatériaux envahissent de plus en plus notre quotidien. On les retrouve un peu partout, par exemple dans les appareillages électroniques modernes, certains médicaments, produits cosmétiques et pommades, textiles, cellules solaires ou encore additifs alimentaires. Cette situation n’est pas sans poser de problèmes environnementaux, de santé et de sécurité. Ainsi, au sein de l’Europe et aux Etats-Unis, on a vu se développer des législations éparses et parfois incohérentes entre elles. Récemment, la nécessité d’une harmonisation entre les réglementations Européennes et Américaines est devenue une évidence.

Ainsi, depuis presque 3 ans, des scientifiques et des médecins des Etats-Unis et d’Europe, travaillant dans le secteur de l’environnement, de la sécurité et de la santé, cherchent à unir leurs efforts pour répondre aux préoccupations de gestion et de contrôle des risques liés aux nanotechnologies. Ainsi en 2011 se tenait le premier séminaire européen-américain « Bridging nanoEHS Research Efforts », à Washington, DC. Un an plus tard, trois communautés de recherche (« CoR ») se sont constituées autour des thématiques, « Modélisation et prédictions en santé humaine », « Tests d’écotoxicité et modèles de prédiction », et « Exposition durant un cycle de vie » lors d’une rencontre à San Francisco. Ces trois CoR sont soutenues administrativement par le bureau américain national de la coordination des nanotechnologies. Puis 3 autres CoR se sont formées lors d’une conférence à Grenoble : « Bases de données et Ontologie », « Evaluation des risques », et « Contrôle et gestion des risques », ces dernières étant soutenues administrativement par l’Union Européenne.

Les six communautés collaborent au travers de conférences annuelles et de téléconférences. La dernière téléconférence, le 7 novembre dernier, était initiée par la 6e CoR (« Contrôle et gestion des risques ») et abordait la question urgente de trouver un terrain d’entente pour l’ensemble des secteurs du commerce, des matériaux et des sciences naturelles pour l’élaboration de lois nano harmonisées à l’échelle internationale. En effet, si aucune mesure n’est prise en compte pour coordonner les politiques des différents acteurs du secteur rapidement, la poursuite des investissements et le développement de l’ingénierie de pointe dans le domaine des nanotechnologies subiront un ralentissement inévitable.

Une trentaine de participants ont assisté à cette conférence. L’importance de la mobilisation des scientifiques et professionnels de la santé a été mise en avant, afin d’identifier et de partager des méthodologies, des stratégies de contrôle et de démontrer des solutions efficaces. Le but commun de ces lois étant de réduire et prévenir les effets néfastes de l’exposition aux nanomatériaux pour la santé, la sécurité et l’environnement.

Un problème initial de définition : vision européenne

Ilise L. Feitshans, avocate Suisse spécialiste des questions liées aux nanotechnologies, a montré à quel point les lois concernant les nanotechnologies étaient en compétition les unes avec les autres, avec notamment des définitions différentes de l’appellation « nano », ne permettant pas d’établir une harmonisation internationale de ces lois.

Elle est l’auteur d’un article, « Forecasting Nano Law : Defining Nano » qui se concentre sur ce problème fondamental de définition. Elle y explique par ailleurs que les définitions admises par les différents acteurs du domaine des nano, sont en général très simples mais du coup beaucoup trop larges, si bien que par exemple des molécules biologiques naturelles (e.g. les cellules sanguines) se retrouveraient classées parmi les nanomatériaux et donc soumis à la réglementation.

Durant la conférence, le Dr. Feitshans a pointé les deux principales faiblesses concernant les lois actuelles sur les nanomatériaux : d’une part l’absence d’harmonisation et d’autre part le manque d’éducation des consommateurs. Afin de remédier à la situation, elle a suggéré une implication éventuelle du Conseil de l’Europe dans la définition et la réglementation des nanotechnologies au sein de ses 47 pays membres. De plus, elle a proposé une implication du Comité des Ministres, lesquels pourraient évaluer les aspects économiques, scientifiques, politiques et légaux pour déterminer s’il est nécessaire de créer une Convention sur « les nanotechnologies et les droits de l’homme / les nanotechnologies et la santé » ou plutôt ajouter un protocole spécifique à un Conseil déjà existant tel que la Convention Oviedo sur la biomédecine et les droits de l’homme.

Enfin, elle a proposé la rédaction d’un rapport pour guider la mise en place de cette éventuelle commission. Ce rapport aborderait ainsi la question du critère le plus pertinent à adopter pour donner une définition claire de ce que l’on veut appeler « nano », comment faire respecter les lois nano qui seront établies et comment les contrôler, définir le rôle éventuel de l’Assemblée Parlementaire du Conseil de l’Europe, comment communiquer à l’échelle mondiale et harmoniser les lois à l’échelle nationale tout en impliquant le Conseil de l’Europe et autres institutions.

Des accréditations professionnelles pour la gestion des risques liés aux nanotechnologies : l’initiative américaine

Donald Ewert, vice-président de la compagnie NanoTox Inc., compagnie spécialisée dans la gestion et l’évaluation des risques liés à l’utilisation des nanomatériaux- a présenté le principe des programmes d’accréditation qu’ils veulent instaurer à l’échelle internationale. Ces programmes se basent sur une harmonisation internationale des lois concernant les nanomatériaux, grâce à la définition au préalable d’une base de standards des nano vis-à-vis des risques environnementaux, de sécurité et de santé. L’ensemble du programme d’accréditation devrait être établi dans les 6 prochains mois.

Dans un premier temps, un Comité Consultatif sera formé, lequel inclura des organisations non gouvernementales, des industries, des universités et une variété de parties prenantes et entités gouvernementales d’Amérique du Nord et d’Europe. Le rôle du comité sera d’établir un modèle, inspiré d’un modèle commercial déjà existant, pour créer ladite base de standards.

Ce modèle fera alors l’objet de cours de formation académique. A l’issu de ces cours, les auditeurs seront capables de comprendre l’étendue des risques potentiels liés aux nanomatériaux et nanotechnologies et d’en assurer un bon control. Ils pourront alors délivrer des accréditations aux différentes structures privées comme publiques travaillant dans le domaine. Ces établissements accrédités garantiront ainsi une approche cohérente de la réglementation des nanomatériaux à l’international et une vérification rapide et efficace des risques impliqués.

Une fois cette démarche lancée, d’autres organismes de réglementation pourraient s’y joindre, de la même façon que ce qui se passe actuellement avec l’harmonisation mondiale de la sécurité en chimie (« Global Harmonization of Chemical Safety » GHS).

Par ailleurs, un groupe de professionnels hautement respectés et faisant autorité devra se charger de superviser l’amélioration du modèle d’accréditation tous les deux ans, en parallèle de leurs activités et engagements professionnels. Ainsi, l’initiative de ces programmes d’accréditation permettra le développement d’une politique internationale et cohérente pour les nanotechnologies.

Source : bulletins électroniques

Les macro-algues de la côte portugaise : source d’alimentation ou source d’ennui ?

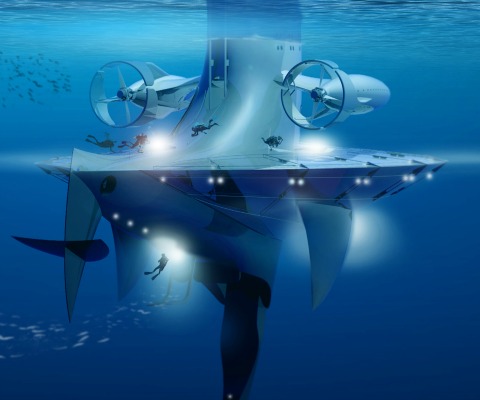

Les macro-algues sont en train de modifier l’écosystème marin portugais. Fernando Correia et Leonel Pereira, chercheurs aux Universités d’Aveiro et de Coimbra respectivement, ont attiré l’attention de la communauté scientifique sur ce phénomène grâce à leurs travaux récompensés par la mairie de Cascais. Les côtes portugaises sont envahies par des macro-algues du Sud Est de l’Asie, d’Australie, d’Afrique du Sud et d’Amérique du Nord. Certaines de ces algues peuvent atteindre jusqu’à 12 mètres de long, monopolisant l’accès à la lumière ou aux nutriments et empêchant le développement des algues locales, plus petites. Les conséquences sur l’écosystème sont importantes, car ces macro-algues ont des capacités de reproduction et de fixation supérieures aux algues typiques de la côte portugaise. Leur développement empêche la croissance des algues plus petites, ayant également un impact sur l’alimentation des poissons et autres invertébrés des côtes portugaises.

Certaines de ces algues ont été introduites par la main de l’homme, dans le cadre de la culture des algues, mais la plupart ont été amenées par des navires des grandes lignes commerciales qui parcourent le monde entier. Les études ont montré que ce sont des particules qui se fixent sur la coque des navires et qui sont transportées sur des milliers de kilomètres, dans l’attente de trouver un milieu favorable à leur reproduction et à leur expansion. « Lorsque un navire fait escale dans un port qui a un environnement propice pour la reproduction de ces algues, ces dernières libèrent des spores qui se propagent… », a expliqué Fernando Correia. Il a ajouté que la lutte contre ce type d’algues sera difficile. En effet, qui nettoierait la coque d’un porte-conteneur qui entre dans les eaux portugaises ? De plus, un autre facteur important de contamination sont les installations sanitaires de ces navires.

Lorsque l’eau aspirée par ces embarcations n’est pas correctement filtrée, elle peut contenir des spores de ces différentes espèces qui seront par la suite libérées dans les ports d’escale. Ce vecteur de contamination a introduit sur les côtes européennes le goémon japonais. On estime que les grands navires transatlantiques de ce type, transportent par jour près de 700 espèces à travers les océans, dont une petite partie se stabilisera. Ce phénomène aurait également un impact sur l’alimentation humaine. En effet, Leonel Perreira travaille également sur la valorisation des algues dans l’alimentation humaine et est un des protagonistes portugais des workshops sur la récolte, la confection et la dégustation des légumes de la mer typique des côtes portugaises. Il a mis au point le menu suivant : des algues farcies aux moules avec un bouillon de crevettes aux algues, en entrée, un riz de spaghettis de mer avec des pignons et des raisins secs en plat principal et une mousse d’agar-agar aux deux citrons pour le dessert. Pour de nombreuses personnes, l’utilisation d’algues dans l’alimentation peut paraître étrange et est synonyme d’une cuisine exotique, mais les algues sont de plus en plus utilisées par de grands chefs européens qui cherchent une cuisine alternative à haute valeur nutritive.

Les macro-algues sont riches en protéines, en fibres, en lipides, en vitamines, en fer, en iode, en antioxydants et sont de digestion facile. Sur le vieux continent, certaines pâtisseries et boulangeries les utilisent dans leurs pains et leurs pâtes. Certains fabricants de conserves les utilisent car elles apportent une saveur iodée. Elles sont également utilisées sous forme de poudre pour texturer des gélatines et des sauces en industrie alimentaire. Au Portugal, il existe une seule entreprise qui produit ses propres algues en aquaculture, Algaplus à Ria de Aveiro. Les produits sont commercialisés sous la marque « Tok de Mar » directement au consommateur. Helena Abreu, biologiste et fondatrice de l’entreprise a expliqué qu’ils utilisaient un système alternatif d’aquaculture, intégrant des daurades et des bars. Cette méthode permet un meilleur contrôle de qualité de l’eau et des nutriments et une meilleure stabilité durant toute l’année. Pour le moment, la production est faible, quelques centaines de kilogrammes par an, mais l’objectif est de produire 50 tonnes d’algues d’ici 2015, qui seront par la suite séchées. Algaplus aimerait également développer un marché pour fournir des matières premières pour les cosmétiques et la production de bioplastique

Source : bulletins électroniques

.jpg)