Laurence Riblet, experte-conseil en risque chimique, nous présente la formation Evaluer et prévenir le risque chimique, qu’elle anime chez Techniques de l’Ingénieur.

Laurence Riblet, experte-conseil en risque chimique, nous présente la formation Evaluer et prévenir le risque chimique, qu’elle anime chez Techniques de l’Ingénieur.

Si les calculs de ces chercheurs sont exacts, cette étoile s’est formée quelque 200 millions d’années seulement après le Big Bang.

Jusqu’alors, les plus anciens astres identifiés – décrits respectivement en 2007 et 2013 par des équipes européennes et américaines – affichaient 13,2 milliards d’années au compteur.

A l’échelle astronomique, cette étoile antique est en outre relativement proche de nous, souligne Stefan Keller, de l’observatoire du Mont Stromlo, dans la capitale australienne Canberra.

Elle est située dans la Voie Lactée, notre galaxie, à environ 6.000 années-lumière de la Terre, et son matricule dans le catalogue de l’Univers est SMSS J0313000.36-670839.3.

« Le révélateur de l’âge canonique de cette étoile, c’est l’absence de tout niveau détectable de fer dans le spectre lumineux qui en émerge », explique M. Keller dans un échange de mails avec l’AFP.

Initialement, le Big Bang a créé un Univers rempli d’hydrogène, d’hélium et d’un soupçon de lithium. Tous les autres éléments qui existent aujourd’hui ont été forgés dans les étoiles, nés des nuages de gaz et de poussières laissés derrière elles par des supernovas, l’explosion d’étoiles géantes en fin de vie.

Le recyclage incessant de ces éléments peut servir aux astrophysiciens pour évaluer l’âge d’une étoile car la concentration en fer ne fait que croître au fur et à mesure de ses réincarnations successives. Autrement dit, moins il y a de fer dans une étoile plus elle est vieille.

« Le taux de fer dans l’Univers augmente au fil du temps, au fur et à mesure que les générations d’étoiles se forment et meurent », résume M. Keller.

« Nous pouvons utiliser la quantité de fer contenue dans une étoile comme une +horloge+ qui nous dit quand elle s’est formée. »

« Dans le cas de notre étoile, la quantité de fer est moins d’un millionième de celle de notre Soleil, et au moins soixante fois moins que dans n’importe quelle autre étoile. Cela signifie que notre étoile est la plus ancienne jamais découverte à ce jour », affirme le chercheur.

L’étoile en question a été découverte à l’aide du télescope SkyMapper de l’Université nationale australienne, qui mène actuellement une étude du ciel austral d’une durée de cinq ans.

D’après l’étude, publiée dimanche dans la revue Nature, cette étoile serait issue d’une supernova de faible énergie, dont la masse était environ 60 fois celle du Soleil.

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

Des chercheurs ont analysé le sang de 86 personnes malades et celui de 79 autres non malades. Leurs mesures révèlent un taux de DDT quatre fois supérieur dans les échantillons des personnes atteintes d’Alzheimer ! Ces mesures ont été complétées par des analyses du cerveau de malades post-mortem. La présence de DDT a là encore été retrouvée en grande quantité. Publiés dans la revue Journal of the American Medical Association Neurology, ces résultats soulignent l’impact à long terme de cet insecticide et son implication dans la survenue d’une maladie neurodégénérative.

Le DDT a été interdit aux Etats-Unis dès 1972, mais a été très utilisé pour lutter contre le paludisme. Dans ces parties du monde, il reste un outil majeur pour éradiquer ce mal. Bien que désormais limité à une utilisation dans des bâtiments, à des doses très contrôlées, les sols et les cultures restent contaminés. Le DDT présente en effet l’inconvénient de persister plusieurs années dans son environnement, avec une demi-vie allant de 2 à 15 ans. Les Américains consommant des produits cultivés dans des régions touchées par le paludisme s’exposent donc au DDT.

Le DDT possède un composant actif, le dichlorodiphényldichloroéthylène (DDE). Ce dernier serait à l’origine de l’accroissement d’une substance participant à la formation de protéines bêta-amyloïdes, les plaques qui se forment dans le cerveau des malades d’Alzheimer. Les scientifiques qui ont mené les analyses ont aussi constaté que les malades présentant le plus fort taux de DDE dans le sang étaient aussi ceux avec les symptômes les plus sévères. Enfin, l’impact du DDT est majoré par la vieillesse puisqu’il s’accumule dans le corps.

Dr Allan Levey, directeur du Centre de recherche sur la maladie d’Alzheimer et co-auteur de l’étude n’hésite pas à comparer « l’effet du DDT […] au facteur génétique le plus courant prédisposant à la maladie d’Alzheimer ».

Cette étude est la première à mettre en évidence aussi clairement un effet du DDT sur la santé humaine.

Par Audrey Loubens, journaliste scientifique

Et aussi dans les

ressources documentaires :

Et aussi en

formation :

Vous aussi vous rechargez votre portable tous les jours ? Et encore, quand vous ne faites que téléphoner quelques minutes. Si vous avez le malheur de regarder une vidéo, d’écouter un peu de musique ou de trainer sur la toile, la batterie ne tient même pas la journée de travail. Pour pallier ce désagrément, les scientifiques planchent sur plusieurs solutions. Parmi elles, les chercheurs de l’université d’Arlington ont choisi l’option énergie renouvelable, plus précisément les éoliennes. Evidemment, il ne s’agit pas d’édifices de 20 mètres de haut mais d’éoliennes miniatures. Leur dispositif mesure 1,8mm de large, des dimensions qui permettent d’envisager de l’intégrer dans un téléphone. Et pas qu’une, mais bel et bien des dizaines. Constituées d’un alliage de nickel, ces éoliennes possèdent une flexibilité et une résistance suffisantes pour résister aux sollicitations subies lors des manipulations d’un téléphone. L’activation des micro-pales pourrait se faire en plaçant son téléphone dans un courant d’air ou simplement en faisant du vent avec nos mains.

Pour J.C Chiao et Smitha Rao, auteurs des travaux, quelques rangées de ces éoliennes miniatures suffiraient à assurer le chargement de la batterie en à peine quelques minutes. Une estimation qui peut sembler optimiste au vu des temps de chargement actuellement supérieures à l’heure. Enfin, ce dispositif pourrait servir à autre chose que nos batteries de téléphones et servir des causes plus nobles comme l’alimentation de micro-robots servant d’outils chirurgicaux ou encore de machines de recherche et d’assistance aux victimes.

La société taïwanaise WinMEMS Technologie s’est montrée intéressée avec une offre d’achat des droits exclusifs de commercialisation des mini-éoliennes. Disposant d’un procédé associant lithographie aux rayons X et électrodéposition, WinMEMS espère produire à grande échelle et ainsi abaisser les coûts.

Et aussi dans les

ressources documentaires :

Et aussi en

formation :

Depuis les années 1970, experts, chercheurs et amateurs, jusqu’au grand spécialiste de Léger, Douglas Cooper, cherchaient à savoir si cette toile faisait bien partie d’une série intitulée « Contrastes de Formes », peinte de la main du peintre cubiste (1881-1955) entre 1913 et 1914.

Aujourd’hui, se félicite l’Institut italien dans un communiqué, « il est désormais certain » que ce tableau, propriété de la collection Peggy Guggenheim de Venise, mais jamais exposé en raison des doutes sur son authenticité, « est un faux ».

Pour ce faire, les chercheurs du Laboratoire pour l’environnement et l’héritage culturel (LABEC) de Florence, en partenariat avec l’INFN de Ferrare et le musée vénitien, utilisant un accélérateur de particules, ont mesuré le carbone 14 contenu dans un fragment de la toile non peinte du tableau.

Ils ont ensuite comparé ces résultats avec ceux de la courbe dite « du pic de la bombe », et c’est cette méthode, utilisée pour la première fois pour authentifier un tableau, qui a permis de certifier que l’oeuvre avait été peinte après 1959, soit au moins quatre ans après la mort de Léger.

Pendant la guerre froide, le nombre d’essais nucléaires augmentant dans le monde, le niveau de carbone 14 dans l’atmosphère a également augmenté, jusqu’à atteindre un pic dans les années 1963-1965, avant de baisser grâce à la signature de traités internationaux.

Pendant ce « pic de la bombe », le niveau de carbone 14 a augmenté dans tous les organismes vivants, dont le coton et le lin, utilisés notamment pour produire des toiles.

L’étude a été publiée le 21 janvier dans The European Physical Journal Plus.

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

Et aussi dans les

ressources documentaires :

Découvrez également les formations Techniques de l’Ingénieur :

Le Volocopter est une invention de la start-up allemande e-volo. Grâce à cet essai, avec de multiples vols de plusieurs minutes, jusqu’à 22 mètres de hauteur, le concept Volocopter est validé. Pour les essais en extérieur avec pilotes, les créateurs devront obtenir une licence de vol provisoire. Les premiers résultats étant concluants, celle-ci devrait arriver au printemps.

Dès lors, un programme d’essais en vol sera mis en place pour obtenir une classification aéronef « Volocopter » courant 2015. Au programme : plusieurs jours de vols autonomes sur des zones inhabitées pour tester et démontrer la fiabilité du pilotage électronique et les différents systèmes de sécurité. L’équipe d’e-volo espère conclure ces tests rapidement et lancer la production en série dès 2016, car « il existe déjà de nombreuses demandes de Volocopter dans le monde entier », prévient Alexander Zosel, directeur général d’e-volo.

L’appareil décolle et atterrit verticalement, mais contrairement aux hélicoptères traditionnels, le pilotage est un jeu d’enfant. Le pilote ne contrôle que la direction de l’appareil à l’aide d’un simple joystick qu’il oriente dans la direction souhaitée. Ce sont ensuite 20 ordinateurs, en dialogue avec des capteurs, qui prennent le relais pour adapter la vitesse de vol ou le faire tourner.

18 hélices permettent au Volocopter de s’élever dans le ciel, puis de voler. Leur pas est fixe et l’appareil reste donc toujours à l’horizontal, sans se pencher. Le changement de direction se fait en modifiant automatiquement la vitesse des hélices.

Le Volocopter pourrait voler jusqu’à 100 km/h, à une altitude de 2000 mètres. Les batteries ne permettent pour le moment que 20 minutes de vol, mais les développeurs espèrent atteindre une autonomie d’au moins une heure. Pour permettre des vols de plusieurs heures en une seule fois, une version hybride électrique et thermique, avec prolongateur d’autonomie, est également à l’étude.

Les créateurs espèrent en faire l’appareil volant le plus sécurisé au monde. Ainsi, pour assurer la sécurité pendant le vol, toutes les pièces capitales sont présentes en plusieurs exemplaires. En cas de pannes multiples, des pièces de secours prendraient alors le relais. Et en cas de panne du prolongateur d’autonomie, des batteries supplémentaires se mettent en marche pour assurer un atterrissage en toute sécurité. Enfin, en dernier recours, un parachute s’ouvre pour faire atterrir le Volocopter au sol !

Le projet a déjà bénéficié de 2 millions d’euros de subventions du ministère de l’industrie allemand. Pour ses futurs développements, 1,2 million d’euros ont été récoltés en décembre sur Seedmatch, un site de financement participatif allemand.

Les 500 000 premiers euros ont été récoltés en seulement 2 heures et 35 minutes. C’est le record européen en la matière. Au final il n’aura fallu que 3 jours, 9 heures, 52 minutes pour récolter les 1,2 millions d’euros espérés…

Découvrez le prototype biplace VC200 du Volocopter en vidéo, lors de son test à Karlsruhe :

Et aussi dans les

ressources documentaires :

Sony a en outre prévenu qu’il s’attendait désormais à une lourde perte annuelle de 110 milliards de yens (810 millions d’euros), au lieu d’un bénéfice de 30 milliards, du fait de méventes d’une partie de ses appareils électroniques grand public et de frais de restructuration.

Le groupe a enfin précisé que les différentes mesures de réorganisation en cours réduiraient ses effectifs de 5.000 postes, dont 3.500 à l’étranger.

Bien que ses ventes des neuf premiers mois aient grimpé de 16% à 5.901 milliards de yens (44 milliards d’euros) et qu’il ait terminé dans le vert avec un bénéfice net de 11,17 milliards de yens et un résultat d’exploitation en hausse de 70% à 140 milliards de yens, Sony a reconnu être encore dans une phase difficile qui nécessite des mesures radicales, dont la cession des PC.

Sony avait commencé à proposer des ordinateurs personnels en 1996, enregistrant un pic de ventes de près de 9 millions d’unités par an il y a quelques années, mais pour l’année comptable 2013, il ne mise plus que sur 5,80 millions et cette activité est déficitaire.

Sony est le 9e fabricant mondial de PC, une place assez honorable mais sa part de marché ne dépasse pas 1,9% pour la période de janvier à septembre, selon les calculs de l’institut IDC.

La montée en puissance des tablettes numériques et smartphones qui remplacent parfois les PC portables lamine le marché des ordinateurs personnels et, la concurrence étant féroce, Sony ne parvient plus à conserver des marges.

De surcroît, depuis des années déjà, la division des téléviseurs ne parvient pas à être rentable, ce qui constitue un énorme casse-tête pour le groupe qui de toute façon ne peut pas se retirer de ce marché emblématique de la marque, d’autant que « les TV restent le centre du divertissement multimédia », a répété à maintes reprises le patron Kazu Hirai.

Ce dernier doit s’exprimer plus tard lors d’une conférence de presse.

kap/spi/jh

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

Une étude de faisabilité sera lancée la semaine prochaine. Dans cette perspective, une centaine de chercheurs venus du monde entier se réuniront du 11 au 13 février à l’Université de Genève afin de lancer ce programme prévu sur cinq ans.

Ce futur anneau est destiné à prendre la relève du LHC (accélérateur de particules), l’anneau actuel, qui mesure 27 km de circonférence. Cet anneau a été imaginé dans les années 1980 pour ne fonctionner que 25 ans plus tard.

D’une circonférence de 80 à 100 km, le futur anneau, baptisé FCC (Futur collisionneur Circulaire) pourrait atteindre une énergie sans précédent de 100 TeV (téraélectronvolt), contre 14 TeV pour le LHC.

Cette étude rejoint celle engagée depuis plusieurs années d’un collisionneur linéaire compact (CLIC), un accélérateur rectiligne de 80 kilomètres qui pourrait aussi passer sous la Suisse et la France.

L’objectif des deux études est d’examiner la faisabilité des différentes machines et d’en évaluer les coûts d’ici à 2018/2019, date à laquelle la stratégie européenne en la matière sera mise à jour, écrit le CERN.

La recherche en physique des particules devient en effet de plus en plus planétaire. Des informations sont régulièrement échangées entre l’Amérique, l’Asie et l’Europe au sein d’un organe mondial, l’ICFA (Comité international sur les futurs accélérateurs).

En attendant, il est prévu de faire fonctionner le LHC pendant encore vingt ans. Actuellement à l’arrêt, il doit redémarrer en 2015.

« Nous savons encore peu de choses sur le boson de Higgs, nous sommes en quête de la matière noire et de la supersymétrie… Seuls les prochains résultats du LHC seront en mesure de nous indiquer les pistes des recherches à suivre dans l’avenir, et le type d’accélérateur le plus adapté », a indiqué Sergio Bertolucci, directeur de la recherche et de l’informatique au CERN.

Le boson de Higgs a été découvert pendant l’été 2012 par le CERN grâce aux travaux du Belge François Englert et au Britannique Peter Higgs.

Le boson de Higgs est une particule élémentaire considérée par les physiciens comme la clef de voûte de la structure fondamentale de la matière.

Les deux hommes, qui sont octogénaires, ont reçu le Prix Nobel de physique pour cette découverte en 2013.

Ces travaux expliquent notamment pourquoi certaines particules ont une masse et pas d’autres, et par conséquent pourquoi l’Univers existe tel que nous le connaissons.

Dans les efforts de vulgarisation de cette découverte, le boson a été surnommé « particule de Dieu » parce qu’il est dans tout, tout en étant particulièrement insaisissable.

Cette avancée est l’une des plus importantes de l’histoire de la physique.

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

« C’est une longue saga, mais nous n’abandonnerons pas », a déclaré Jean-Louis Schilansky, le président de l’Union française des industries pétrolières. « Nous pensons que ce serait une erreur pour notre pays », a-t-il ajouté lors d’une conférence de presse.

La fracturation hydraulique, seule technique éprouvée pour exploiter le gaz et le pétrole de schiste, est interdite en France par une loi de juillet 2011, validée en octobre dernier par le Conseil constitutionnel. Elle est décriée en raison des risques qu’elle fait courir à l’environnement et le président français François Hollande a écarté toute exploitation durant son quinquennat.

« La fracturation telle que pratiquée aujourd’hui n’est pas une technique sale. C’est juste pas vrai! », a affirmé M. Schilansky. « Pendant ce temps, on ne fait rien, c’est du temps qu’on perd ».

Autre facteur défavorable à l’industrie pétrolière, selon l’Ufip, le « blocage » par le gouvernement d’une centaine de demandes de permis de recherche pour les hydrocarbures dits « conventionnels ».

« Aujourd’hui, il y a 112 permis bloqués, d’entreprises essentiellement étrangères qui ont fait des demandes auprès de l’administration française », a déploré M. Schilansky.

« Nous ne voyons rien venir », a-t-il ajouté, précisant que « seulement deux permis ont été octroyés » en 2013. « C’est une situation grave non seulement pour l’industrie française, mais aussi pour le message qui est envoyé à l’étranger. (…) Il ne faut pas s’étonner si les investissements étrangers en France ont baissé ».

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

La voix est un instrument familier et mal connu qui fascine et passionne beaucoup. Tous les jours, nous mesurons à quel point elle nous est utile pour communiquer avec les autres. Tous les chanteurs, comédiens et orateurs savent que leurs cordes vocales sont un « moteur » sensible qu’il faut protéger. Les scientifiques plus précis, appellent « plis vocaux » ces replis du larynx essentiels pour transformer notre souffle en voix. A la fois puissante et fragile, la voix peut nous toucher, nous séduire, nous agacer. Pourtant, nous ignorons souvent comment elle fonctionne, ce qu’elle dévoile de notre personnalité et ce dont elle est capable.

Réalisation : Grégoire Ausina

Et aussi dans les

ressources documentaires :

Une des pistes pour doper le fonctionnement des batteries du futur pourrait résider dans la présence de nano-diamants.

Il a déjà été observé que l’ajout de nano-diamants dans les électrodes améliore la capacité des condensateurs. A ce jour, ce bénéfice reste pourtant mal compris. C’est pour découvrir comment les nanoparticules de diamants optimisent les batteries que le Centre de recherche énergétique appliquée de Bavière bavarois (ZAE) et l’Université de Wurtzbourg (Bavière) s’associent au sein du projet UMWELTnanoTECH. Cette initiative allemande sur l’enrichissement des batteries à partir de nano-diamants est prévue sur trois ans.

L’enjeu énergétique est une problématique qui tient à cœur les allemands, pour preuve le financement du Ministère de l’environnement du Land de Bavière de trois millions d’euros !

Mais la thématique est séduisante. Une fois compris le mécanisme mis en jeu, les scientifiques pourront bénéficier de batteries plus performantes, dopées à partir d’un matériau à bas coût. En effet, alors qu’on pourrait croire que des particules de diamants valent aussi cher que du diamant de joaillerie, il n’en est rien. Les nanoparticules de diamants peuvent être récupérées parmi les résidus dispersés suite à la fabrication d’explosifs.

Comme l’a d’ailleurs démontré depuis 2007 le laboratoire alsacien Nanomatériaux pour système sous sollicitations extrême, quelques 500g de TNT dans une cuve en acier suffisent pour fabriquer du diamant sous forme de nano-particules. Ceci avec un rendement de plus de 10 % !

Des nanoparticules de diamant à un prix abordable, la capacité des supercondensateurs optimisée, voilà deux bonnes raisons pour en savoir plus.

Par Audrey Loubens, journaliste scientifique

Et aussi dans l’actualité :

Et aussi dans les

ressources documentaires :

13 janvier 2014 : le rover Yutu et la sonde spatiale lunaire chinoise Chang’e 3 sont sortis avec succès de la torpeur de leur première nuit lunaire, un réveil réussi après 14 jours (terrestres…) de sommeil forcé, le rover et la sonde spatiale ayant été exposés à des températures pouvant atteindre les -180 degrés Celsius. Depuis la grande aventure spatiale américaine et la mission spatiale soviétique Luna 24 en août 1976, la mission Chang’e 3 (déesse de la Lune dans la mythologie chinoise) est la première à parvenir à poser une sonde et un astromobile lunaire – le rover Yutu, « lapin de jade » en mandarin – sur le sol de notre bon vieux satellite.

Cet exploit permet à la Chine de gagner en crédibilité en entrant dans le cercle très fermé des nations capables de mener à bien une mission lunaire, mais permet également à la superpuissance asiatique de parfaire sa technique d’alunissage, une étape dont la maîtrise est absolument indispensable pour pouvoir accomplir ce qui semble être le véritable objectif des Chinois : ramener sur Terre des échantillons de sol lunaire. Surmonter une nuit sélène de près de quatorze jours autrement qu’avec une mise en veille prolongée reste pourtant une gageure, même pour les Chinois, qui ont dû munir leur rover d’un système de chauffage, à base… d’isotopes radioactifs de plutonium 238.

Une équipe de scientifiques de l’université polytechnique de Catalogne, aidée par des scientifiques américains, s’est proposée de trouver une solution à ce problème de nuit lunaire en étudiant deux scénarios permettant de stocker de l’énergie sur la Lune pendant qu’il y fait jour, deux scénarios exposés dans un article publié dans la revue spécialisée Acta Astronautica, s’adjoignant même pour l’occasion les services d’un ponte, Michael Griffin, administrateur de la NASA jusqu’en janvier 2009.

Le premier scénario nécessite l’utilisation de la régolithe, la couche poussiéreuse qui recouvre la croûte sélène, produite par l’impact des météorites à la surface de notre satellite. En y incorporant des éléments tels que de l’aluminium, il devient possible de jouer sur l’inertie thermique de l’ensemble, si l’on en croit Ricard Gonzalez-Cinca, coauteur de l’article et chercheur à l’université espagnole. « Lorsque les rayons du Soleil atteignent la surface, un système de miroirs reflète les rayons lumineux afin de réchauffer l’ensemble de la masse thermique qui, plus tard, peut à son tour transmettre de l’énergie sous forme de chaleur, la nuit, au rover et aux autres équipements lunaires. », explique-t-il.

Le second scénario envisagé est similaire, mais implique cette fois-ci un agencement différent des miroirs, connu sous le nom de « lentille de Fresnel », une lentille plan-convexe découpée de sections annulaires concentriques, utilisée dans l’éclairage des phares de signalisation marine. Les rayons du Soleil sont concentrés sur un tube contenant un fluide, que la chaleur transforme en gaz et qui réchauffe alors l’ensemble de la masse thermique. Au cours de l’une de ces longues nuits lunaires, un moteur Stirling pourra alors convertir la chaleur… en électricité.

Par Moonzur Rahman

Daniel Hubert, consultant expert en sécurité machines, nous présente la formation Sécurité Machines qu’il anime chez Techniques de l’Ingénieur.

Cette semaine dans la revue du Web :

En constante évolution et en voie de démocratisation, l’impression 3D tient le haut du pavé. Pour le prouver, débutons notre cinquante-cinquième Revue du Web avec « Mechaneu V1 », première sculpture d’une série de sculptures cinétiques imprimées en 3D par le studio de design new-yorkais Proxy. Développées dans le but d’explorer les limites artistiques de l’impression 3D, les sculptures miniatures sont composées d’un ingénieux système de 64 roues dentées constituant des engrenages circulaires, s’imbriquant parfaitement pour former une sphère dont l’aspect organique ne doit rien au hasard : la position et la dynamique de chacun de ces engrenages suit un schéma algorithmique fortement inspiré par la croissance des cellules de notre organisme, si l’on en croit le concepteur de « Mechaneu V1 », Toru Hasegawa.

Il suffit d’enclencher l’une des roues dentées pour que tout le réseau se mette en branle, comme dans un souffle. « La Nature vient à bout de nombreux problèmes en utilisant seulement la forme, ajoutant du matériau là où c’est nécessaire et en retirant là où elle n’en a pas besoin. », explique Hasegawa, avant d’ajouter qu’il s’est inspiré de cette même logique « sur chaque partie du Mechaneu, afin de créer un objet poreux bien que totalement solide ».

Pendant plutôt raté et petit frère boiteux de la vidéo précédente, la vidéo qui suit montre qu’on ne gagne pas à tous les coups en surfant sur la vague de l’impression en trois dimensions… On peut y voir un internaute se livrer à quelques expérimentations, dessinant des motifs en trois dimensions – dont un cube – dans un verre rempli de gélatine, à l’aide d’une encre « maison », constituée dans des proportions gardées secrètes de… liqueur de banane et de colorant alimentaire mâtiné d’un peu d’amidon pour rendre l’ensemble moins visqueux.

Signalons tout de même, pour rendre justice au concepteur, adepte du « do it yourself », que l’imprimante 3D utilisée est artisanale et entièrement composée de vieux lecteurs CD-ROM.

Continuons notre petit tour d’horizon avec une vidéo très ludique d’une expérience facile à réaliser chez soi, et dont le résultat semble être une insulte au bon sens : parvenir à réaliser une bulle de savon… cubique. Pour cela, il suffit de suivre les instructions de notre maître de cérémonie, un scientifique amateur particulièrement inventif et au fort accent russe, répondant au doux sobriquet de « Crazy Russian Hacker », qui a posté la vidéo sur Youtube au début du mois de janvier.

Il faut tout d’abord « construire la structure », un cube constitué de douze Cotons-Tiges – comme autant d’arêtes – collés entre eux par leurs extrémités. Une fois l’ossature réalisée, tremper minutieusement chacune des faces de la structure cubique dans de l’eau savonneuse, afin qu’un film de cette eau prenne possession du cube. Première surprise : le film d’eau savonneuse ne se stabilise pas en épousant la surface de chacune des faces, mais selon des surfaces minimales stables qui s’appuient sur le contour. C’est une solution au fameux « problème de Plateau » consistant à montrer, un bord étant donné, qu’il existe une surface minimale s’appuyant sur ce bord.

Notre sympathique Russe souffle enfin une bulle de savon au milieu de la structure, qui est alors capturée au centre du cube, épousant à son tour ce qui semble être une forme cubique. Mieux : l’ensemble forme un tesseract, l’analogue quadridimensionnel du cube, décrit de manière formelle comme « un 4-polytope régulier convexe dont les frontières sont constituées par huit cellules cubiques ».

Imaginer qu’un étudiant en chimie daigne se contenter d’un robot araignée sentinelle pour les fêtes de fin d’année, aussi perfectionné soit-il, revient à se bercer de douces illusions. Un jeune étudiant américain nous explique dans la vidéo qui suit, démonstration à l’appui, comment modifier un jouet somme toute inoffensif en une terrifiante araignée robotique téléguidée.

Première étape, se débarrasser de la tourelle d’origine du robot « mecha Attacknid Stryder », pour y installer un premier laser de visée, un pointeur rouge. Seconde étape, installer et connecter à l’ensemble une diode laser de 2W, de couleur bleu, et le tour est joué ! Notre apprenti bricoleur, la manette bien en main, lance alors sa nouvelle machine de guerre sur trois ballons de baudruche ayant eu l’outrecuidance de manquer de respect à la sentinelle robotique. La sanction ne se fait pas attendre.

Rappelons néanmoins l’importance des lunettes de protection laser, qui réduisent de manière significative la quantité de lumière incidente de longueur d’onde spécifique, évitant ainsi à l’œil humain d’être exposé tout en autorisant la transmission d’une quantité de lumière suffisante à une bonne vision.

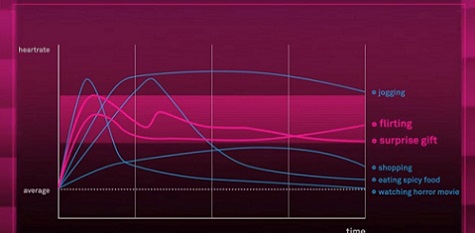

La ceinture de chasteté, insuffisante ? Si vous partagez cette opinion, le gadget (inutile?) de la semaine pourrait bien vous réjouir : les Japonais de Ravijour proposent « True Love Tester Bra », un soutien-gorge de chasteté permettant de détecter – supposément – lorsqu’une femme est réellement amoureuse, livrant alors – et alors seulement – la poitrine tant convoitée. Le soutien-gorge japonais dissimule dans l’un de ses bonnets un capteur, synchronisé au préalable avec une application présente sur le smartphone de la propriétaire (via bluetooth), permettant de mesurer les battements du cœur de cette dernière. Les données collectées sont « analysées », et le soutien-gorge finit par se dégrafer tout seul, dans un mouvement d’une rare violence, lorsque les battements restent suffisamment longtemps dans une zone spécifique, comme le montre l’illustration suivante.

La vidéo, pas sexiste pour un sou, montre le calvaire de quelques demoiselles livrées à un bestiaire masculin des plus « représentatifs » :la bête humaine, balourd et très direct, le technicien de l’amour, tout en filoutes flagorneries, ou encore le m’as-tu-vu, sûr de lui et de ses liasses de billets. Qui sera alors surpris que les concepteurs se cachant derrière le « True Love Tester Bra », en fin connaisseurs de la gent féminine et de ses émotions, sont… deux hommes ? Un autre aspect intéressant : une femme ne pourra donc pas enlever son soutien-gorge pour se laver, pour aller se coucher, ni même se changer si elle n’éprouve pas « l’amour véritable » tant vanté ici ?

En bonus de la Revue du Web de cette semaine, voici une jolie petite mélodie qu’aucun ingénieur ou technicien travaillant sur une turbine à gaz de combustion n’a la moindre envie d’entendre. Semblant sortir tout droit d’un xylophone, cette douce phrase musicale est pourtant synonyme de cauchemar pour tout bon technicien, car cela signifie qu’il va bien falloir sortir la vis si l’on ne veut pas courir le risque d’endommager gravement la turbine. Et comme bien souvent, il est bien plus facile de laisser entrer la vis que de parvenir à la sortir…

Par Moonzur Rahman

Et aussi dans les

ressources documentaires :

« I hate math ! », les premières images du film Comment j’ai détesté les maths commencent par ce constat façon micro-trottoir dans toutes les langues : le désamour des maths est bien réel et sans frontière, et les jeunes interviewés s’en vanteraient même. « Pourquoi autant de gens se disent nul en maths, et souvent avec fierté ? C’est rarement le cas pour la littérature, l’histoire ou d’autres matières. Je suis parti de ce cri du cœur, surement un peu trivial mais qui parle à beaucoup, pour voir si on pouvait aller au-delà » explique le réalisateur Olivier Peyon. À travers un voyage aux quatre coins du monde avec les plus grands mathématiciens dont Cédric Villani (médaille Fields 2010), ce film aborde des sujets très variés : l’éducation, la recherche, la technologie, la politique, la finance…

Et l’amour ou le désamour des maths, ça commence à l’école : « Il faut faire des maths une histoire mystérieuse qui enchante les enfants » explique l’un des mathématiciens. Apprendre le langage mathématique, ce n’est pas forcément synonyme d’austérité, rigidité ou élitisme. En suivant dans leurs classes ces enseignants hors pair, on se prend à rêver d’une école ouverte sur l’expérimentation, la curiosité, la découverte du raisonnement, le doute et le plaisir ! Rapprocher les maths du monde réel est un enjeu majeur de l’enseignement. La réforme des « maths modernes » sous l’influence du mathématicien Bourbaki dans les années 70 a fait entrer brutalement des milliers d’élèves et d’enseignants dans le monde de l’abstraction : pour définir une droite, il n’était plus question « de plus court chemin entre 2 points », mais « d’un ensemble de points alignés entre deux points A et B ». La rupture était consommée. La réforme fut abandonnée dans les années 80, mais nous en payons encore le prix.

Aujourd’hui, il est pourtant de notre responsabilité de nous réapproprier les maths, de ne pas renoncer ! En 40 ans, les mathématiques ont bouleversé notre société pour créer un monde où tout est tourné vers l’efficacité, la rentabilité. Apple, Google, Goldman Sachs ne sont plus qu’algorithmes et formules mathématiques. En politique aussi, on se sert des maths pour asséner des certitudes et clore le débat : « c’est mathématique », « les chiffres parlent d’eux-mêmes, c’est statistique », alors que les mathématiciens se construisent eux sur le doute. « Dans ce film, il est question de notre propre responsabilité, de la place que nous avons donnée aux mathématiques, de notre renoncement à y comprendre quelque chose, les laissant du coup entre les mains de certains, comme par exemple les banques qui ont abusé des modèles mathématiques et déclenché la crise des subprimes » alerte Oliver Peyon.

Ce film, qui donne parfois l’impression de partir dans beaucoup de directions à la fois, a le mérite d’aborder un sujet rare, d’éveiller nos consciences, de produire du doute, du questionnement… et de donner à penser ! A l’image du mathématicien Gert-Martin Greuel, qui conclut ainsi le film : « Ne croyez aucune autorité, vérifiez par vous-même. Ne répétez pas des formules apprises par cœur, mais développez vos propres idées. N’arrêtez jamais ».

M. B

Comment j’ai détesté les maths, film réalisé par Olivier PEYON

Et aussi dans les

ressources documentaires :

Le professeur Gilles-Eric Séralini, auteur d’une étude controversée sur des effets d’un OGM et du pesticide Roundup sur des rats, persiste et signe avec un nouvelle étude montrant selon lui que les pesticides sont « deux à mille fois plus toxiques » qu’annoncés.

« Nous avons étendu les travaux que nous avons faits avec le Roundup et montré que les produits tels qu’ils étaient vendus aux jardiniers, aux agriculteurs, étaient de 2 à 1.000 fois plus toxiques que les principes actifs qui sont les seuls à être testés in vivo à moyen et long terme », a-t-il déclaré jeudi à l’AFP.

Avant mise sur le marché, seuls les effets de la substance active sont évalués et non ceux des produits commercialisés auxquels ont été ajoutés des adjuvants.

« Il y a méprise sur la réelle toxicité des pesticides », a insisté le professeur Séralini, précisant qu’il y a toxicité « quand les cellules commencent à se suicider » au contact du produit et « qu’elles meurent en quantités beaucoup plus significatives que les cellules contrôles ».

L’étude, publiée il y a quelques jours dans la revue Biomed Research International (groupe Hindawi) à comité de lecture, est signée du professeur Séralini ainsi que d’autres membres de l’université de Caen, où se trouve son laboratoire, et du Comité de recherche et d’information indépendantes sur le génie génétique (Criigen).

Elle a été réalisée in vitro sur cellules humaines sur neuf des « principaux » pesticides utilisés dans le monde: trois herbicides (Roundup, Matin El, Starane 200), trois insecticides (Pirimor G, Confidor, Polysect Ultra), et trois fongicides (Maronee, Opus, Eyetak).

Elle conclut que sur 9 de ces pesticides, « 8 formulations sont clairement en moyenne des centaines de fois plus toxiques que leur principe actif », et pointe du doigt les adjuvants qui « sont souvent gardés confidentiels et sont déclarés comme inertes par les fabricants ».

Les conclusions de l’étude choc du professeur Séralini sur les effets des OGM et du Roundup sur des rats, publiée en 2012, avaient été contestées par l’Agence européenne de sécurité des aliments (Efsa) et l’Agence nationale de sécurité sanitaire (Anses).

La revue Food and chemical toxicology (groupe Elsevier), qui l’avait publiée, a retiré l’article en novembre dernier. Le professeur Séralini avait relié cette décision de retrait à l’arrivée dans le comité éditorial de la revue de Richard Goodman, « un biologiste qui a travaillé plusieurs années chez Monsanto ».

Conduite en secret pendant deux ans, l’étude démontrait, selon son auteur, un risque accru de tumeurs mammaires et d’atteintes hépato-rénales pour les rats nourris avec le maïs OGM, associé ou pas à l’herbicide Roundup, deux produits du fabricant Monsanto.

La nouvelle étude du Pr Séralini a été saluée jeudi par l’ONG Générations Futures. « Nous demandons que des tests sur les effets chroniques de ces formulations de pesticides soient rendus obligatoires au niveau national et européen au plus vite, c’est une exigence de santé publique! », a déclaré son porte-parole, François Veillerette, dans un communiqué.

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

15/01/2014

Avant le 1er décembre 2010, les industriels ont enregistré les substances fabriquées ou importées en quantités supérieures à 1 000 tonnes par an mais aussi les substances cancérogènes, mutagènes ou toxiques pour la reproduction au-dessus d’une tonne par an, et les substances dangereuses pour les organismes aquatiques ou l’environnement en quantités supérieures à 100 tonnes par an.

La règlementation REACH exige de l’ECHA qu’elle vérifie au moins 5 % de la conformité des enregistrements par bande de tonnage. L’ECHA s’était fixé un objectif d’avoir 5 % des dossiers vérifié, au moins partiellement, à la fin de 2013.

À la fin de 2013, l’ECHA a conclu 1130 contrôles de conformité ou 5,7 % du nombre total de dossiers d’enregistrement de plus de 100 tonnes présentées au 1er décembre 2010. 69% des dossiers examinés ont été jugés non conformes. Les deux principales raisons de ces non-conformités résident dans les informations relatives à l’identification et la composition de la substance, et les justifications insuffisantes pour ne pas soumettre les études nécessaires ou un manque de données dans le rapport sur la sécurité chimique.

16/01/2014

La direction générale de la prévention des risques du ministère de l’Ecologie a publié un fascicule de 2 pages sur les fiches de données de sécurité (FDS) relatives aux produits chimiques. La fiche de données de sécurité doit accompagner la fourniture de substances ou mélanges dangereux au titre du règlement Reach. Transmise d’amont en aval dans la chaîne d’approvisionnement, elle offre une connaissance complète des dangers associés à l’utilisation de ces produits. Ce dépliant indique la marche à suivre pour se conformer à la fiche de données de sécurité.

Le second fascicule concerne les scénarios d’exposition et la marche à suivre à réception d’un scénario d’exposition.

Ce document est disponible sur : http://www.developpement-durable.gouv.fr/IMG/pdf/13150-Reach_fiches-scenario_10-01_DEF_Web.pdf

16/01/2014

Un avis aux opérateurs économiques est paru au journal officiel du 16 janvier 2014. Il informe de la mise à jour de la liste des substances candidates à autorisation par l’ECHA le 16 décembre 2013, avec 151 substances et rappelle aux opérateurs économiques les obligations liées à la présence de SVHC dans les articles.

27/01/2014

Le helpdesk propose une nouvelle brochure: « TPE/PME : comment me situer et justifier de mon statut ? ». En effet, conformément au règlement Reach, les PME peuvent bénéficier de réductions significatives pour de nombreux actes soumis à redevances.

Ainsi, cette brochure a pour objectif d’apporter une aide concrète aux micro, petites et moyennes entreprises, notamment dans la détermination et la manière de vérifier ce statut de PME.

Cette brochure est disponible sur le site du Helpdesk http://reach-info.ineris.fr dans l’onglet « Documentation », section « Guides et Brochures »: http://reach-info.ineris.fr/sites/reach-info.gesreg.fr/files/pdf/BROCHURE%20PME_janv%202014.pdf

31/01/2014

La nouvelle version de la IUCLID Report Generator importe des informations sur l’évaluation de l’exposition générée dans l’évaluation de la sécurité chimique et l’outil (Chesar)

Et aussi en

formation :

Et aussi dans les

ressources documentaires :

Le prototype, présenté dans la revue scientifique spécialisée Food Chemistry, affiche un taux de précision de 82%.

Fondé sur le fonctionnement de la langue humaine et de ses papilles ultra-sensibles, « le concept de langue électronique revient à utiliser une palette de capteurs génériques qui réagissent aux divers composés chimiques recherchés », résume dans un communiqué Manel del Valle, chimiste à l’Université autonome de Barcelone.

En l’occurrence, la langue espagnole est composée de 21 « électrodes ioniques » réagissant à différentes substances, comme l’ammonium, le sodium, les nitrates ou les chlorures.

Le spectre de signaux générés par la langue artificielle a ensuite été étalonné en fonction des différents types de bière à laquelle elle était exposée.

Grâce à une analyse informatique et un processus automatique « d’apprentissage supervisé », le dispositif « nous a permis de différencier les principales catégories de bière étudiées: schwarzbier (bière noire), lager, double malt, pils, alsacienne et sans alcool, avec un taux de réussite de 81,9% », assure M. del Valle.

L’organe artificiel est en revanche incapable de reconnaître les breuvages dont on ne lui a pas enseigné la signature chimique (mélange de bière et de soda, autres boissons), preuve de sa fiabilité selon les experts.

« Ces outils pourraient un jour doter les robots d’un sens du goût » et pourraient même finir par « supplanter les panels de goûteurs dans l’industrie alimentaire pour améliorer la qualité et la régularité des produits destinés à la consommation », conclut l’étude.

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

Le problème ? « Cette affirmation est dénuée de tout fondement » explique sur son blog personnel Cédric Philibert, expert de l’Agence Internationale de l’Energie (AIE), dans un billet intitulé « L’Allemagne brouille-t-elle la vue des électriciens français? » et publié le 27 janvier 2014. « Sans les renouvelables, et compte-tenu du prix du gaz, l’Allemagne recourrait bien davantage encore au charbon – et l’augmentation de son usage résultant de la sortie progressive du nucléaire serait bien plus rapide encore » prévient-il.

Selon ce spécialiste des questions énergétiques à l’échelle internationale et qui a dirigé la rédaction de plusieurs rapports de l’AIE sur les énergies d’avenir, trois facteurs sont responsables du léger et récent regain du charbon en Allemagne : le recul du nucléaire, la multiplication par trois depuis 10 ans du prix du gaz en Europe qui est indexé à celui du pétrole, et enfin la faiblesse du prix du CO2 dans le cadre du système communautaire d’échange de quotas d’émission (EU ETS). On peut aussi ajouter les prix bas du charbon sur le marché consécutivement au boom du gaz de schiste aux USA. « Les renouvelables n’y sont pour rien – sinon pour n’avoir pas crû assez vite » conclue l’expert.

« La transition énergétique allemande est vraiment incomprise en France, c’est le moins qu’on puisse dire. Les articles assassins sont légion, et très souvent biaisés de façon étonnante, médias reprenant en boucle idées reçues et désinformations » regrette Cédric Philibert.

Un problème de déontologie se pose pour les journalistes. La mise en avant des avantages réels du nucléaire, comme par exemple la capacité de produire de l’électricité en continu, en particulier l’hiver où la production électro-solaire est plus faible, ou de réduire la facture liée aux importations de combustibles fossiles, n’est-elle pas suffisante pour que certains en viennent à mentir de manière délibérée à propos des énergies renouvelables ? Au nom du sauvetage de la filière nucléaire française, fleuron national, et de la volonté de prolonger le fonctionnement de nos vieilles centrales nucléaires jusqu’à 2040, tout est-il permis, y compris de faire preuve au pire de malhonnêteté intellectuelle délibérée ou, au mieux, d’ignorance ?

En 2003, selon la BDEW, l’association fédérale des industries de l’énergie et de l’eau, le charbon et le lignite représentaient 50 % de la production électrique allemande, le gaz 10 %, le nucléaire 27 % et les ENR 7 %. En 2013 le couple charbon-lignite est passé à 46 %, le gaz est resté à 10 %, le nucléaire a chuté à 15 % et les ENR ont fortement progressé pour atteindre 23 %. La hausse significative des ENR (+16 points) s’est ainsi accompagnée d’une baisse du couple charbon-lignite (-4 points), d’une chute du nucléaire (-12 points) et d’un maintien du gaz à son niveau initial.

La ponctuelle et légère hausse du charbon entre 2012 et 2013 (passage de 18,5% à 19,7%), qui s’accompagne par une baisse symétrique du gaz (passage de 12,1 % à 10,5 %) ne change rien à la tendance de fond engagée en Allemagne, dynamique vertueuse d’un pays qui s’est doté un objectif clair à horizon 2050 : 80 % d’ENR. Le gaz naturel américain va parvenir sur le marché européen (liquéfaction et transport par navire méthanier) d’ici environ 2 ans, ce qui contribuera à changer la donne.

Dans une tribune intitulée « Energies renouvelables : sortons de la caricature ! » publiée dans Les Echos le 4 janvier 20114 », Jean-Louis Bal, président du Syndicat des Energies Renouvelables (SER) a rappelé que pour la France les énergies renouvelables « constituent le moyen le plus efficace de progresser vers trois objectifs fondamentaux : la réduction de notre dépendance énergétique (60 milliards d’euros d’importations chaque année), la réduction de nos émissions de gaz à effet de serre et la construction de filières industrielles françaises puissantes, dont les débouchés mondiaux sont une réalité. »

ci-dessus : Production d’électricité en Allemagne par source

François Hollande, qui s’est engagé devant le peuple français à réduire la part du nucléaire dans le mix électrique française de 75% à 50% d’ici 2025, a annoncé lors de sa conférence de presse du 14 janvier 2014 son souhait que soit crée une grande alliance franco-allemande dans le domaine des énergies renouvelables et de l’efficacité énergétique.

Cette idée d’EADS des énergies renouvelables pour l’Europe a été proposée dès 2011 par Serge Orru, à l’époque directeur du WWF-France. François Hollande a comme projet phare la construction d’une méga-usine franco-allemande de production de panneaux solaires photovoltaïques susceptible, par effet d’échelle, de faire baisser les coûts de production et ainsi devenir en mesure de concurrencer les producteurs asiatiques sur le marché mondial.

L’Allemagne a choisi de se focaliser sur les filières énergétiques les plus pertinentes sur le plan économique, l’éolien terrestre et le solaire photovoltaïque. Le coût du photovoltaïque a fortement chuté ces dernières années grâce à la forte ambition chinoise sur ce marché d’avenir, ce qui a déstabilisé l’industrie européenne dans ce domaine. De manière pragmatique, les mécanismes de soutien des filières biogaz et éolien maritime, trop coûteuses en période de crise économique, viennent d’être revus à la baisse outre-Rhin. Dès 2015, un tarif moyen de 12 centimes le kWh sera mis en place qui tombera ensuite à un tarif unique de 9 centimes pour toutes les filières renouvelables. Il convient de « garantir que la transition énergétique soit un succès non seulement sur le plan écologique mais aussi économique » résume Rainer Baake, le nouveau Secrétaire d’État au ministère fédéral de l’environnement, ex directeur du think-tank Agora-EnergieWende.

A titre de comparaison EDF a fait pression auprès du gouvernement britannique pour obtenir un tarif d’achat (« strike price ») de 10,9 centimes pour le nouveau nucléaire (EPR). Ceci alors que le nucléaire n’est pas une énergie renouvelable : la ressource utilisée, l’uranium 235 a un stock très limité, de seulement quelques décennies au rythme de la consommation mondiale actuelle. Et cette filière, du début jusqu’à la fin, pose de sérieux problèmes sur le plan de la sécurité, de la santé, de l’environnement

En France aussi, comme en Allemagne, l’avenir peut être solaire. Sauf si les journalistes acceptent la pollution, par tous les moyens, du débat énergétique par les défenseurs des énergies non durables, semant ainsi la confusion dans l’esprit des citoyennes et citoyens français. Il s’agit d’une question éminemment éthique étant donné qu’elle nous engage pour les décennies à venir.

Par Olivier Danielo

Et aussi dans l’actualité :

Avec 4 places, l’absence de montant central offre une vue directe sur l’habitacle. Le tableau de bord sert de surface de projection en alternant informations et éléments décoratifs personnalisables. La motorisation est électrique avec un prolongateur d’autonomie au gaz naturel pour véhicules (GNV). Le concept va guider l’orientation stylistique d’Opel pour se prochains modèles.

Ce coupé sportif est un hybride pouvant aller jusqu’à 350 km/h. La voiture atteint les 100 km/h en 2,9 secondes.

![]()

Intégralement électrique, cette petite citadine bleue de 5 portes est lumineuse et se veut « organique », avec un habitacle proche du milieu naturel. Elle dispose en théorie d’une autonomie de 160 km et d’une vitesse de pointe de 130 km/h. A quel point inspirera-t-elle les futurs modèles de la marque ?

Renault nous propose ici une version moderne et haut de gamme de l’Espace. Le toit, en verre, représente le plan de Paris.

Voici un concept de citadine musclée hybride électrique-essence. Kia, le constructeur coréen, serait en train de faire une étude de marché pour lancer la production en série d’une voiture proche de ce concept.

À essence, cette berline compact musclée émettrait 145 g de CO2 par kilomètre pour une consommation moyenne de 6,3L/100 km. La porte est ouverte à une éventuelle commercialisation.

Un écran tactile regroupe toutes les fonctions au centre du tableau de bord. Il s’agit d’une Hybrid’Air à air comprimé couplé à un moteur essence. La nouvelle Citroën C4 Cactus, dévoilée officiellement le 5 février 2014, est inspirée de ce concept car, mais n’adoptera pas le moteur « Hybrid Air ».

Cet hybride rechargeable devrait donner à un véhicule produit en série et commercialisé prochainement en Asie, mais pas en Europe.

Ce coupé de luxe a été commandé par BMW au carrossier italien Pininfarina pour le concours d’élégance de la Villa d’Este 2013. Pari réussi !

Horaires :

Jeudi 30/01 et samedi 01/02 : 10h-20h

Vendredi 31/01 : 10h-19h

Dimanche 02/02 : 10h-18h

Par Matthieu Combe, journaliste scientifique

Et aussi dans les

ressources documentaires :

Selon le Canard enchaîné, Arnaud Montebourg veut publier après les municipales un rapport défendant une nouvelle technique expérimentale « propre » d’exploitation des hydrocarbures de schiste, qui consisterait à utiliser du « fluoropropane » comme alternative à la fracturation hydraulique interdite en France.

« La question à mes yeux est de savoir si nous pouvons nous permettre d’exploiter de nouvelles énergies fossiles fortement émettrices de CO2 alors que nous nous sommes fixé comme objectif de réduire nos émissions de gaz à effet de serre et de réduire notre consommation d’hydrocarbures de 30% à l’horizon 2030 », a déclaré M. Martin lors de sa cérémonie de voeux. « Les réponses me semblent être dans les questions ».

Le ministre de l’Ecologie a rappelé la position du président de la République, François Hollande, et du gouvernement contre l’exploitation du gaz de schiste.

« Cette position vient de loin », a-t-il souligné. « Alors dans l’opposition, nous avions déposé une proposition de loi en juillet 2011, dont le premier signataire était (le Premier ministre) Jean-Marc Ayrault et quatre ministres actuels figuraient parmi les premiers signataires », dont Arnaud Montebourg.

Les deux ministres n’en sont pas à leurs premières escarmouches.

M. Montebourg avait dit jeudi dernier qu’il espérait « convaincre » François Hollande « d’avancer sur la recherche » de techniques « propres » pour l’exploitation des gaz et pétrole de schiste, s’attirant les critiques de son collègue de l’Ecologie.

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

Dans le sud de l’Allemagne, le petit PV en toiture permet dès à présent de délivrer un kWh à 8 centimes, et c’est encore plus économique avec le grand PV au sol. Dans le nord du pays, le coût est de 14 centimes du fait du plus faible ensoleillement annuel, ce qui reste néanmoins très inférieur au prix de l’électricité pour les particuliers outre-Rhin (29 centimes le kWh). Le coût moyen du PV à l’échelle du pays est de l’ordre de 11 centimes le kWh, c’est-à-dire exactement le tarif d’achat demandé par EDF en Grande-Bretagne pour le nucléaire EPR.

Le LOEC (Levelised Cost of Energy) des centrales fonctionnant au lignite est aujourd’hui de 5 centimes par kWh en Allemagne, celui des centrales au charbon de 8 centimes et celui des centrales à gaz combiné peut monter jusqu’à 9.8 centimes.

La hausse du prix des combustibles fossiles dans les décennies à venir étant inévitable du fait de la hausse de la demande énergétique mondiale, un énorme boulevard s’ouvre pour la croissance des petites unités de production renouvelables décentralisées qui sont fortement désirées par la population allemande.

Dans le cadre de la nouvelle loi en matière d’ENR, dite Loi « EEG 2.0 », par soucis de rationalité économique, l’Allemagne va fixer un tarif unique d’achat pour l’ensemble des filières renouvelables, de 12 centimes en 2015, qui passera à 9 centimes quelques années plus tard. L’éolien terrestre et le photovoltaïque, deux filières dont le potentiel technique est immense, seront les grands gagnants de ce nouveau cadre réglementaire.

Selon l’institut Frauhofer, le coût du KWh provenant des centrales solaires à concentration thermodynamique (CSP, Concentrated Solar Power), une technologie différente du photovoltaïque et prônée notamment par le think Tank Desertec, restera relativement élevé en 2030, compris entre 9 et 11,5 centimes dans l’hypothèse d’une insolation normale directe de 2000 KWh par mètre-carré et par an (contre 14 à 19,5 centimes aujourd’hui). C’est-à-dire 2 à 3 fois plus coûteux que le petit solaire PV à cette date.

Ce qui est valable dans la moitié sud de l’Europe l’est aussi en Australie, au Moyen-Orient, dans l’ouest des USA, en Afrique et en Amérique latine affirment les experts du Fraunhofer.

Alors que le charbon attire aujourd’hui fortement les pays dits « du sud » du fait de son attractivité économique, l’émergence d’un solaire PV de plus en plus bon marché offre un formidable espoir dans la perspective d’une libération progressive de l’humanité de sa dépendance envers les énergies sales sans compromette son développement économique.

La perspective d’un coût aussi bas du photovoltaïque permet d’envisager une réduction progressive des émissions de gaz à effet de serre, uniquement en laissant faire le marché. Et ceci même si les différents pays du monde ne parvenaient pas à se mettre d’accord sur des objectifs contraignants des volumes d’émissions, ce qui a été le cas lors de tous les sommets internationaux sur le climat jusqu’à présent.

Même si le projet souhaité par François Hollande se réalisait, projet d’alliance franco-allemande pour construire une grande usine de production de matériel photovoltaïque, nul ne peut prévoir si cela sera suffisant pour devenir compétitif face à la très puissante industrie chinoise. Il était dans tous les cas grands temps de réagir car le marché qui s’ouvre aux gagnants de cette course est colossal.

Selon une étude prospective du groupe pétrolier Shell, le solaire photovoltaïque sera la 4ème source d’énergie primaire du monde en 2040, derrière le charbon le pétrole et le gaz mais devant l’éolien, l’hydraulique, les agrocarburants, la gazification de la biomasse, la valorisation des déchets, la géothermie et le nucléaire. Et il deviendra la première source d’énergie en 2100.

Par Olivier Daniélo

La Politique énergétique de l’Union Européenne repose notamment sur le développement d’un marché intérieur de l’électricité et sur le « paquet climat-énergie » adopté en 2008. Ce dernier pose des objectifs ambitieux (le 3×20) en termes de réduction des émissions de gaz à effet de serre, d’efficacité énergétique et de développement des énergies renouvelables.

Entre temps, la crise est passée par là et le marché se retrouve en situation critique. Il est en surcapacité, c’est-à-dire qu’il existe trop de moyens de production en Europe pour répondre à la demande électrique. Dans une économie de marché, lorsque l’offre excède la demande, les prix baissent ! Il y a deux raisons principales à cette surcapacité : la crise économique a fait baisser la demande électrique bien en-deçà des prévisions (alors que l’on continuait à construire de nouvelles capacités) et les énergies renouvelables intermittentes se sont développées rapidement. Ces énergies étant subventionnées « hors marché » et bénéficiant d’un accès prioritaire sur le réseau électrique, il y a une décorrélation entre leur développement et les besoins réels.

Le développement des énergies renouvelables amplifiant le problème de surcapacité, cela entraîne une chute du prix de gros de l’électricité et une mise sous « cocon », voire une fermeture, d’un grand nombre de centrales thermiques, devenues non rentables. Des dizaines de gigawatts de centrales thermiques neuves ferment ainsi en Europe. Le paradoxe ultime est qu’il faudrait en fermer encore davantage, mais que cela n’est pas possible, car il faut les garder pour répondre à l’intermittence ! Si le prix du marché de gros est à la baisse, le prix du détail est à la hausse et la compétitivité des centrales thermiques prend un sacré coup !

En parallèle, la lutte contre les émissions de gaz à effet de serre en Europe est mise à mal par la révolution du gaz de schiste aux Etats-Unis. Le prix du gaz y étant désormais trois fois moins élevé qu’en Europe, le pays exporte son charbon sur le « Vieux Continent ». Le charbon l’emporte alors sur le gaz dans les centrales thermiques qui restent en activité et les émissions de gaz à effet de serre augmentent.

Dans son rapport « La crise du système électrique européen », le Commissariat général à la stratégie et à la prospective (CGSP) formule plusieurs recommandations pour sortir le marché de l’électricité européen de cette crise. Le CGSP et les industriels se rejoignent sur trois points fondamentaux : faire de la baisse des émissions de gaz à effet de serre l’objectif principal du paquet climat-énergie (sinon le seul), repenser les aides aux énergies renouvelables et créer un vrai marché européen du carbone.

Après le 3×20 en 2020, de nouveaux objectifs vont être débattus cette année au Parlement européen pour 2030. En particulier, la Commission a proposé aux États membres de réduire de 40% les émissions de gaz à effet de serre européennes. Il pourrait également y avoir un objectif contraignant de développement d’énergies renouvelables. Mais rajouter un tel objectif à l’horizon 2030 est une « folie » dans la situation actuelle, selon Philippe Torrion, Directeur Optimisation Amont-Aval & Trading d’EDF. « Je crois que c’est le seul exemple de secteur économique dans l’Histoire en situation de surcapacité massive où l’on continue d’ajouter de nouvelles capacités », regrette-t-il à l’occasion du colloque du Club Energie & Développement. Pour dépasser cet état de fait, « a minima, il faudrait maîtriser le développement des nouvelles capacités d’énergies renouvelables en se calant, autant que possible, sur ce qui est juste nécessaire pour développer leur efficacité […] lorsqu’il s’agira de remplacer les équipements existants en fin de vie aux horizons 2035-2040 », analyse-t-il. « Les moindres dépenses mis dans ces moindres volumes d’ENR permettraient d’investir massivement dans la recherche et développement pour avoir des énergies plus compétitives lorsque nous aurons besoin de plus de capacités », conclut-il.

En parallèle, il faudrait tout de même faire de la réduction des émissions de gaz à effet de serre le principal objectif à atteindre pour lutter contre le réchauffement climatique. Si le développement des énergies renouvelables s’accompagne d’une hausse des émissions de gaz à effet de serre, comme cela semble être le cas actuellement en Allemagne avec le recours au charbon, on se trompe effectivement d’objectif.

Puisque les politiques de soutien aux énergies renouvelables creusent les budgets nationaux et des ménages et amplifient le problème de surcapacité, il semblerait bon de les repenser. Notamment, le CGSP recommande de remplacer les tarifs d’achat pour les technologies qui ont atteint la maturité technologique par des mécanismes de type « marché + prime » et par des appels d’offres portant sur des quantités limitées. Dans ce cadre, les énergies renouvelables seraient soumis aux mêmes responsabilités que les énergies conventionnelles et mettraient fin au paiement des tarifs d’achat lorsque les prix de gros sont négatifs ou lorsque les lignes sont saturées. Le Club Energie & Développement fait des recommandations similaires.

Pour que tout cela fonctionne, il faut un marché du carbone dissuasif, ce qui n’est pas le cas actuellement. Les prix sont aujourd’hui à 5 euros la tonne de CO2. Le CGSP recommande donc de réformer en profondeur ce marché afin de donner un signal-prix clair pour les investissements de long terme et de créer une banque centrale du carbone afin de disposer d’une certaine marge d’ajustement.

Par Matthieu Combe, journaliste scientifique

Et aussi dans les

ressources documentaires :

Le ministre du Redressement productif Arnaud Montebourg veut publier après les municipales un rapport défendant une nouvelle technique expérimentale « propre » d’exploitation des hydrocarbures de schiste, affirme le Canard enchaîné mercredi.

Cette technique, déjà évoquée dans un rapport parlementaire fin 2013, consisterait à fracturer la roche contenant les hydrocarbures sans avoir recours à la technique utilisant de l’eau et des produits chimiques, interdite en France pour son risque environnemental.

Il s’agirait, selon le Canard Enchaîné, d’utiliser du « fluoropropane » (en réalité, de l’heptafluoropropane également connu sous le sigle de « non flammable propane », NFP, ndlr), une technologie « propre » proposée par la société américaine ECorpStim. Ce liquide non inflammable dérivé du propane est actuellement utilisé comme propulseur dans des inhalateurs pour traiter l’asthme ainsi que dans des extincteurs.

Interrogé par l’AFP, le ministère du Redressement productif n’a pas souhaité faire de commentaires.

Le cousin du NFP, le propane, a déjà servi à mener quelques fracturations hydrauliques qui n’utilisent pas d’eau et peu, voire pas de produits chimiques, en remontant 95% du propane avec le gaz ou le pétrole visé. Inconvénient principal: cette technique nécessite en surface plusieurs centaines de tonnes de propane inflammable, ce qui en France transformerait chaque forage en site Seveso.

Jamais testé en conditions réelles, le NFP présente lui les mêmes avantages que le propane, mais est également non inflammable, ce qui « supprime à 100% les risques industriels », selon le rapport publié en novembre par l’Office parlementaire d’évaluation des choix scientifiques et technologiques (Opesct).

Comme le propane, il est toutefois « onéreux », reconnaît l’Office, ce qui pourrait rendre l’exploitation non rentable. Il n’est pas non plus « sans danger pour le climat », puisque le NFP compte déjà pour 0,05% des émissions totales de gaz à effet de serre, selon le rapport.

Le risque d' »incident » entraînant sa libération dans l’atmosphère, « nécessiterait de prévenir et de contrôler les fuites susceptibles de survenir à tous les stades de la chaîne de production », recommande le travail parlementaire.

Selon le Canard enchaîné, Arnaud Montebourg n’a pas encore publié le rapport sur le NFP, auquel ont contribué « géologues, économistes publics et privés » pour éviter de « fâcher les Verts avant les municipales ».

Dans un communiqué, le député EELV François-Michel Lambert a demandé jeudi à François Hollande et Jean-Marc Ayrault de « désavouer M. Montebourg qui bafoue délibérément les engagements pris par le Président ». Le président avait écarté en juillet toute exploitation durant son quinquennat.

M. Lambert « tient à rappeler que le gaz de schiste propre n’existe pas puisque son exploitation dégagera du CO2 à l’origine directe du réchauffement climatique », écrit-il par ailleurs.

M. Montebourg a dit jeudi dernier qu’il espérait « convaincre » François Hollande « d’avancer sur la recherche » de techniques « propres » pour l’exploitation des gaz et pétrole de schiste.

Le ministre Philippe Martin avait critiqué son collègue en soulignant que la France cherchait à réduire de 30% d’ici 2030 sa consommation d’hydrocarbures.

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

Moins d’un quart (24%) des Français sont favorables au développement du gaz de schiste comme source d’énergie en France, soit 11 points de moins que l’an passé, selon un sondage publié mercredi.

Cette enquête montre aussi que le soutien des Français à toutes les formes d’énergies décline, même si les énergies renouvelables sont encore plébiscitées.

A la question : « Selon vous, pour la production de chaleur et d’électricité, faut-il encourager en France le gaz de schiste ? », 24% (6%, « oui tout à fait » et 18%, « oui plutôt ») répondent par l’affirmative, contre 35% il y a un an, selon le baromètre annuel Qualit’EnR-Ifop.

Les sondés sont au total 63% à répondre « plutôt non » (25%) ou « non, pas du tout » (38%), tandis que 13% sont sans opinion au sujet de cette énergie.

Les énergies renouvelables caracolent de nouveau dans les souhaits des Français, avec 90% de soutien global et seulement 6% d’opposants à leur développement. Le soutien recule toutefois de 6 points sur un an.

Suit le gaz naturel (conventionnel, qui est distingué du gaz de schiste dans l’enquête, bien que celui-ci soit aussi du méthane), avec 66% de soutien, mais celui-ci baisse de 14 points en un an. 28% des sondés sont défavorables à son développement.

Le nucléaire arrive en troisième position, avec un soutien global de 45% (moins 9 points) et 48% d’opposants. Seuls le charbon (21%, moins 22 points) et le fioul (21%, moins 11 points) issu du pétrole, les deux énergies les plus émettrices de CO2, se placent derrière les hydrocarbures de schiste.

Au final, toutes les énergies voient leur soutien décliner dans l’opinion.

Côté portefeuille, 91% des sondés (baisse de 2 points sur un an) disent que leur facture énergétique (toutes énergies confondues) est « très élevée » (34%) et « assez élevée » (57%).

En revanche, ils ne sont plus que 78% à penser qu’elle va augmenter au cours des deux prochaines années, contre 88% début 2013. 6% des sondés la voient baisser et 16% rester stable.

Le sondage a été effectué du 2 au 6 janvier sur un échantillon représentatif de 1.004 personnes, via un questionnaire en ligne.

« Tous droits de reproduction et de représentation réservés. © 2014 Agence France-Presse. »

« Nous voulons rentrer dans les livres d’histoire et que l’on se souvienne de nous comme ayant rendu une technologie de pointe accessible au grand public ». Brendan Goh et Tsang You ne manquent pas d’ambition ! Et pour cause, ils vivent aujourd’hui un véritable conte de fées (technologique).

En 2009, ces étudiants de Singapour s’inscrivent à un concours. Le but : illustrer le principe de la thermochromie en fabriquant une bouteille de lait qui change de couleur selon la température du liquide. Afin de réaliser ce prototype innovant, les deux amis décident de recourir à une imprimante 3D. Mais l’expérience se révèle plus laborieuse que prévu…

Leur première machine tombe en panne. Ils déboursent 2000 euros pour se faire expédier un autre modèle de marque différente mais il leur faut ensuite passer un mois à assembler et calibrer leur nouvelle machine. L’imprimante montre régulièrement des signes des faiblesse jusqu’à ce que leur bouteille de lait finisse enfin par voir le jour ! Malgré le succès de l’opération, les apprentis imprimeurs sortent un peu dépités de l’aventure mais pas découragés : et s’ils créaient leur propre imprimante 3D ? Une imprimante fiable, moins chère, qui fait ce qu’on lui demande…

2011. L’idée se concrétise avec la création de Pirate 3D, une start up qui affiche clairement son objectif : conquérir les particuliers grâce à l’imprimante 3D personnelle la moins chère du marché. Non seulement la Buccaneer doit être plus compacte et plus abordable que ses concurrentes mais elle doit aussi se démarquer par son design épuré.

Un nouveau produit, plus beau, plus fiable, qui s’adresse au plus grand nombre… Comment ne pas penser à Apple et à son iPod désormais légendaire ? Bredan Goh ne s’en cache pas : « nous ne voulons pas nous contenter d’une imprimante 3D bon marché, nous voulons aussi innover dans ce genre de service et pourquoi pas créer une plateforme tel un iTunes Store avec des images que les utilisateurs pourraient acheter pour imprimer immédiatement leurs objets ».

Mais avant de débarquer dans tous les salons de la planète, la Buccaneer a besoin d’un soutien financier important. En janvier 2013, elle reçoit un premier coup de pouce. La société Red Dot Ventures investit 482 000 dollars. Les deux amis devenus entrepreneurs font leurs comptes : il leur manque encore 100 000 dollars. Qu’à cela ne tienne ! Ils lancent un appel au financement sur Kickstarter, une plateforme de financement participatif.

Et en seulement un mois, leur projet reçoit 1 438 765 dollars.

Cartouche centrale, boîtier en acrylique, façade en aluminium, filtre pour emprisonner les odeurs de plastique lors de l’impression, un seul voyant lumineux pour signaler sa mise en marche… La Buccaneer se veut simple, design et efficace.

Destinée aux particuliers, elle se place facilement sur un bureau grâce à des dimensions compactes : 15x10x12 cm et se connecte aux périphériques en Wi-Fi.

Alors que la Cube et la Replicator de Makerbot sont vendues respectivement 1299 dollars et 1956 dollars, la Buccaneer est disponible en précommande au prix de 497 dollars (647 dollars avec les frais de port).

La sortie officielle de l’imprimante est prévue quelques mois après les précommandes livrées fin mai 2014.

Un futur succès planétaire ?

Par Iris Trahin

Sources :

pirate3d.com

priximprimante3d.com/pirate3d

lesnumeriques.com/imprimante/buccaneer

3dnatives.com/pre-commandes-buccaneer-limprimante-3d-lowcost-ouvertes

Et aussi dans les

ressources documentaires :

Trois bureaux de poste proposent depuis bientôt 6 semaines l’accès à un espace de services autour de l’impression 3D. Celui-ci est aussi bien destiné aux particuliers qu’aux professionnels. Les clients peuvent choisir leur impression parmi les 120 références proposées dans le catalogue, amener leur propre fichier ou le choisir dans une base de données plus large.

Depuis le lancement de l’opération, la Poste constate une augmentation nette de la fréquentation des bureaux de postes en question. « En moyenne, entre 15 et 20 personnes par jour viennent exclusivement pour l’impression, dont un certain nombre de jeunes qui n’avaient pas du tout l’habitude de fréquenter nos bureaux », se félicite l’entreprise.

Les premiers retours montrent que les imprimantes sont utilisées à environ 60 % par des TPE/PME et à 40 % par le grand public. « Parmi les professionnels, on trouve des bijoutiers qui créent des prototypes, des architectes qui impriment des maquettes, des quincailleries qui impriment leur logo ou encore des artistes qui en profitent pour imprimer des objets », précise la Poste. « Avec les fêtes de Noël, on a aussi quelques particuliers qui en ont profité pour imprimer des cadeaux personnalisés », ajoute-t-elle. « On a aussi eu des demandes plus atypiques, comme celle d’un particulier qui a imprimé son cerveau en relief », s’amuse-t-elle.

Mais imprimer en 3D c’est long et cela reste encore assez cher. Une coque de smartphone, par exemple, vous coûtera 30 € pour un temps d’impression de 5 heures. En revanche, des bijoux peuvent aussi être édités à partir de 5 euros ! Pour les projets plus ambitieux, un devis est établi. En raison du délai d’impression, celles-ci ne se font pas sur place, mais dans les ateliers de Sculpteo, une société française spécialisée dans l’impression 3D et partenaire du projet. Une fois produits, les objets sont disponibles en quelques jours au bureau de poste.

Deux postiers par centre ont été formés au sein du FacLab de l’Université de Cergy-Pontoise et au sein de Sculpteo et travaillent à temps plein sur ces imprimantes pour conseiller les usagers. « Leur rôle est notamment d’expliquer ce qu’est l’impression 3D, finaliser les fichiers, répondre aux attentes, d’aider les clients à faire les bons choix techniques et d’envoyer les projets à l’impression », précise la Poste.

Ce projet est porté par la Direction de l’Innovation et du Développement de Services de la Poste qui souhaitait être pionnier dans le test de cette technologie auprès du grand public. « Comme les bureaux de postes sont à présent modernisés, il était aisé d’envisager l’expérience », explique La Poste. Le choix de la zone d’expérimentation en Ile-de-France s’est fait dans un souci de concentration des tests. Il y avait aussi plusieurs opportunités dans les zones choisies, notamment avec une certaine concentration d’agences de communication et de cabinets d’architecture. Au bout de 6 mois, la Poste étudiera les résultats avant de décider si elle étend ou non l’expérience à d’autres villes en France.

Par Matthieu Combe, journaliste scientifique

Et aussi dans les

ressources documentaires :

Créer des pâtes dans sa cuisine suivant son désir et avec la forme souhaitée… À première vue, l’idée aurait bien de quoi faire sourire. D’une part parce que la diversité des pâtes présentes dans le commerce est déjà bien conséquente mais aussi, et surtout, parce que l’idée peut sembler incongrue. Imaginez-vous découvrir dans votre assiette des pâtes aux allures d’animaux ou d’objets… Pas sûr que cela soit indispensable ni que cela améliore leur goût.

Pourtant Barilla croit en cette technologie – au potentiel extraordinaire et au développement sidérant ces derniers temps. Il faut dire que le concept est doublement malin. En permettant aux utilisateurs de concevoir leur modèle de pâte, grâce à un logiciel prévu à cet effet, l’implication dans le processus de création est totale et d’une certaine manière ludique pour peu que l’on se prenne au jeu. Il est donc probable que de nouveaux usages voient le jour. La gestion des stocks devrait également s’en trouver améliorée. Car avec l’imprimante 3D, on ne produit que ce dont on a besoin.

Mais l’intérêt majeur pour Barilla réside principalement dans la commercialisation des capsules contenant les matières premières, outre la vente des imprimantes. La firme est en train de dessiner un nouveau business model; qui est un peu à l’image de l’impression 3D aujourd’hui. Actuellement, bon nombre de start-up et grandes entreprises développent un concept similaire. Citons entre autres Natural Machines et son imprimante Foodini et la NASA avec son projet d’imprimante à pizzas pour nourrir les travailleurs de l’espace.

Le projet germe depuis deux ans dans la tête des dirigeants du géant de l’alimentaire. C’est depuis ce temps qu’il s’est adjoint les services de TNO, l’institut de recherche appliquée néerlandais (basée à Eindhoven), pour développer la fameuse imprimante 3D. Une version de l’imprimante est d’ores et déjà en test dans certains restaurants d’Eindhoven.

Toutefois quelques ajustements – tel qu’augmenter la vitesse d’impression – reste à faire pour la rendre opérationnelle. L’objectif est d’imprimer 15 à 20 pâtes en deux minutes. À ce sujet, le chef de projet TNO Kjeld van Bommel est optimiste « Nous pouvons y arriver. La vitesse a déjà été multiplié par dix depuis le début du projet ». La commercialisation devrait débuter dans le courant 2014.

Et aussi dans les

ressources documentaires :

Selon Didier Remoussenard, l’évolution à court terme est d’obtenir des machines capables de produire des pièces complexes sur-mesure et de ramener ce type de production en France. Le but : réaliser des objets en très peu de temps et les livrer aussi rapidement !

Il est désormais possible de créer en une minute le portrait en trois dimensions d’une personne qui peut ensuite l’imprimer où elle le souhaite. Pour les particuliers, cela permet aussi de lutter contre l’obsolescence programmée en remplaçant uniquement la pièce défectueuse d’un appareil ménager coûteux qui fonctionne parfaitement par ailleurs.

Pour les professionnels, cela dépend entièrement des besoins des clients.

Jusqu’à présent, l’impression 3D était réservée à des prototypes coûteux. Aujourd’hui, avec les possibilités des imprimantes par extrusion et les outils de conception plus abordables, la production d’une première maquette est devenue bien plus accessible. On peut ainsi obtenir des maquettes impressionnantes à partir de 1 000 euros.

Interview : Iris Trahin

Vidéo : Bruno Decottignies

Et aussi dans les

ressources documentaires :

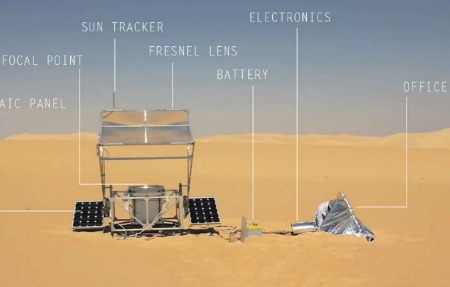

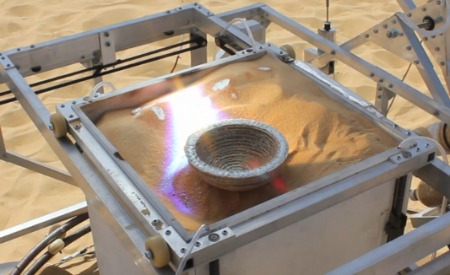

« En Août 2010, j’ai mis ma première machine solaire – le Sun-Cutter – dans le désert égyptien dans une valise. Il s’agissait d’une découpe laser semi-automatique de faible technicité à l’énergie solaire, qui utilise la puissance du soleil pour conduire et directement exploiter ses rayons à travers une lentille sphérique de verre à «laser» pour couper des composants 2D en utilisant un système de caméra guidée.