La catastrophe de Fukushima occupe l’actualité depuis plus de deux semaines. Le point sur les dernières informations.

Le nuage

Les poussières radioactives s’infiltrent partout dans la nature, quand passe un nuage nucléaire comme celui de Tchernobyl : dans les plantes, dans les rivières et les plans d’eau, dans les animaux. Tous les organismes vivants sont concernés. Roland Desbordes, président de la Commission de recherche et d’information indépendantes sur la radioactivité précise qu’il faut éviter d’ingérer des produits laitiers et des légumes : « Les particules transportées par les nuages radioactifs se fixent prioritairement sur les légumes à larges feuilles comme les salades et les épinards, mais aussi les champignons (les cèpes en particulier) et le thym ». « Vingt-quatre ans après l’accident de Tchernobyl, on mesure toujours la présence de césium 137 dans les zones contaminées. On en trouve également en France en très faible quantité, dans les zones les plus touchées par le nuage radioactif ukrainien, principalement dans l’Est et le Sud-Est », affirme encore Roland Desbordes.

Conséquences directes sur l’environnement au Japon

Selon les dernières informations de l’IRSN sur l’évaluation de la radioactivité dégagée par la centrale de Fukushima Daiichi (Fukushima I) jusqu’au 22 mars 2011, les principaux éléments radioactifs rejetés au cours des différents épisodes de rejet entre le 12 et le 23 mars seraient :

- des gaz rares (éléments radioactifs chimiquement peu réactifs, restant dans l’atmosphère sans se déposer au sol), notamment le xénon 133 dont la période radioactive est de 5,3 jours ;

- des éléments volatils, principalement des isotopes radioactifs de l’iode, du césium radioactif, du tellure radioactif. Ces éléments forment de fines particules en suspension dans l’air (aérosols) qui se déposent progressivement sur les surfaces au sol, au fur et à mesure de leur dispersion dans l’air ;

Les résultats de mesure dans l’environnement dont dispose l’IRSN, venant du Japon, confirme la présence principalement :

- d’iode 131 (période radioactive de 8 jours), d’iode 132 (période radioactive de 2,3 heures) et d’iode 133 (période radioactive de 20,8 heures) ;

- de tellure 132 (période radioactive de 3,2 jours) dont la décroissance radioactive produit de l’iode 132, ainsi que du tellure 129m (période radioactive de 33,6 jours) associé à du tellure 129 de période plus courte (1,16 heures) ;

- de césium 137 (période radioactive de 30 ans) et de césium 134 (période de 2,1 ans).

Conséquences des rejets dans l’environnement au Japon

Les éléments radioactifs sous forme de particules se déposent progressivement sur les différentes surfaces au sol, notamment sur les feuilles de plantes cultivées, sur l’herbe des pâtures, sur l’eau stagnante à l’air libre ou l’eau des rivières, sur les milieux urbains…

Les légumes à feuilles (épinards, salades, poireaux…) sont particulièrement sensibles à ces retombées radioactives et sont rapidement contaminés après l’accident. Les résultats des mesures effectuées au Japon, à plus de 100 kilomètres de la centrale de Fukushima, sur cette catégorie de produit le confirment. Ces résultats indiquent que pour l’iode 131 dans les épinards, le niveau maximal admissible au Japon pour la commercialisation et la consommation des denrées (2000 Bq/kg) sont systématiquement dépassés dans ces territoires. Il en est de même pour les césiums radioactifs, mais dans une moindre mesure (niveau maximal admissible au Japon de 500 Bq/kg). Les poireaux, qui offrent une surface foliaire plus faible au contact de l’air ambiant, semblent moins contaminés. La contamination des légumes à feuilles est certainement plus importante en se rapprochant du site de Fukushima, en fonction de l’importance des retombées radioactives.

D’une manière générale, la contamination de ces légumes peut rester importante dans les prochains jours. Au cours des semaines à venir, si de nouveaux rejets importants ne se produisent pas, une nette diminution de la contamination des légumes à feuilles devrait être observée, à cause de la décroissance radioactive des radionucléides à vie courte (iode 131) et de l’effet de la croissance végétale qui dilue la contamination initiale dans la masse de la plante.

AREVA reporte la livraison de combustible MOX au Japon

Autre effet collatéral de la catastrophe de Fukushima : le groupe de technologie nucléaire Areva SA a confirmé vendredi 25 mars que la livraison de combustible nucléaire MOX à des groupes énergétiques japonais qui devait être effectuée dans les jours qui viennent avait été reportée. Areva devait livrer du MOX, un combustible nucléaire produit à partir de plutonium et d’uranium appauvri, aux groupes énergétiques japonais Kensai Electric Power et Chubu Electric Power Co. Inc. (9502.TO) au cours des prochains jours. Un porte-parole d’Areva n’a pas été en mesure de préciser jusqu’à quand était reportée cette livraison. Le groupe écologiste Greenpeace a déclaré dans un communiqué de presse que les deux groupes japonais prévoyaient de repousser cette livraison à 2013, au plus tôt.

Le nucléaire… en Inde

L’Inde veut commercialiser des réacteurs à eau lourde et investit dans des mines d’uranium à l’étranger

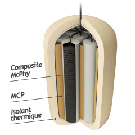

La Nuclear Power Corporation of India Limited est désormais prête a commercialiser des réacteurs à eau lourde pressurisée (PHWR) de capacités allant de 220 MWe à 540 Mwe. Selon Srikumar Banerjee, Directeur de l’Atomic Energy Commission (AEC), ces réacteurs, qui utilisent comme carburant de l’uranium naturel et l’eau lourde en tant que modérateur et liquide de refroidissement, représentent des alternatives intéressantes pour les pays désirants mettre en place des réacteurs de taille petite et moyenne à coût limité.

Le Dr. Banerjee a annoncé que quatre réacteurs à eau lourde pressurisée développés par l’Inde sont actuellement en cours de mise en place. La production électrique totale des 19 réacteurs actuellement mis en place est de 4 560 MW. Selon lui, deux réacteurs d’une puissance de 1000 MWe dans le Tamil Nadu développés avec la Russie sont actuellement en cours de finalisation. Le prototype de réacteur reproducteur rapide de Kalpakkam d’une puissance de 500 Mwe est lui à un stade avancé de construction. Le Dr. Banerjee a aussi annoncé que l’Inde allait renforcer ses capacités d’enrichissement d’uranium déjà bien implantées et mettre en place une structure de retraitement des déchets radioactifs.

Aussi, on a appris que l’Inde prévoit d’acheter des mines d’uranium à l’étranger afin d’alimenter ses réacteurs. Pour se faire, le Ministre à la Science et la Technologie, Prithviraj Chavan prévoit de créer une entreprise sur le modèle de l’ONGC Videsh (International Petroleum Company of India). Selon lui, il faudra encore du temps avant que l’Inde puisse entrer dans la phase 3 de son programme nucléaire imaginé par Homi Bhabha, considéré comme père du programme nucléaire indien. L’Inde ne peut encore utiliser du thorium dans ses réacteurs avant d’avoir des réserves de plutonium suffisantes. L’Inde possède de vastes réserves de thorium qui lui permettront d’assurer sa sécurité énergétique. Le ministre a annoncé la mise au point d’un réacteur a combustible métallique d’un puissance de 1000-MW d’ici 2022. En attendant, elle doit continuer à importer des réacteurs étrangers afin de subvenir à ses besoins en plutonium.

Zoom sur… l’Inde

L’Inde doit s’intéresser aux biocarburants de seconde génération

La production durable de biocarburants et les technologies de production de biocarburants de seconde génération devraient permettre à l’Inde d’atteindre les objectifs de développement écologique qu’elle s’est fixé. Selon le rapport de l’IISc (Indian Institute of Science) , l’Inde doit minimiser les effets indésirables de la production de biocarburants et développer des synergies afin de favoriser la reconquête des terres agricoles dégradées, l’amélioration des conditions de vie en milieu rural et la promotion de l’indépendance énergétique.

Les biocarburants de première génération étaient produits à partir de récoltes de sucre de canne de céréales et de végétaux. Les biocarburants de seconde génération sont eux produits grâce à la biomasse, aux végétaux et aux déchets agricoles. L’Inde importe les trois quarts du pétrole qu’elle consomme, soit environ 56 millions de mètres cubes en 2007. Selon l’IEA (International Energy Agency), d’ici à 2030, l’Inde sera le troisième plus gros importateur au monde avec une consommation estimée à 6 millions de barils par jour.

En 2009, l’Inde a annoncé un plan national pour les biocarburants dont l’objectif est de remplacer 20 % des énergies fossiles consommées par des biocarburants produits à partir de semences non comestibles. Le plan national assure aussi la promotion de la production de biocarburants en favorisant par exemple les opérations de plantation de jatropha dans les zones inadaptées aux pratiques agricoles.

Le centre de R&D Renault Nissan lance un programme de recherche sur les batteries Lithium en Inde

Renault Nissan Technology et le Business Centre India Pvt Ltd ont commencé leur travail de recherche sur les batteries. Le Centre, hébergé à proximité de Chennai au Mahindra World City Industrial Zone, va travailler sur la mise au point de batteries lithium selon les propos de Mr Haruyoshi Kumura, Directeur de la Fondation Scientifique Nissan.

Le centre collabore déjà avec Nissan et Renault dans des domaines variés allant jusqu’à la R&D. Ce centre emploie 1 500 personnes travaillant principalement dans trois domaines, l’ingénierie numérique, l’électronique, et la recherche. Le travail réalisé dans ce centre de R&D est employé dans toutes les filiales mondiales de Renault Nissan. Mr Kumura était à Chennai dans le but de signer deux MoU (accords cadres) avec l’IIT Madras ; l’un destiné à ouvrir la voie à un plan de soutien de la recherche, l’autre concernant la Nissan Foundation Scholar grâce à laquelle des élèves sélectionnés se verront invités à suivre un stage au siège de Nissan Japon.

Le gouvernement indien assure la promotion des véhicules hybrides

Le gouvernement indien va mettre en place un nouvel organisme doté d’un budget de 2 milliards de roupies, soit 33,2 millions d’euros afin d’assurer la promotion des technologies écologiques durables pour les véhicules hybrides et électriques. Le National Electric Mobility Mission tentera d’améliorer le taux de pénétration des véhicules hybrides et électriques sur le marché automobile et deux roues indien, largement dominé par les véhicules à combustible fossile, ce qui permettrait par la même occasion d’améliorer la qualité de l’air des villes indiennes.

Selon Ambuj Sharma secrétaire au Ministre des Industrie Lourdes, de nombreuses alternatives sont déjà disponibles sur le marché indien mais le manque d’infrastructures spécifiques (point de charge) et le surcoût à l’achat des véhicules hybrides nuisent à leur développement en Inde malgré des politiques d’incitation fiscale.

L’industrie des deux roues électriques compte en Inde plus de 36 acteurs avec une capacité de production d’1 million d’unités par an. Toutefois, les ventes annuelle ne s’élèvent pas à plus de 100 000 unités. L’entreprise Mahindra Reva Electric Vehicles, basée à Bangalore, a uniquement vendu quelques centaines d’unités sur le marché indien mais les véhicules hybrides ont un coût d’achat deux fois plus important que les véhicules traditionnels. Toyota et Honda qui ont tenté de diffuser leurs modèles sur le marché indien ont difficilement vendu une centaine d’unités. La mission National Electric Mobility rassemblera des représentants de différents ministères allant des Routes au Ministère à la Science et à la Technologie, afin d’apporter une réponse globale et transversale aux problèmes de développement du marché des véhicules respectueux de l’environnement.

Les piles à combustibles du futur mises au point en Inde

Les piles à combustibles convertissent l’énergie chimique d’une oxydation entre un combustible réducteur et une électrode, en énergie électrique. De nombreuses recherches sont menées sans réelles avancées. La venue d’une délégation anglaise à Chennai dans le but de développer un programme de recherche conjoint a cependant relancé le débat en Inde.

Chennai héberge le Centre for Fuel Cell Technology, centre autonome de R&D du Department of Science and Technology. De nombreux groupes de recherches couvrant divers aspects des technologies liées aux piles à combustibles sont représentés au sein de l’IIT Madras. Jason Green, Directeur de l’UK Energy Programme Engineering and Physical Sciences Research Council (EPSRC) a annoncé, en collaboration avec le DST, un appel à projet à hauteur de 7 millions d’euros. Le marché des générateurs diesel alimentant les antennes relais téléphonique représentent en Inde un marché de 1,4 milliards d’euros par an, l’efficacité énergétique étant une priorité. Murali Arikara, Vice Président exécutif d’ Emerging Markets, Intelligent Energy U.K., a annoncé que quelques installations avaient été mises en place afin d’étudier les potentialités de ce marché.

Selon David Book, chercheur de l’Université de Birmingham, l’Inde, les États-Unis et le Royaume Uni sont les premiers pays, en ce qui concerne le nombre de publications dans le domaine des piles à combustible. Mais l’une des principales difficultés liées au développement à grande échelle de ce type de technologie reste le coût. Une voiture équipée d’une pile à combustible à base d’hydrogène coûterait 10 fois plus qu’une voiture traditionnelle.

Les scientifiques doivent maintenant se concentrer sur l’étude de nouveaux oxydants qui permettraient de développer des piles à combustible à moindre coût.

Sources : Bulletins électroniques, CNRS, LeMonde.fr, Ademe

.jpg)