Alors que l’intérêt grandissant pour les Green ITs a entrainé la multiplication de solutions logicielles pour le monde de l’entreprise comme pour les particuliers, aidée en cela par une législation encore balbutiante, une jeune start-up française s’est intéressée en parallèle à la mise en place d’une solution matérielle, avec la conception d’un ordinateur éco-construit et peu gourmand en énergie, optimisé en réseau. D’autres se sont intéressés à réduire drastiquement l’impact écologique des « data centers », les centres de données, amenés à se multiplier, indispensables à la pérennisation du « cloud computing ».

L’avènement des « logiciels verts »

Les solutions logicielles vertes commencent à pulluler, proposant essentiellement deux types de service aux entreprises, dans des formules gratuites ou payantes, avec ou sans accompagnement :

- un audit de la consommation électrique ;

- un audit concernant l’empreinte Carbone.

40 % des ordinateurs seraient allumés 24h/24. Prenons le Avob Energy Saver, de la société Avob, « une des références françaises de la réduction de la consommation électrique des postes de travail. », selon le site « GreenIT.fr ». Non seulement il se propose d’éteindre les postes indûment allumés les soirs et weekend, comportement apparemment très répandu :http://www.greenit.fr/article/energie/40-des-ordinateurs-allumes-24-heures-sur-24-3452

Ce logiciel permet aussi de moduler la puissance du processeur d’un ordinateur en l’adaptant aux besoins de l’utilisateur, en ayant une approche dynamique de la consommation nécessaire, et non linéaire. Le système informatique devient alors moins gourmand, ne tournant plus constamment à plein régime.

Ils ont l’ambition de réaliser 10 millions de chiffres d’affaires à 3 ans, en investissant le marché américain, selon la Tribune : http://www.latribune.fr/green-business/l-actualite/20101222trib000585558/les-logiciels-verts-d-avob-gagnent-du-terrain.html

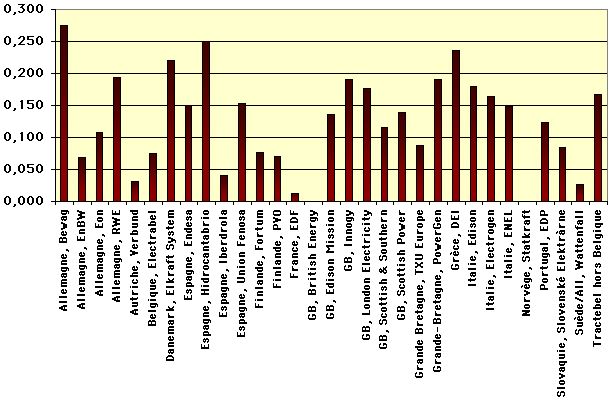

En effet, « contrairement à la France où le kWh électrique est peu émissif (80% d’énergie nucléaire) et bon marché, les Etats-Unis produisent leur électricité essentiellement à partir de sources primaires carbonées (pétrole, gaz, charbon). Par ailleurs, le prix du kWh y est plus cher. Les entreprises sont donc motivées pour réaliser des économies d’énergie. », toujours selon GreenIT.fr.

Carbon Hub

Dans le créneau « bilan Carbone », Carbon Hub, concepteur de logiciels de gestion environnementale permettant de maîtriser et de réduire l’impact environnemental des emissions de CO2 des entreprises et des collectivités locales, tout en réduisant les coûts initiaux, se démarque des autres acteurs de ce marché en mettant l’accent sur ses fonctions collaboratives, alors que longtemps les bilans se faisaient à l’aide… de fichiers Excel. Ronan Kerouedan, co-fondateur de Carbon Hub, insiste sur le fait que ce qui intéresse les entreprises et les collectivités, « c’est voir ce que font les autres et obtenir du contenu de qualité, échanger sur ce qui marche, sur ce qui ne marche pas, savoir combien ça coûte, quel fournisseur contacter, connaître les délais… ». Ces logiciels ont quelques beaux jours devant eux car c’est un marché appelé à se développer, les entreprises et les collectivités étant bientôt toutes dans l’obligation de mesurer leurs émissions de carbone, c’est en tout cas ce que laisse augurer une législation encore légère, mais chaque jour un peu plus restrictive.

Le « Pay As You Save », réponse inventive à une législation jugée trop faible

La France et l’Angleterre sont les deux pays les plus en avance dans le domaine législatif, bien qu’on puisse trouver ces lois faméliques comparées à leurs déclarations d’intentions. L’abandon de la Taxe Carbone, remplacée par les CEE… On constate d’abord qu’il n’existe pas de taxe carbone en France, pourtant prévue pour début 2010, avec un montant initial de 17 € la tonne de CO2, redistribués par la suite sous forme de crédits d’impôts, mais le projet fut enterré par la suite. Ce sont les certificats d’économie d’énergie (CEE) qui font désormais office de taxe carbone. (en savoir plus : http://www2.ademe.fr/servlet/KBaseShow?sort=-1&cid=96&m=3&catid=15024

On récompense ici les efforts des entreprises ayant mis en place des actions qui génèrent des économies d’énergie par l’obtention d’un certificat, les autres pouvant alors soit acheter ces certificats et ainsi financer et valorisant indirectement les efforts de rénovation énergétique des bons élèves, soit payer une surtaxe à l’état. Le coût de la pénalité est de 0,02 €/kWh cumulé accumulé (cumac) maximum et les certificats, qui ont leur propre marché, se négocient entre 0 et 0,02 €/kWh cumac.

On peut aussi souligner la création du concept de « Responsabilité sociale des entreprises » (RSE). La définition de la Commission européenne de la RSE est la suivante : « Un concept qui désigne l’intégration volontaire par les entreprises de préoccupations sociales et environnementales à leurs activités commerciales et leurs relations avec leurs parties prenantes ». Peu efficiente jusque là et dans l’état actuel des choses, il lui manque le corps et les applications pour que ce ne soit pas qu’une simple déclaration d’intention.

Greenwashing ?

On a souvent accusé certaines entreprises se servant de ces logiciels, parfois à juste titre, d’ « écoblanchiment » (en anglais, « greenwashing »), c’est à dire de se racheter une image plus verte, plus respectueuse de l’environnement auprès du grand public, instrumentalisant ainsi cette orientation en en faisant un coup marketing, ayant avant tout une approche économique et à court terme .

« La communication paie. Le Top10 des sociétés les plus “responsables” est constitué de très

grandes multinationales qui investissent des sommes colossales en communication. », toujours selon le site GreenIT.fr.

« Pay as you save »

C’est dans l’idée de responsabiliser les entreprises, tout en se rendant attractifs et en profitant de la frilosité législative que certains concepteurs de logiciels ont mis en place le modèle économique alternatif du « Pay As You Save », plutôt que de rester sur une licence annuelle.

Ce principe est assez limpide, comme l’explique Christelle Kerouedan, co-fondatrice de Carbon Hub : « nos clients nous rémunèrent uniquement s’ils parviennent à réduire leurs émissions de CO2 ». Ces éditeurs de logiciels, dont Carbon Hub et Avob font partie, prennent donc une commission sur l’argent ainsi économisé, système de rémunération moins statique et plus engageant que la simple licence, alors que nombre de logiciels jouent uniquement la carte de la stratégie de réduction des coûts, mettant en avant la diminution de la facture mais sans réelle valeur ajoutée, laissant de côté la nécessaire sensibilisation des utilisateurs et le pilotage de la réduction (laissant le logiciel faire « tout » le travail), oubliant aussi le recyclage des machines, l’allongement de la durée de vie des postes…

Alt, l’ordinateur éco-conçu

C’est fort de ce constat qu’une jeune entreprise française, Meta IT, localisée en région Aquitaine, a décidé de s’implanter dans ce vide relatif, en devenant le premier fabricant français d’informatique responsable. Bien que les concepteurs disent eux-mêmes qu’il serait un non-sens de parler d’ordinateur écologique, tout depuis la conception jusqu’à la réduction des impacts à la production, en passant par la diminution de la consommation en fonctionnement, ainsi qu’une plus grande maîtrise du cycle de vie, font de Alt une alternative originale et crédible aux ordinateurs classiques, tout du moins pour une utilisation professionnelle de gestion et de bureautique.

Une puissance appelée de 107 W en moyenne pour un ordinateur de bureau

En se concentrant sur cette utilisation bureautique, les concepteurs ne sont pas tombés dans le piège d’une inutile surenchère de la performance. En le débarrassant de tous les « gadgets superflus », cet ordinateur, n’est tout d’abord constitué que de quatre pièces en aluminium, constituant la « carcasse » au design épuré, de cinq pièces électroniques (pas de Wifi, ni de lecteur CD) ainsi que la connectique (elle aussi en aluminium), limitant dès sa conception son impact écologique. Son alimentation de faible puissance, sa faible consommation d’énergie (la puissance appelée en fonctionnement est de 107W en moyenne pour un ordinateur de bureau, 81W pour un ordinateur plus économe en énergie, et de 40W en moyenne pour les portables, selon une étude diligentée par Enertech pour le compte de l’Ademe, et selon Meta IT) leur ont permis de se débarrasser du ventilateur, très énergivore et soumis à l’usure mécanique car, selon les concepteurs, « l’alimentation spécifique de Alt est de 30 W avec un rendement de 90%, ce qui engendre seulement une perte d’énergie de 2 à 3 W », donc un échauffement très minime.

Sa durée de vie se voit allongée, tant par la robustesse de ses composants que par l’optimisation de leur utilisation. Il est d’autre part facilement réparable, (coûts de maintenance réduits ),le très petit nombre de pièces le composant, permettant le remplacement rapide et à moindre frais de la pièce défectueuse plutôt que l’onéreux retour en atelier, ce qui laisse présager là aussi une durée de vie supérieure à la normale. Autre point remarquable, Alt est assemblé localement et il est livré sans emballage.

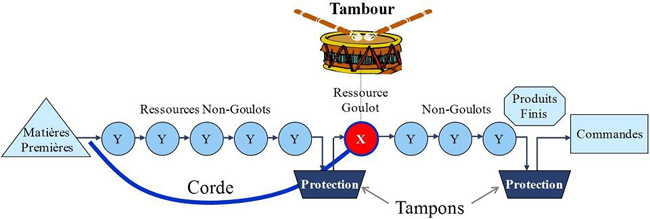

Un ordinateur optimisé pour fonctionner en réseau

Le Alt de Meta IT, pris à l’unité, est évidemment moins performant qu’un ordinateur récent dans la même gamme de prix, se concentrant sur les fonctionnalités standards utiles en bureautique (traitement de données, navigation internet…) mais, comme le précise Michael Gil de Muro, l’un des concepteurs, « le fonctionnement et le coût global sont optimisés en réseau ».Il fonctionne naturellement sous Windows ou Linux, mais « l’efficacité énergétique maximale est atteinte en réseau, plusieurs Alt avec un serveur Meta IT utilisant une technologie hybride (entre le réseau classique et le réseau de terminaux) basée sur l’emploi de serveurs peu énergivores en grappe (cluster). ». Lorsqu’il y a un pic de charge, celle-ci est donc redistribuée sur toutes les unités du réseau. Cela simplifie aussi grandement les mises à jour, la maintenance, les sauvegardes, et sécurise un peu plus les données. Il est donc destiné avant tout aux entreprises et aux collectivités.

Cette utilisation en terminal léger le rend donc idéal pour du « cloud computing » (la carte mère dispose d’un boot PXE). Il est à noter que l’implantation dans des bâtiments à haute performance énergétique et le retrait de la climatisation deviennent envisageables grâce à la réduction de la consommation électrique (l’extinction automatique soir/week-end de série, le 0W réel à l’arrêt), et à la réduction de l’enveloppe thermique des ordinateurs et des serveurs.

Le « Cloud-computing » et les centres de données

Le Cloud-computing est un concept d’externalisation des capacités de stockage, de calcul, et des logiciels (traditionnellement localisés sur le poste d’un utilisateur) sur des serveurs distants, les centres de données, la communication serveurs / ordinateurs étant assurée par internet.

Les experts estiment que les taux de croissance annuels devraient avoisiner les 40%, nouvelle grande tendance annuelle dans le monde des Technologies de l’Information et des Communications.

L’existence même du Cloud-Computing est, on le comprend, intimement liée à celle des Centre de Données, amenés à grandement se multiplier.

Les Data-centers pointés du doigt

Outre leur multiplication, les « data centers » sont particulièrement énergivores et polluants contribuant à tripler les émissions de gaz à effet de serre imputables à l’industrie de l’informatique et des télécommunications d’ici 2020. La consommation électrique du secteur atteindra alors 1963 Mds kWh.

L’Uptime Institute, Think Tank créé à l’initiative de plusieurs acteurs du secteur des centres de données, note que les infrastructures (qui comprennent le système de refroidissement et les équipements qui assurent l’alimentation électrique) consomment autant d’énergie que les serveurs hébergés dans le centre de données, que les centre de données sont sous-exploités, le taux de charge de travail moyen des serveurs serait de 20 %,l note aussi que la consommation électrique des serveurs pourraient diminuer (liée à l’inégalité des périodes d’activités).

La course à l’efficacité énergétique : le data center d’Hewlett Packard

Wynyard, dans le nord-est de l’Angleterre, choisie pour la clémence et la fraicheur de son climat, abritera le nouveau data center des américains d’HP, d’une surface d’environ 33 500 m². Le système de refroidissement, permettant de conserver une température ne dépassant jamais les 24°C, est composé de huit larges ventilateurs de 2,1 mètres de diamètre pour insuffler l’air extérieur dans l’enceinte du complexe. L’air, filtré, circule sous les serveurs. Lorsque l’air extérieur est trop frais, l’air chaud rejeté par les équipements informatiques est récupéré et mixé à l’air extérieur afin de réguler la température de l’air insufflé ensuite dans le data hall ».Cette méthode de refroidissement, devrait permettre à HP de réduire sa facture d’électricité de 2,6 M£ chaque année.

Les baies de serveur, blanches plutôt que noires, réfléchiront la lumière réduisant à priori de 40% l’éclairage intérieur. Ce système est complété par un réservoir d’une capacité de 80.000 litres, permettant « de stocker l’eau de pluie qui est ensuite utilisée pour maintenir le taux d’humidité entre 40 et 60% dans les data halls. Après filtrage, cette eau est vaporisée dans l’air stocké dans le plenum lorsque le taux d’humidité de celui-ci est trop faible.

Le « Power Usage Effectiveness »(PUE), indicateur mis au point pour mesurer l’efficience énergétique d’un data center, est calculé en divisant le total de l’énergie consommée par celui-ci par le total de l’énergie utilisée par l’équipement informatique (serveur, stockage, réseau). Le résultat est supérieur ou égal à 1. Un PUE le plus proche possible de 1 est préférable. Le centre de Wynyard dont le PUE est de 1,16, est donc l’un des data centres les plus efficaces énergétiquement parlant dans le monde. Pour se faire une idée, la plupart des data centers dans le monde flirtent plutôt avec un PUE de 2.

Mais Greenpeace explique dans son rapport « Make It Green » que la course à l’efficacité énergétique à laquelle se livrent les grandes entreprises du secteur telles que Microsoft, Google ou HP n’est qu’une solution partielle au problème de la réduction globale de l’impact écologique de cette industrie. Elle estime que d’un point de vue écologique, il est au moins aussi important de s’intéresser aux sources d’énergie utilisées pour alimenter les data centres qu’aux moyens mis en oeuvre pour diminuer leur consommation énergétique.

Les réponses logicielles et matérielles aux problématiques du développement durable et de l’éco-responsabilisation n’en sont qu’à leurs prémices. Elles doivent accompagner et susciter un changement de mentalité. Gageons que l’initiative de la start-up française « Meta It fera florès », et qu’elle entrainera dans son sillage une multitude d’autres initiatives innovantes. Jusqu’à arriver à un parc privé informatique plus vert, muni de logiciels verts? Il y a urgence, car le parc privé est en constante augmentation (surinformatisation dans les pays développés, taux de pénétration en augmentation dans les pays « émergents », dont l’Inde et la Chine).

M.R

Sources : ADEME, Les Bulletins électroniques, La Tribune, Greenit.fr