Compétition universitaire biennale internationale organisée depuis 2002 par le Département de l’Energie des Etats-Unis, le Solar Decathlon a pour objectif de développer la transmission des savoirs et de la recherche dans le domaine des énergies renouvelables et notamment de l’énergie solaire. Le principe est de faire concevoir et réaliser par une équipe d’étudiants architectes et ingénieurs encadrée par des enseignants et des chercheurs d’universités du monde entier, un prototype d’habitat passif avec le soleil pour seule source d’énergie. La première version européenne de ce concours aura lieu à Madrid du 18 au 27 juin. Comme son nom l’indique, le Solar Decathlon est une compétition où les concurrents seront notés suivant 10 critères, notamment » Innovation » et » Développement durable » qui n’existaient pas dans la version américaine. Chacun des vingt prototypes dont 2 français formeront un village solaire relié en réseau et sous monitoring constant pendant les 10 jours de la compétition. A partir de données objectives, mais aussi subjectives, un comité d’experts jugera leurs qualités architecturales, leurs performances solaires, leur pertinence sociale et notera le confort offert. Chaque projet doit respecter un ensemble de règles très précises. Ainsi, les dimensions et la forme du terrain sont imposées, la surface maximum ne doit pas excéder 74 m2, la surface habitable doit être de 42 m2 au minimum, la température intérieure doit être maintenue entre 22 et 24°C, l’humidité entre 40 et 55 %, et enfin le sol ne peut être ni creusé ni planté.

Le projet de l’Armadillo Box est porté par l’équipe » Architecture et Cultures Constructives » de l’Ecole Nationale Supérieure d’Architecture de Grenoble (ENSAG), en partenariat avec l’Institut de l’Energie Solaire (INES) et les Grands Ateliers de l’Isle d’Abeau (GAIA). En plus de créer un habitat écologiquement responsable, les étudiants de l’ENSAG se sont imposés des contraintes financières, dans le but de créer un projet non seulement autonome, mais aussi accessible financièrement à la majorité de la population et adapté au marché français. Par ailleurs, le prototype devant être construit en cinq jours, il est primordial de favoriser une architecture simple et légère. Le concept moteur de l’Armadillo Box est celui de la décomposition » core-skin-shell » qui permet le mariage de hautes technologies industrielles avec des systèmes constructifs simples et économiques :

- Core : un noyau technique préfabriqué comprenant la cuisine, la salle de bain, la machinerie et les systèmes de connexion aux fluides. Il peut être produit industriellement et amené sur le chantier prêt à monter ;

- Skin : une enveloppe thermique étanche à l’eau et à l’air constitue la partie Low tech et Low cost du projet. Elle est réalisée avec des matériaux naturels, locaux, économiques et faciles à mettre en œuvre : bois sous toutes ses formes (massif, laine, fibres, panneaux industrialisés), terre, acier démontable et recyclable, toile en fibres de verre précontrainte enduite de PVC… Elle peut être réalisée par une main d’œuvre peu qualifiée et peut intégrer une part d’auto-construction assistée par des professionnels ;

- Shell : un bouclier solaire, protecteur et capteur d’énergie, constitue l’élément High tech du projet. Il protège l’enveloppe thermique des aléas climatiques et capte l’énergie du soleil. Il est constitué d’éléments industriels de haute technologie qui sont installés par des spécialistes.

La maison est pensée pour pouvoir être reproduite facilement à un coût accessible au plus grand nombre : le noyau technique est conçu pour être préfabriqué et industrialisé ; l’enveloppe thermique peut au contraire être réalisée en auto-construction. Sa conception se prête par ailleurs à la réalisation de maison en bandes, ou d’immeubles collectifs dont elle constituerait l’unité d’habitation élémentaire.

Pour maintenir une température constante entre 22 et 24°C, il est d’abord nécessaire de posséder une bonne isolation. Armadillo Box utilise une enveloppe étanche à l’air, sans pont thermique et fortement isolée par une vingtaine de centimètres de laine de bois. En hiver, l’important est de conserver la chaleur à l’intérieur et d’exploiter au maximum les apports thermiques dégagés durant la journée – notamment ceux en provenance du soleil – pour en profiter la nuit. C’est là qu’entre en jeu l’inertie de l’enveloppe thermique. En partie composée de terre, elle permet d’accumuler de l’énergie pour ensuite la rediffuser avec un certain déphasage horaire. Durant cette saison, les toiles protectrices du bouclier protecteur sont relevées, pour permettre aux murs de capter le plus possible de chaleur. Le bouclier se referme ensuite la nuit, pour conserver cette chaleur à l’intérieur et permettre à l’enveloppe de la diffuser.En été, c’est exactement l’inverse qu’il faut rechercher. En effet, l’important est de ne pas laisser entrer la chaleur et d’essayer de conserver la fraîcheur de la nuit pour ensuite l’exploiter durant la journée. Au coucher du soleil, les toiles protectrices seront donc relevées, et le bouclier protecteur sera totalement clos durant la journée afin de procurer de l’ombre à la masse des murs de l’enveloppe qui joue un rôle d’accumulateur tampon et qui relâche la chaleur accumulée le jour grâce à une très bonne ventilation nocturne.En fonctionnant uniquement avec ces stratégies passives, Armadillo Box nécessite déjà très peu d’énergie pour fonctionner, puisque ses besoins sont évalués à 32,8 kW.h/m2/an (chauffage, eau chaude, ventilation) soit 1873 kW sur l’année.Stratégies actives : pour répondre au cahier des charges du Solar Decathlon, c’est-à-dire obtenir un habitat positif en énergie, les dispositions passives ne suffisent pas. Il faut donc développer des stratégies actives qui permettent de compenser les besoins, et si possible, produire un surplus d’énergie à insuffler dans le réseau du village solaire.Armadillo Box possède une large surface de panneaux solaires, placés sur son toit, qui permettent l’approvisionnement en électricité de toute l’habitation, le fonctionnement d’un four, de 3 plaques de cuissons, d’un frigo, d’une machine à laver et sécher le linge, d’équipement HI-FI et multimédia (TV et PC). Les panneaux photovoltaïques produisent également assez d’électricité pour l’éclairage, la production de 40 % de l’eau chaude sanitaire. Quelques 3 m2 de panneaux thermiques assurent la production des 60 % d’eau sanitaire restant. Une machine compacte de type » 3 en 1 « , installée dans le noyau technique, prend en charge la ventilation double flux, la pompe à chaleur d’air repris, le chauffage et le rafraîchissement sur l’air entrant, l’eau chaude des sanitaires, et la connexion solaire thermique.Le problème majeur des panneaux solaires photovoltaïques (PV) réside dans le fait que seulement 15 % de l’énergie captée est transformée en électricité, le reste étant rediffusé sous forme de chaleur (qui peut provoquer une montée de la température jusqu’à 80°C en été, en sous-face des panneaux). Cette montée en température provoque une chute notable de la productivité des panneaux. Dans un souci de régulation thermique et de préservation des performances des PV, il est donc nécessaire de remédier à cet inconvénient par des dispositions spatiales. Le bouclier high tech est surélevé par rapport au toit de l’enveloppe afin d’assurer une très bonne ventilation de l’arrière des panneaux. Ceci permet d’évacuer la chaleur produite et de maintenir une température de fonctionnement optimale des panneaux en fonction des conditions climatiques. Un système de brumisateur est prévu pour rafraîchir le comble de la surtoiture. En octobre 2008, lors du dépôt de candidature, l’équipe d’Armadillo Box était la seule à décliner un projet qui associe habitat et transport et qui relève simultanément les défis énergétiques et climatiques. C’est maintenant chose faite sous la forme d’un ensemble de moyens de locomotion (vélo, scooter et voiture électriques, dont la recharge est assurée exclusivement par les modules photovoltaïques placés sur le toit de l’Armadillo Box par Ténésol, filiale du groupe Total, et Photo – watt. En effet, le bilan énergétique du pavillon intègre la consommation d’une voiture électrique qui ferait 14.000 km par an, soit beaucoup plus que la moyenne française.Si les deux roues sont déjà commercialisés, le choix s’est porté sur la C- Zen de Courb. Un prototype léger (500 kg) aux formes innovantes dues au designer industriel Boxer, conçu à partir de matériaux recyclables et doté de batteries lithium-ion. Petite urbaine, elle atteindre 90 km /h, elle affiche une autonomie de 160 km en cycle urbain, soit à 50 km/h et est équipée de technologies de pointe (radar de stationnement, géo-localisation du véhicule, affichage de la pression de pneu, alarme de dépassement de vitesse…). Un second véhicule électrique, la petite urbaine Think city que va bientôt distribuer Mobivia (ex Norauto) via sa filiale O2, sera également présent.

Les instigateurs du projet Nápévomó sont des élèves-ingénieurs de l’école des Arts et Métiers ParisTech de Bordeaux. L’équipe s’est attachée la force de recherche des laboratoires de l’école d’ingénieur Arts et Métiers, du centre de ressources technologiques Ecocampus / Nobatek et du Laboratoire Trefle UMR 8508, spécialisé notamment dans les transferts énergétiques Elle s’est aussi alliée la créativité de l’architecte chilien Gonzalo Rodriguez, et le savoir-faire de quelques entreprises régionales, plutôt des PME, avec des savoir-faire pointus dans leurs domaines respectifs. L’ensemble de la maison est préfabriqué en atelier. Les solutions énergétiques mises en oeuvre dénotent une réflexion technique très avancée et un souci de limitation de l’impact environnemental (autre qu’énergétique et carbonique) : système de production d’énergie solaire par concentration et suivi 1 axe (micro-cogénération) ; système de chauffage-ventilation-rafraîchissement » 3 en 1 » (VMC double flux thermodynamique) ; système passif de refroidissement d’air à matériaux à changement de phase ; toiture végétalisée légère et auto-irriguée ; système naturel de traitement des eaux usées par lombrifiltration ; système de domotique permettant une interface simple et transparente avec l’utilisateur ; solution complète d’isolation naturelle (fibre de bois et ouate de cellulose) ; construction bois 100 % pin maritime ; électroménager haute performance énergétique et usage de l’eau. L’équipe s’est fixée comme ambition de remporter l’épreuve » développement durable « , ce qui transparaît clairement dans les choix techniques. Ce projet met en exergue plusieurs avancées technologiques :

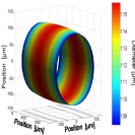

- utilisation d’un matériau à changement de phase, composé de paraffines, pour stocker la chaleur du jour et la restituer la nuit. En lissant les pics de température diurne ce matériau favorise ainsi le confort d’été et, couplé à un système de ventilation, il permet une réelle optimisation des échanges thermiques ;

- production d’énergie solaire optimisée grâce à un capteur hybride innovant : le concentrateur cylindro-parabolique. Ce système de micro-cogénération permet la production simultanée d’électricité et d’eau chaude. Priorité est donnée à l’utilisation directe en chauffage de la production d’eau chaude solaire, une véritable avancée par rapport à l’utilisation actuelle du solaire qui se limite essentiellement à la production d’eau chaude sanitaire. La maison Nápévomó peut fonctionner en » tout solaire « .

Son architecture bioclimatique est le premier élément de ce concept avec :

- des ouvertures en lien avec la course du soleil de manière à favoriser la pénétration de la lumière naturelle (ouverture zénithale), et à permettre les gains en chaleur (grandes ouvertures en façade sud) ;

- une toiture et un mur végétalisés auto-irrigués pour faciliter le rafraîchissement naturel de la maison et favoriser son confort d’été. L’irrigation se fait à partir de la récupération de l’eau de pluie et du recyclage naturel des eaux usées (par un procédé de lombrifiltration).

Bien que la technologie intégrée à Napevomo soit complexe et élaborée, la maison offrira à ses habitants un réel confort de vie grâce à une gestion facilitée par l’introduction de la domotique au quotidien de son utilisation. Pour exemple, la gestion des éclairages et la commande des persiennes sont entièrement automatisées.Par Marc Chabreuil

.jpg)

.jpg)