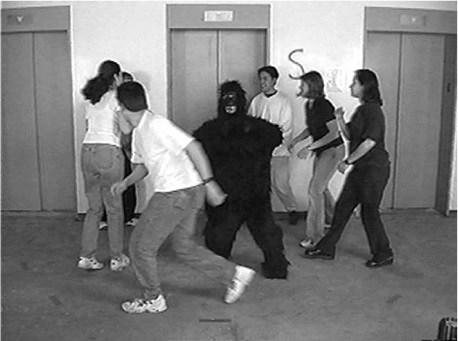

Les industriels présents en Pays de la Loire vont pouvoir profiter d’un tout nouvel espace de travail de réalité virtuelle. La réalité virtuelle, c’est l’association de technologies 3D avec de la capture de mouvements qui « permet d’immerger complètement un opérateur, de traquer son mouvement et son point de vue pour lui permettre d’interagir de l’intérieur », rappelle Sophie Levionnois, Directrice de ce nouveau centre Industriel de réalité virtuelle du Technocampus Smart Factory, intégré à la Jules Vernes Manufacturing Valley.

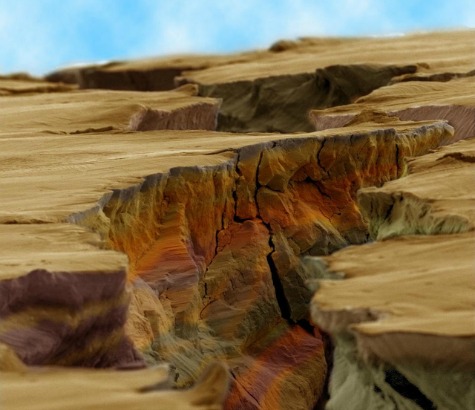

Les usages de ce nouveau centre seront multiples. Il offrira aux industriels de la région une solution innovante pour faire des présentations commerciales ou afin de mieux communiquer pour présenter leurs projets. Par exemple, STX pourra y présenter ses paquebots, Alstom ses éoliennes offshore, Airbus ses avions… Mais sur ce centre, les utilisations seront principalement techniques. Il s’agira de concevoir un produit ou un process de fabrication en réalité virtuelle. « Cela va nous permettre de tester l’ergonomie d’un poste de travail ou d’un produit, que cela soit dans l’automobile, dans le naval ou dans l’éolien », assure Sophie Levionnois.

La maintenance et l’usine du futur à l’épreuve

Les potentialités de la réalité virtuelle ne s’arrêtent pas à ces simples aspects. Cette autre réalité permet aussi de former, entraîner les opérateurs à faire des opérations dangereuses, complexes et coûteuses, en toute sécurité. Cela s’applique notamment à l’entretien maritime des éoliennes. « C’est l’un des plus gros usages que l’on va avoir ici », prévient Sophie Levionnois.

Dans ce cadre, la réalité virtuelle pourra aussi servir lors des opérations sur le terrain, grâce à la collaboration distante. Ainsi, une personne immergée dans la maquette pourra aider les opérateurs en opération dans une situation difficile. « Si l’on est accroché à un filin d’hélicoptère pour faire une opération sur le rotor d’une éolienne offshore, cela est plus facile si l’on est guidé par quelqu’un qui fait la même opération dans le virtuel », analyse Sophie Levionnois.

Cette plateforme est aussi une brique de l’usine du futur. «L’usine du futur, c’est l’idée que l’industrie comprendra des ateliers physiques et un clone virtuel qui contient toute l’intelligence industrielle qui va permettre de mieux faire fonctionner, plus rapidement, avec moins de défauts et moins de déchets cette usine réelle », prévoit la Directrice du centre virtuel. En plus de la réalité virtuelle, la réalité augmentée pourrait avoir toute sa place dans cette nouvelle définition de l’usine. « A travers la réalité augmentée, l’idée est d’amener aux opérateurs toute l’information nécessaire au bon endroit et au bon moment, de manière géolocalisée », précise-t-elle.

Ce centre de réalité virtuelle est intégré à la Jules Vernes Manufacturing Valley. Cette valée regroupe de grands industriels de 4 filières très développées dans la région : naval, aéronautique, énergie et automobile. Elle vise à regrouper des moyens et à les regrouper entre différents industriels pour optimiser les dépenses. Technocampus est un Groupement d’Intérêt Public (GIP) mandaté par la Région pour assurer la fréquentation des plateformes et mettre à disposition un outil « clés en main » aux industriels. La région Pays de la Loire est propriétaire et investisseur majoritaire des plateformes Technocampus. L’investissement complet pour ce site s’élève à 9 millions d’euros.Trois formules d’utilisation sont proposées aux industriels pour des tarifs compris entre 1 200 € et 1 680 € la demi-journée.

Par Matthieu Combe, journaliste scientifique

Et aussi dans l’actualité :

.jpg)